Tensorflow學習筆記之tf.nn.relu

Tensorflow學習筆記之tf.nn.relu

關於Tensorflow的學習筆記大部分為其他部落格或者書籍轉載,只為督促自己學習。

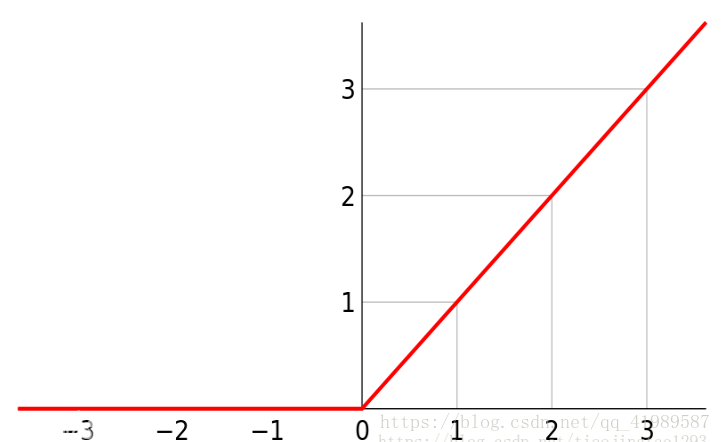

線性整流函式(Rectified Linear Unit,ReLU),又稱修正線性單元。其定義如下圖,在橫座標的右側,ReLU函式為線性函式。在橫座標的左側,ReLU函式值為0。

因此tf.nn.relu()的目的就是將輸入小於0的值設為1,輸入大於0的值不變。

相關推薦

Tensorflow學習筆記之tf.nn.relu

Tensorflow學習筆記之tf.nn.relu 關於Tensorflow的學習筆記大部分為其他部落格或者書籍轉載,只為督促自己學習。 線性整流函式(Rectified Linear Unit,ReLU),又稱修正線性單元。其定義如下圖,在橫座標的右側,ReLU函式為線性函式。在橫座標

Tensorflow學習筆記之tf.layers.conv2d

Tensorflow學習筆記 關於Tensorflow的學習筆記大部分為其他部落格或者書籍轉載,只為督促自己學習。 conv2d(inputs, filters, kernel_size, strides=(1, 1), padding='valid', d

TensorFlow學習筆記之--[tf.clip_by_global_norm,tf.clip_by_value,tf.clip_by_norm等的區別]

以下這些函式可以用於解決梯度消失或梯度爆炸問題上。 1. tf.clip_by_value tf.clip_by_value( t, clip_value_min, clip_value_max, name=None ) 輸入一個張量t,把t中的每一個元素的值都

TensorFlow函式之tf.nn.relu()

tf.nn.relu()函式是將大於0的數保持不變,小於0的數置為0,函式如圖1所示。 ReLU函式是常用的神經網路啟用函式之一。 圖1 ReLU函式影象 下邊為ReLU例子: import tenso

Tensorflow學習筆記之池化

Tensorflow學習筆記之池化 在深度學習網路中,經常會遇到池化操作,並且往往是在卷積之後,池化操作的意義是降低卷積層輸出特徵向量的維度,並且通過不同的池化方法使不同維度的卷積層輸出結果得到相同維度的特徵向量結果。 1、一般池化 池化過程作用於不重疊區域 我們定義池化視窗的大小為s

tensorflow常用函式之tf.nn.softmax

關於softmax的詳細說明,請看Softmax。 通過Softmax迴歸,將logistic的預測二分類的概率的問題推廣到了n分類的概率的問題。通過公式 可以看出當月分類的個數變為2時,Softmax迴歸又退化為logistic迴歸問題。

tensorflow學習筆記之使用tensorflow進行MNIST分類(3)

在載入MNIST資料集時候用到了Input_data.py。這段程式碼其實非常重要,現在和大家一起分享一下我的學習理解 #coding=utf-8 #input_data.py的詳解 #學習讀取資料檔案的方法,以便讀取自己需要的資料庫檔案(二進位制檔案) """Funct

TensorFlow學習筆記之疑問解答(持續更新)

1、tensorflow中一箇中括號和兩個中括號是什麼意思? b = tf.constant([3,3]) c = tf.constant([[3,3]]) with tf.Session() as sess: print(b,c) pri

TensorFlow學習筆記之原始碼分析(3)---- retrain.py

"""簡單呼叫Inception V3架構模型的學習在tensorboard顯示了摘要。 這個例子展示瞭如何採取一個Inception V3架構模型訓練ImageNet影象和訓練新的頂層,可以識別其他類的影象。 每個影象裡,頂層接收作為輸入的一個2048維向量。這

tensorflow學習筆記之使用tensorflow進行MNIST分類(2)

接著上一篇:http://blog.csdn.net/IEEE_FELLOW/article/details/53012351 本文參考Yann LeCun的LeNet5經典架構,稍加ps得到下面適用於本手寫識別的cnn結構,構造一個兩層卷積神經網路,神經網路的結構如下圖

TensorFlow學習筆記之五——原始碼分析之最近演算法

import numpy as np import tensorflow as tf # Import MINST data import input_data mnist = input_data.read_data_sets("/tmp/data/", one_hot=

《TensorFlow學習筆記》tf.concat函式用法

tf版本:1.5.0 concat官方定義 Args: values: A list of Tensor objects or a single Tensor. 單個張量或是一個關於張量的

TensorFlow學習筆記之三——適合入門的一些資源

Github上除了有TensorFlow的原始碼庫之外,還有一些很不錯的適合入門的資源。現在將目前已經接觸到的資源整理出來,和大家分享。1、TensorFlow原始碼庫https://github.com/tensorflow/tensorflow2、TensorFlow中文

TensorFlow學習筆記之——常用函式(概覽)

本文章內容比較繁雜,主要是一些比較常用的函式的用法,結合了網上的資料和原始碼,還有我自己寫的示例程式碼。建議照著目錄來看。1.矩陣操作1.1矩陣生成這部分主要將如何生成矩陣,包括全0矩陣,全1矩陣,隨機數矩陣,常數矩陣等tf.ones | tf.zeros tf.ones(

TensorFlow學習筆記之原始碼分析(1)----最近演算法nearest_neighbor

import numpy as np import tensorflow as tf # Import MINST data import input_data mnist = input_data.read_data_sets("/tmp/data/", one_hot

Tensorflow 學習筆記之使用LSTM實現MNIST資料集

LSTM實現MNIST手寫集識別 這幾天剛好看了RNN之後瞭解了LSTM(原理可以去參考這個)。雖然LSTM主要用於處理自然語言、語音、機器人翻譯等領域,但圖片也可以看做一個有序列的資料。所以用LSTM

TensorFlow學習筆記 —— tf.nn.nce_loss

Tensorflow 的NCE-Loss的實現和word2vec 這兩天因為實現mxnet的nce-loss,因此研究了一下tensorflow的nce-loss的實現。所以總結一下。 先看看tensorflow的nce-loss的API: def nce_loss(weights, b

Tensorflow學習筆記(用哪學哪)tf.nn.dropout

tf.nn.dropout(x, keep_prob, noise_shape=None, seed=None, name=None) 根據給出的keep_prob引數,將輸入tensor x按比例輸出。 預設情況下, 每個元素儲存或丟棄都是獨立的 x

Tensorflow學習筆記(2):tf.nn.dropout 與 tf.layers.dropout

You want to use the dropout() function in tensorflow.contrib.layers, not the one in tensorflow.nn. The only differences in the two funct

TensorFlow之tf.nn.dropout():防止模型訓練過程中的過擬合問題

AC -- 輸出 array 全連接 spa () 激活 odin 一:適用範圍: tf.nn.dropout是TensorFlow裏面為了防止或減輕過擬合而使用的函數,它一般用在全連接層 二:原理: dropout就是在不同的訓練過程中隨機扔掉一部分神經元。也就是