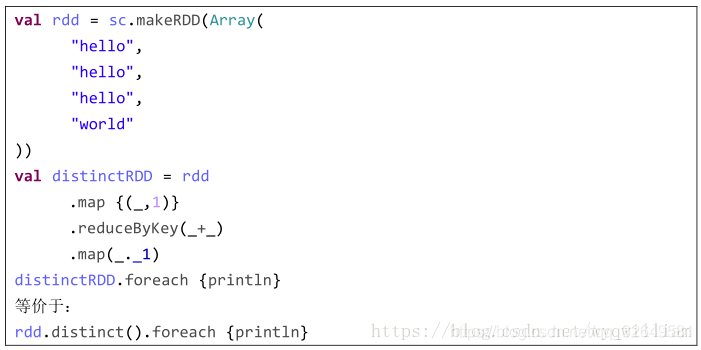

spark運算元:distinct去重的原理

1、Distinct是transformation運算元,不是action運算元。

2、Distinct的去重,是當key與value都一樣的時候,會被當做重複的資料。

也就是說,有多條key和value都相同的資料在執行完distincct之後,只會保留1條。

原文地址:https://blog.csdn.net/wyqwilliam/article/details/82110860

相關推薦

spark運算元:distinct去重的原理

1、Distinct是transformation運算元,不是action運算元。 2、Distinct的去重,是當key與value都一樣的時候,會被當做重複的資料。 也就是說,有多條key和value都相同的資料在執行完distincc

連結串列去重原理示意圖:改變原連結串列結構,不用新建連結串列

package interview.datastructure; import java.util.Hashtable; /** * 實現連結串列的插入和刪除結點的操作 */ public class Link_list { //定義一個結點 class Node { Node

Spark運算元:transformation之map、flatMap和distinct

1、map 將RDD中的每個元素通過map中的函式對映為一個新的元素,並返回一個新型別的RDD。輸入時的分割槽數與輸出時的分割槽數保持一致。 //HDFS上的txt檔案 hadoop fs -cat /tmp/1.txt hello world hello spark h

【spark】Spark運算元:RDD基本轉換操作–map、flagMap、distinct

map將一個RDD中的每個資料項,通過map中的函式對映變為一個新的元素。 輸入分割槽與輸出分割槽一對一,即:有多少個輸入分割槽,就有多少個輸出分割槽。 hadoop fs -cat /tmp/lxw1234/1.txthello worldhello sparkhello

spark 按某幾列distinct去重、topN、視窗計算的應用

在spark計算當中,我們日常有些簡單需求,比如去重,比如有四列(appid、date、type、platform),我們只需要對appid,date進行去重,另外兩列不關注。在spark中,distinct會對所有列執行去重操作,兩行比較,只要有個一列有差異

List<object>進行Distinct()去重

namespace strong equals ole 重寫 自定義對象 pan distinct 繼承 有時我們會對一個list<T>集合裏的數據進行去重,C#提供了一個Distinct()方法直接可以點得出來。如果list<T>中的T是個自定義對

Scrapy學習-18-去重原理

.py sort bsp url none ont digest set request Scrapy去重原理 scrapy本身自帶一個去重中間件 scrapy源碼中可以找到一個dupefilters.py去重器 源碼去重算法 # 將返回值放到集合set中

sql-distinct去重語句

原資料表exercise: select distinct(name) from exercise; select distinct(name),myorder from temp.exercise; select distinct(name),myorder,time from

十分透徹:電容去耦原理

一、電容退耦原理 採用電容退耦是解決電源噪聲問題的主要方法。這種方法對提高瞬態電流的響應速度,降低電源分配系統的阻抗都非常有效。 對於電容退耦,很多資料中都有涉及,但是闡述的角度不同。有些是從區域性電荷儲存(即儲能)的角度來說明,有些是從電源分配系統的阻抗

JavaStudy——0068:整數去重

總時間限制: 1000ms 記憶體限制: 65536kB 描述 給定含有n個整數的序列,要求對這個序列進行去重操作。所謂去重,是指對這個序列中每個重複出現的數,只保留該數第一次出現的位置,刪除其餘位置。 輸入 輸入包含兩行: 第一行包含一個正整數n(1 <= n <= 2

邊學邊敲邊記之爬蟲系列(三):url去重策略及實現

一、前言 今天給大家分享的是,Python爬蟲裡url去重策略及實現。 二、url去重及策略簡介 1.url去重 從字面上理解,url去重即去除重複的url,在爬蟲中就是去除已經爬取過的url,避免重複爬取,既影響爬蟲效率,又產生冗

Spark運算元:transformation之union、intersection、subtract

1、union:def union(other: RDD[T]): RDD[T] 該函式是不去重的合併兩個RDD。 scala> var rdd1 = sc.makeRDD(1 to 2,1) rdd1: org.apache.spark.rdd.RDD[Int]

Spark運算元:Action之first、count、reduce、collect

1、first:def first(): T 該函式返回RDD的第一個元素,不排序。 scala> var rdd1 = sc.makeRDD(Array(("A","1"),("B","2"),("C","3")),2) rdd1: org.apache.spar

Spark運算元:Action之countByKey、foreach、foreachPartition、sortBy

1、countByKey:def countByKey(): Map[K, Long] countByKey用於統計RDD[K,V]中每個K的數量。 scala> var rdd1 = sc.makeRDD(Array(("A",0),("A",2),("B",1)

Spark運算元:Action之saveAsTextFile、saveAsSequenceFile、saveAsObjectFile

1、saveAsTextFile 1)def saveAsTextFile(path: String): Unit 2)def saveAsTextFile(path: String, codec: Class[_ <: CompressionCodec]): Uni

Spark運算元:transformation之鍵值轉換groupByKey、reduceByKey、reduceByKeyLocally

1、groupByKey 1)def groupByKey(): RDD[(K, Iterable[V])] 2)def groupByKey(numPartitions: Int): RDD[(K, Iterable[V])] 3)def groupByKey(parti

Spark運算元:transformation之鍵值轉換combineByKey、foldByKey

1、combineByKey 1)def combineByKey[C](createCombiner: (V) => C, mergeValue: (C, V) => C, mergeCombiners: (C, C) => C): RDD[(K, C)

Spark運算元:transformation之鍵值轉換join、cogroup

1、join 1)def join[W](other: RDD[(K, W)]): RDD[(K, (V, W))] 2)def join[W](other: RDD[(K, W)], numPartitions: Int): RDD[(K, (V, W))] 3)def

spark運算元:滑動視窗函式reduceByKeyAndWindow的使用

1.reduceByKeyAndWindow這個運算元也是lazy的,它用來計算一個區間裡面的資料,如下圖: 截圖自官網,例如每個方塊代表5秒鐘,上面的虛線框住的是3個視窗就是15秒鐘,這裡的15秒鐘就是視窗的長度,其中虛線到實線移動了2個方塊表示10秒鐘,這裡的10秒鐘就表示每隔10秒計算一

scrapy的去重原理

對於每一個url的請求,排程器都會根據請求得相關資訊加密(類似於MD5)得到一個指紋資訊,並且將指紋資訊和自己維護的一個集合中的url指紋資訊進行比對,如果集合中已經存在這個指紋,就代表出現重複請求,就不再將這個Request放入佇列中。如果集合中沒有存在這個指紋,就將這個Request物件放入佇列