Hoeffding不等式

阿新 • • 發佈:2018-12-11

在看統計學習方法證明泛化誤差上界中提到使用Hoeffding不等式(霍夫丁不等式)

很陌生,佔個坑理解一下。

關於該不等式的原地址:Hoeffding's inequality

Hoeffding不等式指的是某個事件的真實概率與在伯努利試驗中觀察到的頻率之間的差異

考慮到伯努利實驗,該實驗是在同樣的條件下重複地、相互獨立地進行的一種隨機試驗,其特點是該隨機試驗只有兩種可能結果:發生或者不發生。比較熟悉的一種就是0-1分佈,也叫兩點分佈。

用H(n)表示拋n次硬幣正面向上的概率

則正面向上的次數不超過k的概率為

當k=(p-ε)n時,霍夫丁上界將會按照指數級變化,得到霍夫丁不等式

當k=(p+ε)n時

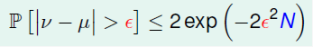

兩式合併,得到

令

得到

在《統計機器學習》中的Hoeffding的公式好像有很多的版本。

證明實在沒看懂,就依據例子簡單的瞭解一下吧。

不少部落格舉到一個從小罐中裡摸小球的例子,從一個裝有綠色和黃色的罐子裡隨機地摸出小球,根據摸出小球的概率來估計整個罐子中綠色球和黃色球的所佔的比例。

那麼當抽出的樣本數越多,最終預測出的綠球佔整個罐子中小球的概率u會越趨近於實際罐子中綠色小球佔整個罐子小球的概率v。

所以就有了霍夫丁不等式,在一個含有N個樣本數(N足夠大)的資料集中,在誤差允許的範圍內,u和v可以不斷地靠近。左側的概率隨著N的增大而減少,所以,要減少預測和實際之間的誤差,就要增大樣本數量。

附一張參考博文2裡的圖,不做多的解釋。

參考博文:

1、機器學習數學原理(8)——霍夫丁不等式 對原英文文章的翻譯