大資料hadoop叢集的搭建總結及步驟

CentOS6.5mini版hadoop叢集搭建流程

CentOS 7 系列:

關閉防火牆:systemctl stop firewalld

禁止防火牆開機啟動:systemctl disable firewalld

安裝虛擬機器的時候需要配置好主機名和網路

主機名:master,slave1,slave2

網路配置:

1. 自動連線

2. ipv4 手動

------------------ 三個都要執行的操作

-2.驗證網路配置是否正確:ifconfig

-1.驗證主機名是否正確:hostname

master,slave1,slave2

0. 安裝 ssh 服務 (mini版要安裝ssh, 桌面版無須安裝 ssh )

yum -y install openssh-server 安裝 ssh 伺服器

yum -y install openssh-clients 安裝 ssh 客戶端

1. 分別關閉防火牆

service iptables stop

2. 分別禁止防火牆開機啟動

chkconfig iptables off

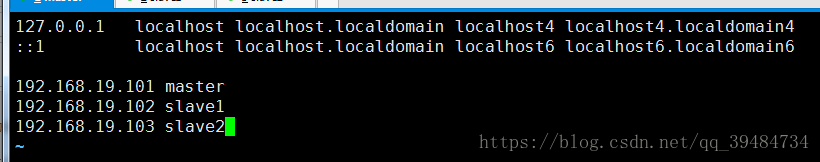

3. 分別配置 /etc/hosts 檔案,增加一下內容

192.168.37.101 master

192.168.37.102 slave1

192.168.37.103 slave2

4. 分別執行 ssh-keygen 生成公鑰和私鑰

5. 分別執行 ssh-copy-id master /root/.ssh/id_rsa.pub 把公鑰傳送給 master

----------------- master 執行的操作

6. master 執行 cat /root/.ssh/authorized_keys 檢查是否收集到了所有的公鑰

7. master 執行命令把 authorized_keys 傳送給 slave1 和 slave2

scp /root/.ssh/authorized_keys [email protected]:/root/.ssh/

scp /root/.ssh/authorized_keys [email protected]:/root/.ssh/

------------------ 三個都要執行的操作

8. 分別執行,共 9 次

ssh master exit

ssh slave1 exit

ssh slave2 exit

消除第一次登入的 yes

------------------ 以下操作都在 master 上進行

9. 上傳 jdk 到 master 的 /opt/SoftWare 資料夾

10.解壓 jdk tar -xvf jdk

11.配置 jdk 環境變數 vi /etc/profile

在檔案最後追加一下內容:

export JAVA_HOME=/opt/SoftWare/jdk1.8.0_141

export JRE_HOME=/opt/SoftWare/jdk1.8.0_141/jre

export CLASSPATH=.:$JRE_HOME/lib/rt.jar:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export PATH=$PATH:$JAVA_HOME/bin:$JRE_HOME/bin

12.重新整理環境變數 source /etc/profile

13.驗證是否配置成功 java -version

15.上傳 hadoop 到 /opt/SoftWare 並解壓

16.進入解壓後的 hadoop 資料夾建立

tmp,logs,hdfs,hdfs/name,hdfs/data 五個資料夾

16.使用 nodepad++ 進行配置檔案的修改,都在 hadoop-2.7.3/etc/hadoop

1. hadoop-env.sh

修改第 25 行的 ${JAVA_HOME} 為自己的 jdk 安裝目錄

2. yarn-env.sh

修改第 23 行,解註釋,修改路徑為自己的 jdk 安裝目錄

3. salves

修改 localhost 為 slave1 和 slave2

4. mv mapred-site.xml.template mapred-site.xml 重新命名 mapred-site.xml.template

5. 配置檔案參考附件

17.把 SoftWare 資料夾拷貝到 slave1 和 slave2 的 opt 下

scp -r /opt/SoftWare/ [email protected]:/opt/

scp -r /opt/SoftWare/ [email protected]:/opt/

18.把 /etc/profile 檔案拷貝到 slave1 和 slave2 的 /etc 下

scp /etc/profile/ [email protected]:/etc/

scp /etc/profile/ [email protected]:/etc/

------------------ 三個都要執行的操作

19.分別去 slave1 和 slave2 重新整理環境變數,驗證 java 是否配置成功

20.鎖定時間同步

安裝時間同步軟體 ntpdate:yum -y install ntp ntpdate

把時間寫入硬體進行鎖定:hwclock --systohc

----------------- master 執行的操作

21.進入 hadoop-2.7.3/bin 目錄

22.使用 ./hdfs namenode -format 進行格式化

出現 /hdfs/name has been successfully formatted 表示成功

不允許多次格式化,會導致叢集無法啟動

如果出錯:

1. 修改配置檔案

2. 刪除 三個 上的 hdfs/name 和 hdfs/data 資料夾

3. 把修改的內容傳送到 slave1 和 salve2 下

時刻保持 3 個虛擬機器的配置檔案是一致的

4. 重新格式化

23.進入 hadoop-2.7.3/sbin 目錄,使用 ./start-dfs.sh 啟動 hdfs 服務

---------------- 三個虛擬機器執行的命令

分別執行 jps 命令

master:

NameNode

SecondaryNameNode

slave1 和 slave2:

DataNode

訪問:http://192.168.37.101:50070

Live Nodes 2

----------------- master 執行的命令

24.進入 hadoop-2.7.3/sbin 目錄,使用 ./start-yarn.sh 啟動 yarn 服務

---------------- 三個虛擬機器執行的命令

25.分別執行 jps 命令

master:

ResourceManager

slave1 和 slave2:

NodeManager

訪問:http://192.168.37.101:8088

---------------- master 執行命令

26.進入 hadoop-2.7.3/sbin 目錄,使用 ./stop-dfs.sh 關閉 hdfs 服務

進入 hadoop-2.7.3/sbin 目錄,使用 ./stop-yarn.sh 關閉 yarn 服務

切記:關虛擬機器前先關閉 hadoop 叢集,不然可能會導致叢集的崩潰