機器學習-10(最優決策樹演算法的實際展示)

網上一大堆的文章,但是他們的介紹並沒有實際上說明為什麼使用最優決策樹,決策樹到底是什麼玩意

我這裡也不做類似的白話文解釋了,直接附圖來詳細生動的例子給大家演示why

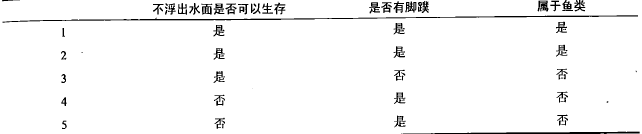

OK,現在我們先以是否浮出水面來分類

最終結果如圖

ok,經過我們層層的決策,結果如圖

最後結果是[1,1],[1,1]為魚類,[1,0],[0,1],[0,1]為非魚類,而其實我們在第一次判別是否浮出水面的時候已經把[0,1][0,1]排除在外了

我們實際經歷了2次決策,第一次決策排除了2個

現在我們試試以是否有腳蹼來分類

一樣是2次決策,但是第一次決策只排除了1個

很顯然我們用第一種決策方式,是屬於最優的

在此處資訊熵就是總的5個樣本的集合的訊號

而分類引起的資訊增益也就是劃分之後,我們剩下的子集需要多少訊號去表達的度量

經過第一種分類 剩下的表達就只有 0,1,10三個就可以儲存下

而第二種我們需要0,1,10,11才可以儲存下。

明顯第一種劃分之後純度更高(資訊熵-分類資訊熵),是我們的最優選擇

這就是所謂的決策樹演算法,也就是每次遞迴,我們要去選取哪一種類別佔主要因素

相關推薦

機器學習-10(最優決策樹演算法的實際展示)

網上一大堆的文章,但是他們的介紹並沒有實際上說明為什麼使用最優決策樹,決策樹到底是什麼玩意 我這裡也不做類似的白話文解釋了,直接附圖來詳細生動的例子給大家演示why OK,現在我們先以是否浮出水面來分類 最終結果如圖 ok,經過我們層層的決策,結果如圖

小白自學機器學習之一文讀懂決策樹演算法詳解

1.概念準備 1.1 遞迴與迭代 迭代是人,遞迴是神。 區別 定義 優缺點 遞迴(recursion) 程式呼叫自身

機器學習--DIY筆記與感悟--②決策樹(1)

lis ... 編寫代碼 需要 總結 初始化 對數 三分 xtend 在完成了K臨近之後,今天我們開始下一個算法--->決策樹算法。 一、決策樹基礎知識 如果突然問你"有一個陌生人叫X,Ta今天需要帶傘嗎?", 你一定會覺得這個問題就像告訴你"兩千米外有一個超市,

機器學習入門 - 1. 介紹與決策樹(decision tree)

recursion machine learning programmming 機器學習(Machine Learning) 介紹與決策樹(Decision Tree)機器學習入門系列 是 個人學習過程中的一些記錄與心得。其主要以要點形式呈現,簡潔明了。1.什麽是機器學習?一個比較概括的理解是:

《機器學習》第三章 決策樹學習 筆記加總結

分類問題 子集 觀察 組成 cas 普通 重復 1.0 需要 《機器學習》第三章 決策樹學習 決策樹學習方法搜索一個完整表示的假設空間,從而避免了受限假設空間的不足。決策樹學習的歸納偏置是優越選擇較小的樹。 3.1.簡介 決策樹學習是一種逼近離散值目標函數的方法,在這種方法

機器學習二——分類算法--決策樹DecisionTree

其中 .cn 比較 輸出 選擇 結構 沒有 ati 流程圖 機器學習算法評估標準:準確率,速度,強壯性(噪音影響較小),可規模性,可解釋性。 1、決策樹 Decision Tree:決策樹是一個類似於流程圖的樹結構,其中每個內部節點表示在一個屬性上的測試,每一個分支代表

機器學習實戰讀書筆記(2)--決策樹

決策樹 決策樹的一個重要任務是為了資料中所蘊含的知識資訊,因此決策樹可以使用一系列不熟悉的資料集合,並從中提取系列規則,在這些機器根據資料集建立規則時,就是機器學習的過程.專家系統中經常使用決策樹 決策樹的構造 優點:計算複雜度不高,輸出結果易於理解,對中間值缺失不敏

C++單刷《機器學習實戰》之二——決策樹

演算法概述:決策樹是用於分類的一種常用方法,根據資料集特徵值的不同,構造決策樹來將資料集不斷分成子資料集,直至決策樹下的每個分支都是同一類或用完所有的特徵值。 決策樹的一般流程: (1)收集資料 (2)準備資料:樹構造演算法只適用於標稱型資料,因此數值型資料必須離散化,最好轉為bool型

機器學習實戰程式碼_Python3.6_決策樹_程式碼

決策樹程式碼 from math import log import operator def calc_shannon_ent(data_set): num_entries = len(data_set) label_counts =

《機器學習實戰》之三——決策樹

花了差不多三天時間,終於把《機器學習實戰》這本書的第三章的決策樹過了一遍,知道了決策樹中ID3的一個具體編法和流程。 【一】計算資料資訊熵 這段程式碼主要是用於計算資料的每個特徵資訊熵,資訊熵用於描述資料的混亂程度,資訊熵越大說明資料包含的資訊越多,也就是資料的波動越大。而ID3演算

機器學習實戰(第三篇)-決策樹簡介

我們經常使用決策樹處理分類問題,近來的調查表明決策樹也是最經常使用的資料探勘演算法。它之所以如此流行,一個很重要的原因就是使用者基本上不用瞭解機器學習演算法,也不用深究它是如何工作的。 如果你以前沒有接觸過決策樹,不用擔心,它的概念非常簡單。即使不知道它也可以通

機器學習實戰(第三篇)-決策樹構造

首先我們分析下決策樹的優點和缺點。優點:計算複雜度不高,輸出結果易於理解,對中間值的卻是不敏感,可以處理不相關特徵資料;缺點:可能會產生過度匹配問題。適用資料型別:數值型和標稱型。 本篇文章我們將一步步地構造決策樹演算法,並會涉及許多有趣的細節。首先我們先討論數

秦剛剛的機器學習成長之路之決策樹總結

決策樹之分類樹和迴歸樹 本文主要講解最常用的3種決策樹(ID、C4.5和CART),為了更加系統和全面的認識這3種常用的決策樹演算法,我將從以下4個部分進行講解: 1.決策樹學習演算法步驟有哪些? 2.常用的決策樹演算法有哪幾種? 3.決策樹剪枝 4.Gini指數與熵的關係 1.

【機器學習基礎】梯度提升決策樹

引言 上一節中介紹了《隨機森林演算法》,該演算法使用bagging的方式作出一些決策樹來,同時在決策樹的學習過程中加入了更多的隨機因素。該模型可以自動做到驗證過程同時還可以進行特徵選擇。 這一節,我們將決策樹和AdaBoost演算法結合起來,在AdaBoos

Spark2.0機器學習系列之3:決策樹及Spark 2.0-MLlib、Scikit程式碼分析

概述 分類決策樹模型是一種描述對例項進行分類的樹形結構。 決策樹可以看為一個if-then規則集合,具有“互斥完備”性質 。決策樹基本上都是 採用的是貪心(即非回溯)的演算法,自頂向下遞迴分治構造。 生成決策樹一般包含三個步驟: 特徵選擇 決策樹生成 剪枝

Matlab自帶的分類學習工具箱(SVM、決策樹、Knn等分類器)

在matlab中,既有各種分類器的訓練函式,比如“fitcsvm”,也有圖形介面的分類學習工具箱,裡面包含SVM、決策樹、Knn等各類分類器,使用非常方便。接下來講講如何使用。 啟動: 點選“應用程式”,在面板中找到“Classification Lea

python機器學習實戰2:實現決策樹

1.決策樹的相關知識 在之前的接觸中決策樹直觀印象應該就是if-else的迴圈,if會怎麼樣,else之後再繼續if-else直至最終的結果。在上節講的kNN它其實已經可以完成很多工,但是它最大的缺點就是無法給資料集的內在含義,決策樹的主要優勢在於資料形式非常

通過網格搜尋和巢狀交叉驗證尋找機器學習模型的最優引數

在機器學習的模型中,通常有兩類引數,第一類是通過訓練資料學習得到的引數,也就是模型的係數,如迴歸模型中的權重係數,第二類是模型演算法中需要進行設定和優化的超參,如logistic迴歸中的正則化係數和決策樹中的樹的深度引數等。在上一篇文章中,我們通過驗證曲線來尋找最優的超參,在

機器學習實戰第三章——決策樹(原始碼解析)

機器學習實戰中的內容講的都比較清楚,一般都能看懂,這裡就不再講述了,這裡主要是對程式碼進行解析,如果你很熟悉python,這個可以不用看。 #coding=utf-8 ''' Created on 2016年1月5日 @author: ltc ''' from mat

機器學習實踐-第三章 決策樹

計算給定資料集的夏農熵from math import log import operator def calcShannonEnt(dataSet): numEntries = len(dat