迴歸——支援向量機迴歸(SVR)

支援向量機迴歸(SVR)是支援向量機在迴歸問題上的應用模型。支援向量機迴歸模型基於不同的損失函式產生了很多變種。本文僅介紹基於

核心思想

找到一個分離超平面(超曲面),使得期望風險最小。

ϵ -SVR

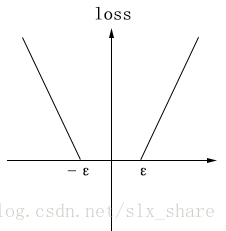

ϵ -損失函式

基於

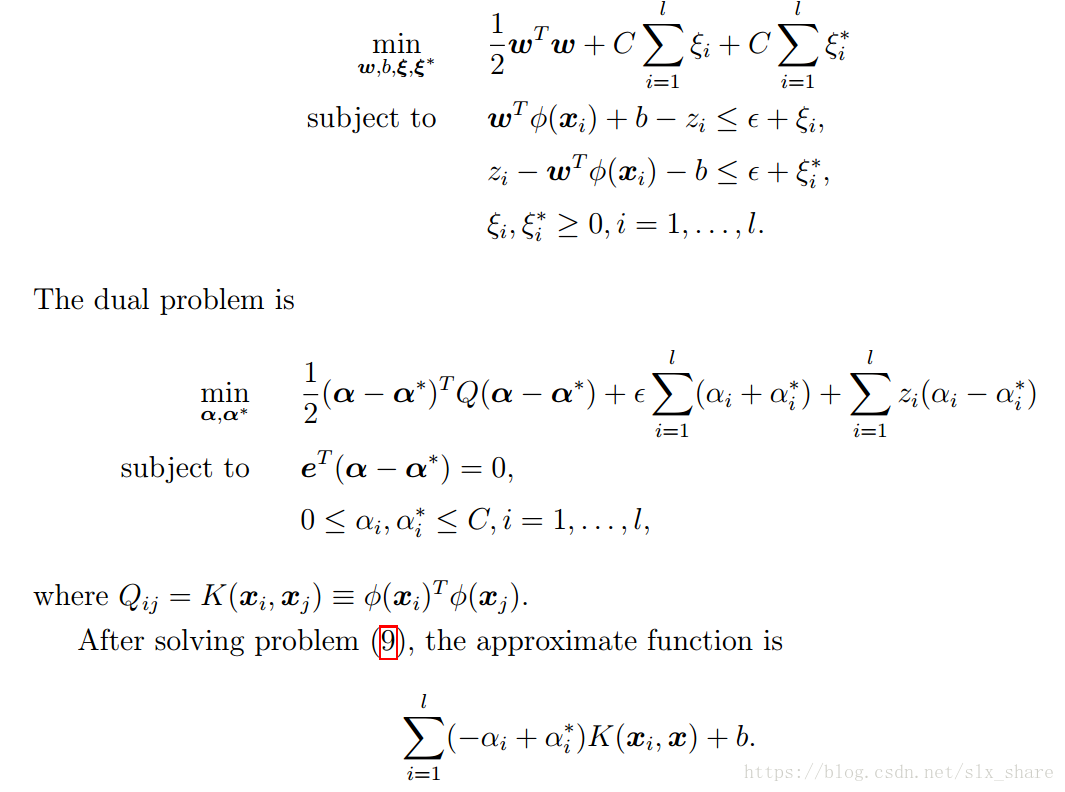

優化問題如下:

ν -SVR

同

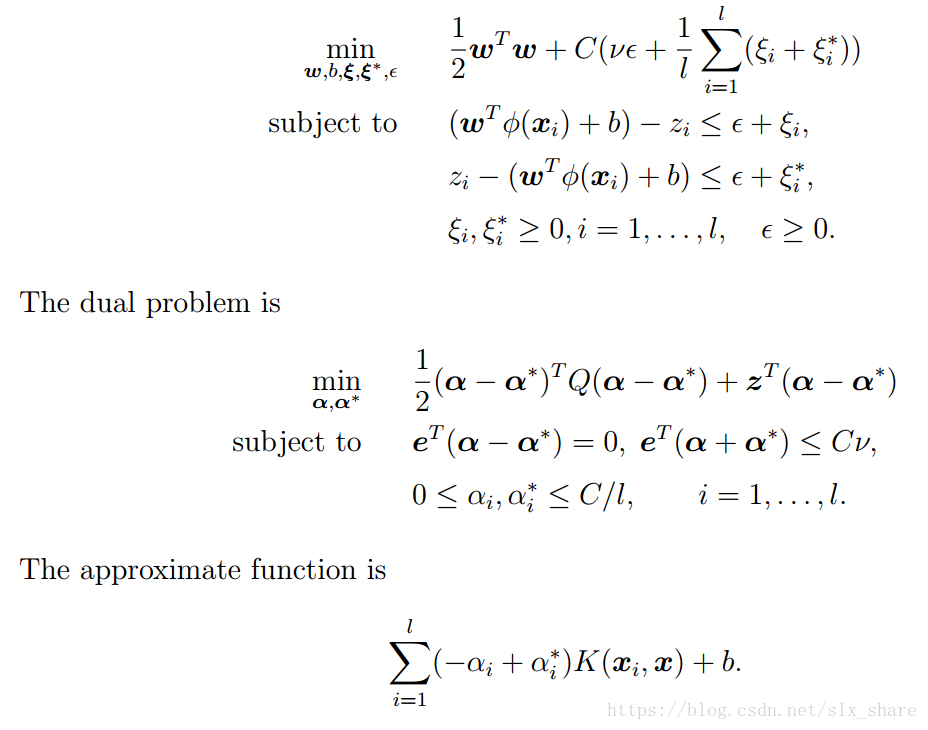

優化問題如下:

支援向量

直觀地理解,支援向量就是對最終的w,b的計算起到作用的樣本(

注:圖片來自LIBSVM指導文件

我的GitHub

注:如有不當之處,請指正。

相關推薦

迴歸——支援向量機迴歸(SVR)

支援向量機迴歸(SVR)是支援向量機在迴歸問題上的應用模型。支援向量機迴歸模型基於不同的損失函式產生了很多變種。本文僅介紹基於ϵϵ不敏感損失函式的SVR模型。 核心思想 找到一個分離超平面(超曲面),使得期望風險最小。 ϵϵ-SVR ϵϵ-損失函

sklearn中svr(支援向量機迴歸)

支援向量機也可以用來回歸 from sklearn.svm import SVR import numpy as np n_samples, n_features = 10, 5 np.random.seed(0) y = np.random.rand

機器學習二十二:支援向量機迴歸SVR

AI菌在前四篇裡面我們講到了SVM的線性分類和非線性分類(核函式),以及在分類時用到的SMO演算

libsvm支援向量機迴歸示例

libsvm支援向量機演算法包的基本使用,此處演示的是支援向量迴歸機 import java.io.BufferedReader; import java.io.File; import java.io.FileReader; import java.util.ArrayL

機器學習之支援向量機迴歸(機器學習技法)

核函式山脊迴歸Represent Theorem表達理論就是指如果一個模型是帶有L2正則化的線性模型,那麼它在最佳化的時候的權重引數值W*將能夠用Z空間的資料的線性組合來表示。它的推論就是L2的正則化線性模型能夠核函式化如下圖所示:現在我們的目標就是用核函式的方式去解決迴歸問

支援向量機 svc svr svm

支援向量機(Support Vector Machine)指的是一系列機器學習方法,最初是20世紀90年代有美國電話電報公司的Vapnik和同事們一起開發的 這類方法的基礎其實是支援向量演算法,該演算法是對廣義肖像演算法(Generalized Portrait)的擴充套件,後者是1963年

支援向量機SVM和支援向量迴歸SVR簡介——原理方法

本人根據《Pattern Recognition and Machine Learning》這本書的第7章的7.1部分,學習瞭解了支援向量機SVM和支援向量迴歸SVR的理論部分,並做了PPT,有需要的同學儘管拿!下載地址:http://download.csdn.net/d

邏輯迴歸(LR)和支援向量機(SVM)的區別和聯絡

1. 前言 在機器學習的分類問題領域中,有兩個平分秋色的演算法,就是邏輯迴歸和支援向量機,這兩個演算法個有千秋,在不同的問題中有不同的表現效果,下面我們就對它們的區別和聯絡做一個簡單的總結。 2. LR和SVM的聯絡 都是監督的分類演算法。 都是線性分類方法 (不考慮核函式時)。 都是判別

SVM支援向量機系列理論(九) 核嶺迴歸

1. 嶺迴歸問題 嶺迴歸就是使用了L2正則化的線性迴歸模型。當碰到資料有多重共線性時(自變良量存在高相關性),我們就會用到嶺迴歸。 嶺迴歸模型的優化策略為: minw 1N∑i(yi−w⋅zi)2+λNwTw&nbs

SVM支援向量機系列理論(八) 核邏輯迴歸

kernel 邏輯迴歸(KRL)就是使用Representer Theory在L2正則的邏輯迴歸模型中應用核技巧。 1. Representer Theoem Representer Theoem是說,對於任何一個L2正則化的線性模型,其最優的權重向量 w∗

支援向量機(SVM)第四章---支援向量迴歸

簡單總結一下自己對SVM的認識:有一條帶區域,固定差距為1,希望最大化間隔 1||w|| 1 |

邏輯迴歸、決策樹和支援向量機

摘要:分類問題是商業業務中遇到的主要問題之一。本文對三種主要技術展開討論,邏輯迴歸(Logistic Regression)、決策樹(Decision Trees)和支援向量機(Support Vector Machine,SVM)。 分類問題是我們在各個行業的商業業務中遇到的主要問題之一。在本

支援向量機(SVM)和邏輯迴歸(LR)

開篇 為什麼把這兩個機器模型放在一起呢,主要是因為它們經常會在面試中同時出現,這邊把它們放在一起,解析一下它們之間的聯絡和區別。我們先看一下問題 經典演算法問題 LR 與 SVM 的相同和不同? 講一下其中的LR、SVM,以及區別和聯絡(2018京東演算

邏輯迴歸,決策樹,支援向量機 選擇方案

邏輯迴歸 vs 決策樹 vs 支援向量機 分類是我們在工業界經常遇到的場景,本文探討了3種常用的分類器,邏輯迴歸LR,決策樹DT和支援向量機SVM。 這三個演算法都被廣泛應用於分類(當然LR,DT和SVR也可以用於迴歸,但是本文先不討論)。我經常

各種機器學習方法(線性迴歸、支援向量機、決策樹、樸素貝葉斯、KNN演算法、邏輯迴歸)實現手寫數字識別並用準確率、召回率、F1進行評估

本文轉自:http://blog.csdn.net/net_wolf_007/article/details/51794254 前面兩章對資料進行了簡單的特徵提取及線性迴歸分析。識別率已經達到了85%, 完成了數字識別的第一步:資料探測。 這一章要做的就各

迴歸與支援向量機的總結

一, 線性迴歸(linear regression) 引入:房價預測(以英尺計算)表示式 衡量好壞的標準:代價函式 去往何方?值域目前是無窮大,假如我想解決分類問題,應該如何才能把值域控制在一個較小的區間範圍之內呢?試想如下案例:二,邏輯斯蒂迴歸模型(logistics re

資料探勘十大演算法——支援向量機SVM(五):線性支援迴歸

首先感謝“劉建平pinard”的淵博知識以及文中詳細準確的推導!!! 支援向量機原理SVM系列文章共分為5部分: (一)線性支援向量機 (二)線性支援向量機的軟間隔最大化模型 (三)線性不可分支援向量機與核函式 (四)SMO演算法原理 (五)線性支援迴歸

《Spark機器學習》筆記——Spark分類模型(線性迴歸、樸素貝葉斯、決策樹、支援向量機)

一、分類模型的種類 1.1、線性模型 1.1.1、邏輯迴歸 1.2.3、線性支援向量機 1.2、樸素貝葉斯模型 1.3、決策樹模型 二、從資料中抽取合適的特徵 MLlib中的分類模型通過LabeledPoint(label: Double, features

如何使用支援向量機(Support Vector Machine,SVM)思想解決迴歸問題

迴歸問題的本質其實就是找到一根直線也好曲線也好,能夠最佳程度擬合我們的資料點,在這裡,怎樣定義擬合其實就是迴歸演算法的關鍵。比如說我們之前學過的線性迴歸演算法定義擬合的方式,就是讓我們的資料點到我們預測的直線相應的MSE的值最小,而對於SVM演算法的思路來說,對擬

支援向量機 (三): 優化方法與支援向量迴歸

拉格朗日乘子法 - KKT條件 - 對偶問題 支援向量機 (一): 線性可分類 svm 支援向量機 (二): 軟間隔 svm 與 核函式 支援向量機 (三): 優化方法與支援向量迴歸 優化方法 一、SMO演算法 回顧 支援向量機 (二) 中 \((1.7)\) 式最後要求解的優化問題: \[ \begi