支援向量迴歸-SVR

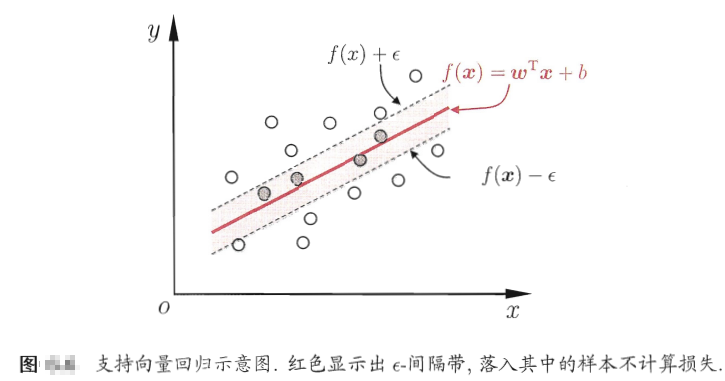

對於一般的迴歸問題,給定訓練樣本D={(x1,y1),(x2,y2),...,(xn,yn)},yi€R,我們希望學習到一個f(x)使得其與y儘可能的接近,w,b是待確定的引數。在這個模型中,只有當f(x)與y完全相同時,損失才為零,而支援向量迴歸假設我們能容忍的f(x)與y之間最多有ε的偏差,當且僅當f(x)與y的差別絕對值大於ε時,才計算損失,此時相當於以f(x)為中心,構建一個寬度為2ε的間隔帶,若訓練樣本落入此間隔帶,則認為是被預測正確的。(間隔帶兩側的鬆弛程度可有所不同)

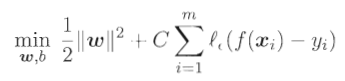

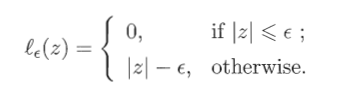

因此SVR問題可轉化為(下式左部是正則化項):

l為損失函式

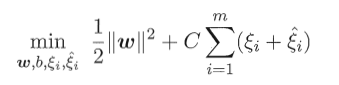

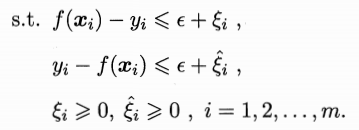

因此引入了鬆弛因子,重寫第一個式子為:

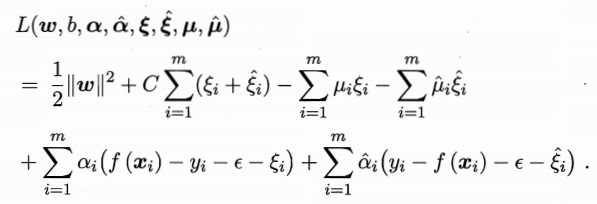

最後引入拉格朗日乘子,可得拉格朗日函式:

對四個遍歷求偏導,令偏導數為零,可得

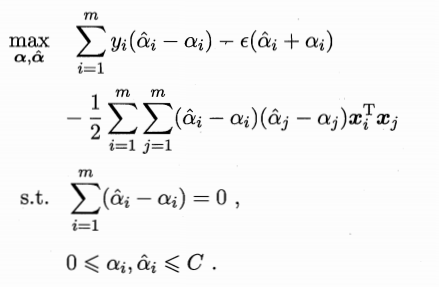

把上邊的式子帶入,即可求得SVR的對偶問題

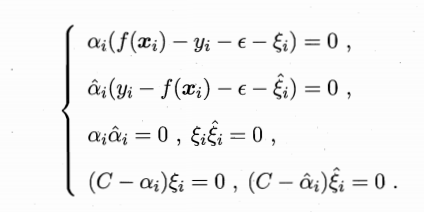

上邊的過程需要滿足KKT條件,即

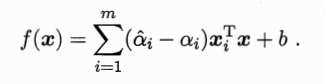

最後,可得SVR的解為

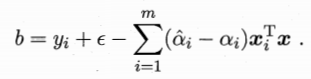

其中b為

其中b為

相關推薦

支援向量機SVM和支援向量迴歸SVR簡介——原理方法

本人根據《Pattern Recognition and Machine Learning》這本書的第7章的7.1部分,學習瞭解了支援向量機SVM和支援向量迴歸SVR的理論部分,並做了PPT,有需要的同學儘管拿!下載地址:http://download.csdn.net/d

支援向量迴歸-SVR

對於一般的迴歸問題,給定訓練樣本D={(x1,y1),(x2,y2),...,(xn,yn)},yi€R,我們希望學習到一個f(x)使得其與y儘可能的接近,w,b是待確定的引數。在這個模型中,只有當

SVM系列理論(十) SVR支援向量迴歸

1 敏感度損失函式 2 支援向量迴歸模型的匯出 3 對偶形式的匯出 4 KKT條件匯出支援向量 5 KKT條件匯出b的值

SVM拓展和SVR支援向量迴歸

軟間隔 在建立SVM模型時,假定正負樣本是線性可分的。但是,實際有些時候,樣本不是完全線性可分的,會出現交錯的情況,例如下圖。 這時,如果採用以下模型 minw,b{12∥w∥22},subject toyi(wTxi+b)≥1

支援向量機(SVM)第四章---支援向量迴歸

簡單總結一下自己對SVM的認識:有一條帶區域,固定差距為1,希望最大化間隔 1||w|| 1 |

TensorFlow HOWTO 2.2 支援向量迴歸(軟間隔)

將上一節的假設改一改,模型就可以用於迴歸問題。 操作步驟 匯入所需的包。 import tensorflow as tf import numpy as np import matplotlib.pyplot as plt import sklearn.datasets as

【機器學習基礎】支援向量迴歸

引言 這一小節介紹一下支援向量迴歸,我們在之前介紹的核邏輯迴歸使用表示定理(Representer Theorem),將邏輯迴歸程式設計Kernel的形式,這一節我們沿著這個思路出發,看看如何將回歸問題和Kernel的形式結合起來。 Kernel Rid

LibSVM支援向量迴歸詳解

LibSVM是是臺灣林智仁(Chih-Jen Lin)教授2001年開發的一套支援向量機的庫,可以很方便的對資料做分類或迴歸。由於LibSVM程式小,運用靈活,輸入引數少,並且是開源的,易於擴充套件,因此成為目前國內應用最多的SVM的庫,同時sklearn.sv

支援向量機 (三): 優化方法與支援向量迴歸

拉格朗日乘子法 - KKT條件 - 對偶問題 支援向量機 (一): 線性可分類 svm 支援向量機 (二): 軟間隔 svm 與 核函式 支援向量機 (三): 優化方法與支援向量迴歸 優化方法 一、SMO演算法 回顧 支援向量機 (二) 中 \((1.7)\) 式最後要求解的優化問題: \[ \begi

sklearn中svr(支援向量機迴歸)

支援向量機也可以用來回歸 from sklearn.svm import SVR import numpy as np n_samples, n_features = 10, 5 np.random.seed(0) y = np.random.rand

迴歸——支援向量機迴歸(SVR)

支援向量機迴歸(SVR)是支援向量機在迴歸問題上的應用模型。支援向量機迴歸模型基於不同的損失函式產生了很多變種。本文僅介紹基於ϵϵ不敏感損失函式的SVR模型。 核心思想 找到一個分離超平面(超曲面),使得期望風險最小。 ϵϵ-SVR ϵϵ-損失函

機器學習二十二:支援向量機迴歸SVR

AI菌在前四篇裡面我們講到了SVM的線性分類和非線性分類(核函式),以及在分類時用到的SMO演算

邏輯迴歸(LR)和支援向量機(SVM)的區別和聯絡

1. 前言 在機器學習的分類問題領域中,有兩個平分秋色的演算法,就是邏輯迴歸和支援向量機,這兩個演算法個有千秋,在不同的問題中有不同的表現效果,下面我們就對它們的區別和聯絡做一個簡單的總結。 2. LR和SVM的聯絡 都是監督的分類演算法。 都是線性分類方法 (不考慮核函式時)。 都是判別

SVM支援向量機系列理論(九) 核嶺迴歸

1. 嶺迴歸問題 嶺迴歸就是使用了L2正則化的線性迴歸模型。當碰到資料有多重共線性時(自變良量存在高相關性),我們就會用到嶺迴歸。 嶺迴歸模型的優化策略為: minw 1N∑i(yi−w⋅zi)2+λNwTw&nbs

SVM支援向量機系列理論(八) 核邏輯迴歸

kernel 邏輯迴歸(KRL)就是使用Representer Theory在L2正則的邏輯迴歸模型中應用核技巧。 1. Representer Theoem Representer Theoem是說,對於任何一個L2正則化的線性模型,其最優的權重向量 w∗

支援向量機 svc svr svm

支援向量機(Support Vector Machine)指的是一系列機器學習方法,最初是20世紀90年代有美國電話電報公司的Vapnik和同事們一起開發的 這類方法的基礎其實是支援向量演算法,該演算法是對廣義肖像演算法(Generalized Portrait)的擴充套件,後者是1963年

邏輯迴歸、決策樹和支援向量機

摘要:分類問題是商業業務中遇到的主要問題之一。本文對三種主要技術展開討論,邏輯迴歸(Logistic Regression)、決策樹(Decision Trees)和支援向量機(Support Vector Machine,SVM)。 分類問題是我們在各個行業的商業業務中遇到的主要問題之一。在本

支援向量機(SVM)和邏輯迴歸(LR)

開篇 為什麼把這兩個機器模型放在一起呢,主要是因為它們經常會在面試中同時出現,這邊把它們放在一起,解析一下它們之間的聯絡和區別。我們先看一下問題 經典演算法問題 LR 與 SVM 的相同和不同? 講一下其中的LR、SVM,以及區別和聯絡(2018京東演算

邏輯迴歸,決策樹,支援向量機 選擇方案

邏輯迴歸 vs 決策樹 vs 支援向量機 分類是我們在工業界經常遇到的場景,本文探討了3種常用的分類器,邏輯迴歸LR,決策樹DT和支援向量機SVM。 這三個演算法都被廣泛應用於分類(當然LR,DT和SVR也可以用於迴歸,但是本文先不討論)。我經常

各種機器學習方法(線性迴歸、支援向量機、決策樹、樸素貝葉斯、KNN演算法、邏輯迴歸)實現手寫數字識別並用準確率、召回率、F1進行評估

本文轉自:http://blog.csdn.net/net_wolf_007/article/details/51794254 前面兩章對資料進行了簡單的特徵提取及線性迴歸分析。識別率已經達到了85%, 完成了數字識別的第一步:資料探測。 這一章要做的就各