深度學習:反向傳播與基本原理

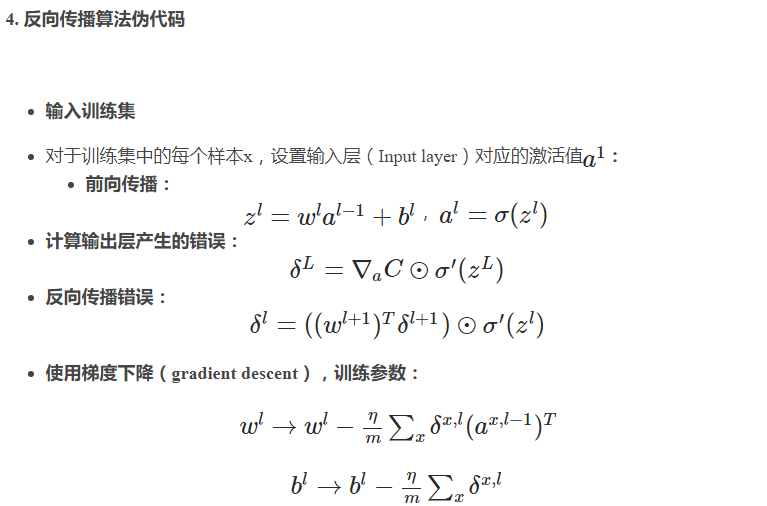

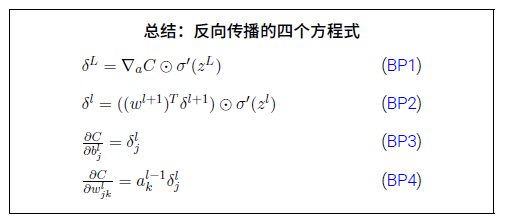

我們要證明得是這四個公式

有了這個四個公式,我們得反響傳播就可以遞推得到。

BP1公式:

這個是輸出層誤差方程,這個方程好像沒啥好說的

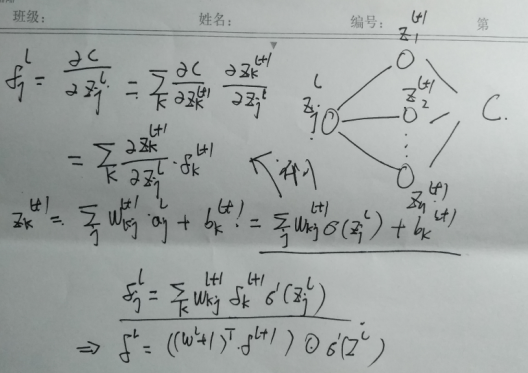

BP2公式

從這個公式我們可以通過高階層的誤差,通過的遞推的方式求出每一層的誤差

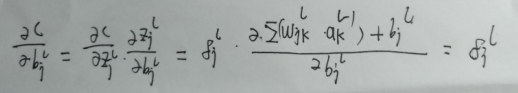

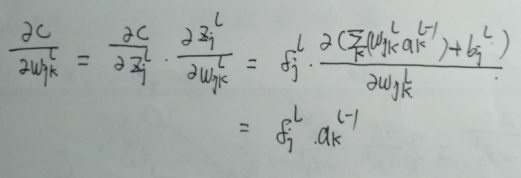

BP3公式

BP4公式

從BP4公式我們可以看到,如果前一層的輸出函式過於小的話 w引數學習就會變慢。

相關推薦

深度學習:反向傳播與基本原理

我們要證明得是這四個公式 有了這個四個公式,我們得反響傳播就可以遞推得到。 BP1公式: 這個是輸出層誤差方程,這個方程好像沒啥好說的 BP2公式 從這個公式我們可以通過高階層的誤差,

對深度學習之反向傳播訓練過程的理解

深度學習中的反向傳播訓練過程,是優化權值矩陣的關鍵過程,下面記錄自己學習體會。 卷積神經網路經過前面的運算之後,在訓練的過程中,由於我們知道每一個樣本的正確結果,所以可以得到一個損失函式。這個損失函式很關鍵,反向傳播的訓練過程就是通過他來實現的。 得到損失函式之後,我們就希望損失函式的值

深度學習——DNN反向傳播

理解鏈式求導 網站連結:https://www.bilibili.com/video/av10435213?from=search&seid=5523894613383510820 &n

深度學習:Sigmoid函式與損失函式求導

1、sigmoid函式 sigmoid函式,也就是s型曲線函式,如下: 函數:f(z)=11+e−z 導數:f′(z)=f(z)(1−f(z)) 上面是我們常見的形式,雖然知道這樣的形式,也知道計算流程,不夠感覺並不太直觀,下面

深度學習之反向傳播算法

操作 隨機梯度下降 並且 網絡 bili 方法 如何 ide 想象 直觀理解反向傳播 反向傳播算法是用來求那個復雜到爆的梯度的。 上一集中提到一點,13000維的梯度向量是難以想象的。換個思路,梯度向量每一項的大小,是在說代價函數對每個參數有多敏感。 如上圖,我們

深度學習與計算機視覺[CS231N] 學習筆記(4.1):反向傳播(Backpropagation)

在學習深度學習的過程中,我們常用的一種優化引數的方法就是梯度下降法,而一般情況下,我們搭建的神經網路的結構是:輸入→權重矩陣→損失函式。如下圖所示。 而在給定輸入的情況下,為了使我們的損失函式值達到最小,我們就需要調節權重矩陣,使之滿足條件,於是,就有了本

《深度學習:原理與應用實踐》中文版PDF

應用 href 書籍 nag tex 原理 圖片 water images 下載:https://pan.baidu.com/s/1YljEeog_D0_RUHjV6hxGQg 《深度學習:原理與應用實踐》中文版PDF,帶目錄和書簽; 經典書籍,講解詳細; 如圖: 《深度學

分享《深入淺出深度學習:原理剖析與python實踐》PDF+源代碼

img color fff png aid pdf ffffff pytho 下載 下載:https://pan.baidu.com/s/1H4N0W5sPOE7YlK0KyC7TZQ 更多資料分享:http://blog.51cto.com/3215120 《深入淺出深度

《深入淺出深度學習:原理剖析與python實踐》pdf 下載

深入淺出深度學習:原理剖析與Python實踐》介紹了深度學習相關的原理與應用,全書共分為三大部分,第一部分主要回顧了深度學習的發展歷史,以及Theano的使用;第二部分詳細講解了與深度學習相關的基礎知識,包括線性代數、概率論、概率圖模型、機器學習和至優化演算法;在第三部分中,針對若干核心的深度

分享《深度學習:原理與應用實踐》+PDF+張重生

ofo 51cto 經典 mar src mage 詳細 深度學習 目錄 下載:https://pan.baidu.com/s/1LmlYGbleDhkDAuqoZ2XjAQ更多資料分享:http://blog.51cto.com/14087171 《深度學習:原理與應用實

深度學習:卷積神經網路與影象識別基本概念

一 卷積神經網路的組成 影象分類可以認為是給定一副測試圖片作為輸入 IϵRW×H×CIϵRW×H×C,輸出該圖片 屬於哪一類。引數 W 是影象的寬度,H 是高度,C 是通道的個數;彩色影象中 C = 3,灰度影象 中 C = 1。一般的會設定總共類別的個數,

深度學習基礎:反向傳播即BP演算法的推導過程

BP演算法簡單的來說就是根據神經網路實際的輸出和目標輸出(也就是輸入樣本對應的標記)之間的誤差計算神經網路各個權值的過程。 下面的推導過程參考了《神經網路設計》 Martin T. Hagan等著 戴葵等譯。 採用BP演算法從輸出層、經過隱層再到輸入層進行層層計算的原因是如

反向傳播的工作原理(深度學習第三章)

What is backpropagation really doing? 梯度向量的每一項大小是在告訴大家,代價函式對於每一個引數有多敏感。 對於改變啟用值,可以有三種方法: 1.增加偏置 2.增加權重 3.改變上一層的啟用值 對於

MySql 基礎學習筆記 1——概述與基本數據類型: 整型: 1)TINYINT 2)SMALLINT 3) MEDIUMINT 4)INT 5)BIGINT 主要是大小的差別 圖 浮點型:命令

where float 函數名 src ron 編碼方式 永遠 -m mas 一、CMD中經常使用mysql相關命令 mysql -D, --database=name //打開數據庫 --delimiter=name //指定分隔符 -h, --host=na

反向傳播與梯度下降的基本概念

反向傳播和梯度下降這兩個詞,第一眼看上去似懂非懂,不明覺厲。這兩個概念是整個神經網路中的重要組成部分,是和誤差函式/損失函式的概念分不開的。 神經網路訓練的最基本的思想就是:先“蒙”一個結果,我們叫預測結果h,看看這個預測結果和事先標記好的訓練集中的真實結果y之間的差距,然後調整策略,再試一次,這一次就不是

Lucene學習總結之一:全文檢索的基本原理

一、總論 Lucene是一個高效的,基於Java的全文檢索庫。 所以在瞭解Lucene之前要費一番工夫瞭解一下全文檢索。 那麼什麼叫做全文檢索呢?這要從我們生活中的資料說起。 我們生活中的資料總體分為兩種:結構化資料和非結構化資料。 結構化資料:指具

AI應用開發基礎傻瓜書系列2-神經網路中反向傳播與梯度下降的基本概念

第二篇:神經網路中反向傳播與梯度下降的基本概念 預警:本篇部落格中會涉及到偏導數的概念,但是非常初級,很容易理解,建議硬著頭皮看,跟著算一遍,看完之後保證會覺得人生美好了很多。 反向傳播和梯度下降這兩個詞,第一眼看上去似懂非懂,不明覺厲。這兩個概念是整個神經網路中的重要組成部分,是和誤差函式/損失函式的概念

學習筆記:《深度學習框架PyTorch入門與實踐》(陳雲)Part1

學習筆記:《深度學習框架PyTorch入門與實踐》(陳雲)Part1 2017年1月,FAIR團隊在GitHub上開源了PyTorch。 常見的深度學習框架:

斯坦福CS231n 2017最新課程:李飛飛詳解深度學習的框架實現與對比

斯坦福大學的課程 CS231n (Convolutional Neural Networks for Visual Recognition) 作為深度學習和計算機視覺方面的重要基礎課程,在學界廣受推崇。今年 4 月,CS231n 再度開課,全新的 CS231n Spring 2017 仍舊由李飛飛帶頭,帶來

python3__深度學習:TensorFlow__資料的生成與讀取(主要針對影象處理)

1.CSV檔案(提供影象地址和標籤) 1.1 建立 import os path = "pic" filenames = os.listdir(path=path) strText = "" with open(file="train_list.csv", mode="w") as