概率矩陣分解模型 PMF

本文是論文《一種結合推薦物件間關聯關係的社會化推薦演算法》的筆記(上)。因為對其中的概率矩陣分解(Probabilistic Matrix Factorization, PMF)不夠了解,因而我先去腦補了PMF在推薦系統中的應用,然後再對論文進行總結。主要內容包括svd的兩種形式和PMF的介紹。

資源下載,猛擊此處。

相關推薦

概率矩陣分解模型 PMF

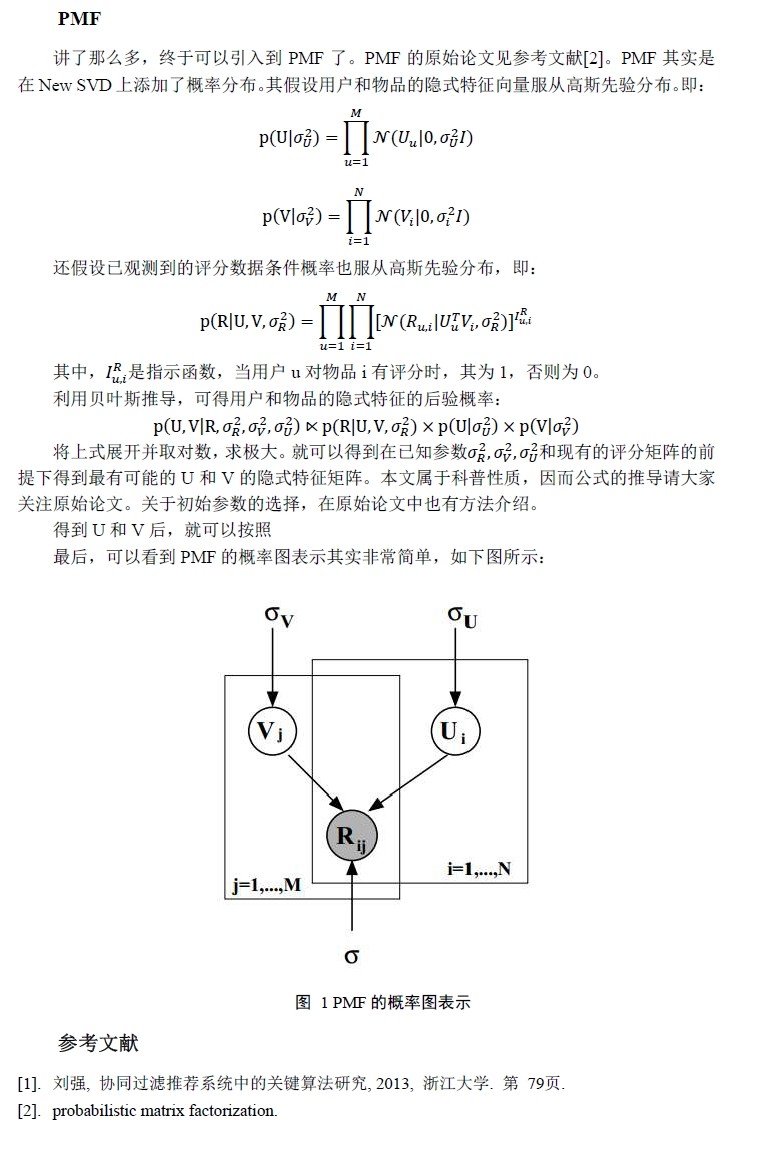

本文是論文《一種結合推薦物件間關聯關係的社會化推薦演算法》的筆記(上)。因為對其中的概率矩陣分解(Probabilistic Matrix Factorization, PMF)不夠了解,因而我先去腦

概率矩陣分解(Probabilistic Matrix Factorization)

摘要 很多現有的協同過濾的方法既不能處理非常大的資料集,也不能容易地應對有非常少的評價的使用者。在這篇論文中,我們提出了概率矩陣分解(PMF)模型,它的規模與觀察值的數目線性相關,並且更重要的是,它在非常大的、稀疏的和非常失衡的Netflix資料集上表現優異。我們更進一步

基於概率的矩陣分解原理詳解(PMF)

上一篇部落格講到了推薦系統中常用的矩陣分解方法,RegularizedMF是對BasicMF的優化,而PMF是在RegularizedMF的基礎上,引入概率模型進一步優化。假設使用者U和專案V的特徵矩陣均服從高斯分佈,通過評分矩陣已知值得到U和V的特徵矩陣,然後

推薦系統:矩陣分解與鄰域的融合模型

critical with 分析 但是 rac 公式 download pearson 情況 推薦系統通常分析過去的事務以建立用戶和產品之間的聯系,這種方法叫做協同過濾。 協同過濾有兩種形式:隱語義模型(LFM),基於鄰域的模型(Neighborhood models)。

文字主題模型之非負矩陣分解(NMF)

在文字主題模型之潛在語義索引(LSI)中,我們講到LSI主題模型使用了奇異值分解,面臨著高維度計算量太大的問題。這裡我們就介紹另一種基於矩陣分解的主題模型:非負矩陣分解(NMF),它同樣使用了矩陣分解,但是計算量和處理速度則比LSI快,它是怎麼做到的呢? 1. 非負矩陣分解(NMF)概述

文本主題模型之非負矩陣分解(NMF)

slist 做到 主題模型 直觀 推薦算法 語言 開始 2.6 如果 在文本主題模型之潛在語義索引(LSI)中,我們講到LSI主題模型使用了奇異值分解,面臨著高維度計算量太大的問題。這裏我們就介紹另一種基於矩陣分解的主題模型:非負矩陣分解(NMF),它同樣使用了矩陣分解,但

簡單的基於矩陣分解的推薦演算法-PMF, NMF

介紹: 推薦系統中最為主流與經典的技術之一是協同過濾技術(Collaborative Filtering),它是基於這樣的假設:使用者如果在過去對某些專案產生過興趣,那麼將來他很可能依然對其保持熱忱。其中協同過濾技術又可根據是否採用了機器學習思想建模的不同劃分為基於記憶體的協同過濾(Memory-based

矩陣分解協同過濾模型

矩陣分解實際上就是一個利用更少數目的引數通過某種計算來表示原有資料,然後找到一個方法來計算這些引數的模型。已知的方法有SVD等矩陣分解的方法。SVD雖然在推薦系統中已經發揮了良好的效果,但是在利用SVD進行矩陣分解應用於推薦系統時,不能有缺失值,而缺失值的填充又是一個很

論文閱讀——矩陣填補模型之深度矩陣分解(Deep Matrix Factorization)

1,論文相關資訊 Paper:Matrix completion by deep matrix factorization Journal:Neural Networks Year:2018 2,研究動機 (1)傳統的矩陣填補模型(matrix c

推薦演算法之用矩陣分解做協調過濾——LFM模型

隱語義模型(Latent factor model,以下簡稱LFM),是推薦系統領域上廣泛使用的演算法。它將矩陣分解應用於推薦演算法推到了新的高度,在推薦演算法歷史上留下了光輝燦爛的一筆。本文將對 LFM原理進行詳細闡述,給出其基本演算法原理。此外,還將介紹使得隱語義模型聲名大噪的演算法FunkSVD和在其基

基於One-Class的矩陣分解方法

mat ack tracking useful number 用戶 loss cat cti 在矩陣分解中。 有類問題比較常見,即矩陣的元素僅僅有0和1。 相應實際應用中的場景是:用戶對新聞的點擊情況,對某些物品的購買情況等。基於graphchi裏面的矩陣分解結

017 ACM-ICPC 亞洲區(西安賽區)網絡賽 Coin 概率+矩陣快速冪

scan 快速 while 矩陣 icpc 概率 pre using name 題目鏈接: https://nanti.jisuanke.com/t/17115 題意: 詢問硬幣K次,正面朝上次數為偶數。 思路: dp[i][0] = 下* dp[i-1][0] + 上*d

推薦系統(recommender systems):預測電影評分--構造推薦系統的一種方法:低秩矩陣分解(low rank matrix factorization)

ngs img round col tin product ems 找到 推薦 如上圖中的predicted ratings矩陣可以分解成X與ΘT的乘積,這個叫做低秩矩陣分解。 我們先學習出product的特征參數向量,在實際應用中這些學習出來的參數向量可能比較難以理解

融合非負矩陣分解和圖全變分的歌曲推薦算法

算法摘要: Kirell Benzi, Vassilis Kalofolias, Xavier Bresson and Pierre Vandergheynst Signal Processing Laboratory 2 (LTS2), Swiss Federal Institute of Technolo

矩陣分解---QR正交分解,LU分解

rect 同學 表達方式 play 位向量 frame 因此 log rgb 相關概念: 正交矩陣:若一個方陣其行與列皆為正交的單位向量,則該矩陣為正交矩陣,且該矩陣的轉置和其逆相等。兩個向量正交的意思是兩個向量的內積為 0 正定矩陣:如果對於所有的非零實系數向量x

推薦系統-矩陣分解

文章一 ref: https://blog.csdn.net/GZHermit/article/details/73920755 推薦任務定義: 在一個標準推薦任務中,我們有mm個使用者(user),nn個物品(item),以及一個稀疏評分矩陣R(R∈Rm∗n)R(R∈

視覺SLAM常見的QR分解SVD分解等矩陣分解方式求解滿秩和虧秩最小二乘問題

內容一 首先直接給出AX=B解的情況: (1)R(A)< r(A|B),方程組無解 (2)r(A)=r(A|B)=n,方程組有唯一解 (3)r(A)=r(A|B) < n,方程組有無窮解 (4)r(A)>r(A|B),這種

CF989E A Trance of Nightfall(概率+矩陣快速冪優化+倍增)

CF傳送門 洛谷傳送門 【題目分析】 在zxy大佬的講解下終於懂了這道題的做法了qwq。。。 首先根據題意,出發點不一定在特殊點上,但第一次操作後,之後所有的操作都是在特殊點上,所以先考慮從線上出發的最大概率,再加一步即可得到從點出發的最大概率,二者取較大值即可。 記陣列f[i]

【矩陣分解】 QR, Householder變換

使用matlab,基於householder變化寫了QR的實現過程 1、Householder變化演算法 function [ H, v, beta ] = householder( x ) % x : inout param. x is a vector which size is n*1

【Mark Schmidt課件】機器學習與資料探勘——稀疏矩陣分解

本課件主要內容包括: 上次課程回顧:基於正交/序貫基的PCA 人眼的顏色對立 顏色對立表示法 應用:人臉檢測 特徵臉 VQ vs. PCA vs. NMF 面部表示 非負最小二乘法 稀疏性與非負最小