[轉]用python爬蟲抓站的一些技巧總結 zz

來源網站:http://www.pythonclub.org/python-network-application/observer-spider

學用python也有3個多月了,用得最多的還是各類爬蟲腳本:寫過抓代理本機驗證的腳本,寫過在discuz論壇中自動登錄自動發貼的腳本,寫過自動收郵件的腳本,寫過簡單的驗證碼識別的腳本,本來想寫google music的抓取腳本的,結果有了強大的gmbox,也就不用寫了。

這些腳本有一個共性,都是和web相關的,總要用到獲取鏈接的一些方法,再加上simplecd這個半爬蟲半網站的項目,累積不少爬蟲抓站的經驗,在此總結一下,那麽以後做東西也就不用重復勞動了。

1.最基本的抓站

import urllib2

content = urllib2.urlopen(‘http://XXXX‘).read()

2.使用代理服務器

這在某些情況下比較有用,比如IP被封了,或者比如IP訪問的次數受到限制等等。

import urllib2

proxy_support = urllib2.ProxyHandler({‘http‘:‘http://XX.XX.XX.XX:XXXX‘})

opener = urllib2.build_opener(proxy_support, urllib2.HTTPHandler)

urllib2.install_opener(opener)

content = urllib2.urlopen(‘http://XXXX‘).read()

3.需要登錄的情況

登錄的情況比較麻煩我把問題拆分一下:

3.1 cookie的處理

import urllib2, cookielib

cookie_support= urllib2.HTTPCookieProcessor(cookielib.CookieJar())

opener = urllib2.build_opener(cookie_support, urllib2.HTTPHandler)

urllib2.install_opener(opener)

content = urllib2.urlopen(‘http://XXXX‘).read()

是的沒錯,如果想同時用代理和cookie,那就加入proxy_support然後operner改為

opener = urllib2.build_opener(proxy_support, cookie_support, urllib2.HTTPHandler)

3.2 表單的處理

登錄必要填表,表單怎麽填?首先利用工具截取所要填表的內容。

比如我一般用firefox+httpfox插件來看看自己到底發送了些什麽包

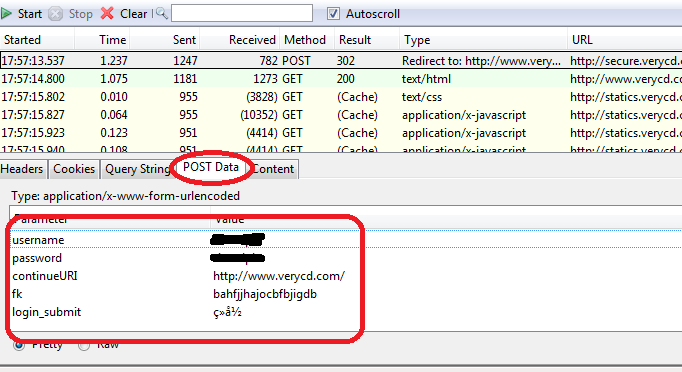

這個我就舉個例子好了,以verycd為例,先找到自己發的POST請求,以及POST表單項:

可以看到verycd的話需要填username,password,continueURI,fk,login_submit這幾項,其中fk是隨機生成的(其實不太隨機,看上去像是把epoch時間經過簡單的編碼生成的),需要從網頁獲取,也就是說得先訪問一次網頁,用正則表達式等工具截取返回數據中的fk項。continueURI顧名思義可以隨便寫,login_submit是固定的,這從源碼可以看出。還有username,password那就很顯然了。

好的,有了要填寫的數據,我們就要生成postdata

import urllib

postdata=urllib.urlencode({

‘username‘:‘XXXXX‘,

‘password‘:‘XXXXX‘,

‘continueURI‘:‘http://www.verycd.com/‘,

‘fk‘:fk,

‘login_submit‘:‘登錄‘

})

然後生成http請求,再發送請求:

req = urllib2.Request(

url = ‘http://secure.verycd.com/signin/*/http://www.verycd.com/‘,

data = postdata

)

result = urllib2.urlopen(req).read()

3.3 偽裝成瀏覽器訪問

某些網站反感爬蟲的到訪,於是對爬蟲一律拒絕請求。這時候我們需要偽裝成瀏覽器,這可以通過修改http包中的header來實現:

headers = {

‘User-Agent‘:‘Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US; rv:1.9.1.6) Gecko/20091201 Firefox/3.5.6‘

}

req = urllib2.Request(

url = ‘http://secure.verycd.com/signin/*/http://www.verycd.com/‘,

data = postdata,

headers = headers

)

3.4 反”反盜鏈”

某些站點有所謂的反盜鏈設置,其實說穿了很簡單,就是檢查你發送請求的header裏面,referer站點是不是他自己,所以我們只需要像3.3一樣,把headers的referer改成該網站即可,以黑幕著稱地cnbeta為例:

headers = {

‘Referer‘:‘http://www.cnbeta.com/articles‘

}

headers是一個dict數據結構,你可以放入任何想要的header,來做一些偽裝。例如,有些自作聰明的網站總喜歡窺人隱私,別人通過代理訪問,他偏偏要讀取header中的X-Forwarded-For來看看人家的真實IP,沒話說,那就直接把X-Forwarde-For改了吧,可以改成隨便什麽好玩的東東來欺負欺負他,呵呵。

3.5 終極絕招

有時候即使做了3.1-3.4,訪問還是會被據,那麽沒辦法,老老實實把httpfox中看到的headers全都寫上,那一般也就行了。 再不行,那就只能用終極絕招了,selenium直接控制瀏覽器來進行訪問,只要瀏覽器可以做到的,那麽它也可以做到。類似的還有pamie,watir,等等等等。

4.多線程並發抓取

單線程太慢的話,就需要多線程了,這裏給個簡單的線程池模板 這個程序只是簡單地打印了1-10,但是可以看出是並發地。

from threading import Thread

from Queue import Queue

from time import sleep

#q是任務隊列

#NUM是並發線程總數

#JOBS是有多少任務

q = Queue()

NUM = 2

JOBS = 10

#具體的處理函數,負責處理單個任務

def do_somthing_using(arguments):

print arguments

#這個是工作進程,負責不斷從隊列取數據並處理

def working():

while True:

arguments = q.get()

do_somthing_using(arguments)

sleep(1)

q.task_done()

#fork NUM個線程等待隊列

for i in range(NUM):

t = Thread(target=working)

t.setDaemon(True)

t.start()

#把JOBS排入隊列

for i in range(JOBS):

q.put(i)

#等待所有JOBS完成

q.join()

5.驗證碼的處理

碰到驗證碼咋辦?這裏分兩種情況處理:

- google那種驗證碼,涼拌

- 簡單的驗證碼:字符個數有限,只使用了簡單的平移或旋轉加噪音而沒有扭曲的,這種還是有可能可以處理的,一般思路是旋轉的轉回來,噪音去掉,然後劃分單個字符,劃分好了以後再通過特征提取的方法(例如PCA)降維並生成特征庫,然後把驗證碼和特征庫進行比較。這個比較復雜,一篇博文是說不完的,這裏就不展開了,具體做法請弄本相關教科書好好研究一下。

- 事實上有些驗證碼還是很弱的,這裏就不點名了,反正我通過2的方法提取過準確度非常高的驗證碼,所以2事實上是可行的。

6 gzip/deflate支持

現在的網頁普遍支持gzip壓縮,這往往可以解決大量傳輸時間,以VeryCD的主頁為例,未壓縮版本247K,壓縮了以後45K,為原來的1/5。這就意味著抓取速度會快5倍。

然而python的urllib/urllib2默認都不支持壓縮,要返回壓縮格式,必須在request的header裏面寫明’accept-encoding’,然後讀取response後更要檢查header查看是否有’content-encoding’一項來判斷是否需要解碼,很繁瑣瑣碎。如何讓urllib2自動支持gzip, defalte呢?

其實可以繼承BaseHanlder類,然後build_opener的方式來處理:

import urllib2

from gzip import GzipFile

from StringIO import StringIO

class ContentEncodingProcessor(urllib2.BaseHandler):

"""A handler to add gzip capabilities to urllib2 requests """

# add headers to requests

def http_request(self, req):

req.add_header("Accept-Encoding", "gzip, deflate")

return req

# decode

def http_response(self, req, resp):

old_resp = resp

# gzip

if resp.headers.get("content-encoding") == "gzip":

gz = GzipFile(

fileobj=StringIO(resp.read()),

mode="r"

)

resp = urllib2.addinfourl(gz, old_resp.headers, old_resp.url, old_resp.code)

resp.msg = old_resp.msg

# deflate

if resp.headers.get("content-encoding") == "deflate":

gz = StringIO( deflate(resp.read()) )

resp = urllib2.addinfourl(gz, old_resp.headers, old_resp.url, old_resp.code) # ‘class to add info() and

resp.msg = old_resp.msg

return resp

# deflate support

import zlib

def deflate(data): # zlib only provides the zlib compress format, not the deflate format;

try: # so on top of all there‘s this workaround:

return zlib.decompress(data, -zlib.MAX_WBITS)

except zlib.error:

return zlib.decompress(data)

然後就簡單了,

encoding_support = ContentEncodingProcessor

opener = urllib2.build_opener( encoding_support, urllib2.HTTPHandler )

#直接用opener打開網頁,如果服務器支持gzip/defalte則自動解壓縮

content = opener.open(url).read()

7. 更方便地多線程

總結一文的確提及了一個簡單的多線程模板,但是那個東東真正應用到程序裏面去只會讓程序變得支離破碎,不堪入目。在怎麽更方便地進行多線程方面我也動了一番腦筋。先想想怎麽進行多線程調用最方便呢?

1、用twisted進行異步I/O抓取

事實上更高效的抓取並非一定要用多線程,也可以使用異步I/O法:直接用twisted的getPage方法,然後分別加上異步I/O結束時的callback和errback方法即可。例如可以這麽幹:

from twisted.web.client import getPage

from twisted.internet import reactor

links = [ ‘http://www.verycd.com/topics/%d/‘%i for i in range(5420,5430) ]

def parse_page(data,url):

print len(data),url

def fetch_error(error,url):

print error.getErrorMessage(),url

# 批量抓取鏈接

for url in links:

getPage(url,timeout=5) .addCallback(parse_page,url) \ #成功則調用parse_page方法

.addErrback(fetch_error,url) #失敗則調用fetch_error方法

reactor.callLater(5, reactor.stop) #5秒鐘後通知reactor結束程序

reactor.run()

twisted人如其名,寫的代碼實在是太扭曲了,非正常人所能接受,雖然這個簡單的例子看上去還好;每次寫twisted的程序整個人都扭曲了,累得不得了,文檔等於沒有,必須得看源碼才知道怎麽整,唉不提了。

如果要支持gzip/deflate,甚至做一些登陸的擴展,就得為twisted寫個新的HTTPClientFactory類諸如此類,我這眉頭真是大皺,遂放棄。有毅力者請自行嘗試。

這篇講怎麽用twisted來進行批量網址處理的文章不錯,由淺入深,深入淺出,可以一看。

2、設計一個簡單的多線程抓取類

還是覺得在urllib之類python“本土”的東東裏面折騰起來更舒服。試想一下,如果有個Fetcher類,你可以這麽調用

f = Fetcher(threads=10) #設定下載線程數為10

for url in urls:

f.push(url) #把所有url推入下載隊列

while f.taskleft(): #若還有未完成下載的線程

content = f.pop() #從下載完成隊列中取出結果

do_with(content) # 處理content內容

這麽個多線程調用簡單明了,那麽就這麽設計吧,首先要有兩個隊列,用Queue搞定,多線程的基本架構也和“技巧總結”一文類似,push方法和pop方法都比較好處理,都是直接用Queue的方法,taskleft則是如果有“正在運行的任務”或者”隊列中的任務”則為是,也好辦,於是代碼如下:

import urllib2

from threading import Thread,Lock

from Queue import Queue

import time

class Fetcher:

def __init__(self,threads):

self.opener = urllib2.build_opener(urllib2.HTTPHandler)

self.lock = Lock() #線程鎖

self.q_req = Queue() #任務隊列

self.q_ans = Queue() #完成隊列

self.threads = threads

for i in range(threads):

t = Thread(target=self.threadget)

t.setDaemon(True)

t.start()

self.running = 0

def __del__(self): #解構時需等待兩個隊列完成

time.sleep(0.5)

self.q_req.join()

self.q_ans.join()

def taskleft(self):

return self.q_req.qsize()+self.q_ans.qsize()+self.running

def push(self,req):

self.q_req.put(req)

def pop(self):

return self.q_ans.get()

def threadget(self):

while True:

req = self.q_req.get()

with self.lock: #要保證該操作的原子性,進入critical area

self.running += 1

try:

ans = self.opener.open(req).read()

except Exception, what:

ans = ‘‘

print what

self.q_ans.put((req,ans))

with self.lock:

self.running -= 1

self.q_req.task_done()

time.sleep(0.1) # don‘t spam

if __name__ == "__main__":

links = [ ‘http://www.verycd.com/topics/%d/‘%i for i in range(5420,5430) ]

f = Fetcher(threads=10)

for url in links:

f.push(url)

while f.taskleft():

url,content = f.pop()

print url,len(content)

8. 一些瑣碎的經驗

1、連接池:

opener.open和urllib2.urlopen一樣,都會新建一個http請求。通常情況下這不是什麽問題,因為線性環境下,一秒鐘可能也就新生成一個請求;然而在多線程環境下,每秒鐘可以是幾十上百個請求,這麽幹只要幾分鐘,正常的有理智的服務器一定會封禁你的。

然而在正常的html請求時,保持同時和服務器幾十個連接又是很正常的一件事,所以完全可以手動維護一個HttpConnection的池,然後每次抓取時從連接池裏面選連接進行連接即可。

這裏有一個取巧的方法,就是利用squid做代理服務器來進行抓取,則squid會自動為你維護連接池,還附帶數據緩存功能,而且squid本來就是我每個服務器上面必裝的東東,何必再自找麻煩寫連接池呢。

2、設定線程的棧大小

棧大小的設定將非常顯著地影響python的內存占用,python多線程不設置這個值會導致程序占用大量內存,這對openvz的vps來說非常致命。stack_size必須大於32768,實際上應該總要32768*2以上

from threading import stack_size

stack_size(32768*16)

3、設置失敗後自動重試

def get(self,req,retries=3):

try:

response = self.opener.open(req)

data = response.read()

except Exception , what:

print what,req

if retries>0:

return self.get(req,retries-1)

else:

print ‘GET Failed‘,req

return ‘‘

return data

4、設置超時

import socket

socket.setdefaulttimeout(10) #設置10秒後連接超時

5、登陸

登陸更加簡化了,首先build_opener中要加入cookie支持,參考“總結”一文;如要登陸VeryCD,給Fetcher新增一個空方法login,並在init()中調用,然後繼承Fetcher類並override login方法:

def login(self,username,password):

import urllib

data=urllib.urlencode({‘username‘:username,

‘password‘:password,

‘continue‘:‘http://www.verycd.com/‘,

‘login_submit‘:u‘登錄‘.encode(‘utf-8‘),

‘save_cookie‘:1,})

url = ‘http://www.verycd.com/signin‘

self.opener.open(url,data).read()

於是在Fetcher初始化時便會自動登錄VeryCD網站。

9. 總結

如此,把上述所有小技巧都糅合起來就和我目前的私藏最終版的Fetcher類相差不遠了,它支持多線程,gzip/deflate壓縮,超時設置,自動重試,設置棧大小,自動登錄等功能;代碼簡單,使用方便,性能也不俗,可謂居家旅行,殺人放火,咳咳,之必備工具。

之所以說和最終版差得不遠,是因為最終版還有一個保留功能“馬甲術”:多代理自動選擇。看起來好像僅僅是一個random.choice的區別,其實包含了代理獲取,代理驗證,代理測速等諸多環節,這就是另一個故事了。

參考

- http://obmem.info/?p=476

- http://obmem.info/?p=753

[轉]用python爬蟲抓站的一些技巧總結 zz