關於樸素貝葉斯

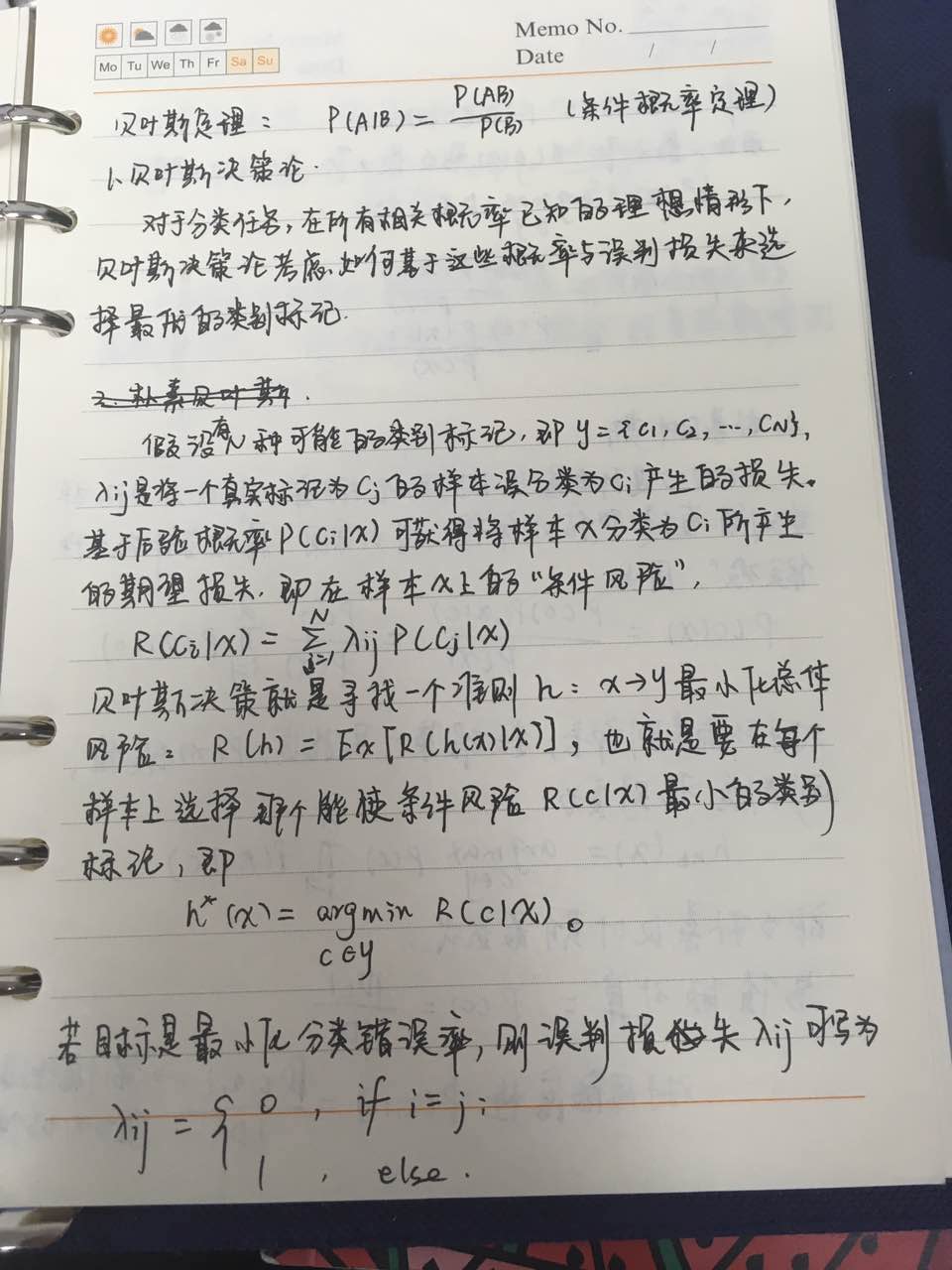

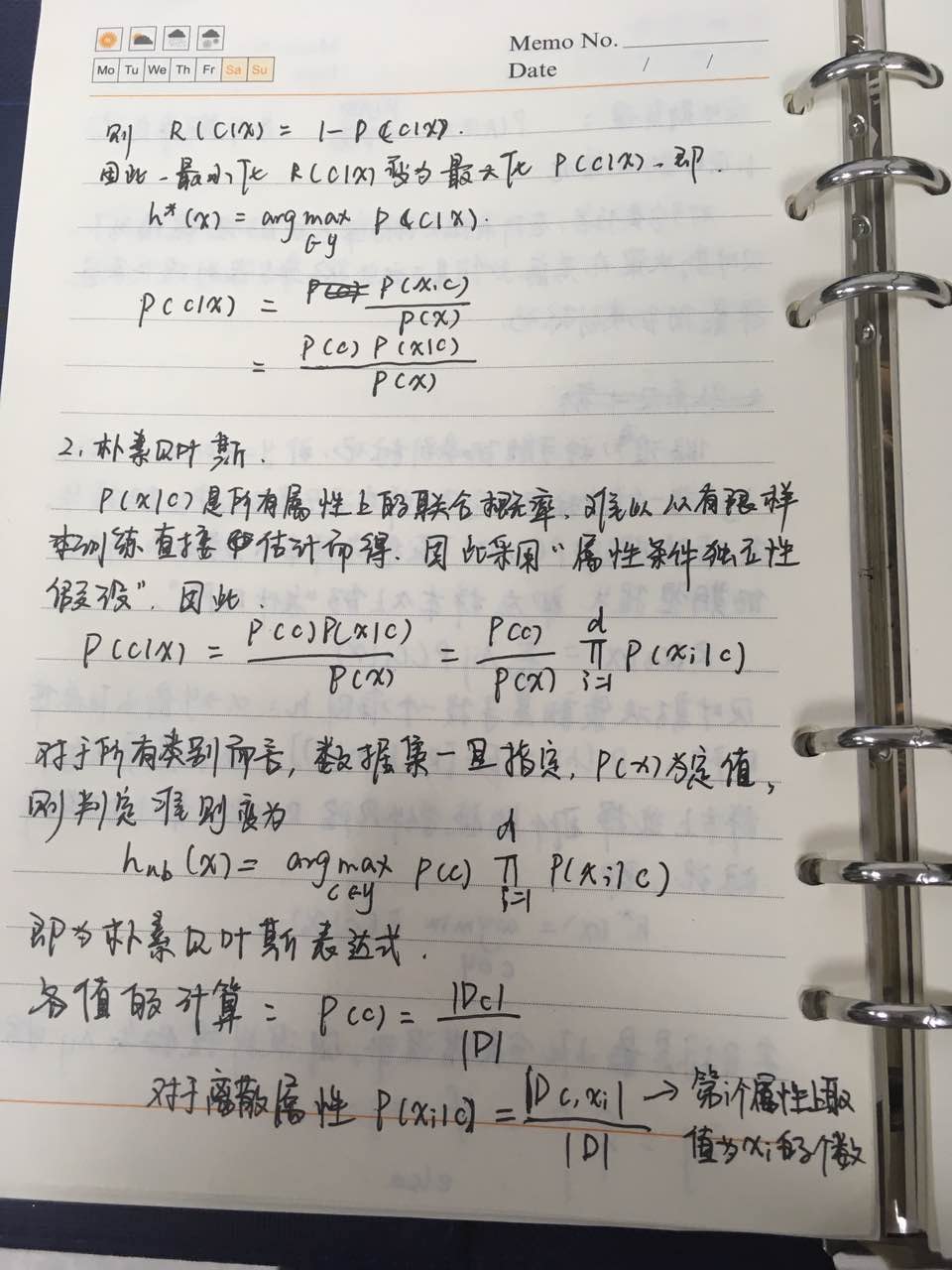

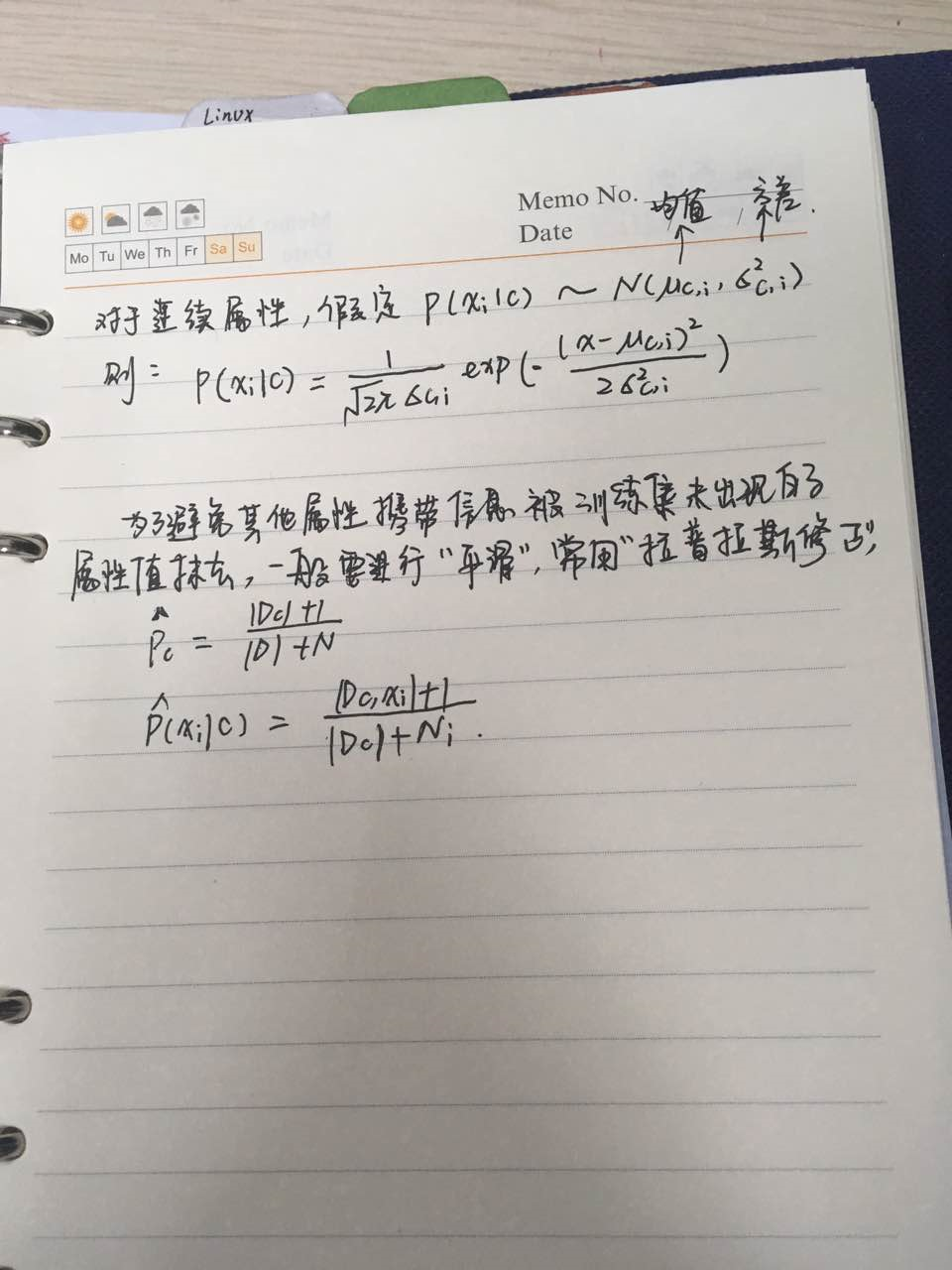

樸素貝葉斯或者說基於貝葉斯理論的決策方法都是生成式模型。那麽什麽是生成式模型呢?生成式模型和判別式模型的概念分別是什麽?大體來說,給定數據集x,可以直接通過建模P(c|x)來預測c,這樣得到的是判別式模型。像BP網絡,支持向量機,決策樹都屬於判別式模型。如果先對聯合概率分布P(x,c)建模,然後再由此獲得P(c|x),這樣得到的生成式模型,例如樸素貝葉斯。

樸素貝葉斯應用的先決條件是“屬性條件獨立假設”,即已知類別,假設所有屬性相互獨立。

關於樸素貝葉斯

相關推薦

<Machine Learning in Action >之二 樸素貝葉斯 C#實現文章分類

options 直升機 water 飛機 math mes 視頻 write mod def trainNB0(trainMatrix,trainCategory): numTrainDocs = len(trainMatrix) numWords =

(筆記)斯坦福機器學習第六講--樸素貝葉斯

span || -h 沒有 height 單純 去除 變量 logistic 本講內容 1. Naive Bayes(樸素貝葉斯) 2.Event models(樸素貝葉斯的事件模型) 3.Neural network (神經網絡) 4.Support vector mac

基於的樸素貝葉斯的文本分類(附完整代碼(spark/java)

ava -s for 轉換成 模型保存 ext js rgs cti txt 本文主要包括以下內容: 1)模型訓練數據生成(demo) 2 ) 模型訓練(spark+java),數據存儲在hdfs上 3)預測數據生成(demo) 4)使用生成的模型進行文本分類。 一

樸素貝葉斯分類算法

貝葉斯 樸素 之前有次考試考的是手工計算樸素貝葉斯的分類。當時沒答對,後來搞明白了,不久又忘得差不多了。所以寫個例子在這兒記一下。先推導一下貝葉斯公式:假定我們觀察到兩個事件都發生了,記做P(AB),那麽我們既可以認為先發生了事件A,在此基礎上又發生了事件B,也可以認為先發生了事件B,在此基礎上又發生

利用樸素貝葉斯(Navie Bayes)進行垃圾郵件分類

判斷 ase create numpy water 向量 not in imp img 貝葉斯公式描寫敘述的是一組條件概率之間相互轉化的關系。 在機器學習中。貝葉斯公式能夠應用在分類問題上。這篇文章是基於自己的學習所整理。並利用一個垃圾郵件分類的樣例來加深對於理論的理解

樸素貝葉斯分類算法介紹及python代碼實現案例

urn bus 人的 元素 1.2 -s index 代碼 步驟 樸素貝葉斯分類算法 1、樸素貝葉斯分類算法原理 1.1、概述 貝葉斯分類算法是一大類分類算法的總稱 貝葉斯分類算法以樣本可能屬於某類的概率來作為分類依據 樸素貝葉斯分類算法是貝葉斯分類算法中最簡單的一種 註:

樸素貝葉斯算法資料整理和PHP 實現版本

樸素貝葉斯樸素貝葉斯算法簡潔http://blog.csdn.net/xlinsist/article/details/51236454 引言先前曾經看了一篇文章,一個老外程序員寫了一些很牛的Shell腳本,包括晚下班自動給老婆發短信啊,自動沖Coffee啊,自動掃描一個DBA發來的郵件啊, 等等。於是我也想

javascript實現樸素貝葉斯分類與決策樹ID3分類

.com 訓練集 this ice map ive sum length roc 今年畢業時的畢設是有關大數據及機器學習的題目。因為那個時間已經步入前端的行業自然選擇使用JavaScript來實現其中具體的算法。雖然JavaScript不是做大數據處理的最佳語言,相比還沒有

機器學習系列——樸素貝葉斯分類器(二)

表示 -h line log ima 條件 code 樸素貝葉斯 spa 貝葉斯定理: 其中: 表示事件B已經發生的前提下,事件A發生的概率,叫做事件B發生下事件A的條件概率。其基本求解公式為:。 機器學習系列——樸素貝葉斯分類器(二)

樸素貝葉斯

9.png 貝葉斯 分詞 世界 最大 log 制造 技術分享 規律 樸素貝葉斯分類是基於貝葉斯概率的思想,假設屬性之間相互獨立,求得各特征的概率,最後取較大的一個作為預測結果(為了消弱罕見特征對最終結果的影響,通常會為概率加入權重,在比較時加入閾值)。樸素貝葉斯是較為簡

樸素貝葉斯-Numpy-對數似然

連續 數學 learn append ocs 似然 mtr 詞匯 reat 《Machine Learning in Action》 為防止連續乘法時每個乘數過小,而導致的下溢出(太多很小的數相乘結果為0,或者不能正確分類) 訓練: def trainN

樸素貝葉斯分類器的應用 Naive Bayes classifier

upload dia get 等號 分布 eat 實現 維基 5.5 一、病人分類的例子 讓我從一個例子開始講起,你會看到貝葉斯分類器很好懂,一點都不難。 某個醫院早上收了六個門診病人,如下表。 癥狀 職業 疾病 打噴嚏 護士 感冒 打噴嚏

統計學習方法四 樸素貝葉斯分類

和數 com .com 條件概率 統計學習 http 模型 適用場景 es2017 樸素貝葉斯分類 1,基本概念 2,算法流程 關鍵點:理解先驗概率,條件概率,最大後驗概率,下面是以極大似然估計的 3,算法改進(貝葉斯估計) 上述用極

關於樸素貝葉斯

alt 如果 條件 分別是 數據 先決條件 支持向量機 所有 貝葉斯 樸素貝葉斯或者說基於貝葉斯理論的決策方法都是生成式模型。那麽什麽是生成式模型呢?生成式模型和判別式模型的概念分別是什麽?大體來說,給定數據集x,可以直接通過建模P(c|x)來預測c,這樣得到的是判別式模型

我理解的樸素貝葉斯模型【轉】

package 規則 dia div href 重要 源代碼 容易 計算 轉自:http://www.cnblogs.com/nxld/p/6607943.html 我想說:“任何事件都是條件概率。”為什麽呢?因為我認為,任何事件的發生都不是完全偶然的,它都會以其他事件的

《統計學習方法(李航)》講義 第04章 樸素貝葉斯

ima .cn 效率 常用 1-1 估計 實現 技術 com 樸素貝葉斯(naive Bayes) 法是基於貝葉斯定理與特征條件獨立假設的分類方法。對於給定的訓練數據集,首先基於特征條件獨立假設學習輸入/輸出的聯合概率分布;然後基於此模型,對給定的輸入x,利用貝

樸素貝葉斯算法

樸素貝葉斯算法樸素貝葉斯算法如何理解?樸素貝葉斯算法是一個生成式的一個算法我們的目的就是分類判斷當前的實例x是那個類別的,但是生成式是這樣的p(Ck/x)在實際問題中我們通常知道p(Ck)這個叫做先驗概率。我們也會知道p(x/ck)中的個數,這種條件概率那怎麽求 p(Ck/x)呢?首先是將條件概率分布轉換成p

機器學習--樸素貝葉斯分類,以及拉普拉斯校準

機器學習算法 我們 earch lov 單詞 標註 樸素貝葉斯分類 images 劃分 原文鏈接:http://chant00.com/2017/09/18/%E8%B4%9D%E5%8F%B6%E6%96%AF/

樸素貝葉斯算法的python實現 -- 機器學習實戰

cut ocl add set 分類器 觀察 problem enc 兩個 1 import numpy as np 2 import re 3 4 #詞表到向量的轉換函數 5 def loadDataSet(): 6 postingLi

【黎明傳數==>機器學習速成寶典】模型篇05——樸素貝葉斯【Naive Bayes】(附python代碼)

pytho res tex 機器學習 樸素貝葉斯 spa 什麽 之一 類別 目錄 先驗概率與後驗概率 什麽是樸素貝葉斯 模型的三個基本要素 構造kd樹 kd樹的最近鄰搜索 kd樹的k近鄰搜索 Python代碼(sklearn庫) 先