【轉】Hadoop學習--第二篇:史上最詳細的Hadoop環境搭建

GitChat 作者:鳴宇淳

原文: 史上最詳細的Hadoop環境搭建

前言

Hadoop在大資料技術體系中的地位至關重要,Hadoop是大資料技術的基礎,對Hadoop基礎知識的掌握的紮實程度,會決定在大資料技術道路上走多遠。

這是一篇入門文章,Hadoop的學習方法很多,網上也有很多學習路線圖。本文的思路是:以安裝部署Apache Hadoop2.x版本為主線,來介紹Hadoop2.x的架構組成、各模組協同工作原理、技術細節。安裝不是目的,通過安裝認識Hadoop才是目的。

本文分為五個部分、十三節、四十九步。

第一部分:Linux環境安裝

Hadoop是執行在Linux,雖然藉助工具也可以執行在Windows上,但是建議還是執行在Linux系統上,第一部分介紹Linux環境的安裝、配置、Java JDK安裝等。

第二部分:Hadoop本地模式安裝

Hadoop本地模式只是用於本地開發除錯,或者快速安裝體驗Hadoop,這部分做簡單的介紹。

第三部分:Hadoop偽分散式模式安裝

學習Hadoop一般是在偽分散式模式下進行。這種模式是在一臺機器上各個程序上執行Hadoop的各個模組,偽分散式的意思是雖然各個模組是在各個程序上分開執行的,但是隻是執行在一個作業系統上的,並不是真正的分散式。

第四部分:完全分散式安裝

完全分散式模式才是生產環境採用的模式,Hadoop執行在伺服器叢集上,生產環境一般都會做HA,以實現高可用。

第五部分:Hadoop HA安裝

HA是指高可用,為了解決Hadoop單點故障問題,生產環境一般都做HA部署。這部分介紹瞭如何配置Hadoop2.x的高可用,並簡單介紹了HA的工作原理。

安裝過程中,會穿插簡單介紹涉及到的知識。希望能對大家有所幫助。

第 1 部分:Linux環境安裝

1.1 配置Vmware NAT網路

1.1.1 Vmware網路模式介紹

參考:http://blog.csdn.net/collection4u/article/details/14127671

1.1.2 NAT模式配置

NAT是網路地址轉換,是在宿主機和虛擬機器之間增加一個地址轉換服務,負責外部和虛擬機器之間的通訊轉接和IP轉換。

我們部署Hadoop叢集,這裡選擇NAT模式,各個虛擬機器通過NAT使用宿主機的IP來訪問外網。

我們的要求是叢集中的各個虛擬機器有固定的IP、可以訪問外網,所以進行如下設定:

-

Vmware安裝後,預設的NAT設定如下:

-

預設的設定是啟動DHCP服務的,NAT會自動給虛擬機器分配IP,但是我們需要將各個機器的IP固定下來,所以要取消這個預設設定。

-

為機器設定一個子網網段,預設是192.168.136網段,我們這裡設定為100網段,將來各個虛擬機器Ip就為 192.168.100.*。

-

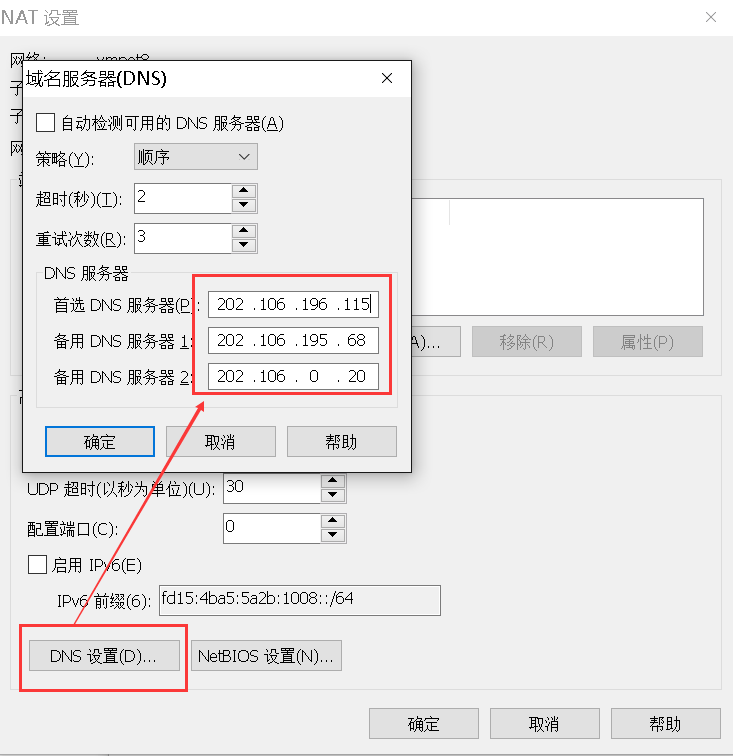

點選NAT設定按鈕,開啟對話方塊,可以修改閘道器地址和DNS地址。這裡我們為NAT指定DNS地址。

-

閘道器地址為當前網段裡的.2地址,好像是固定的,我們不做修改,先記住閘道器地址就好了,後面會用到。

1.2 安裝Linux作業系統

1.2.1 Vmware上安裝Linux系統

-

檔案選單選擇新建虛擬機器

-

選擇經典型別安裝,下一步。

-

選擇稍後安裝作業系統,下一步。

-

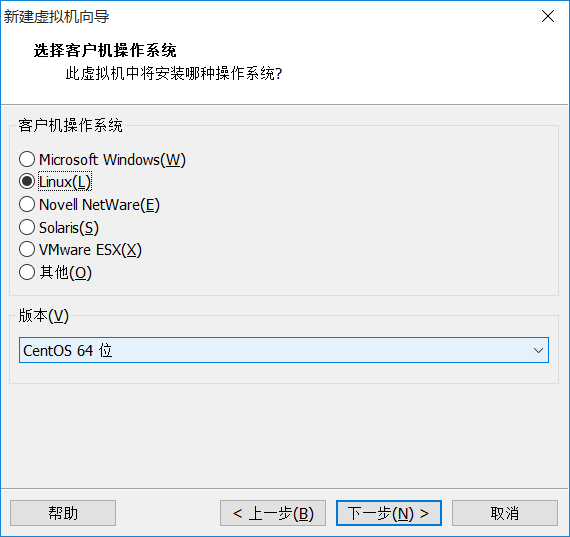

選擇Linux系統,版本選擇CentOS 64位。

-

命名虛擬機器,給虛擬機器起個名字,將來顯示在Vmware左側。並選擇Linux系統儲存在宿主機的哪個目錄下,應該一個虛擬機器儲存在一個目錄下,不能多個虛擬機器使用一個目錄。

-

指定磁碟容量,是指定分給Linux虛擬機器多大的硬碟,預設20G就可以,下一步。

-

點選自定義硬體,可以檢視、修改虛擬機器的硬體配置,這裡我們不做修改。

-

點選完成後,就建立了一個虛擬機器,但是此時的虛擬機器還是一個空殼,沒有作業系統,接下來安裝作業系統。

-

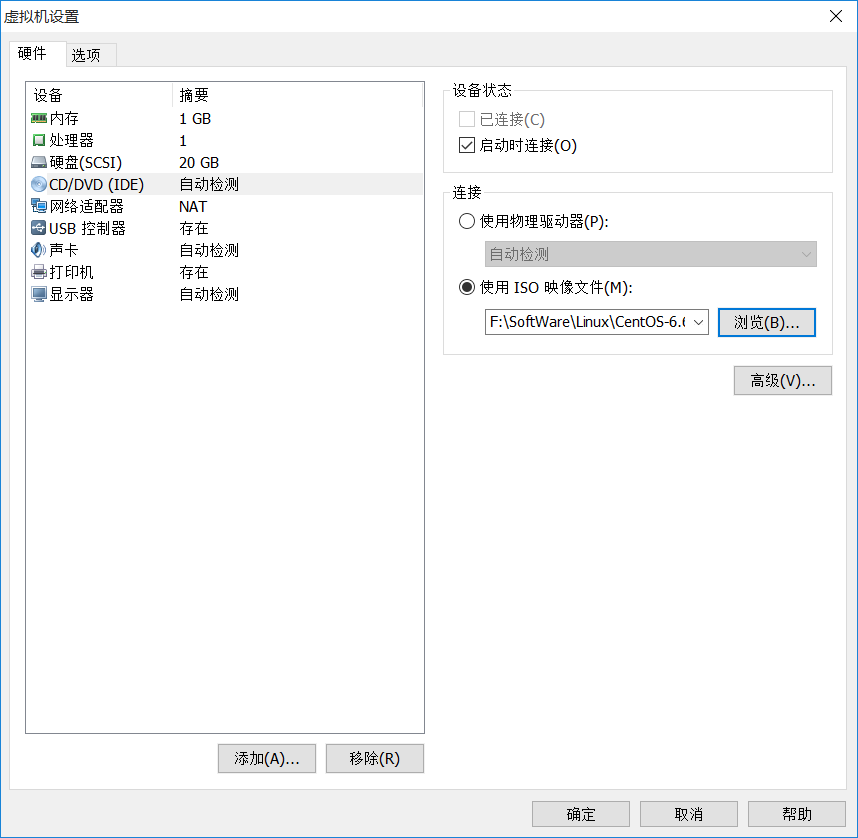

點選編輯虛擬機器設定,找到DVD,指定作業系統ISO檔案所在位置。

-

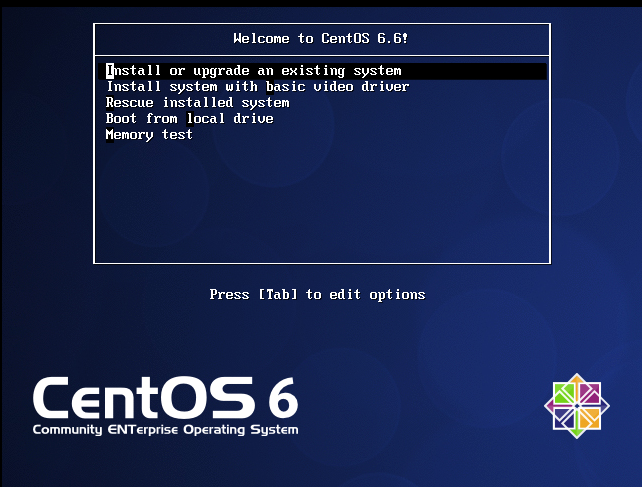

點選開啟此虛擬機器,選擇第一個回車開始安裝作業系統。

-

設定root密碼。

-

選擇Desktop,這樣就會裝一個Xwindow。

-

先不新增普通使用者,其他用預設的,就把Linux安裝完畢了。

1.2.2 設定網路

因為Vmware的NAT設定中關閉了DHCP自動分配IP功能,所以Linux還沒有IP,需要我們設定網路各個引數。

-

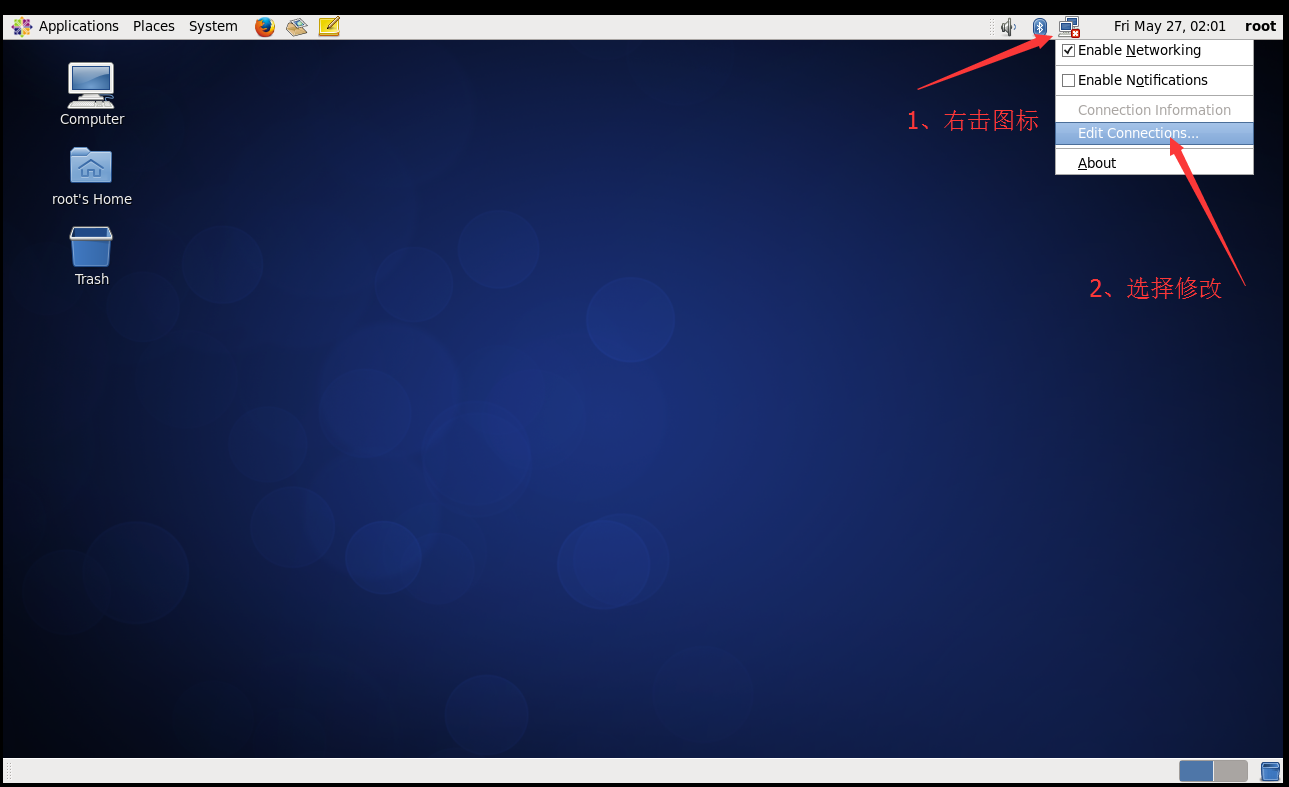

用root進入Xwindow,右擊右上角的網路連線圖示,選擇修改連線。

-

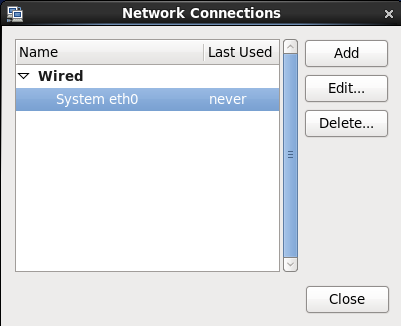

網路連線裡列出了當前Linux裡所有的網絡卡,這裡只有一個網絡卡System eth0,點選編輯。

-

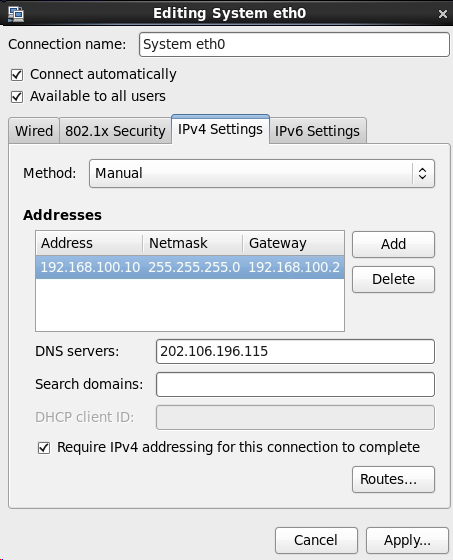

配置IP、子網掩碼、閘道器(和NAT設定的一樣)、DNS等引數,因為NAT裡設定網段為100.*,所以這臺機器可以設定為192.168.100.10閘道器和NAT一致,為192.168.100.2

-

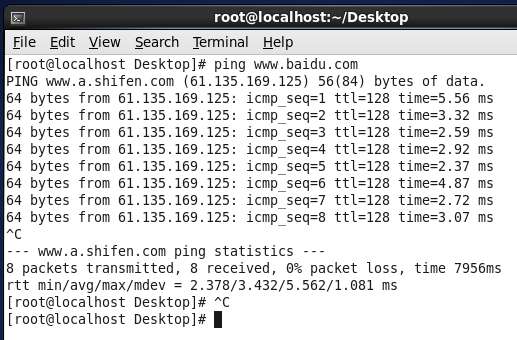

用ping來檢查是否可以連線外網,如下圖,已經連線成功。

1.2.3 修改Hostname

-

臨時修改hostname

[[email protected] Desktop]# hostname bigdata-senior01.chybinmy.com這種修改方式,系統重啟後就會失效。

-

永久修改hostname

想永久修改,應該修改配置檔案 /etc/sysconfig/network。[[email protected] ~] vim /etc/sysconfig/network開啟檔案後:

NETWORKING=yes #使用網路 HOSTNAME=bigdata-senior01.chybinmy.com #設定主機名

1.2.4 配置Host

NETWORKING=yes #使用網路

HOSTNAME=bigdata-senior01.chybinmy.com #設定主機名

1.2.5 關閉防火牆

學習環境可以直接把防火牆關閉掉。

-

用root使用者登入後,執行檢視防火牆狀態。

[[email protected] hadoop]# service iptables status -

用[[email protected] hadoop]# service iptables stop關閉防火牆,這個是臨時關閉防火牆。

[[email protected] hadoop-2.5.0]# service iptables stop iptables: Setting chains to policy ACCEPT: filter [ OK ] iptables: Flushing firewall rules: [ OK ] iptables: Unloading modules: [ OK ] -

如果要永久關閉防火牆用。

[[email protected] hadoop]# chkconfig iptables off關閉,這種需要重啟才能生效。

1.2.6 關閉selinux

selinux是Linux一個子安全機制,學習環境可以將它禁用。

[[email protected] hadoop-2.5.0]$ vim /etc/sysconfig/selinux

# This file controls the state of SELinux on the system.

# SELINUX= can take one of these three values:

# enforcing - SELinux security policy is enforced.

# permissive - SELinux prints warnings instead of enforcing.

# disabled - No SELinux policy is loaded.

SELINUX=disabled

# SELINUXTYPE= can take one of these two values:

# targeted - Targeted processes are protected,

# mls - Multi Level Security protection.

SELINUXTYPE=targeted

1.3 安裝JDK

1.3.1 安裝Java JDK

-

檢視是否已經安裝了java JDK。

[[email protected] Desktop]# java –version注意:Hadoop機器上的JDK,最好是Oracle的Java JDK,不然會有一些問題,比如可能沒有JPS命令。

如果安裝了其他版本的JDK,解除安裝掉。 -

安裝java JDK

(1) 去下載Oracle版本Java JDK:jdk-7u67-linux-x64.tar.gz

(2) 將jdk-7u67-linux-x64.tar.gz解壓到/opt/modules目錄下[[email protected] /]# tar -zxvf jdk-7u67-linux-x64.tar.gz -C /opt/modules(3) 新增環境變數

設定JDK的環境變數 JAVA_HOME。需要修改配置檔案/etc/profile,追加export JAVA_HOME="/opt/modules/jdk1.7.0_67" export PATH=$JAVA_HOME/bin:$PATH修改完畢後,執行 source /etc/profile

(4) 安裝後再次執行 java –version,可以看見已經安裝完成。

第 2 部分 Hadoop本地模式安裝

2.1 Hadoop部署模式

Hadoop部署模式有:本地模式、偽分佈模式、完全分散式模式、HA完全分散式模式。

區分的依據是NameNode、DataNode、ResourceManager、NodeManager等模組執行在幾個JVM程序、幾個機器。

| 模式名稱 | 各個模組佔用的JVM程序數 | 各個模組執行在幾個機器數上 |

|---|---|---|

| 本地模式 | 1個 | 1個 |

| 偽分散式模式 | N個 | 1個 |

| 完全分散式模式 | N個 | N個 |

| HA完全分散式 | N個 | N個 |

2.2 本地模式部署

2.2.1 本地模式介紹

本地模式是最簡單的模式,所有模組都執行與一個JVM程序中,使用的本地檔案系統,而不是HDFS,本地模式主要是用於本地開發過程中的執行除錯用。下載hadoop安裝包後不用任何設定,預設的就是本地模式。

2.2.2 解壓hadoop後就是直接可以使用

-

建立一個存放本地模式hadoop的目錄

[[email protected] modules]$ mkdir /opt/modules/hadoopstandalone -

解壓hadoop檔案

[[email protected] modules]$ tar -zxf /opt/sofeware/hadoop-2.5.0.tar.gz -C /opt/modules/hadoopstandalone/ -

確保JAVA_HOME環境變數已經配置好

[[email protected] modules]$ echo ${JAVA_HOME} /opt/modules/jdk1.7.0_67

2.2.3 執行MapReduce程式,驗證

我們這裡用hadoop自帶的wordcount例子來在本地模式下測試跑mapreduce。

-

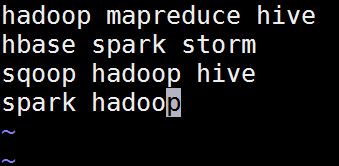

準備mapreduce輸入檔案wc.input

[[email protected] modules]$ cat /opt/data/wc.input hadoop mapreduce hive hbase spark storm sqoop hadoop hive spark hadoop -

執行hadoop自帶的mapreduce Demo

[[email protected] hadoopstandalone]$ bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.5.0.jar wordcount /opt/data/wc.input output2

這裡可以看到job ID中有local字樣,說明是執行在本地模式下的。 -

檢視輸出檔案

本地模式下,mapreduce的輸出是輸出到本地。[[email protected] hadoopstandalone]$ ll output2 total 4 -rw-r--r-- 1 hadoop hadoop 60 Jul 7 12:50 part-r-00000 -rw-r--r-- 1 hadoop hadoop 0 Jul 7 12:50 _SUCCESS輸出目錄中有_SUCCESS檔案說明JOB執行成功,part-r-00000是輸出結果檔案。

第 3 部分:Hadoop偽分散式模式安裝

3.1 偽分散式Hadoop部署過程

3.1.1 Hadoop所用的使用者設定

- 建立一個名字為hadoop的普通使用者

[[email protected] ~]# useradd hadoop [[email protected] ~]# passwd hadoop - 給hadoop使用者sudo許可權

設定許可權,學習環境可以將hadoop使用者的許可權設定的大一些,但是生產環境一定要注意普通使用者的許可權限制。[[email protected] ~]# vim /etc/sudoers

注意:如果root使用者無權修改sudoers檔案,先手動為root使用者新增寫許可權。root ALL=(ALL) ALL hadoop ALL=(root) NOPASSWD:ALL[[email protected] ~]# chmod u+w /etc/sudoers - 切換到hadoop使用者

[[email protected] ~]# su - hadoop [[email protected] ~]$ - 建立存放hadoop檔案的目錄

[[email protected] ~]$ sudo mkdir /opt/modules - 將hadoop資料夾的所有者指定為hadoop使用者

如果存放hadoop的目錄的所有者不是hadoop,之後hadoop執行中可能會有許可權問題,那麼就講所有者改為hadoop。[[email protected] ~]# sudo chown -R hadoop:hadoop /opt/modules

3.1.2 解壓Hadoop目錄檔案

- 複製hadoop-2.5.0.tar.gz到/opt/modules目錄下。

- 解壓hadoop-2.5.0.tar.gz

[[email protected] ~]# cd /opt/modules [[email protected] hadoop]# tar -zxvf hadoop-2.5.0.tar.gz

3.1.3 配置Hadoop

-

配置Hadoop環境變數

[[email protected] hadoop]# vim /etc/profile追加配置:

export HADOOP_HOME="/opt/modules/hadoop-2.5.0" export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH執行:source /etc/profile 使得配置生效

驗證HADOOP_HOME引數:[[email protected] /]$ echo $HADOOP_HOME /opt/modules/hadoop-2.5.0 -

配置 hadoop-env.sh、mapred-env.sh、yarn-env.sh檔案的JAVA_HOME引數

[[email protected] ~]$ sudo vim ${HADOOP_HOME}/etc/hadoop/hadoop-env.sh修改JAVA_HOME引數為:

export JAVA_HOME="/opt/modules/jdk1.7.0_67" -

配置core-site.xml

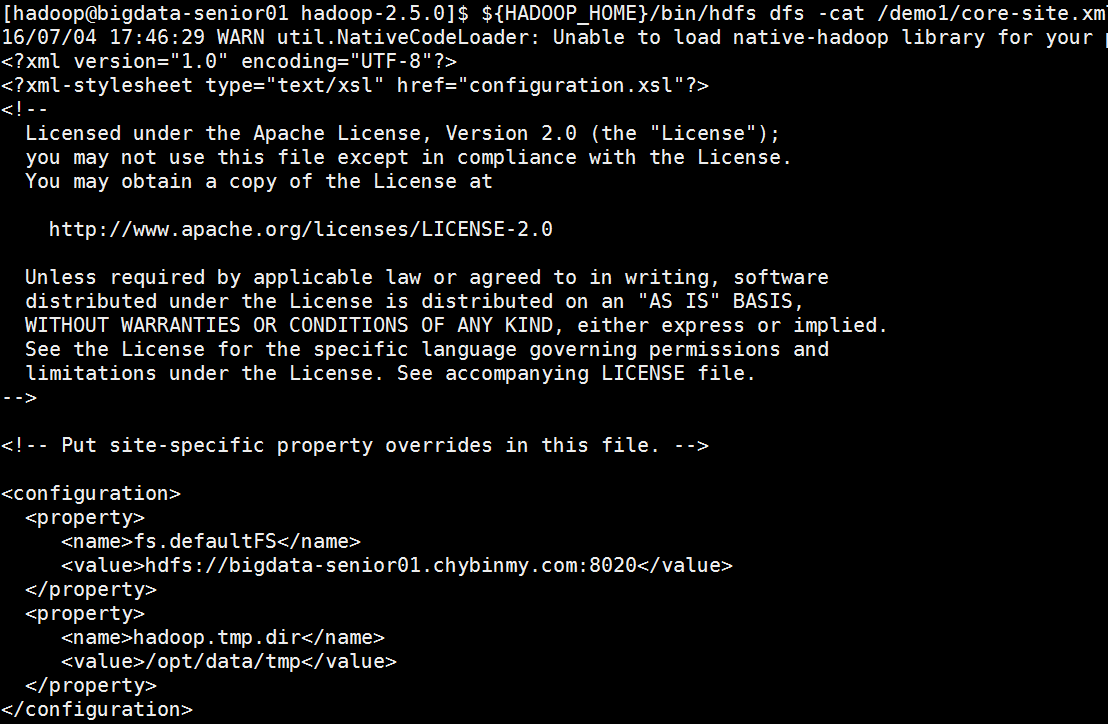

[[email protected] ~]{HADOOP_HOME}/etc/hadoop/core-site.xml(1) fs.defaultFS引數配置的是HDFS的地址。

<property> <name>fs.defaultFS</name> <value>hdfs://bigdata-senior01.chybinmy.com:8020</value> </property>(2) hadoop.tmp.dir配置的是Hadoop臨時目錄,比如HDFS的NameNode資料預設都存放這個目錄下,檢視*-default.xml等預設配置檔案,就可以看到很多依賴${hadoop.tmp.dir}的配置。

預設的hadoop.tmp.dir是/tmp/hadoop-${user.name},此時有個問題就是NameNode會將HDFS的元資料儲存在這個/tmp目錄下,如果作業系統重啟了,系統會清空/tmp目錄下的東西,導致NameNode元資料丟失,是個非常嚴重的問題,所有我們應該修改這個路徑。

-

建立臨時目錄:

[[email protected] hadoop-2.5.0]$ sudo mkdir -p /opt/data/tmp -

將臨時目錄的所有者修改為hadoop

[[email protected] hadoop-2.5.0]$ sudo chown –R hadoop:hadoop /opt/data/tmp -

修改hadoop.tmp.dir

<property> <name>hadoop.tmp.dir</name> <value>/opt/data/tmp</value> </property>

3.1.4 配置、格式化、啟動HDFS

-

配置hdfs-site.xml

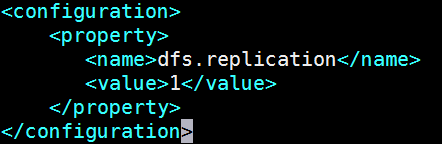

[[email protected] ~]{HADOOP_HOME}/etc/hadoop/core-site.xml<property> <name>dfs.replication</name> <value>1</value> </property>dfs.replication配置的是HDFS儲存時的備份數量,因為這裡是偽分散式環境只有一個節點,所以這裡設定為1。

-

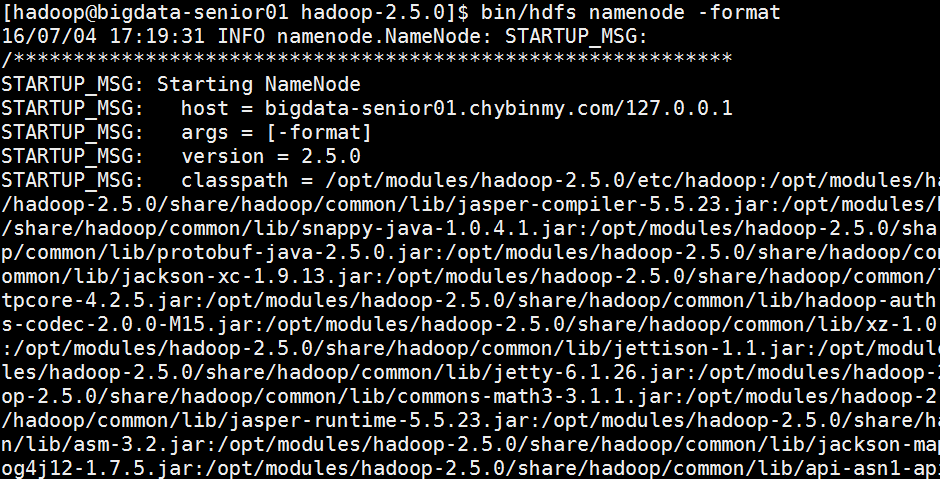

格式化HDFS

[[email protected] ~]$ hdfs namenode –format格式化是對HDFS這個分散式檔案系統中的DataNode進行分塊,統計所有分塊後的初始元資料的儲存在NameNode中。

格式化後,檢視core-site.xml裡hadoop.tmp.dir(本例是/opt/data目錄)指定的目錄下是否有了dfs目錄,如果有,說明格式化成功。

注意:

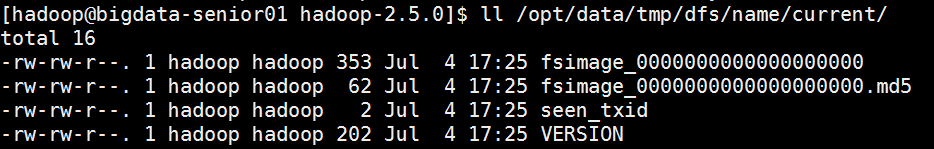

(1) 格式化時,這裡注意hadoop.tmp.dir目錄的許可權問題,應該hadoop普通使用者有讀寫許可權才行,可以將/opt/data的所有者改為hadoop。[[email protected] hadoop-2.5.0]$ sudo chown -R hadoop:hadoop /opt/data(2) 檢視NameNode格式化後的目錄。

[[email protected] ~]$ ll /opt/data/tmp/dfs/name/current

fsimage是NameNode元資料在記憶體滿了後,持久化儲存到的檔案。fsimage*.md5 是校驗檔案,用於校驗fsimage的完整性。

seen_txid 是hadoop的版本

vession檔案裡儲存:

- namespaceID:NameNode的唯一ID。

- clusterID:叢集ID,NameNode和DataNode的叢集ID應該一致,表明是一個叢集。

#Mon Jul 04 17:25:50 CST 2016 namespaceID=2101579007 clusterID=CID-205277e6-493b-4601-8e33-c09d1d23ece4 cTime=0 storageType=NAME_NODE blockpoolID=BP-1641019026-127.0.0.1-1467624350057 layoutVersion=-57 -

啟動NameNode

[[email protected] hadoop-2.5.0]$ ${HADOOP_HOME}/sbin/hadoop-daemon.sh start namenode starting namenode, logging to /opt/modules/hadoop-2.5.0/logs/hadoop-hadoop-namenode-bigdata-senior01.chybinmy.com.out

-

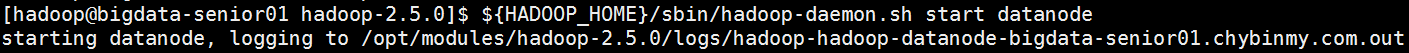

啟動DataNode

[[email protected] hadoop-2.5.0]$ ${HADOOP_HOME}/sbin/hadoop-daemon.sh start datanode starting datanode, logging to /opt/modules/hadoop-2.5.0/logs/hadoop-hadoop-datanode-bigdata-senior01.chybinmy.com.out

-

啟動SecondaryNameNode

[[email protected] hadoop-2.5.0]$ ${HADOOP_HOME}/sbin/hadoop-daemon.sh start secondarynamenode starting secondarynamenode, logging to /opt/modules/hadoop-2.5.0/logs/hadoop-hadoop-secondarynamenode-bigdata-senior01.chybinmy.com.out

-

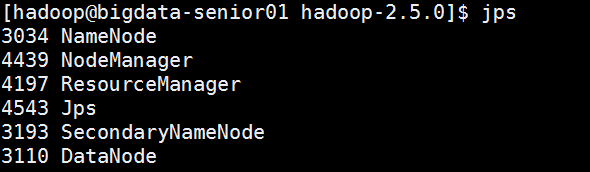

JPS命令檢視是否已經啟動成功,有結果就是啟動成功了。

[[email protected] hadoop-2.5.0]$ jps 3034 NameNode 3233 Jps 3193 SecondaryNameNode 3110 DataNode

-

HDFS上測試建立目錄、上傳、下載檔案

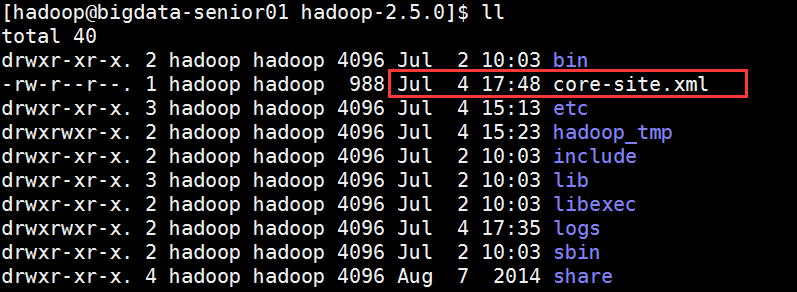

(1) HDFS上建立目錄[[email protected] hadoop-2.5.0]$ ${HADOOP_HOME}/bin/hdfs dfs -mkdir /demo1(2) 上傳本地檔案到HDFS上

[[email protected] hadoop-2.5.0]$ ${HADOOP_HOME}/bin/hdfs dfs -put ${HADOOP_HOME}/etc/hadoop/core-site.xml /demo1(3) 讀取HDFS上的檔案內容

[[email protected] hadoop-2.5.0]$ ${HADOOP_HOME}/bin/hdfs dfs -cat /demo1/core-site.xml

(4) 從HDFS上下載檔案到本地[[email protected] hadoop-2.5.0]$ bin/hdfs dfs -get /demo1/core-site.xml

3.1.5 配置、啟動YARN

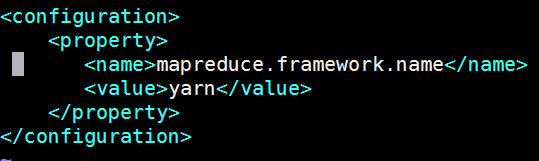

- 配置mapred-site.xml

預設沒有mapred-site.xml檔案,但是有個mapred-site.xml.template配置模板檔案。複製模板生成mapred-site.xml。

新增配置如下:[[email protected] hadoop-2.5.0]# cp etc/hadoop/mapred-site.xml.template etc/hadoop/mapred-site.xml

指定mapreduce執行在yarn框架上。<property> <name>mapreduce.framework.name</name> <value>yarn</value> </property>

2. 配置yarn-site.xml

新增配置如下:<property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <property> <name>yarn.resourcemanager.hostname</name> <value>bigdata-senior01.chybinmy.com</value> </property>

- yarn.nodemanager.aux-services配置了yarn的預設混洗方式,選擇為mapreduce的預設混洗演算法。

- yarn.resourcemanager.hostname指定了Resourcemanager執行在哪個節點上。

- 啟動Resourcemanager

[[email protected] hadoop-2.5.0]$ ${HADOOP_HOME}/sbin/yarn-daemon.sh start resourcemanager

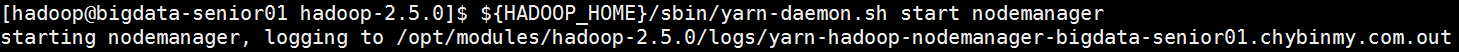

- 啟動nodemanager

[[email protected] hadoop-2.5.0]$ ${HADOOP_HOME}/sbin/yarn-daemon.sh start nodemanager

- 檢視是否啟動成功

可以看到ResourceManager、NodeManager已經啟動成功了。[[email protected] hadoop-2.5.0]$ jps 3034 NameNode 4439 NodeManager 4197 ResourceManager 4543 Jps 3193 SecondaryNameNode 3110 DataNode

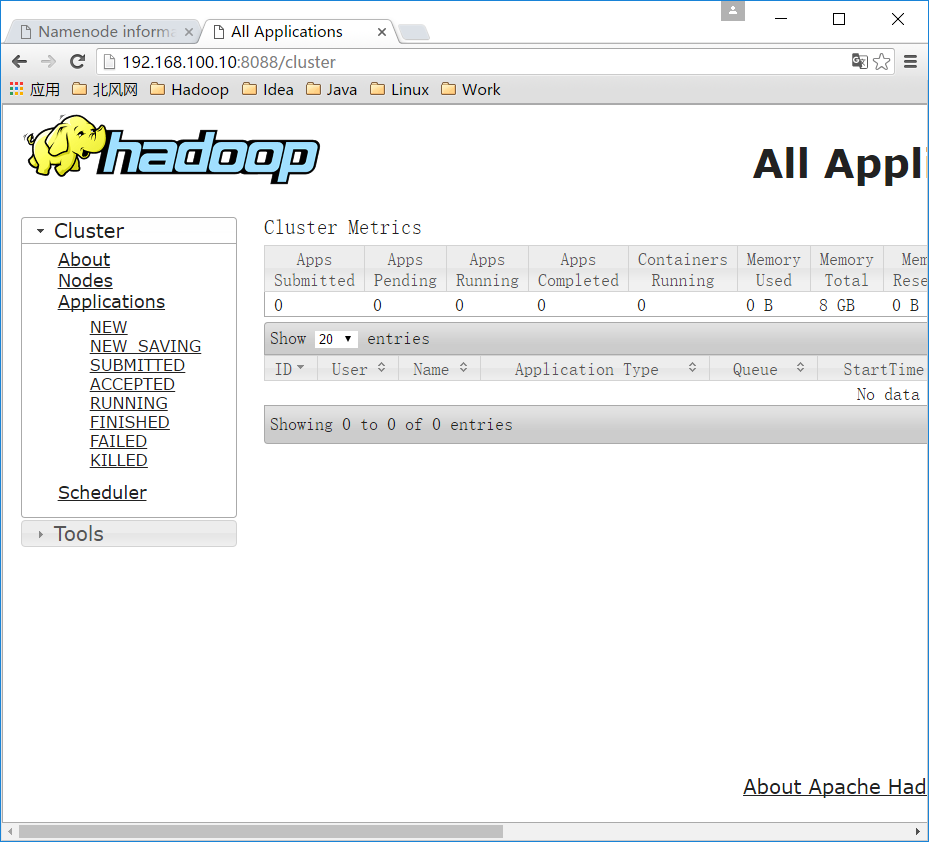

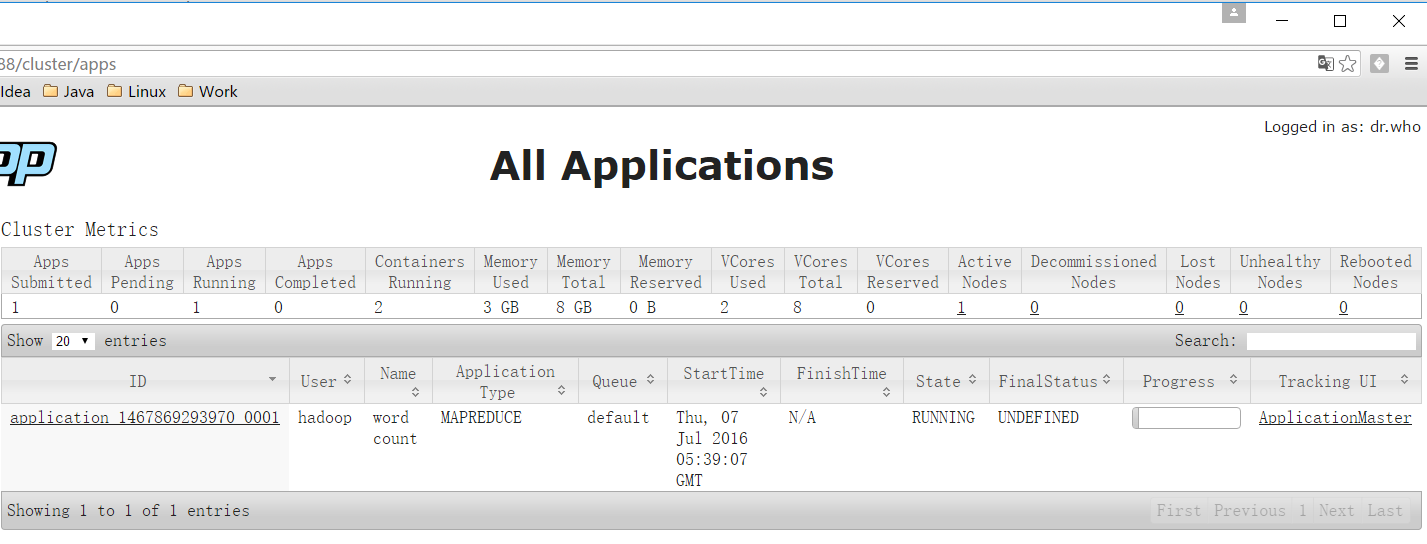

- YARN的Web頁面

YARN的Web客戶端埠號是8088,通過http://192.168.100.10:8088/可以檢視。

3.1.6 執行MapReduce Job

在Hadoop的share目錄裡,自帶了一些jar包,裡面帶有一些mapreduce例項小例子,位置在share/hadoop/mapreduce/hadoop-mapreduce-examples-2.5.0.jar,可以執行這些例子體驗剛搭建好的Hadoop平臺,我們這裡來執行最經典的WordCount例項。

-

建立測試用的Input檔案

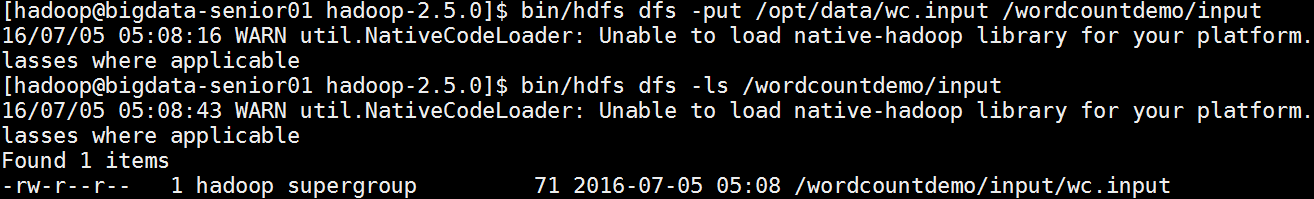

(1) 建立輸入目錄:[[email protected] hadoop-2.5.0]$ bin/hdfs dfs -mkdir -p /wordcountdemo/input(2) 建立原始檔案:

在本地/opt/data目錄建立一個檔案wc.input,內容如下:

(3) 將wc.input檔案上傳到HDFS的/wordcountdemo/input目錄中:[[email protected] hadoop-2.5.0]$ bin/hdfs dfs -put /opt/data/wc.input /wordcountdemo/input

-

執行WordCount MapReduce Job

[[email protected] hadoop-2.5.0]$ bin/yarn jar share/hadoop/mapreduce/hadoop-mapreduce-examples- 2.5.0.jar wordcount /wordcountdemo/input /wordcountdemo/output

-

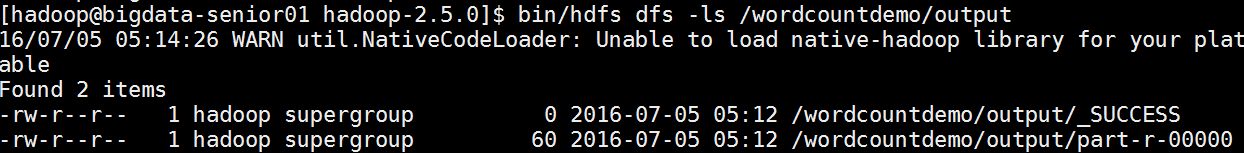

檢視輸出結果目錄

[[email protected] hadoop-2.5.0]$ bin/hdfs dfs -ls /wordcountdemo/output -rw-r--r-- 1 hadoop supergroup 0 2016-07-05 05:12 /wordcountdemo/output/_SUCCESS -rw-r--r-- 1 hadoop supergroup 60 2016-07-05 05:12 /wordcountdemo/output/part-r-00000

- output目錄中有兩個檔案,_SUCCESS檔案是空檔案,有這個檔案說明Job執行成功。

- part-r-00000檔案是結果檔案,其中-r-說明這個檔案是Reduce階段產生的結果,mapreduce程式執行時,可以沒有reduce階段,但是肯定會有map階段,如果沒有reduce階段這個地方有是-m-。

- 一個reduce會產生一個part-r-開頭的檔案。

- 檢視輸出檔案內容。

[[email protected] hadoop-2.5.0]$ bin/hdfs dfs -cat /wordcountdemo/output/part-r-00000 hadoop 3 hbase 1 hive 2 mapreduce 1 spark 2 sqoop 1 storm 1結果是按照鍵值排好序的。

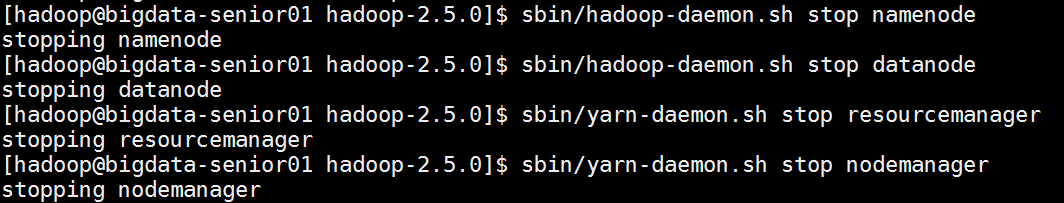

3.1.7 停止Hadoop

[[email protected] hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop namenode

stopping namenode

[[email protected] hadoop-2.5.0]$ sbin/hadoop-daemon.sh stop datanode

stopping datanode

[[email protected] hadoop-2.5.0]$ sbin/yarn-daemon.sh stop resourcemanager

stopping resourcemanager

[[email protected] hadoop-2.5.0]$ sbin/yarn-daemon.sh stop nodemanager

stopping nodemanager

3.1.8 Hadoop各個功能模組的理解

-

HDFS模組

HDFS負責大資料的儲存,通過將大檔案分塊後進行分散式儲存方式,突破了伺服器硬碟大小的限制,解決了單臺機器無法儲存大檔案的問題,HDFS是個相對獨立的模組,可以為YARN提供服務,也可以為HBase等其他模組提供服務。 -

YARN模組

YARN是一個通用的資源協同和任務排程框架,是為了解決Hadoop1.x中MapReduce裡NameNode負載太大和其他問題而建立的一個框架。YARN是個通用框架,不止可以執行MapReduce,還可以執行Spark、Storm等其他計算框架。

-

MapReduce模組

MapReduce是一個計算框架,它給出了一種資料處理的方式,即通過Map階段、Reduce階段來分散式地流式處理資料。它只適用於大資料的離線處理,對實時性要求很高的應用不適用。

3.2 開啟歷史服務

3.2.1 歷史服務介紹

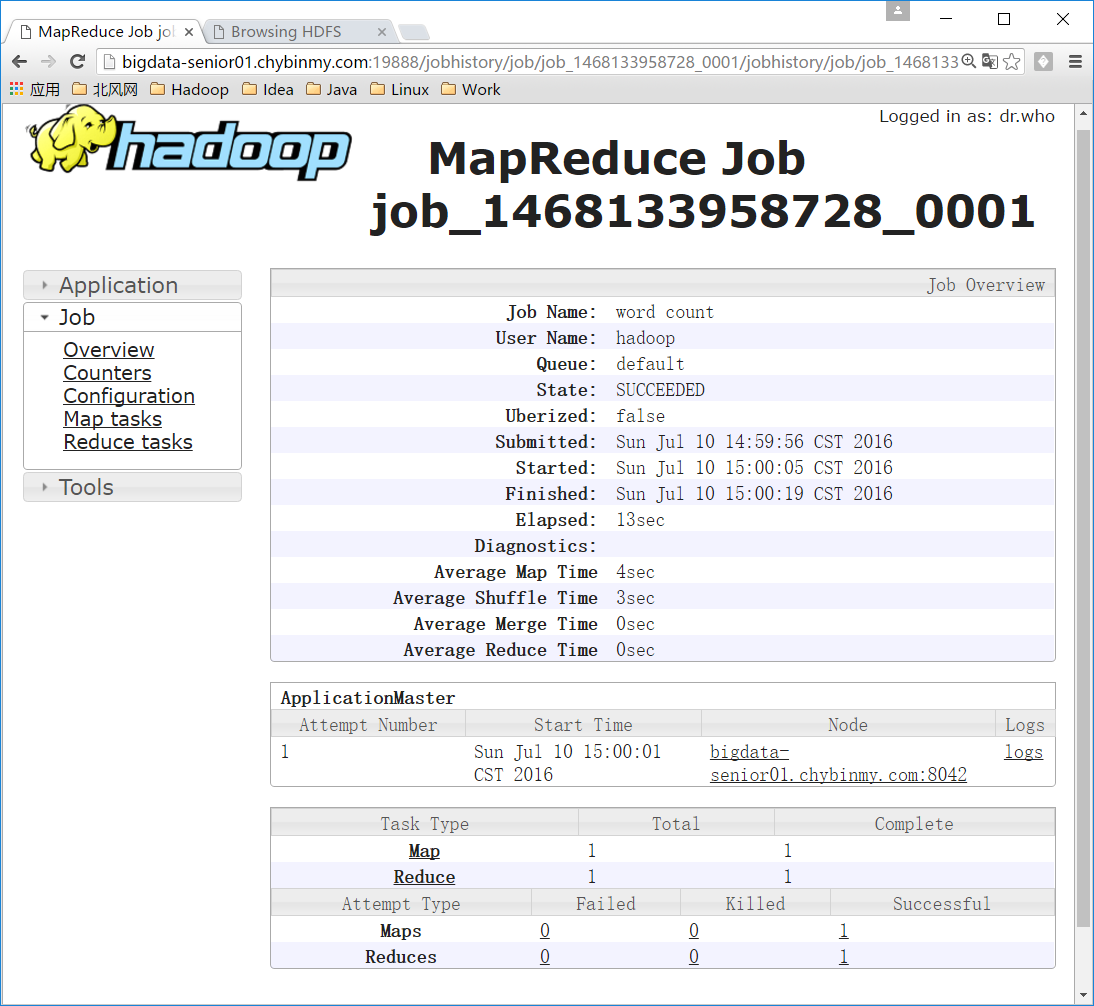

Hadoop開啟歷史服務可以在web頁面上檢視Yarn上執行job情況的詳細資訊。可以通過歷史伺服器檢視已經執行完的Mapreduce作業記錄,比如用了多少個Map、用了多少個Reduce、作業提交時間、作業啟動時間、作業完成時間等資訊。

3.2.2 開啟歷史服務

[[email protected] hadoop-2.5.0]$ sbin/mr-jobhistory-daemon.sh start historyserver、

開啟後,可以通過Web頁面檢視歷史伺服器:

http://bigdata-senior01.chybinmy.com:19888/

3.2.3 Web檢視job執行歷史

-

執行一個mapreduce任務

[[email protected] hadoop-2.5.0]$ bin/yarn jar share/hadoop/mapreduce/hadoop-mapreduce-examples- 2.5.0.jar wordcount /wordcountdemo/input /wordcountdemo/output1 -

job執行中

-

檢視job歷史

歷史伺服器的Web埠預設是19888,可以檢視Web介面。但是在上面所顯示的某一個Job任務頁面的最下面,Map和Reduce個數的連結上,點選進入Map的詳細資訊頁面,再檢視某一個Map或者Reduce的詳細日誌是看不到的,是因為沒有開啟日誌聚集服務。

3.2.4 開啟日誌聚集

-

日誌聚集介紹

MapReduce是在各個機器上執行的,在執行過程中產生的日誌存在於各個機器上,為了能夠統一檢視各個機器的執行日誌,將日誌集中存放在HDFS上,這個過程就是日誌聚集。 -

開啟日誌聚集

(1) 配置日誌聚集功能:

Hadoop預設是不啟用日誌聚集的。在yarn-site.xml檔案裡配置啟用日誌聚集。<property> <name>yarn.log-aggregation-enable</name> <value>true</value> </property> <property> <name>yarn.log-aggregation.retain-seconds</name> <value>106800</value> </property>yarn.log-aggregation-enable:是否啟用日誌聚集功能。

yarn.log-aggregation.retain-seconds:設定日誌保留時間,單位是秒。(2) 將配置檔案分發到其他節點:

[[email protected] hadoop]$ scp /opt/modules/hadoop-2.5.0/etc/hadoop/yarn-site.xml bigdata-senior02.chybinmy.com:/opt/modules/hadoop-2.5.0/etc/hadoop/ [[email protected] hadoop]$ scp /opt/modules/hadoop-2.5.0/etc/hadoop/yarn-site.xml bigdata-senior03.chybinmy.com:/opt/modules/hadoop-2.5.0/etc/hadoop/(3) 重啟Yarn程序:

[[email protected] hadoop-2.5.0]$ sbin/stop-yarn.sh [[email protected] hadoop-2.5.0]$ sbin/start-yarn.sh(4) 重啟HistoryServer程序:

[[email protected] hadoop-2.5.0]$ sbin/mr-jobhistory-daemon.sh stop historyserver [[email protected] hadoop-2.5.0]$ sbin/mr-jobhistory-daemon.sh start historyserver -

測試日誌聚集

執行一個demo MapReduce,使之產生日誌:bin/yarn jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.5.0.jar wordcount /input /output1檢視日誌:

執行Job後,就可以在歷史伺服器Web頁面檢視各個Map和Reduce的日誌了。

第 4 部分:完全分散式安裝

4.1 完全布式環境部署Hadoop

完全分部式是真正利用多臺Linux主機來進行部署Hadoop,對Linux機器叢集進行規劃,使得Hadoop各個模組分別部署在不同的多臺機器上。

4.1.1 環境準備

- 克隆虛擬機器

- Vmware左側選中要克隆的機器,這裡對原有的BigData01機器進行克隆,虛擬機器選單中,選中管理選單下的克隆命令。

- 選擇“建立完整克隆”,虛擬機器名稱為BigData02,選擇虛擬機器檔案儲存路徑,進行克隆。

- 再次克隆一個名為BigData03的虛擬機器。

-

配置網路

(1) 修改網絡卡名稱:

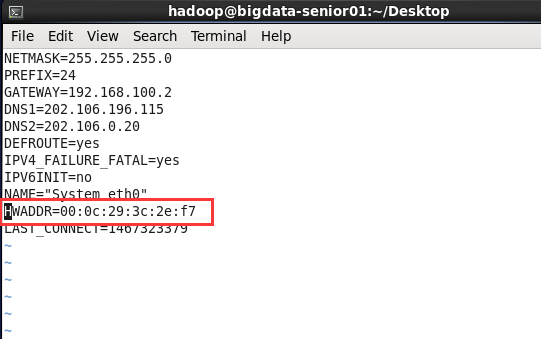

在BigData02和BigData03機器上編輯網絡卡資訊。執行sudo vim /etc/udev/rules.d/70-persistent-net.rules命令。因為是從BigData01機器克隆來的,所以會保留BigData01的網絡卡eth0,並且再新增一個網絡卡eth1。並且eth0的Mac地址和BigData01的地址是一樣的,Mac地址不允許相同,所以要刪除eth0,只保留eth1網絡卡,並且要將eth1改名為eth0。將修改後的eth0的mac地址複製下來,修改network-scripts檔案中的HWADDR屬性。sudo vim /etc/sysconfig/network-scripts/ifcfg-eth0

修改網路引數:- BigData02機器IP改為192.168.100.12

- BigData03機器IP改為192.168.100.13

-

配置Hostname

BigData02配置hostname為 bigdata-senior02.chybinmy.com

BigData03配置hostname為 bigdata-senior03.chybinmy.com -

配置hosts

BigData01、BigData02、BigData03三臺機器hosts都配置為:[[email protected] hadoop-2.5.0]$ sudo vim /etc/hosts 192.168.100.10 bigdata-senior01.chybinmy.com 192.168.100.12 bigdata-senior02.chybinmy.com 192.168.100.13 bigdata-senior03.chybinmy.com -

配置Windows上的SSH客戶端

在本地Windows中的SSH客戶端上新增對BigData02、BigData03機器的SSH連結。

4.1.2 伺服器功能規劃

| bigdata-senior01.chybinmy.com | bigdata-senior02.chybinmy.com | bigdata-senior03.chybinmy.com |

|---|---|---|

| NameNode | ResourceManage | |

| DataNode | DataNode | DataNode |

| NodeManager | NodeManager | NodeManager |

| HistoryServer | SecondaryNameNode |

4.1.3 在第一臺機器上安裝新的Hadoop

為了和之前BigData01機器上安裝偽分散式Hadoop區分開來,我們將BigData01上的Hadoop服務都停止掉,然後在一個新的目錄/opt/modules/app下安裝另外一個Hadoop。

我們採用先在第一臺機器上解壓、配置Hadoop,然後再分發到其他兩臺機器上的方式來安裝叢集。

-

解壓Hadoop目錄:

[[email protected] modules]$ tar -zxf /opt/sofeware/hadoop-2.5.0.tar.gz -C /opt/modules/app/ -

配置Hadoop JDK路徑修改hadoop-env.sh、mapred-env.sh、yarn-env.sh檔案中的JDK路徑:

export JAVA_HOME="/opt/modules/jdk1.7.0_67" -

配置core-site.xml

[[email protected] hadoop-2.5.0]$ vim etc/hadoop/core-site.xml<configuration> <property> <name>fs.defaultFS</name> <value>hdfs://bigdata-senior01.chybinmy.com:8020</value> </property> <property> <name>hadoop.tmp.dir</name> <value>/opt/modules/app/hadoop-2.5.0/data/tmp</value> </property> </configuration>fs.defaultFS為NameNode的地址。

hadoop.tmp.dir為hadoop臨時目錄的地址,預設情況下,NameNode和DataNode的資料檔案都會存在這個目錄下的對應子目錄下。應該保證此目錄是存在的,如果不存在,先建立。

-

配置hdfs-site.xml

[[email protected] hadoop-2.5.0]$ vim etc/hadoop/hdfs-site.xml<configuration> <property> <name>dfs.namenode.secondary.http-address</name> <value>bigdata-senior03.chybinmy.com:50090</value> </property> </configuration>dfs.namenode.secondary.http-address是指定secondaryNameNode的http訪問地址和埠號,因為在規劃中,我們將BigData03規劃為SecondaryNameNode伺服器。

-

配置slaves

[[email protected] hadoop-2.5.0]$ vim etc/hadoop/slaves bigdata-senior01.chybinmy.com bigdata-senior02.chybinmy.com bigdata-senior03.chybinmy.comslaves檔案是指定HDFS上有哪些DataNode節點。

-

配置yarn-site.xml

[[email protected] hadoop-2.5.0]$ vim etc/hadoop/yarn-site.xml<property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <property> <name>yarn.resourcemanager.hostname</name> <value>bigdata-senior02.chybinmy.com</value> </property> <property> <name>yarn.log-aggregation-enable</name> <value>true</value> </property> <property> <name>yarn.log-aggregation.retain-seconds</name> <value>106800</value> </property>根據規劃 yarn.resourcemanager.hostname 這個指定 resourcemanager 伺服器指向 bigdata-senior02.chybinmy.com 。

yarn.log-aggregation-enable是配置是否啟用日誌聚集功能。

yarn.log-aggregation.retain-seconds是配置聚集的日誌在HDFS上最多儲存多長時間。

-

配置mapred-site.xml

從mapred-site.xml.template複製一個mapred-site.xml檔案。[[email protected] hadoop-2.5.0]$ cp etc/hadoop/mapred-site.xml.template etc/hadoop/mapred-site.xml<configuration> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> <property> <name>mapreduce.jobhistory.address</name> <value>bigdata-senior01.chybinmy.com:10020</value> </property> <property> <name>mapreduce.jobhistory.webapp.address</name> <value>bigdata-senior01.chybinmy.com:19888</value> </property> </configuration>mapreduce.framework.name設定mapreduce任務執行在yarn上。

mapreduce.jobhistory.address是設定mapreduce的歷史伺服器安裝在BigData01機器上。

mapreduce.jobhistory.webapp.address是設定歷史伺服器的web頁面地址和埠號。

4.1.4 設定SSH無密碼登入

Hadoop叢集中的各個機器間會相互地通過SSH訪問,每次訪問都輸入密碼是不現實的,所以要配置各個機器間的

SSH是無密碼登入的。

-

在BigData01上生成公鑰

[[email protected] hadoop-2.5.0]$ ssh-keygen -t rsa一路回車,都設定為預設值,然後再當前使用者的Home目錄下的.ssh目錄中會生成公鑰檔案(id_rsa.pub)和私鑰檔案(id_rsa)。

-

分發公鑰

[[email protected] hadoop-2.5.0]$ ssh-copy-id bigdata-senior01.chybinmy.com [[email protected] hadoop-2.5.0]$ ssh-copy-id bigdata-senior02.chybinmy.com [[email protected] hadoop-2.5.0]$ ssh-copy-id bigdata-senior03.chybinmy.com -

設定BigData02、BigData03到其他機器的無金鑰登入

同樣的在BigData02、BigData03上生成公鑰和私鑰後,將公鑰分發到三臺機器上。

4.1.5 分發Hadoop檔案

-

首先在其他兩臺機器上建立存放Hadoop的目錄

[[email protected] ~]$ mkdir /opt/modules/app [[email protected] ~]$ mkdir /opt/modules/app -

通過Scp分發

Hadoop根目錄下的share/doc目錄是存放的hadoop的文件,檔案相當大,建議在分發之前將這個目錄刪除掉,可以節省硬碟空間並能提高分發的速度。

doc目錄大小有1.6G。

[[email protected] hadoop-2.5.0]$ du -sh /opt/modules/app/hadoop-2.5.0/share/doc 1.6G /opt/modules/app/hadoop-2.5.0/share/doc [[email protected] hadoop-2.5.0]$ scp -r /opt/modules/app/hadoop-2.5.0/ bigdata-senior02.chybinmy.com:/opt/modules/app [[email protected] hadoop-2.5.0]$ scp -r /opt/modules/app/hadoop-2.5.0/ bigdata-senior03.chybinmy.com:/opt/modules/app

4.1.6 格式NameNode

在NameNode機器上執行格式化:

[[email protected] hadoop-2.5.0]$ /opt/modules/app/hadoop-2.5.0/bin/hdfs namenode –format

注意:

如果需要重新格式化NameNode,需要先將原來NameNode和DataNode下的檔案全部刪除,不然會報錯,NameNode和DataNode所在目錄是在core-site.xml中hadoop.tmp.dir、dfs.namenode.name.dir、dfs.datanode.data.dir屬性配置的。

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/data/tmp</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file://${hadoop.tmp.dir}/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file://${hadoop.tmp.dir}/dfs/data</value>

</property>

因為每次格式化,預設是建立一個叢集ID,並寫入NameNode和DataNode的VERSION檔案中(VERSION檔案所在目錄為dfs/name/current 和 dfs/data/current),重新格式化時,預設會生成一個新的叢集ID,如果不刪除原來的目錄,會導致namenode中的VERSION檔案中是新的叢集ID,而DataNode中是舊的叢集ID,不一致時會報錯。

另一種方法是格式化時指定叢集ID引數,指定為舊的叢集ID。

4.1.7 啟動叢集

-

啟動HDFS

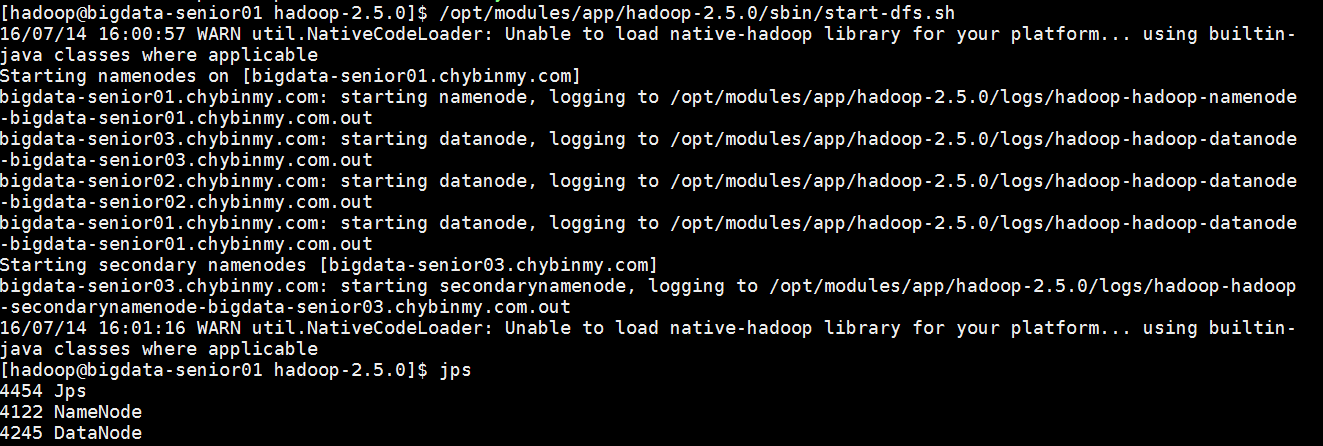

[[email protected] hadoop-2.5.0]$ /opt/modules/app/hadoop-2.5.0/sbin/start-dfs.sh

-

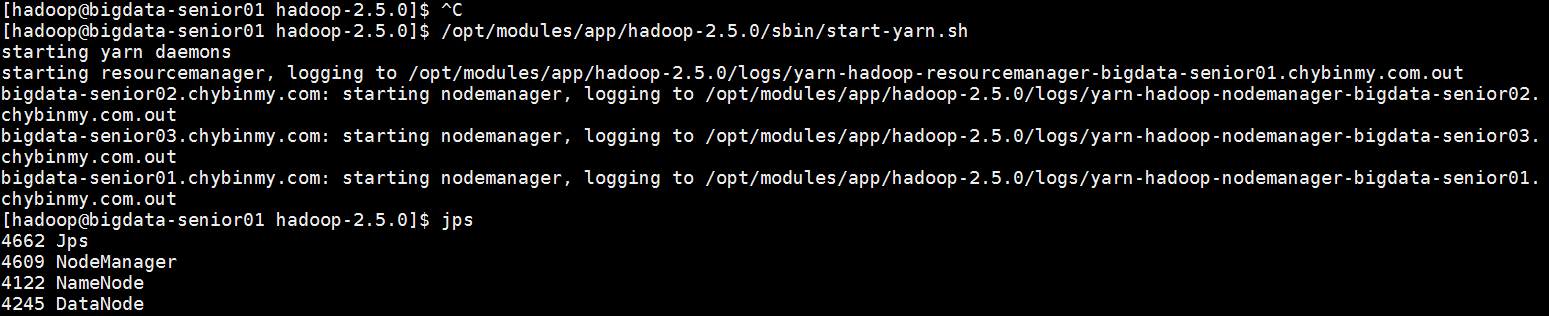

啟動YARN

[[email protected] hadoop-2.5.0]$ /opt/modules/app/hadoop-2.5.0/sbin/start-yarn.sh在BigData02上啟動ResourceManager:

[[email protected] hadoop-2.5.0]$ sbin/yarn-daemon.sh start resourcemanager

-

啟動日誌伺服器

因為我們規劃的是在BigData03伺服器上執行MapReduce日誌服務,所以要在BigData03上啟動。[[email protected] ~]$ /opt/modules/app/hadoop-2.5.0/sbin/mr-jobhistory-daemon.sh start historyserver starting historyserver, logging to /opt/modules/app/hadoop-2.5.0/logs/mapred-hadoop-historyserver-bigdata-senior03.chybinmy.com.out[[email protected] ~]$ jps 3570 Jps 3537 JobHistoryServer 3310 SecondaryNameNode 3213 DataNode 3392 NodeManager -

檢視HDFS Web頁面

http://bigdata-senior01.chybinmy.com:50070/ -

檢視YARN Web 頁面

http://bigdata-senior02.chybinmy.com:8088/cluster

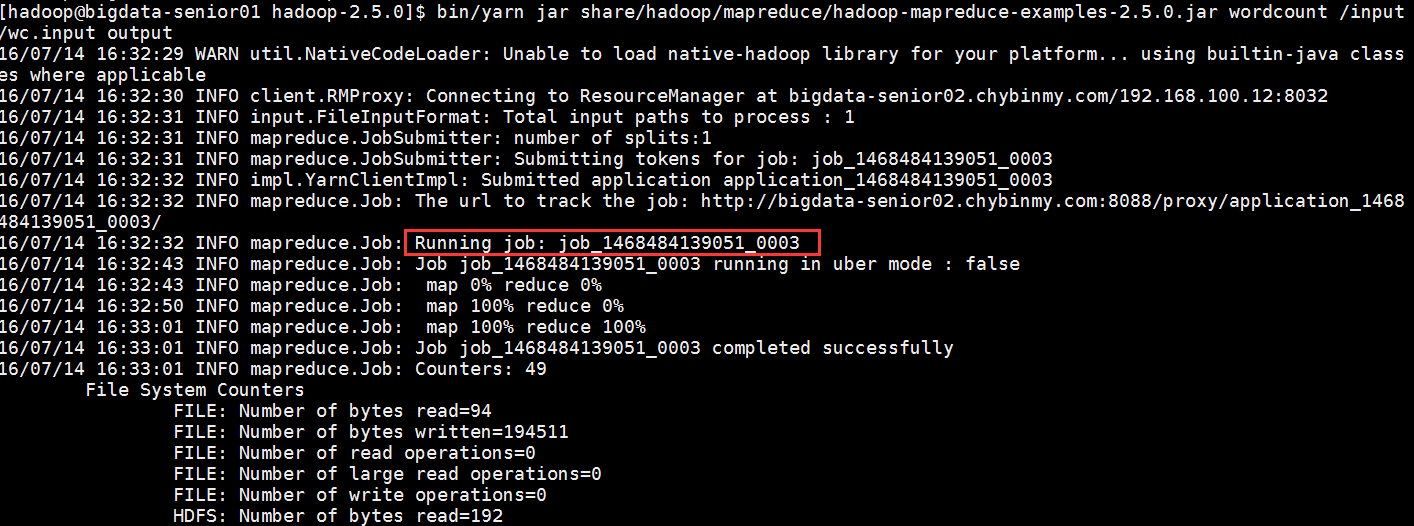

4.1.8 測試Job

我們這裡用hadoop自帶的wordcount例子來在本地模式下測試跑mapreduce。

-

準備mapreduce輸入檔案wc.input

[[email protected] modules]$ cat /opt/data/wc.input hadoop mapreduce hive hbase spark storm sqoop hadoop hive spark hadoop -

在HDFS建立輸入目錄input

[[email protected] hadoop-2.5.0]$ bin/hdfs dfs -mkdir /input -

將wc.input上傳到HDFS

[[email protected] hadoop-2.5.0]$ bin/hdfs dfs -put /opt/data/wc.input /input/wc.input -

執行hadoop自帶的mapreduce Demo

[[email protected] hadoop-2.5.0]$ bin/yarn jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.5.0.jar wordcount /input/wc.input /output

-

檢視輸出檔案

[[email protected] hadoop-2.5.0]$ bin/hdfs dfs -ls /output Found 2 items -rw-r--r-- 3 hadoop supergroup 0 2016-07-14 16:36 /output/_SUCCESS -rw-r--r-- 3 hadoop supergroup 60 2016-07-14 16:36 /output/part-r-00000

第 5 部分 Hadoop HA安裝

HA的意思是High Availability高可用,指噹噹前工作中的機器宕機後,會自動處理這個異常,並將工作無縫地轉移到其他備用機器上去,以來保證服務的高可用。

HA方式安裝部署才是最常見的生產環境上的安裝部署方式。Hadoop HA是Hadoop 2.x中新新增的特性,包括NameNode HA 和 ResourceManager HA。因為DataNode和NodeManager本身就是被設計為高可用的,所以不用對他們進行特殊的高可用處理。

5.1 時間伺服器搭建

Hadoop對叢集中各個機器的時間同步要求比較高,要求各個機器的系統時間不能相差太多,不然會造成很多問題。可以配置叢集中各個機器和網際網路的時間伺服器進行時間同步,但是在實際生產環境中,叢集中大部分伺服器是不能連線外網的,這時候可以在內網搭建一個自己的時間伺服器(NTP伺服器),叢集的各個機器與這個時間伺服器進行時間同步。

5.1.1 配置NTP伺服器

我們選擇第三臺機器(bigdata-senior03.chybinmy.com)為NTF伺服器,其他機器和這臺機器進行同步。

-

檢查ntp服務是否已經安裝

[[email protected] data]$ sudo rpm -qa | grep ntp ntpdate-4.2.6p5-1.el6.centos.x86_64 ntp-4.2.6p5-1.el6.centos.x86_64顯示已經安裝過了ntp程式,其中ntpdate-4.2.6p5-1.el6.centos.x86_64 是用來和某臺伺服器進行同步的,ntp-4.2.6p5-1.el6.centos.x86_64是用來提供時間同步服務的。

-

修改配置檔案ntp.conf

[[email protected] data]$ vim /etc/ntp.conf啟用restrice,修改網段

restrict 192.168.100.0 mask 255.255.255.0 nomodify notrap

將這行的註釋去掉,並且將網段改為叢集的網段,我們這裡是100網段。註釋掉server域名配置

#server 0.centos.pool.ntp.org iburst #server 1.centos.pool.ntp.org iburst #server 2.centos.pool.ntp.org iburst #server 3.centos.pool.ntp.org iburst是時間伺服器的域名,這裡不需要連線網際網路,所以將他們註釋掉。

修改

server 127.127.1.0

fudge 127.127.1.0 stratum 10

-

修改配置檔案ntpd

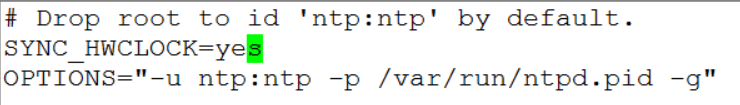

[[email protected] ~]$ sudo vim /etc/sysconfig/ntpd新增一行配置:SYNC_CLOCK=yes

-

啟動ntp服務

[[email protected] ~]$ sudo chkconfig ntpd on這樣每次機器啟動時,ntp服務都會自動啟動。

5.1.2 配置其他機器的同步

切換到root使用