Qt 視訊採集

本文介紹了Qt使用opencv進行視訊採集的方法,本文主要包括:

-

流程

- 識別硬體裝置(攝像頭);

- 開啟影像裝置(攝像頭);

- 讀取攝像頭的資訊,從攝像頭抓取視訊幀,轉換為QImage格式,顯示在介面上。

- 關閉攝像頭,釋放資源。

-

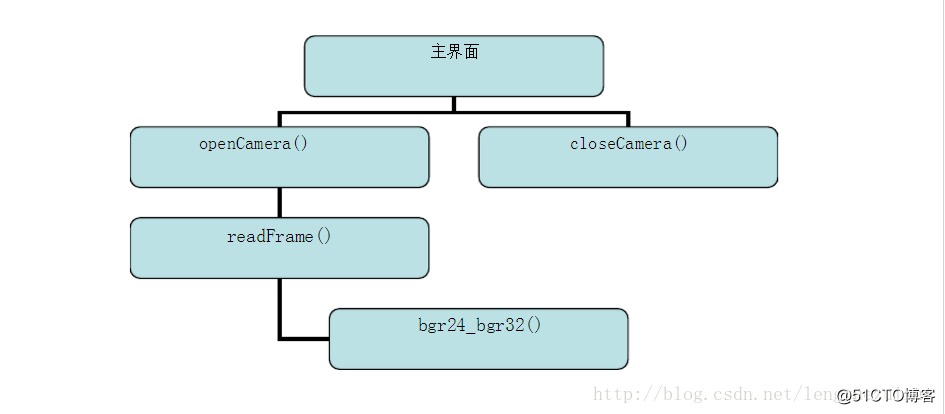

總體結構

- openCamera()開啟攝像頭;

- readFrame()讀取視訊幀;

- closeCamera()關閉攝像頭

- bgr24_bgr32()視訊資料轉換為QImage;

參考程式碼見:https://www.yuque.com/docs/share/d55c52f0-0567-41ac-9cb5-4727358df4ae

相關推薦

Qt 視訊採集

本文介紹了Qt使用opencv進行視訊採集的方法,本文主要包括: 流程 識別硬體裝置(攝像頭); 開啟影像裝置(攝像頭); 讀取攝像頭的資訊,從攝像頭抓取視訊幀,轉換為QImage格式,顯示在介面上。 關閉攝像頭,釋放資源。 總體結構

Zedboard & Zynq 影象採集(五) 板端Linux下視訊TCP傳送 & Linux上位機QT視訊顯示

前面幾篇已經陸續講述了影象採集,傳輸,Linux系統搭建等,這一篇就講一下自制一個簡單的板端視訊傳送和Linux上位機視訊顯示客戶端。板端視訊傳送用Zedboard做視訊資料傳輸,我能想到的是兩條路,一條就是網口,一條就是USB,USB傳輸方式打算以後研究一下,用網口是比較熟

Python+opencv學習筆記之人臉視訊採集及實時檢測(樹莓派3B+下檢測)

實驗目標: 1.首先通過opencv程式設計寫一個可以呼叫攝像頭並且能將攝像頭捕捉到的內容進行儲存。 2.將視訊檔案傳送到我們的樹莓派上,然後再利用Python編寫程式對視訊進行人臉識別處理,最後將人臉識別後的視訊儲存。 3.對某一張圖片進行處理,讓其具有毛玻璃效果,並將處理後的圖片儲存。

videoInput視訊採集庫

描述 opencv中的VideoCapture在採集USB攝像頭影象時,讀入視訊慢,有可能會崩潰。github上有videoInput庫,可解決上述問題,直接在工程中包含了上面程式碼的其中兩個檔案VideoInput.cpp和VideoInput.h; 部分函式解釋 V

Android 實時視訊採集/編碼/傳輸/解碼/播放—方案調研

實時視訊流採集 方案一: 通過Android Camera拍攝預覽中設定setPreviewCallback實現onPreviewFrame介面,實時擷取每一幀視訊流資料 方案二: 通過Android的MediaRecorder,在SetoutputFile函式中繫

Opencv開發環境VS2017配置---USB攝像頭視訊採集

一、下載OpenCV3庫 (2)解壓縮安裝到 C盤根目錄下 二、開啟VS2017新建一個專案 配置【附加包含目錄】 新增附加庫Lib 設定依賴庫 opencv_world343.lib opencv_world343d.lib

VC++視訊採集的步驟

VC6.0視訊採集的步驟:1、插入攝像頭,安裝驅動 VCap2800 USB2.0 DRV(windows 7)或者Vcap2820 sdk,兩者依次嘗試注意:驅動有一下幾種,如果USB2.0 DRVB不成功!!可以換驅動VCap2820 sdk進行嘗試!!!2、G:\VC++視訊採集資料\U

視訊採集與運動檢測原始碼

#include <stdio.h> #include <cv.h> #include <cxcore.h> #include <highgui.h> int main( int argc, char** argv ) { //宣告IplImage指標

【視訊採集方案】

Android視訊採集,傳輸,編碼解碼的方案總結 ipcamera-for-android 伺服器 : Android手機充當伺服器,使用NanoHTTPD充當伺服器 客戶端 : 手機或者pc輸入http://server ip:

C#FFmpeg視訊採集與推送RTMP伺服器程式碼思路整理

C#視訊採集與推送RTMP伺服器程式碼思路整理:在看過FFmpeg後是否認為寫C#的視訊流採集和推送還是一頭霧水啊?深有此感。領導是C#的高手,說可以通過C或C++的程式碼直接複製貼上到C#工程然後進行適配程式碼就可以了,因為C#使用ffmpeg的類名和變數、方法等都與C保持

音視訊採集封裝到直播推流原理

上次好早之前也寫過一篇,隨著工作的深入對這塊知識又鞏固了一遍,算是一個重寫和擴充套件版 舊的總結跳轉,那麼有啥不同呢? 1. 介紹協議的優缺點以及怎麼選擇 2. 會介紹壓縮編碼的原理 3. 測試關注的質量指標 那麼基本框架其實是

音視訊採集封裝到直播推流的簡單原理

那麼今天要分享的主要是兩個內容,第一個是對硬體採集的資源怎麼做一個打包封裝,另一個是處理完成的資源如何直播,作為在日常業務測試線的一個業務邏輯擴充套件,純粹個人理解,所以不會有一些深入的講解,畢竟網上的文章夠多了。 直接用visio花了一張圖:

iOS直播技術分享-音視訊採集(一)

1、iOS直播技術的流程 直播技術的流程大致可以分為幾個步驟:資料採集、影象處理(實時濾鏡)、視訊編碼、封包、上傳、雲端(轉碼、錄製、分發)、直播播放器。 資料採集:通過攝像頭和麥克風獲得實時的音視訊資料;影象處理:將資料採集的輸入流進行實時濾鏡,得到我們美化之後的視訊幀;視訊編碼:編碼分

基於opencv的人臉視訊採集及實時檢測

目標: (1)在windows下使用opencv程式設計,用攝像頭採集一段人臉表情視訊和揮手手勢短視訊,並儲存下來; (2)在樹莓派上基於opencv(c/c++)完成對視訊中人臉的檢測, a)對檢測出的人臉畫一個矩形框或圓圈, b)對此人臉區域進行模糊處理。

iOS 音視訊採集 AVCaptureSession

在之前的文章中,對多媒體音視訊開發的經典流程做過一個簡單的介紹。在這篇文章中,將首先就音視訊從採集部分做一個例項的講解。首先以iOS平臺為例。 AVFoundation Apple 官方給我們提供了一個很大的一個集合框架 AVFoundation。A

用live555做本地視訊採集轉發,附原始碼

在分別做了基於live555與Darwin兩種開源伺服器的轉發伺服器後,不得不說Darwin確實在架構以及效能方面較live555略勝一籌,不過沒關係,以live555的更新速度,作者的負責,相信在客戶端開發以及ipC等方面會給大家帶來不少幫助,不羅嗦,今天

V4L2視訊採集應用原理

具體說明如下: (1)程式首先使用VIDIOC_REQBUFS向驅動程式請求影象緩衝區,v412_requestbuffers結構體包含了所要求緩衝區的型別及數量,但驅動程式有權決定最後返回的數量,因此程式仍需要使用系統返回的緩衝區數量,在這裡程式返回2個緩衝區。 (2)由於緩衝區數量有2個,呼叫2次mmap

windows下ffmpeg音視訊採集並推流【較亂,懶的整理了】

【大多為蒐集的文章,都歸類為,轉載。所以沒有標明,來處。】 1.windows下ffmpeg的編譯: 如:./configure --disable-yasm --enable-static --enable-indev=dshow 如果裝了yasm,x2

iOS GPUImage音視訊採集以及美顏功能

iOS GPUImage音視訊採集以及美顏功能 GPUImageStillCamera:用於拍攝當前手機的畫面, 並且儲存圖片 GPUImageVideoCamera:通常用於實時視訊的錄製 使用方法:GPUImageStillCame

iOS 音視訊採集以及寫入檔案(swift)

iOS音視訊採集以及寫入檔案(swift) 注意:配置允許訪問相機與麥克風參考這裡 1.初始化檔案屬性 class ViewController: UIViewController { fileprivate