[SLAM](番外篇):一起做RGB-D SLAM(3)

本文轉自高翔老師的部落格,建議在學完教程的第二講後,插入學習,做到工程快速入門。

原文連結:https://www.cnblogs.com/gaoxiang12/p/4659805.html

師兄:同學們大家好,又到我們每週一次的“一起做RGB-D SLAM”時間啦!大家還記得上週我們講了什麼東西嗎?

小蘿蔔:等一下師兄!我們的部落格什麼時候變成每週一更了?

師兄:這個,這不是因為終於到暑假了,我可以專門搞學術了嘛。

小蘿蔔:胡說!前兩天我還看到你在超市開挖掘機來著!

師兄:這事你就別提了啊……

小蘿蔔:我還有照片為證呢!

師兄:你能不能別提這個事了啊……我們趕緊開始講課吧。

小蘿蔔:師兄,那可是兒童專區啊,您可是個博士,自重啊!

上講回顧

在上一講中,我們介紹瞭如何把2D影象座標轉換為3D空間座標。然後,利用推導的數學公式,實現了把影象轉化為點雲的程式。在上一講的末尾,我們給出了一道作業題,希望讀者去把這兩件事做成一個函式庫,以供將來呼叫。不知道大家回去之後做了沒有呢?

小蘿蔔:讀者這麼勤奮肯定已經做好了啦!

師兄:嗯,所以呢,這一講裡面我們就要用到上面兩個函數了。在講解本講的內容之前,先介紹一下我們是如何封裝上節課程式碼的。在 程式碼根目錄/include 下,我們新建了一個 slamBase.h 檔案,存放上一講以及以後講到的各種函式:

include/slamBase.h:

1 /*************************************************************************

2 > File Name: rgbd-slam-tutorial-gx/part III/code/include/slamBase.h

3 > Author: xiang gao

4 > Mail: [email protected]

5 > Created Time: 2015年07月18日 星期六 15時14分22秒

6 > 說明:rgbd-slam教程所用到的基本函式(C風格)

7 ************************************************************************/

8 # pragma once

9

10 // 各種標頭檔案

11 // C++標準庫

12 #include <fstream>

13 #include <vector>

14 using namespace std;

15

16 // OpenCV

17 #include <opencv2/core/core.hpp>

18 #include <opencv2/highgui/highgui.hpp>

19

20 //PCL

21 #include <pcl/io/pcd_io.h>

22 #include <pcl/point_types.h>

23

24 // 型別定義

25 typedef pcl::PointXYZRGBA PointT;

26 typedef pcl::PointCloud<PointT> PointCloud;

27

28 // 相機內參結構

29 struct CAMERA_INTRINSIC_PARAMETERS

30 {

31 double cx, cy, fx, fy, scale;

32 };

33

34 // 函式介面

35 // image2PonitCloud 將rgb圖轉換為點雲

36 PointCloud::Ptr image2PointCloud( cv::Mat& rgb, cv::Mat& depth, CAMERA_INTRINSIC_PARAMETERS& camera );

37

38 // point2dTo3d 將單個點從影象座標轉換為空間座標

39 // input: 3維點Point3f (u,v,d)

40 cv::Point3f point2dTo3d( cv::Point3f& point, CAMERA_INTRINSIC_PARAMETERS& camera );可以看到,我們把相機引數封裝成了一個結構體,另外還聲明瞭 image2PointCloud 和 point2dTo3d 兩個函式。然後,在 src/ 目錄下新建 slamBase.cpp 檔案:

src/slamBase.cpp

1 /*************************************************************************

2 > File Name: src/slamBase.cpp

3 > Author: xiang gao

4 > Mail: [email protected]

5 > Implementation of slamBase.h

6 > Created Time: 2015年07月18日 星期六 15時31分49秒

7 ************************************************************************/

8

9 #include "slamBase.h"

10

11 PointCloud::Ptr image2PointCloud( cv::Mat& rgb, cv::Mat& depth, CAMERA_INTRINSIC_PARAMETERS& camera )

12 {

13 PointCloud::Ptr cloud ( new PointCloud );

14

15 for (int m = 0; m < depth.rows; m++)

16 for (int n=0; n < depth.cols; n++)

17 {

18 // 獲取深度圖中(m,n)處的值

19 ushort d = depth.ptr<ushort>(m)[n];

20 // d 可能沒有值,若如此,跳過此點

21 if (d == 0)

22 continue;

23 // d 存在值,則向點雲增加一個點

24 PointT p;

25

26 // 計算這個點的空間座標

27 p.z = double(d) / camera.scale;

28 p.x = (n - camera.cx) * p.z / camera.fx;

29 p.y = (m - camera.cy) * p.z / camera.fy;

30

31 // 從rgb影象中獲取它的顏色

32 // rgb是三通道的BGR格式圖,所以按下面的順序獲取顏色

33 p.b = rgb.ptr<uchar>(m)[n*3];

34 p.g = rgb.ptr<uchar>(m)[n*3+1];

35 p.r = rgb.ptr<uchar>(m)[n*3+2];

36

37 // 把p加入到點雲中

38 cloud->points.push_back( p );

39 }

40 // 設定並儲存點雲

41 cloud->height = 1;

42 cloud->width = cloud->points.size();

43 cloud->is_dense = false;

44

45 return cloud;

46 }

47

48 cv::Point3f point2dTo3d( cv::Point3f& point, CAMERA_INTRINSIC_PARAMETERS& camera )

49 {

50 cv::Point3f p; // 3D 點

51 p.z = double( point.z ) / camera.scale;

52 p.x = ( point.x - camera.cx) * p.z / camera.fx;

53 p.y = ( point.y - camera.cy) * p.z / camera.fy;

54 return p;

55 }最後,在 src/CMakeLists.txt 中加入以下幾行,將 slamBase.cpp 編譯成一個庫,供將來呼叫:

ADD_LIBRARY( slambase slamBase.cpp )

TARGET_LINK_LIBRARIES( slambase

${OpenCV_LIBS}

${PCL_LIBRARIES} )這兩句話是說,把slamBase.cpp編譯成 slamBase 庫,並把該庫裡調到的OpenCV和PCL的部分,和相應的庫連結起來。是不是感覺程式碼更有條理了呢?今後,我們會在每一講裡介紹新的內容,並把實現的程式碼封裝裡這個slamBase庫中。

影象配準 數學部分

SLAM是由“定位”(Localization)和“建圖”(Mapping)兩部分構成的。現在來看定位問題。要求解機器人的運動,首先要解決這樣一個問題:給定了兩個影象,如何知道影象的運動關係呢?

這個問題可以用基於特徵的方法(feature-based)或直接的方法(direct method)來解。雖說直接法已經有了一定的發展,但目前主流的方法還是基於特徵點的方式。在後者的方法中,首先你需要知道影象裡的“特徵”,以及這些特徵的一一對應關係。

假設我們有兩個幀:F1和F2. 並且,我們獲得了兩組一一對應的特徵點:

P={p1,p2,…,pN}∈F1

Q={q1,q2,…,qN}∈F2

. 其中pp和qq都是R3R3中的點。

我們的目的是求出一個旋轉矩陣RR和位移向量tt,使得:

∀i,pi=Rqi+t∀i;

然而實際當中由於誤差的存在,等號基本是不可能的。所以我們通過最小化一個誤差來求解R,t;

minR,t∑i=1N∥pi−(Rqi+t)∥2;

這個問題可以用經典的ICP演算法求解。其核心是奇異值分解(SVD)。我們將呼叫OpenCV中的函式求解此問題,所以在此就不細講ICP的具體步驟了。有興趣的讀者可以參閱1987年PAMI上的一篇文章,也是最原始的ICP方法:Least-squares fitting of two 3-D point sets。

那麼從這個數學問題上來講,我們的關鍵就是要獲取一組一一對應的空間點,這可以通過影象的特徵匹配來完成。

提示:由於OpenCV中沒有提供ICP,我們在實現中使用PnP進行求解。

影象配準 程式設計實現

本節中,我們要匹配兩對影象,並且計算它們的位移關係。它們分別是rgb1,png, rgb2.png, depth1.png, depth2.png. 人眼可以直觀地看到第二個圖是向左轉動了一些。

照例,我們先給出完整的程式程式碼。讀者可以先把程式碼瀏覽一遍,我們再加以詳細的解釋。因為本節的程式碼比較長,我把它摺疊起來,否則排版就太長了。

detectFeatures.cpp

detectFeatures.cpp

程式碼的解釋:

第一部分: 18行至52行,特徵的檢測與描述子的計算。

要在一個影象裡提取特徵,第一步是計算“關鍵點”,然後,針對這些關鍵點周圍的畫素,計算其“描述子”。在OpenCV中,分別由cv::FeatureDetector和cv::DescriptorExtractor來計算。

1 cv::Ptr<cv::FeatureDetector> _detector = cv::FeatureDetector::create( "SIFT" );

2 cv::Ptr<cv::DescriptorExtractor> _descriptor = cv:: DescriptorExtractor::create( "SIFT" );然後,使用 _detector->detect()函式提取關鍵點。值得一提的是,_detector和_descriptor的型別可以由字串指定。如果你想構建FAST, SURF等特徵,只需改後面的字串即可。

關鍵點是一種cv::KeyPoint的型別。你可以看它的API: http://docs.opencv.org/modules/features2d/doc/common_interfaces_of_feature_detectors.html?highlight=keypoint#KeyPoint 由於比較長我這裡就不貼了。可以看到,KeyPoint結構中帶有 Point2f pt 這個成員變數,指這個關鍵點的畫素座標。此外,有的關鍵點還有半徑、角度等引數,畫在圖裡就會像一個個的圓一樣。

有了一組KeyPoint之後,就可以呼叫:

1 _descriptor->compute( image, keypoint, descriptor )在 keypoint 上計算描述子。描述子是一個cv::Mat的矩陣結構,它的每一行代表一個對應於Keypoint的特徵向量。當兩個keypoint的描述子越相似,說明這兩個關鍵點也就越相似。我們正是通過這種相似性來檢測影象之間的運動的。

第二部分:特徵匹配(53行至88行)

接下來,我們對上述的描述子進行匹配。在OpenCV中,你需要選擇一個匹配演算法,例如粗暴式(bruteforce),近似最近鄰(Fast Library for Approximate Nearest Neighbour, FLANN)等等。這裡我們構建一個FLANN的匹配演算法:

1 vector< cv::DMatch > matches;

2 cv::FlannBasedMatcher matcher;

3 matcher.match( desp1, desp2, matches );匹配完成後,演算法會返回一些 DMatch 結構。該結構含有以下幾個成員:

- queryIdx 源特徵描述子的索引(也就是第一張影象)。

- trainIdx 目標特徵描述子的索引(第二個影象)

- distance 匹配距離,越大表示匹配越差。

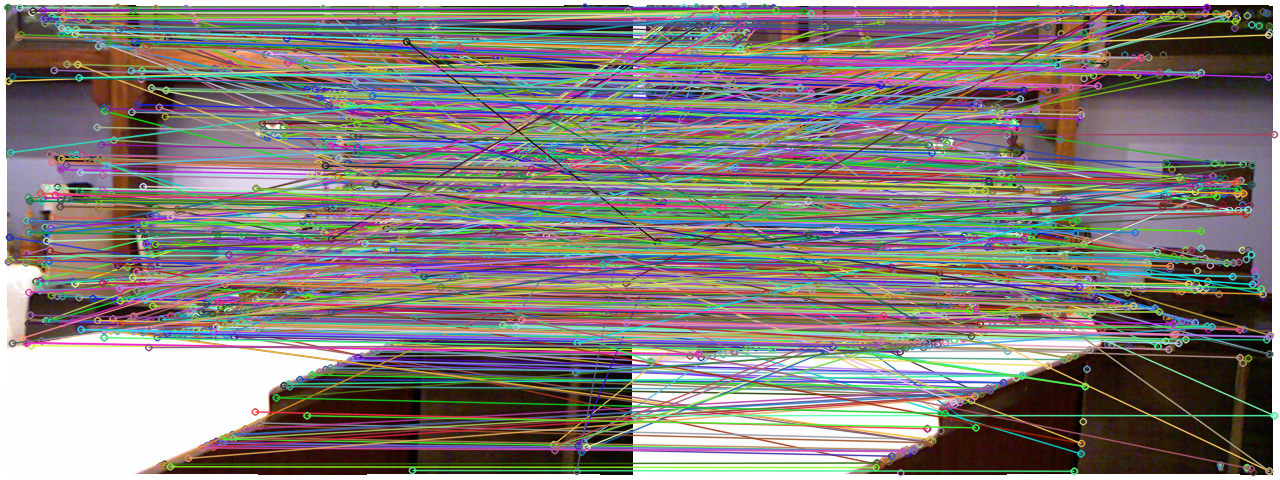

有了匹配後,可以用drawMatch函式畫出匹配的結果:

小蘿蔔:這真是“亂花漸欲迷人眼,淺草才能沒馬蹄”啊!

師兄:你不是機器人麼,怎麼開始變得文藝起來了?

不管如何說,僅靠描述子的匹配似乎是太多了些,把許多不相似的東西也匹配起來了。(由於這兩個影象只有水平旋轉,所以水平的匹配線才是對的,其他的都是誤匹配)。因此,需要篩選一下這些匹配,例如,把distance太大的給去掉(原始檔69到88行)。

篩選的準則是:去掉大於最小距離四倍的匹配。

小蘿蔔:為什麼是四倍呢?

師兄:這只是個經驗數值啦,就像你平時都買一斤半的棗糕呀,為什麼不買兩斤呢?

小蘿蔔:我喜歡吃棗糕!等這節講完我們去吃棗糕吧!

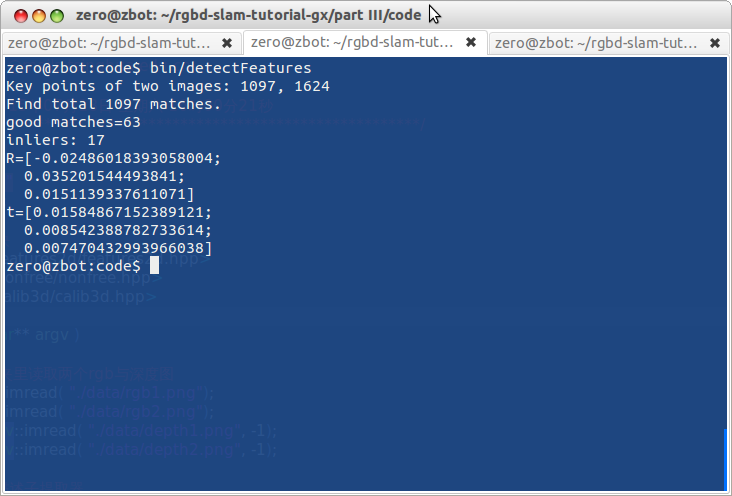

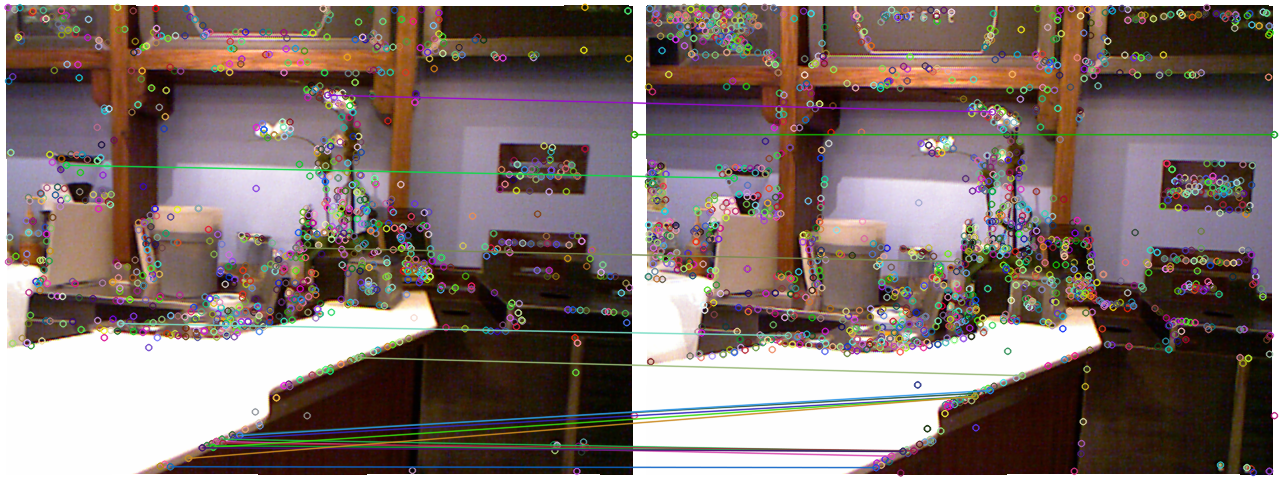

師兄:呃……總、總之,選出來的goodmatch大概是這樣的:

篩選之後,匹配就少了許多了,影象看起來也比較乾淨。

第三部分 求解PnP

求解PnP的核心是呼叫OpenCV裡的SolvePnPRansac函式。該函式的介面如下(來自OpenCV線上API):

C++: void solvePnPRansac(InputArray objectPoints, InputArray imagePoints, InputArray cameraMatrix, InputArray distCoeffs, OutputArray rvec, OutputArray tvec, bool useExtrinsicGuess=false, int iterationsCount=100, float reprojectionError=8.0, int minInliersCount=100, OutputArray inliers=noArray(), int flags=ITERATIVE )

Python: cv2.solvePnPRansac(objectPoints, imagePoints, cameraMatrix, distCoeffs[, rvec[, tvec[, useExtrinsicGuess[, iterationsCount[, reprojectionError[, minInliersCount[, inliers[, flags]]]]]]]]) → rvec, tvec, inliers

| Parameters: |

|

|---|

可以看到,這個函式需要輸入一組匹配好的三維點: objectPoints 和一組二維影象點: imagePoints. 返回的結果是旋轉向量 rvec 和平移向量tvec。其他的都是演算法中的引數。因此,我們需要想辦法構建這兩組輸入點,它們實際上就是從goodmatches裡抽取來的。

由於我們已經提取了KeyPoint,知道了它們的畫素座標。那麼,利用上一節提供的庫函式,就可以直接轉到三維點啦。程式碼如下:(因為很重要就又貼了一遍)

1 // 計算影象間的運動關係

2 // 關鍵函式:cv::solvePnPRansac()

3 // 為呼叫此函式準備必要的引數

4

5 // 第一個幀的三維點

6 vector<cv::Point3f> pts_obj;

7 // 第二個幀的影象點

8 vector< cv::Point2f > pts_img;

9

10 // 相機內參

11 CAMERA_INTRINSIC_PARAMETERS C;

12 C.cx = 325.5;

13 C.cy = 253.5;

14 C.fx = 518.0;

15 C.fy = 519.0;

16 C.scale = 1000.0;

17

18 for (size_t i=0; i<goodMatches.size(); i++)

19 {

20 // query 是第一個, train 是第二個

21 cv::Point2f p = kp1[goodMatches[i].queryIdx].pt;

22 // 獲取d是要小心!x是向右的,y是向下的,所以y才是行,x是列!

23 ushort d = depth1.ptr<ushort>( int(p.y) )[ int(p.x) ];

24 if (d == 0)

25 continue;

26 pts_img.push_back( cv::Point2f( kp2[goodMatches[i].trainIdx].pt ) );

27

28 // 將(u,v,d)轉成(x,y,z)

29 cv::Point3f pt ( p.x, p.y, d );

30 cv::Point3f pd = point2dTo3d( pt, C );

31 pts_obj.push_back( pd );

32 }

33

34 double camera_matrix_data[3][3] = {

35 {C.fx, 0, C.cx},

36 {0, C.fy, C.cy},

37 {0, 0, 1}

38 };

39

40 // 構建相機矩陣

41 cv::Mat cameraMatrix( 3, 3, CV_64F, camera_matrix_data );

42 cv::Mat rvec, tvec, inliers;

43 // 求解pnp

44 cv::solvePnPRansac( pts_obj, pts_img, cameraMatrix, cv::Mat(), rvec, tvec, false, 100, 1.0, 100, inliers );求解完成後,rvec和tvec就含有了位移和旋轉的資訊,至此,我們已經成功地計算出兩個影象的運動啦!

小蘿蔔:對了,那個Ransac和inlier是什麼呢?

師兄:儘管經過了篩選,我們提供的匹配裡還是存在誤匹配的情況。根據誤匹配計算運動是不靠譜的。這時該怎麼辦呢?OpenCV會利用一種“隨機取樣一致性”(Random Sample Consensus)的思路(見https://en.wikipedia.org/wiki/RANSAC)。意思即為,在現有的匹配中隨機取一部分,估計其運動。因為正確的匹配結果肯定是相似的,而誤匹配的結果肯定滿天亂飛。只要把收斂的結果取出來即可。

小蘿蔔:這個就叫做“幸福的家庭都是相似的,不幸的家庭各有各的不幸”吧。

師兄:你這樣理解也可以。ransac適用於資料噪聲比較大的場合。這對影象的inlier大概是這樣的:

小蘿蔔:似乎仍有一些誤差的樣子呢。

師兄:是的,不過可以通過調節我們之前的篩選過程以及之後的ransac引數,得到更好的結果。

本節回顧

本節中,我們介紹瞭如何提取、匹配影象的特徵,並通過這些匹配,使用ransac方法估計影象的運動。下一節,我們將介紹如何使用剛得到的平移、旋轉向量來拼接點雲。至此,我們就完成了一個只有兩幀的迷你SLAM程式。

課後作業:

- 請把計算影象運動資訊封裝成一個函式,放進slamBase庫中。

- 由於我們的程式變複雜了,出現了一些內部的引數,如特徵點型別,篩選準則,ransac引數等等。如果我們把這些引數值定義在原始碼裡,那麼每修改一次,就要重新編譯一遍程式。這非常麻煩。所以,我們希望把引數定義在外部檔案中,在程式剛開始時讀取此檔案。這樣一來,只要更改此檔案即可完成引數的調節,不必重新編譯程式了。因此,請你完成一個讀取引數的類,放進slamBase中。

小蘿蔔:這一講比前兩節難好多啊,師兄。

師兄:是啊,然而我也不得不講這些東西,不然講不清楚呢。

小蘿蔔:嗯,那我回去好好複習啦。大家也要加油!

.

.![(k_1, k_2, p_1, p_2[, k_3[, k_4, k_5, k_6]])](http://docs.opencv.org/_images/math/94288b7709d10a7ddf286e33db0074512bda0411.png) of 4, 5, or 8 elements. If the vector is NULL/empty, the zero distortion coefficients are assumed.

of 4, 5, or 8 elements. If the vector is NULL/empty, the zero distortion coefficients are assumed.