Ng深度學習課程-第三週筆記摘要

淺層神經網路:

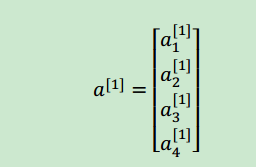

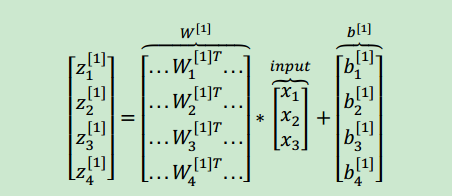

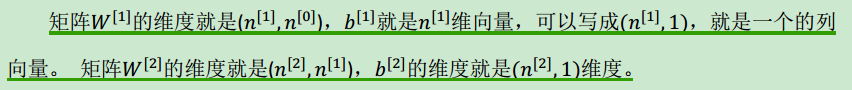

一般地,輸入層不算在總層數內。只考慮隱藏層和輸出層的層數。

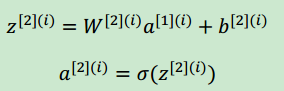

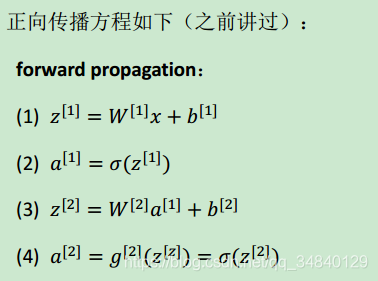

這個是當輸入是單一的訓練樣本時的計算過程,程式設計實現時也只是這四行程式碼。接下來是針對多個訓練樣本。

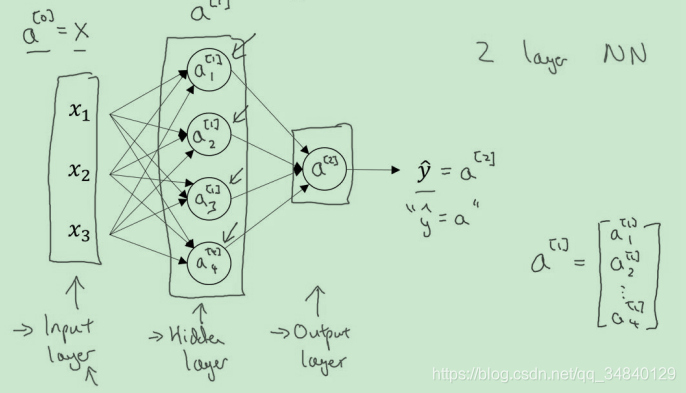

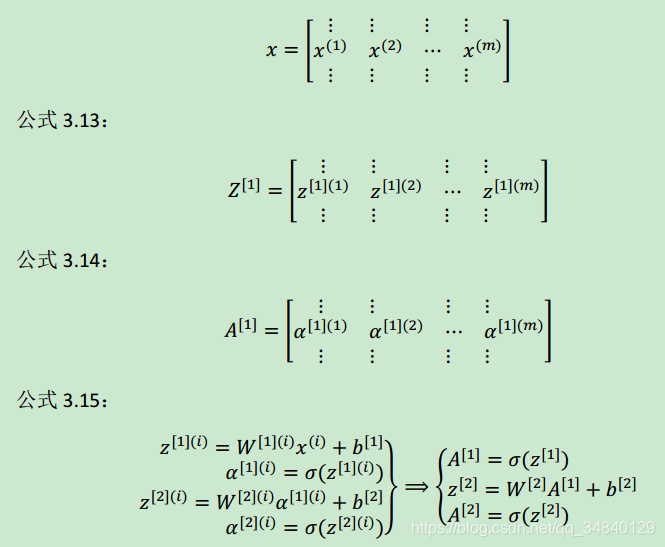

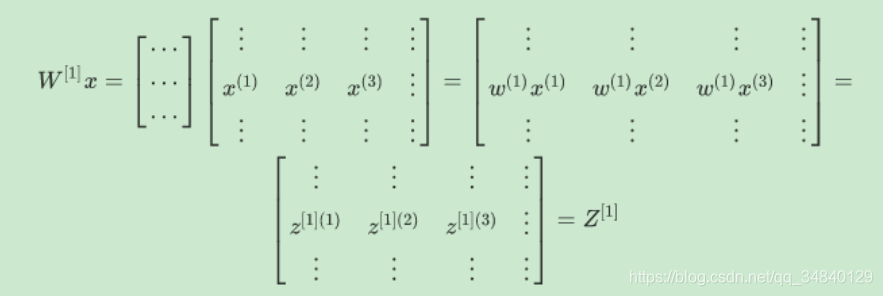

![]() 即是在原來單列的基礎上,再向後增加一列,每增加一個訓練樣本,就在a的後面增加對應的一列。

即是在原來單列的基礎上,再向後增加一列,每增加一個訓練樣本,就在a的後面增加對應的一列。

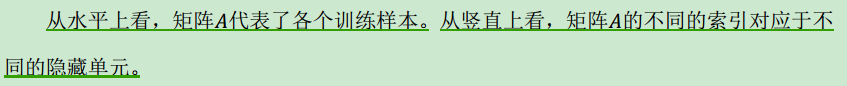

垂直索引對應於神經網路中不同的節點,而水平索引對應於不同的訓練樣本。

![]()

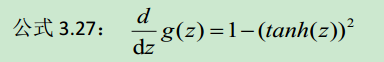

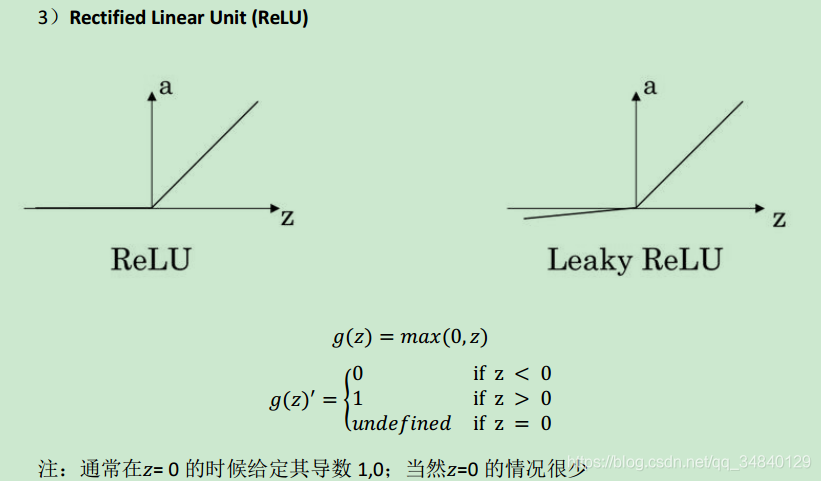

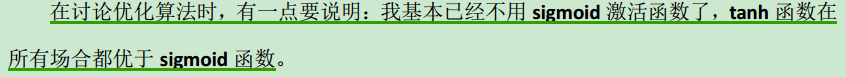

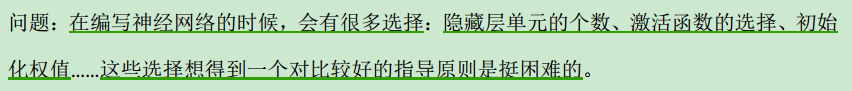

啟用函式

![]()

相關推薦

Ng深度學習課程-第三週筆記摘要

淺層神經網路: 一般地,輸入層不算在總層數內。只考慮隱藏層和輸出層的層數。 這個是當輸入是單一的訓練樣本時的計算過程,程式設計實現時也只是這四行程式碼。接下來是針對多個訓練樣本。 即是在原來單列的基礎上,再向後增加一列,每增

Ng深度學習課程-第三課第二週筆記摘要

進行誤差分析 清除標註錯誤的資料 快速搭建你的第一個系統,並進行迭代 使用來自不同分佈的資料進行訓練和測試 資料分佈不匹配時的偏差與方差的分析

Ng深度學習課程-第三課第一週筆記摘要

第一週 機器學習(ML)策略 滿足和優化指標(Satisficing and optimizing metrics) 訓練/開發/測試集劃分 什麼時候該改變開發/測試集和

Ng深度學習課程-第四課第三週筆記摘要

目標檢測 目標定位 &n

Ng深度學習課程-第四課第一週筆記摘要

卷積神經網路 邊緣檢測 padding 卷積步長 三維卷積 池化層 卷積神經網路

Ng深度學習課程-第五課第一週筆記摘要

序列模型 迴圈神經網路模型 不同型別的迴圈神經網路 語言模型和序列生成 對新序列取樣

Ng深度學習課程-第四課第二週筆記摘要

深度卷積網路:例項探究 為什麼要進行例項探究? 經典網路 殘差網路(ResNets)(Residual Networks (ResNets))

Ng深度學習課程-第四課第四周筆記摘要

人臉識別 One-Shot 學習 Siamese 網路 Triplet 損失 人臉驗證與二分類 風格遷移的代價函式

Coursera 吳恩達《神經網路與深度學習》第三週程式設計作業

# Package imports import numpy as np import matplotlib.pyplot as plt from testCases import * import sklearn import sklearn.datasets impo

Ng深度學習課程-第二課第二週筆記摘要

Mini-batch 梯度下降 指數加權平均數 指數加權平均的偏差修正 動量梯度下降法(Gradient descent with Momentum)

Ng深度學習課程-第二課第一週筆記摘要

深 度 學 習 的 實 踐 層 面

Ng深度學習課程-第二章筆記摘要

計算機中為了儲存一張圖片,需要儲存三個矩陣,它們分別對應圖片中的紅、綠、藍三種顏色通道。如果你的圖片大小為 64x64 畫素,那麼就有三個規模為 64x64 的矩陣,分別對應圖片中紅、綠、藍三種畫素的強度值。為了把這些畫素值放到一個特徵向量

斯坦福深度學習課程cs231n assignment1作業筆記三:softmax實現相關

任務 實現向量化的損失函式 實現向量化的梯度計算 分析梯度與數值梯度的驗證 使用驗證集來選擇超引數 使用SGD優化方法 視覺化權重 理論知識 softmax損失函式 令W為權重矩陣,大小為D×C;x為輸入,大小為1×D;b為偏置項,大小為1×C。那麼模型的輸

Operations on word vectors-v2 吳恩達老師深度學習課程第五課第二週程式設計作業1

吳恩達老師深度學習課程第五課(RNN)第二週程式設計作業1, 包含答案 Operations on word vectors Welcome to your first assignment of this week! Because word embe

coursera機器學習課程第六週——課程筆記

本週的內容主要分為兩部分,第一部分:主要內容是偏差、方差以及學習曲線相關的診斷方法,為改善機器學習演算法的決策提供依據;第二部分:主要內容是機器學習演算法的錯誤分析以及數值評估標準:準

coursera機器學習課程第五週——課程筆記

第五週課程學習結束,一直都是邊上課邊做筆記(紙質),沒有想過在這裡再梳理一遍然後將筆記整理出來,考慮之後覺得這一步很重要,可以藉此對學過的這一週所有知識做一個梳理,方便自己更好的理解這些知識,而且這

python系統學習:第三週之簡單的三級選單

# 三級目錄info = { # 一級 'ShanXi': { # 二級 'JieXiu': { # 三級 'XiaoSongQv': ['Burn here!'], 'SanSchool': ['Stu

python系統學習:第三週之函式

# 函式:如果某個程式中部分程式碼重複使用率較高,可以將其封裝起來,用到的時候就可以去呼叫這個包,這就叫函式# ----------------------第一部分-------------------------# 定義def sayhi(): print("hello word!")# 呼叫sayh

斯坦福深度學習課程cs231n assignment2作業筆記四:Fully-Connected Neural Nets

在有引導的情況下,發現具體實現和相關原理並不難。可是在學習這個課程之前,這些知識點對於博主來說都是不想去理解的理論知識,更沒想過手動實現。不得不說,大牛的課程就是牛啊。跟著走了一遍之後,以前感覺底層的東西都理解的很透徹。 本部落格只貼出程式碼,給大家自己編寫時有

《Python深度學習》——第三章 神經網路入門

主要內容: 神經網路核心元件 Keras簡介 建立深度學習工作站——Jupter 使用深度學習解決二分類,多分類和迴歸問題 3.1 神經網路剖析 層,多層構成網路 輸入函式和目標 損失函式 優化器 3.1.1 層:基本元件 權重 2D張量,用密集連