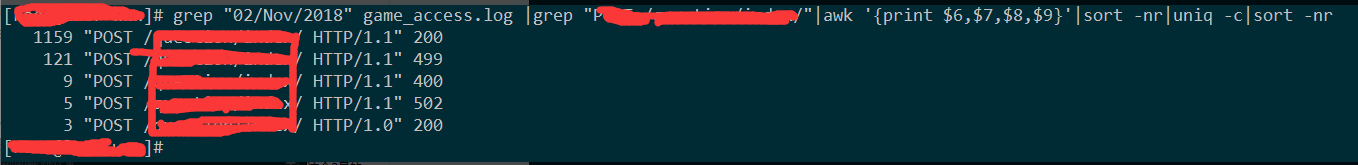

nginx日誌分析之 grep、awk、sort、uniq命令使用

阿新 • • 發佈:2018-12-08

nginx日誌分析對於線上業務排錯有很大的幫助,運用合適的命令能夠快速、準確定位出問題。主要涉及awk、sort、uniq這三個命令的使用。

sort 參 數: -b 忽略每行前面開始出的空格字元。 -c 檢查檔案是否已經按照順序排序。 -d 排序時,處理英文字母、數字及空格字元外,忽略其他的字元。 -f 排序時,將小寫字母視為大寫字母。 -i 排序時,除了040至176之間的ASCII字元外,忽略其他的字元。 -m 將幾個排序好的檔案進行合併。 -M 將前面3個字母依照月份的縮寫進行排序。 -n 依照數值的大小排序。 -o<輸出檔案> 將排序後的結果存入指定的檔案。 -r 以相反的順序來排序。 -t<分隔字元> 指定排序時所用的欄位分隔字元。 +<起始欄位>-<結束欄位> 以指定的欄位來排序,範圍由起始欄位到結束欄位的前一欄位。 --help 顯示幫助。 --version 顯示版本資訊

[[email protected] ~]# uniq [-icu]

選項與引數:

-i :忽略大小寫字元的不同;

-c :進行計數

-u :只顯示唯一的行