spark剖析原理圖

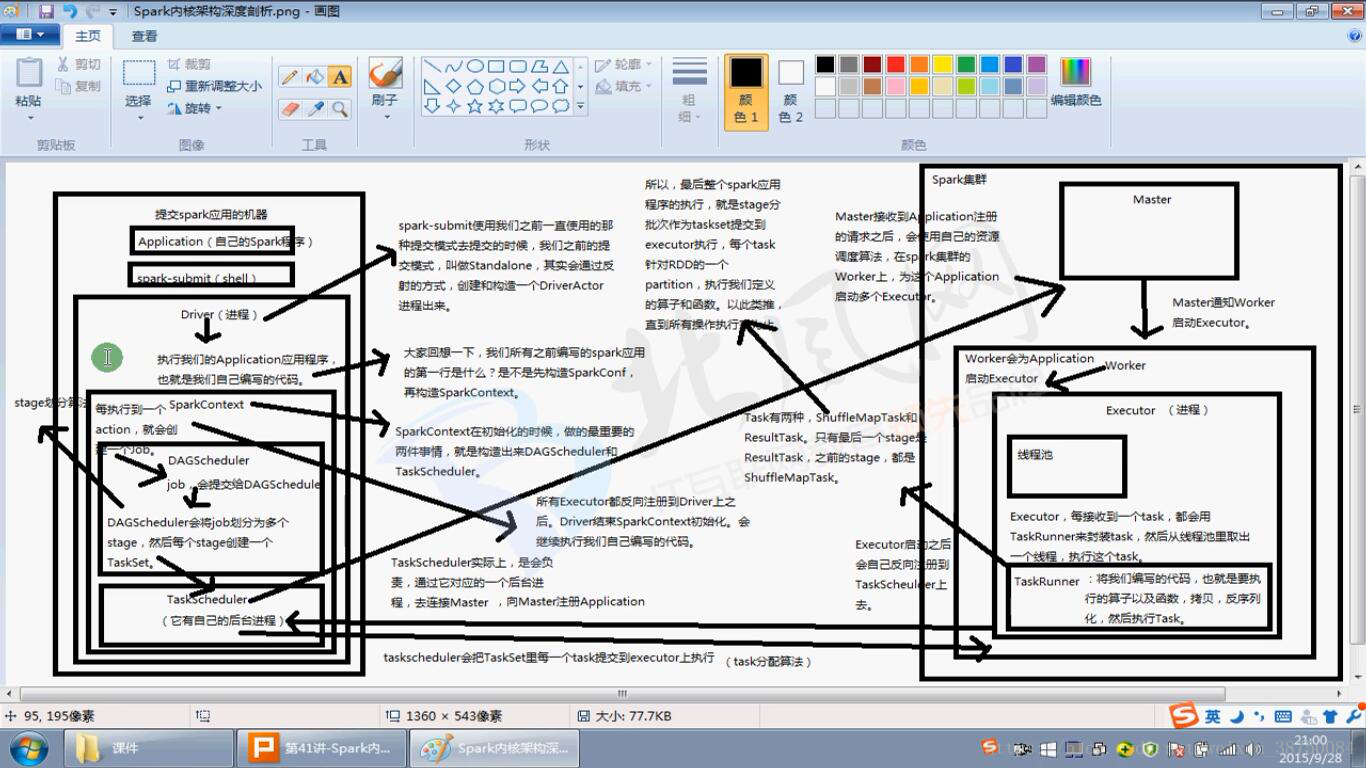

1.spark核心架構深度剖析:

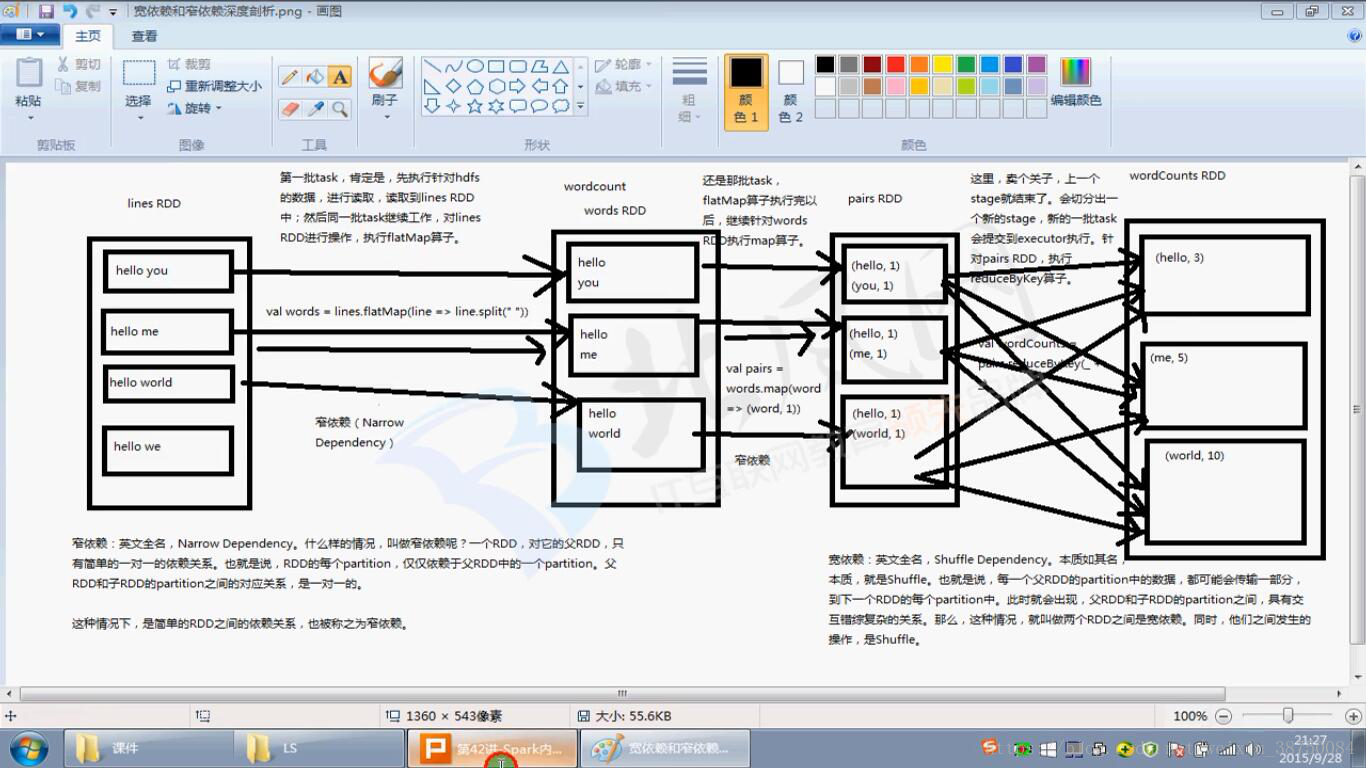

2.寬依賴窄依賴深度剖析:

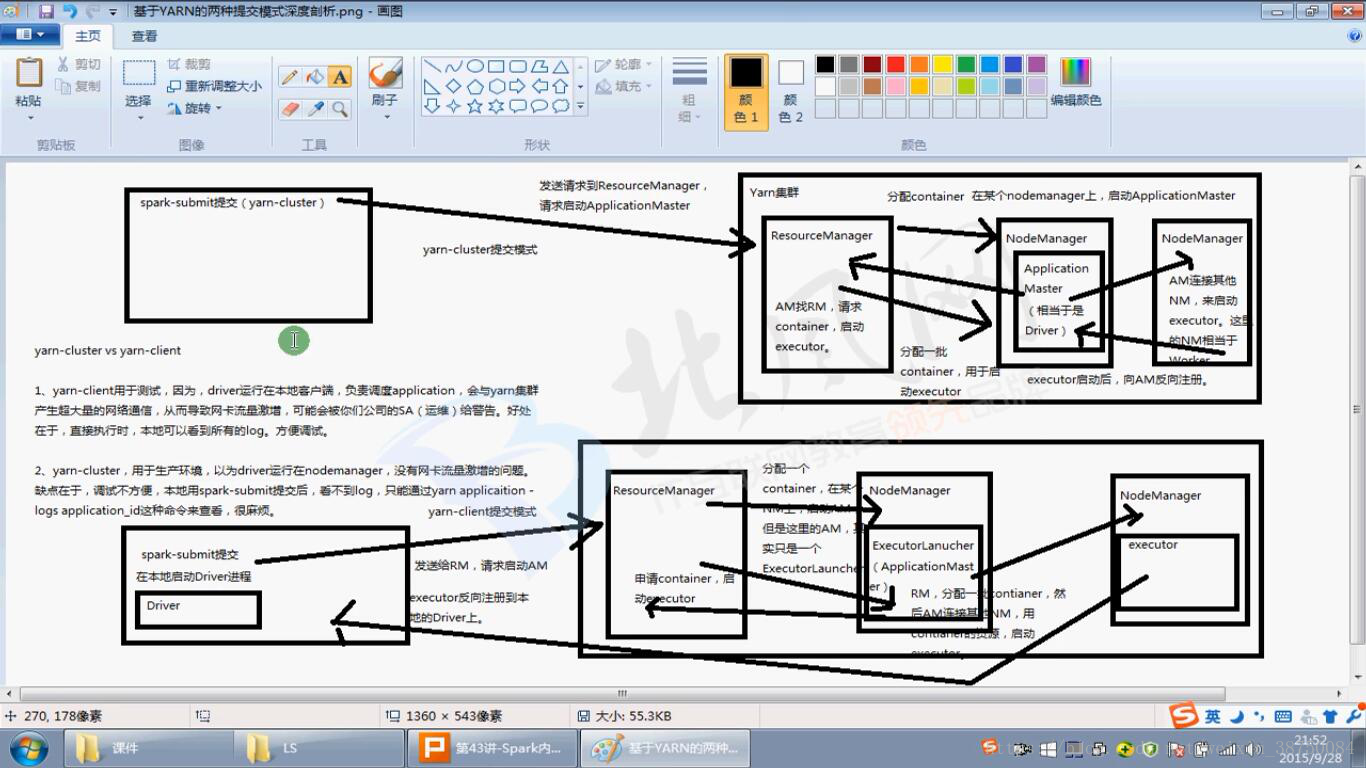

3.基於yarn兩種提交模式深度剖析:

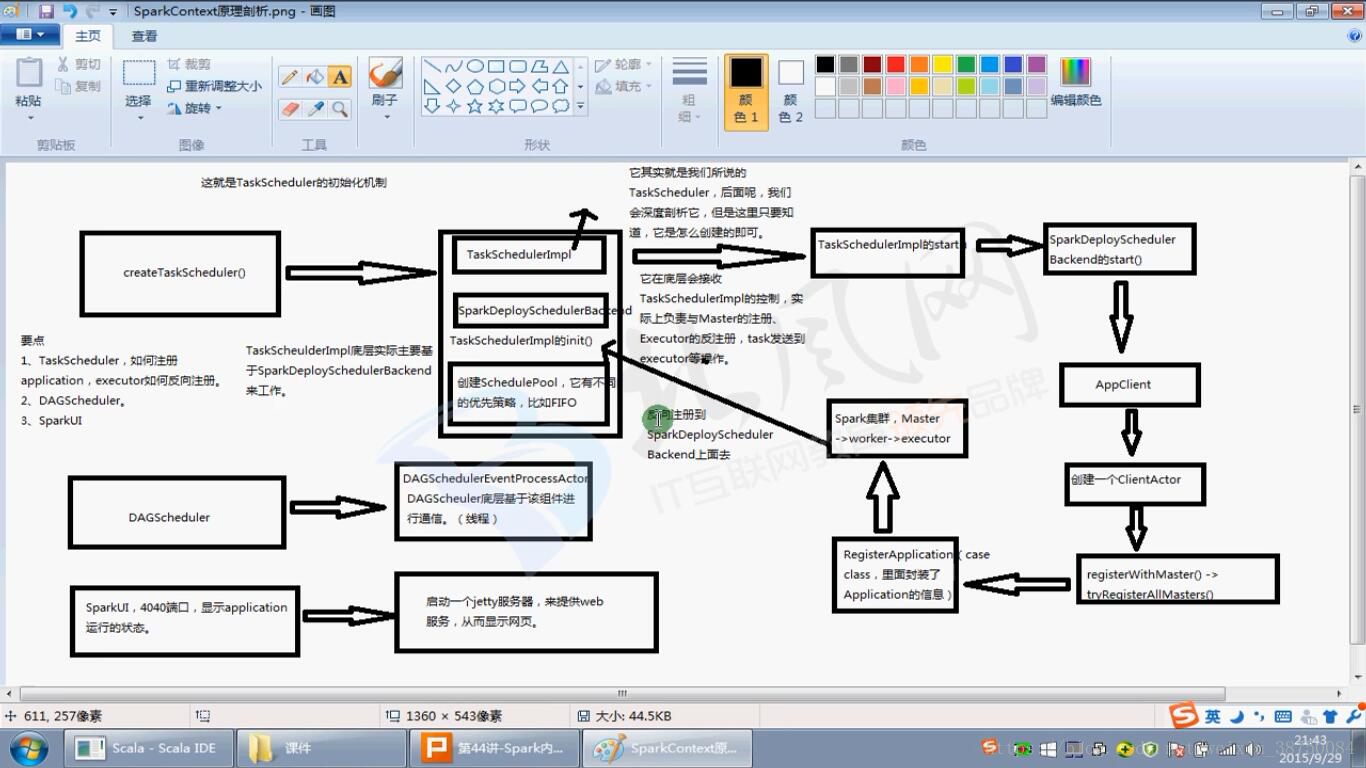

4.SparkContext 原理剖析:

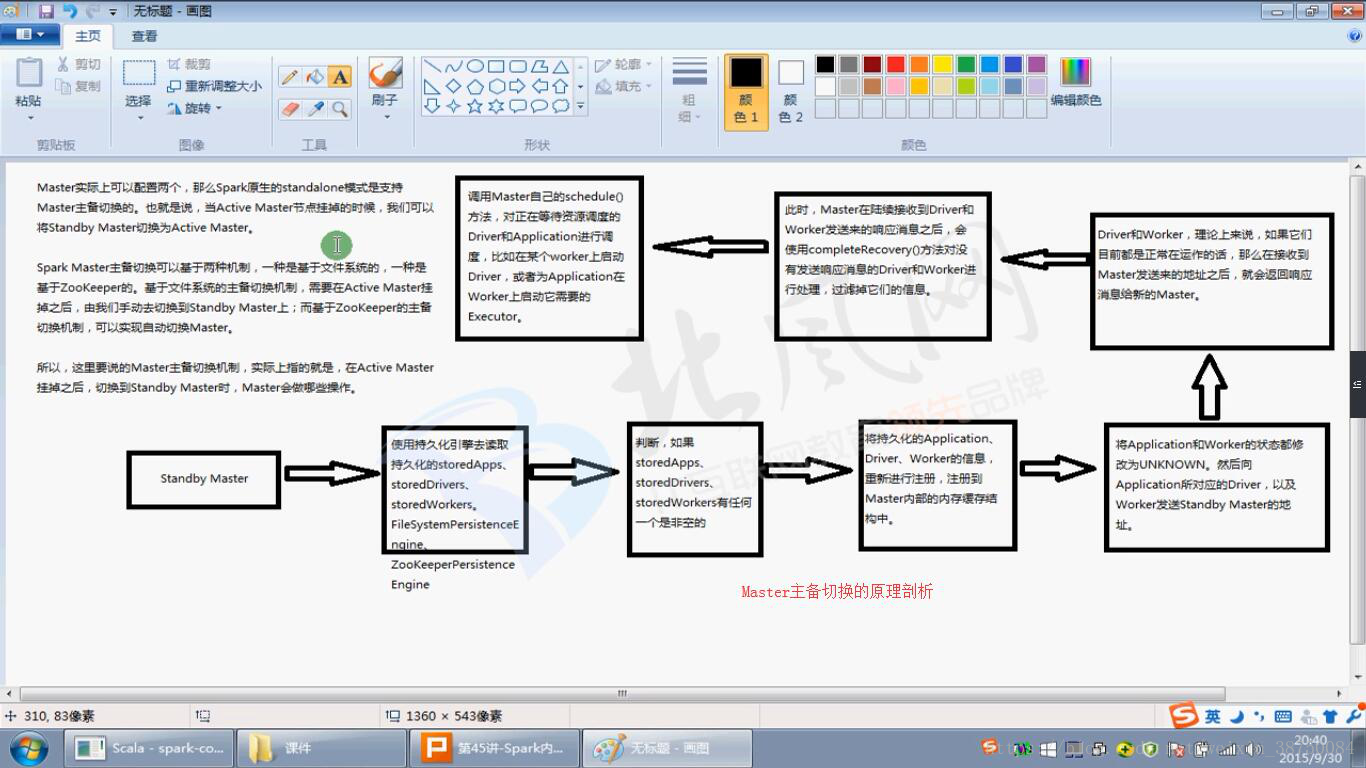

5.Master 主備切換的原理剖析:

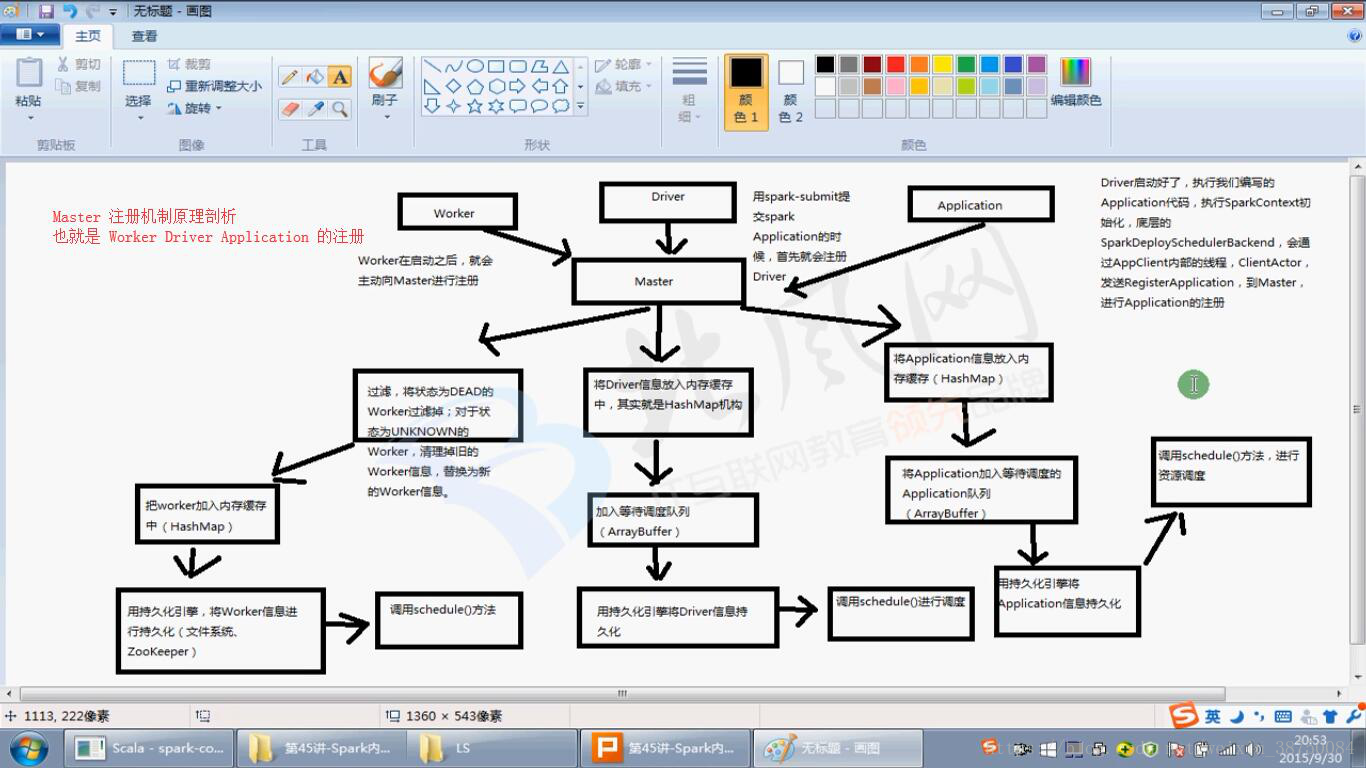

6.Master 註冊機制原理剖析:

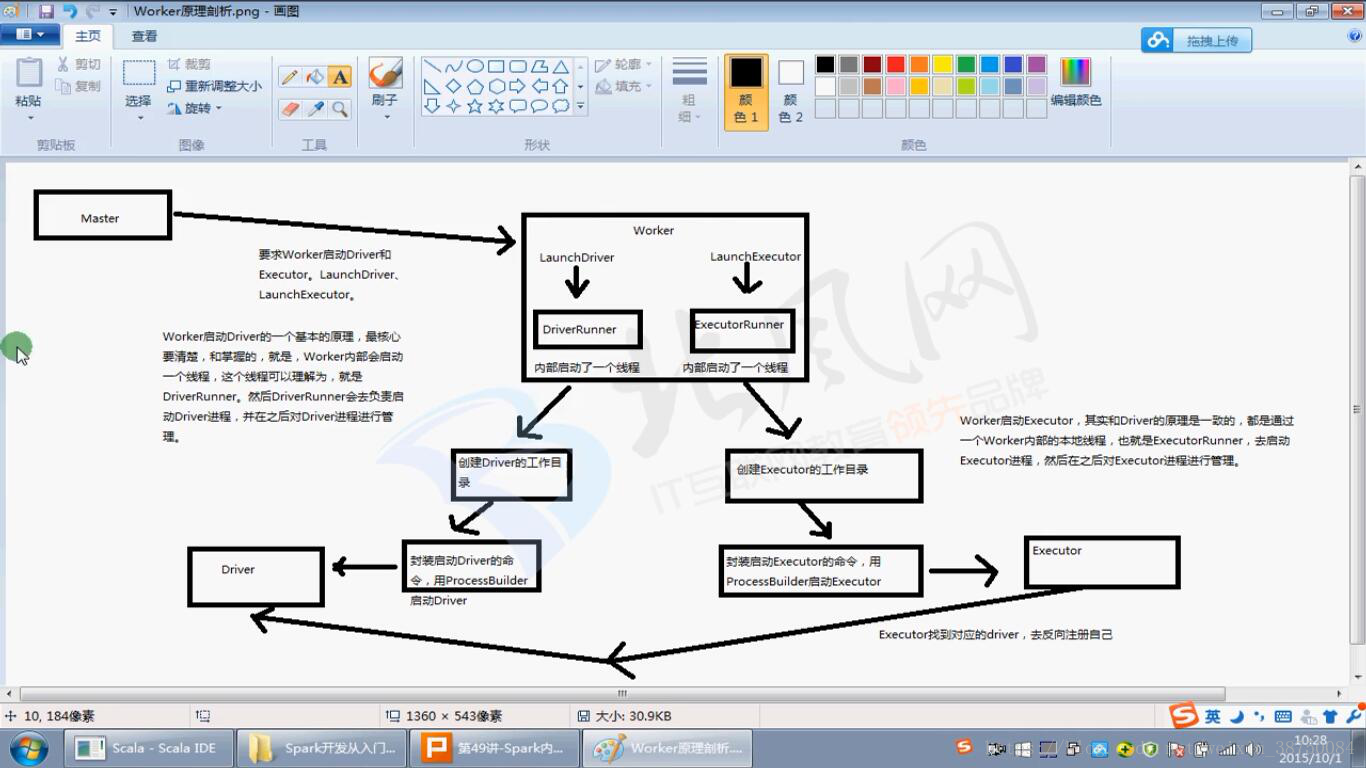

7.Worker 原理剖析:

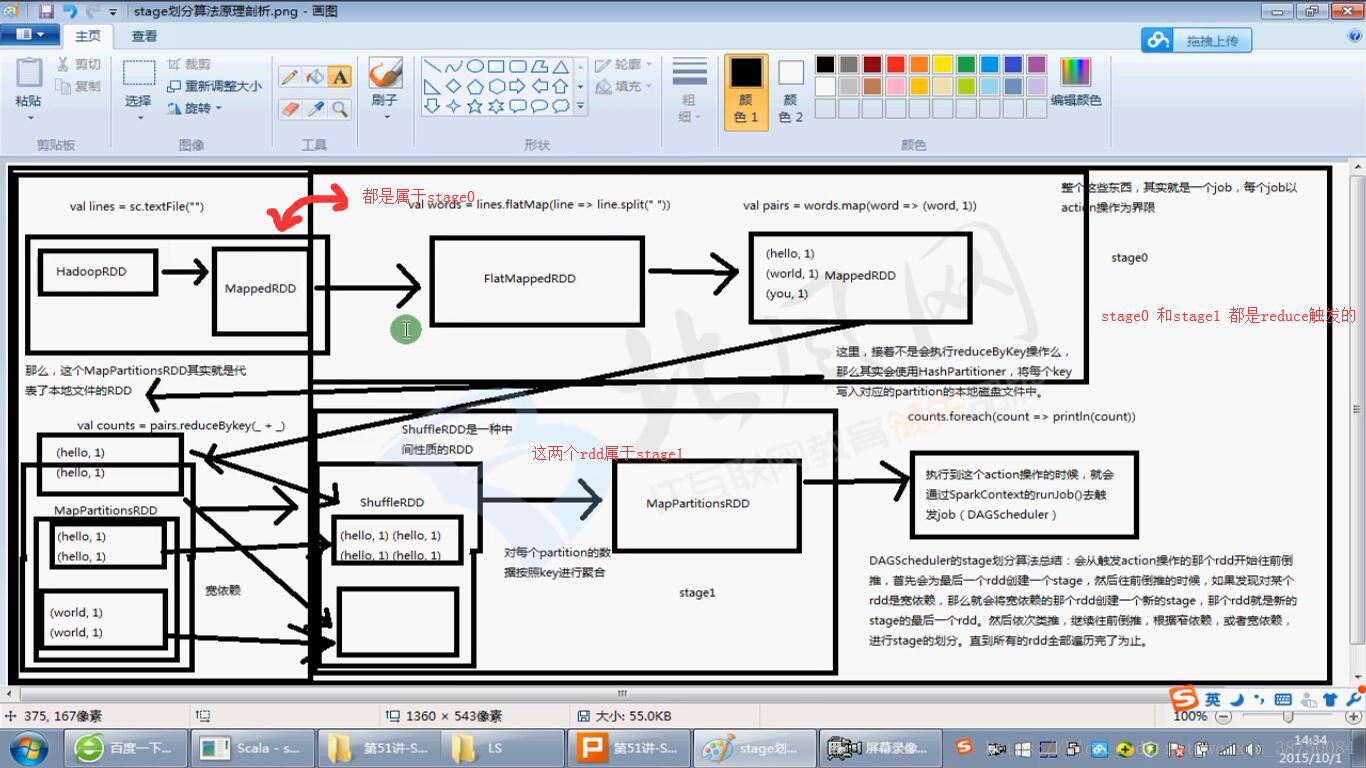

8.stage劃分演算法原理剖析

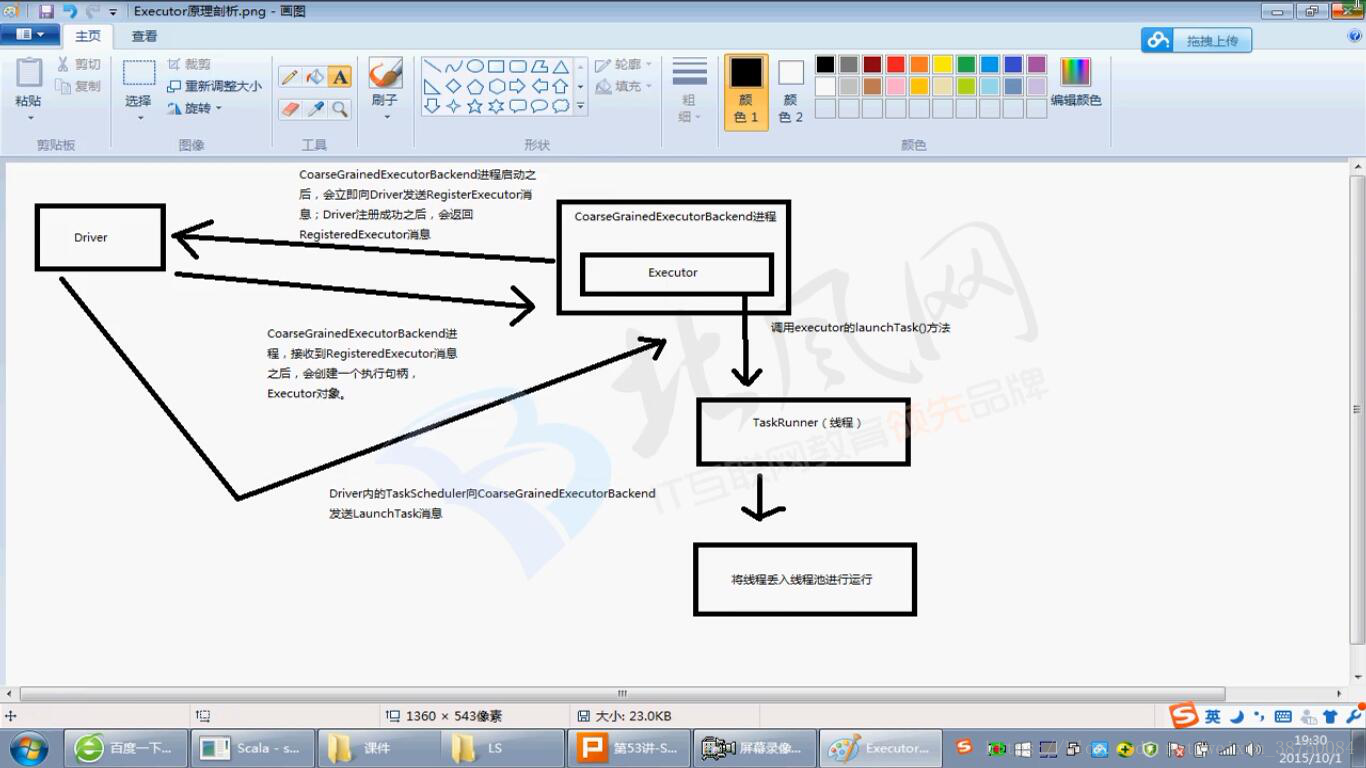

9.executor 原理剖析:

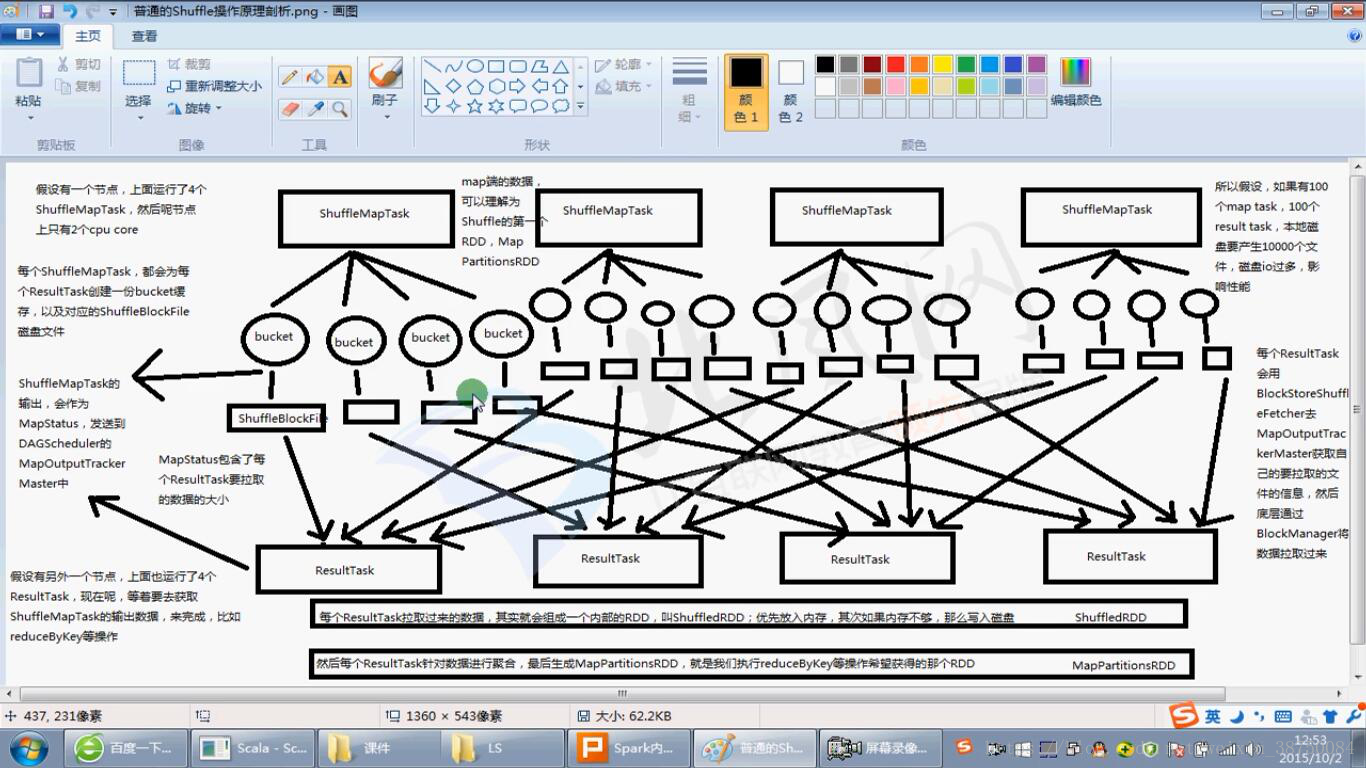

10.普通的shuffle操作原理剖析:

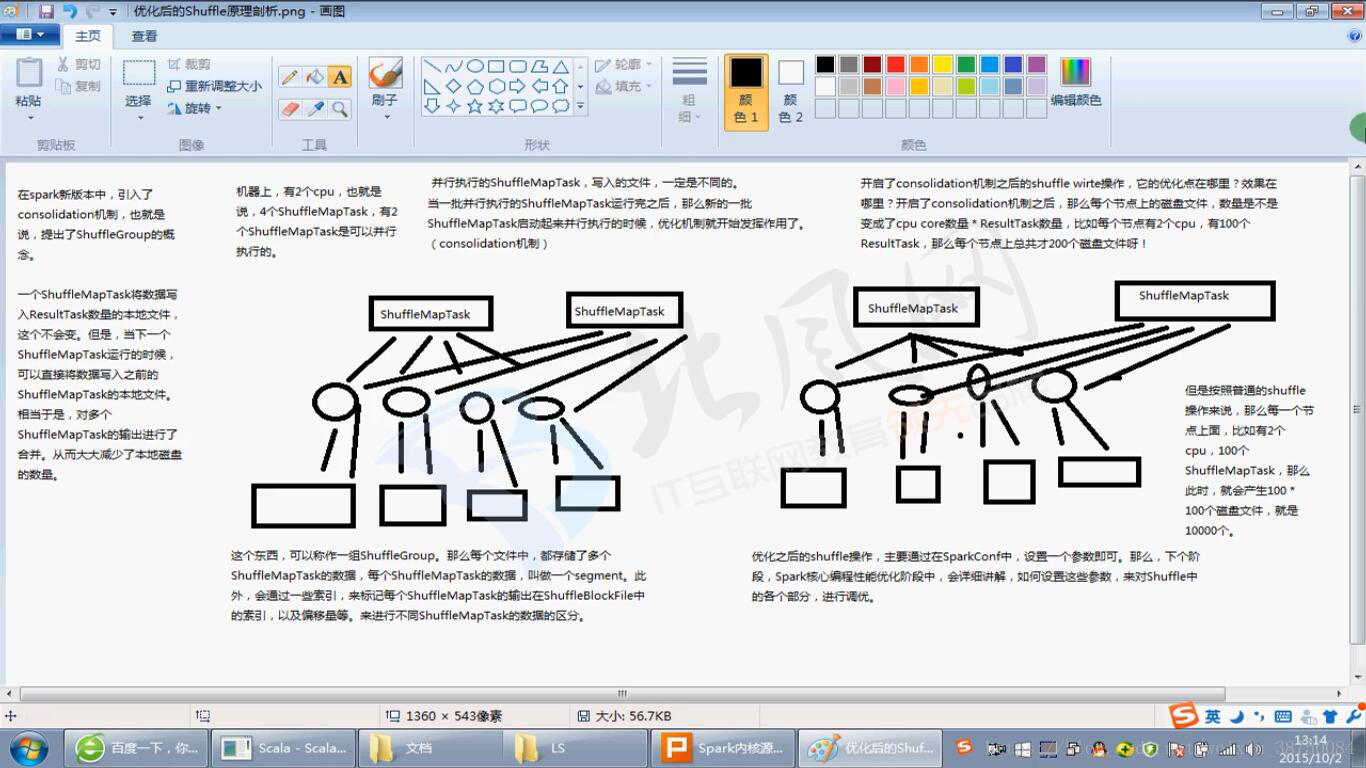

11.優化後的shuffle原理剖析:

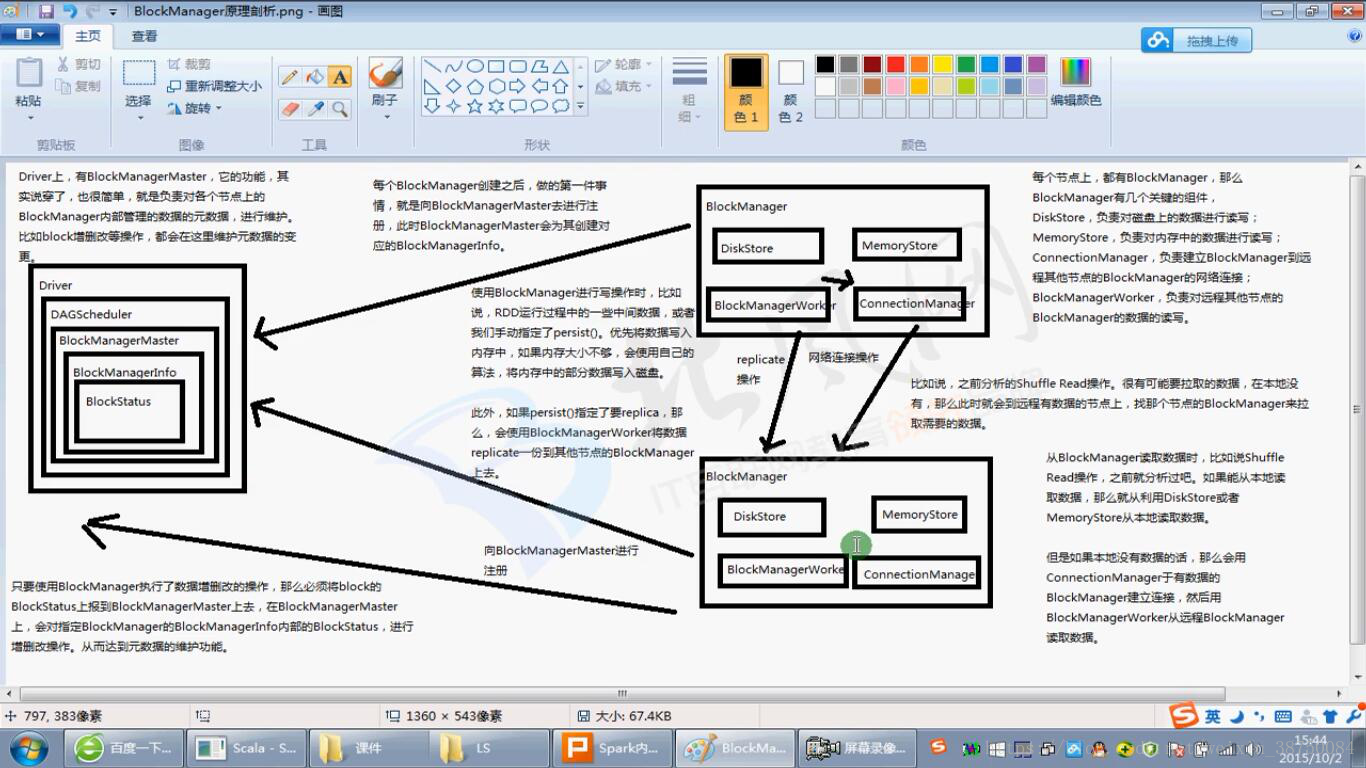

12.Block Manager 原理剖析:

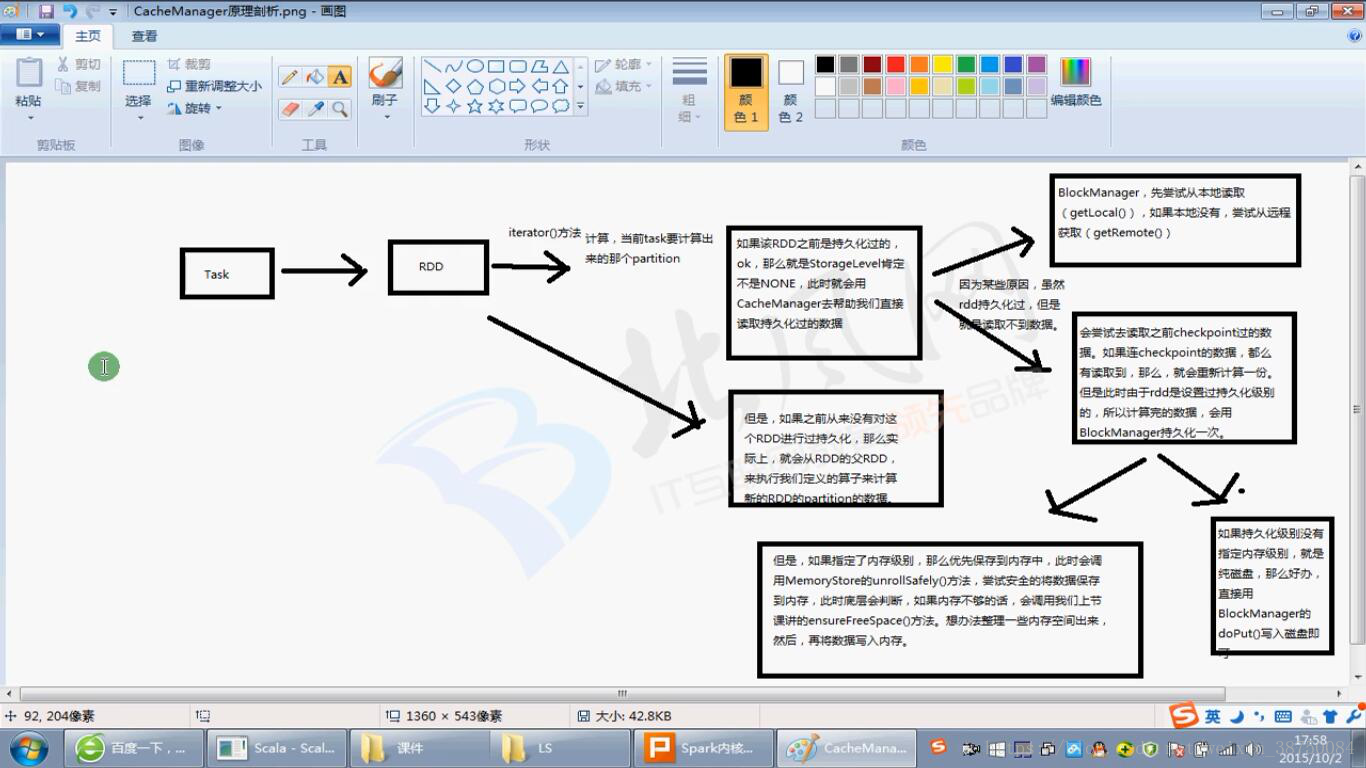

13.CacheManager 原理剖析:

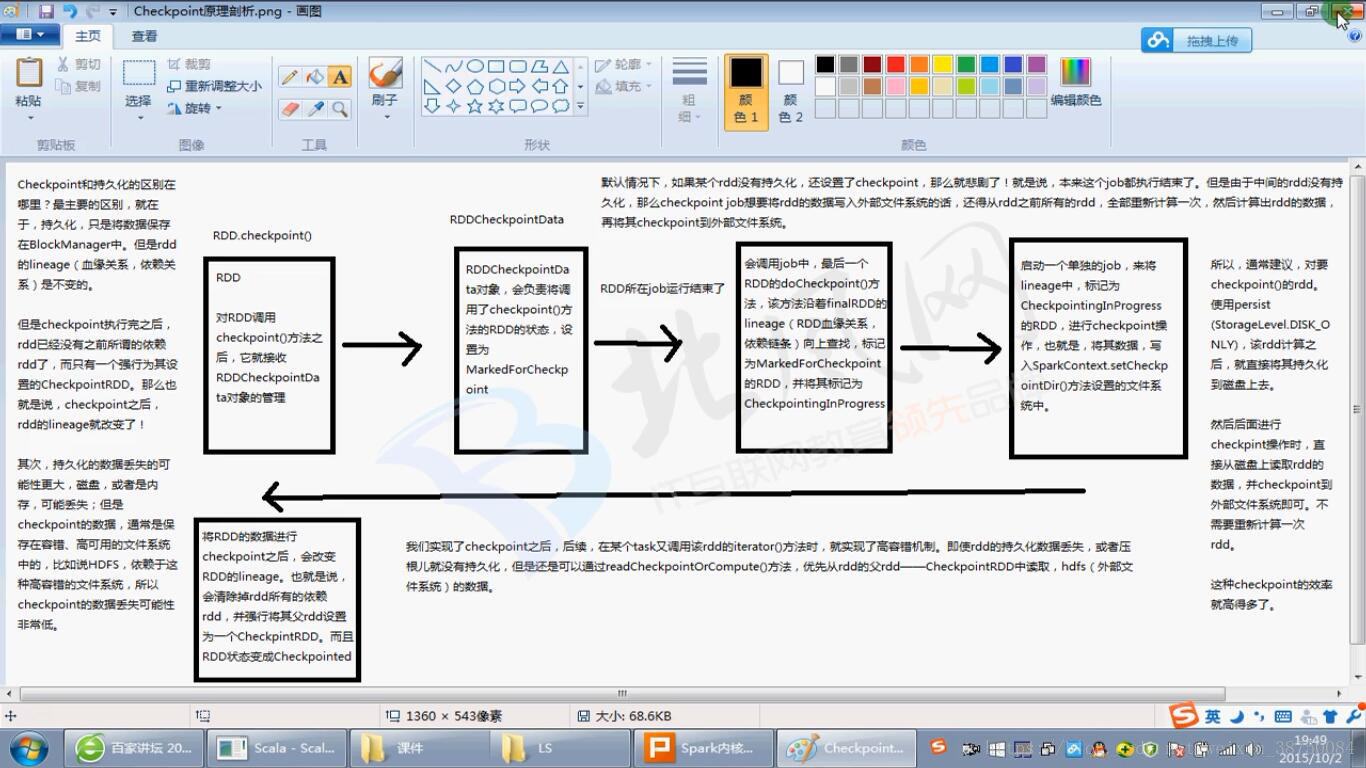

14.Checkpoint原理剖析:

圖片截圖來自北風網視訊資料。

相關推薦

spark剖析原理圖

1.spark核心架構深度剖析: 2.寬依賴窄依賴深度剖析: 3.基於yarn兩種提交模式深度剖析: 4.SparkContext 原理剖析: 5.Master 主備切換的原

Spark Executor內幕徹底解密:Executor工作原理圖、ExecutorBackend註冊源碼解密、Executor實例化內幕、Executor具體工作內幕

ID 註冊 AD https ima .cn ora 成員 其他 本課主題 Spark Executor 工作原理圖 ExecutorBackend 註冊源碼鑒賞和 Executor 實例化內幕 Executor 具體是如何工作的 Spark Executor 工作

課時17 第三課Spark內部原理剖析與原始碼閱讀(五)

為何spark shuffle比mapreduce shuffle慢? 主要是spark shuffle的shuffle read階段還不夠優秀,它是基於hashmap實現的,shuffle read會把shuffel write階段已經排序資料給重新轉成亂序的,轉成亂序之後又做了排序,導致非常低效,sp

Spark:BlockManager原理剖析與原始碼分析

BlockManager是Spark的分散式儲存系統,與我們平常說的分散式儲存系統是有區別的,區別就是這個分散式儲存系統只會管理Block塊資料,它執行在所有節點上。BlockManager的結構是Maser-Slave架構,Master就是Driver上的BlockManagerMaste

Spark:Shuffle原理剖析與原始碼分析

spark中的Shuffle是非常重要的,shuffle不管在Hadoop中還是Spark中都是重重之重,特別是在Spark shuffle優化的時間。更是非常的重要。 普通shuffle操作的原理剖析(spark 2.x棄用) 每一個Job提交後都會生成一個ResultStage和

Spark:Task原理剖析與原始碼分析

在Spark中,一個應用程式要想被執行,肯定要經過以下的步驟: 從這個路線得知,最終一個job是依賴於分佈在叢集不同節點中的task,通過並行或者併發的執行來完成真正的工作。由此可見,一個個的分散式的task才是Spark的真正執行者。下面先來張task執行框架整體的對Spark的task

Spark:Executor原理剖析與原始碼分析

Executor原理示意圖 Executor程序的啟動 worker中為application啟動的executor,實際上是啟動的這個CoarseGrainedExecutorBackend程序. 原始碼分析: 第一步:CoarseGrainedExecutor

Spark:TaskScheduler原理剖析與原始碼分析

TaskScheduler是一個介面,DAGScheduler在提交TaskSet給底層排程器的時候是面向介面TaskScheduler。TaskSchduler的核心任務是提交Taskset到叢集運算並彙報結果 原始碼分析 第一步:TaskScheduler 提交tasks的入口 su

Spark:DAGScheduler原理剖析與原始碼分析

Job觸發流程原理與原始碼解析 wordcount案例解析,來分析Spark Job的觸發流程 程式碼:var linesRDD= sc.textFile('hdfs://') SparkContext中textFile方法 /** * hadoopFile方法呼叫會

Spark:Worker原理剖析與原始碼分析

解釋: Master要求Worker啟動Driver和Executor Worker啟動Driver的一個基本的原理,Worker會啟動一個執行緒DriverRunner,然後DriverRunner會去負責啟動Driver程序,然後在之後對Driver程序進行管理

Spark:Master原理剖析與原始碼分析

Master主備切換 Spark原生的standalone模式是支援主備切換的,也就是說master可以配置兩個,當Action Master因故障掛了的時候,系統會自動將Standby Master 切換成 Active Master。 Master的準備切換分為兩種:

Spark:SparkContext原理剖析與原始碼分析

在Spark中,SparkContext是Spark所有功能的一個入口,你無論是用java、scala,甚至是python編寫都必須要有一個SparkContext,它的主要作用,包括初始化Spark應用程式所需的一些核心元件,包括 排程器(DAGSchedule、TaskScheduler

各種排序算法原理圖

排序數組 images selection election 最小 原理圖 img 縮小 記錄 Insertion:插入排序,每一步都將一個待排數據按其大小插入到已經排序的數據中的適當位置,直到全部插入完畢。 詳細介紹見:http://www.cnblogs.co

分布式事物的原理圖

技術分享 con http eight fill 分布 階段 width ont 分布式事物兩階段提交原理圖。 blog宗旨:用圖說話。 分布式事物的原理圖

Docker的概念及剖析原理和特點

應用程序 服務器 臺電腦 數據庫 虛擬機 一、docker的簡介: 應用容器是個啥樣子呢,一個做好的應用容器長的就像一個裝好了一組特定應用的虛擬機一樣,比如我現在想用mysql數據庫,我直接找個裝好了的MySQL的容器就可以了,想用的時候一運行容器,MySQL服務就起來了,就可以使

AD軟件原理圖封裝過程(即由原理圖轉換到PCB)

wid 文件 布線 自動 cnblogs project 空白 blog 菜單欄 第一步:先畫出你所要的原理圖 第二步:點擊菜單欄的工具→封裝管理器,進去封裝管理器頁面,點擊左邊的每一個元件, 然後選擇封裝時的元器件,再點擊右邊的確定(每一個元器件確定好封裝要用的元

Kafka分區原理圖

log part img off server mage offset 消息發布 art 一個Topic的多個分區,被分布在kafka集群中的多個server上。每個分區都有一個server為"leader";leader負責所有的讀寫操作,如果leader失效,那麽將會有

智能小車十《從原理圖到PCB圖》

迅捷 layer tool lis 選擇 tac pcb stack nbsp 有了電路原理圖,可以做以下3件事。 1.電氣規則檢查Tools->ERC... 這個可以檢查出連線不正確的地方。 2.生成元件列表報告單。 Reports->Bill of

軟鏈接刪除原理圖

軟鏈接刪除原理圖本文出自 “天晴Linux之旅” 博客,請務必保留此出處http://6520736.blog.51cto.com/6510736/1979324軟鏈接刪除原理圖

Spark GraphX 屬性圖操作

val 元組 連接 string parent ase 限制 apach appname package Spark_GraphX import org.apache.spark.graphx._ import org.apache.spark.rdd.RDD impo