如何用70行程式碼實現深度神經網路演算法

現在所有人都在談深度學習,保持學習精神是需要的,架構師永遠都要對核心技術和關鍵演算法保持關注和敏感,必要時要動手寫一寫掌握下來,先不用關心什麼時候用到,用不用是政治問題,會不會寫是技術問題,就像軍人不關心打不打的問題,而要關心如何打贏的問題。

一、程式設計師如何學習機器學習 機器學習對程式設計師出身的人來說是有一定門檻的,這個門檻也是其核心競爭力,相信你學習機器學習時,滿是數學公式的英文論文一定弄的你頭疼,並知難而退。但實際上機器學習演算法落地程式並不難寫,下面是70行程式碼實現的反向多層(BP)神經網路演算法,也就是傳說中的深度學習(當然這個概念可能很大),經過作者的研究,不光是神經網路,其實邏輯迴歸、決策樹c45、id3、隨機森林、貝葉斯、協同過濾、圖計算、kmeans、pagerank等大部分機器學習演算法都能在100行單機程式內實現(以後考慮分享出來)。機器學習的真正難度在於它為什麼要這麼計算,它背後的數學原理是什麼,怎麼推導得來的公式,網上大部分的資料都在介紹這部分理論知識,卻很少告訴你該演算法的計算過程和程式落地是怎麼樣的,對於程式設計師來說,你需要做的僅是工程化應用,而不需要證明出一項新的數學計算方法。實際大部分機器學習工程師都是利用別人寫好的開源包或者工具軟體,輸入資料和調整計算係數來訓練結果,甚至很少自己實現演算法過程。但是掌握每個演算法的計算過程仍然非常重要,這樣你才能理解該演算法讓資料產生了什麼樣的變化,理解演算法的目的是為了達到一個怎麼樣的效果。下面我們重點探討反向神經網路的單機實現,關於神經網路的多機並行化,Fourinone提供非常靈活完善的平行計算框架,我們只需要理解透單機程式實現,就能構思和設計出分散式並行化方案,如果不理解演算法計算過程,一切思路將無法展開。另外,還有卷積神經網路,主要是一種降維思想,用於影象處理,不在本文討論範圍。

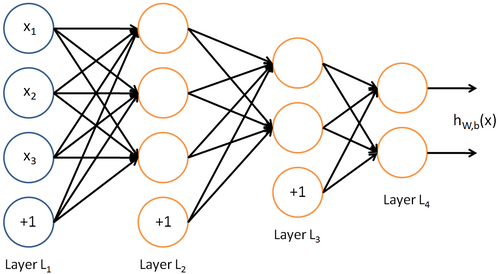

二、神經網路的計算過程說明 神經網路結構如下圖所示,最左邊的是輸入層,最右邊的是輸出層,中間是多個隱含層,對於隱含層和輸出層的每個神經節點,都是由上一層節點乘以其權重累加得到,標上“+1”的圓圈為截距項b,對輸入層外每個節點:Y=w0*x0+w1*x1+...+wn*xn+b,由此我們可以知道神經網路相當於一個多層邏輯迴歸的結構。

演算法計算過程:輸入層開始,從左往右計算,逐層往前直到輸出層產生結果。如果結果值和目標值有差距,再從右往左算,逐層向後計算每個節點的誤差,並且調整每個節點的所有權重,反向到達輸入層後,又重新向前計算,重複迭代以上步驟,直到所有權重引數收斂到一個合理值。由於計算機程式求解方程引數和數學求法不一樣,一般是先隨機選取引數,然後不斷調整引數減少誤差直到逼近正確值,所以大部分的機器學習都是在不斷迭代訓練,下面我們從程式上詳細看看該過程實現就清楚了。

三、神經網路的演算法程式實現說明 分為初始化、向前計算結果,反向修改權重三個過程。 1、初始化過程:由於是n層神經網路,我們用二維陣列layer記錄節點值,第一維為層數,第二維為該層節點位置,陣列的值為節點值;同樣,節點誤差值layerErr也是相似方式記錄。用三維陣列layer_weight記錄各節點權重,第一維為層數,第二維為該層節點位置,第三維為下層節點位置,陣列的值為某節點到達下層某節點的權重值,初始值為0-1之間的隨機數。為了優化收斂速度,這裡採用動量法權值調整,需要記錄上一次權值調整量,用三維陣列layer_weight_delta來記錄,截距項處理:程式裡將截距的值設定為1,這樣只需要計算它的權重就可以了。

2、向前計算結果:採用S函式1/(1+Math.exp(-z))將每個節點的值統一到0-1之間,再逐層向前計算直到輸出層,對於輸出層,實際上是不需要再用S函式的,我們這裡將輸出結果視為0到1之間的概率值,所以也採用了S函式,這樣也有利於程式實現的統一性。

3、反向修改權重 神經網路如何計算誤差,一般採用平方型誤差函式E,如下:

也就是將多個輸出項和對應目標值的誤差的平方累加起來,再除以2。實際上邏輯迴歸的誤差函式也是這個,至於為什麼要用這個函式來計算誤差,它從數學上的合理性是什麼,怎麼得來的,這個我建議程式設計師們不想當數學家的話,先不去深究了,現在我們要做的是如何把這個函式E誤差取它的最小值,需要對其進行求導,如果有些求導數學基礎的話,倒可以嘗試去推導下如何從函式E對權重求導得到下面這個公式的:

不會推導也沒有關係,我們只需要運用結果公式就可以了,在我們的程式裡用layerErr記錄了E對權重求導後的最小化誤差,再根據最小化誤差去調整權重。

注意這裡採用動量法調整,將上一次調整的經驗考慮進來,避免陷入區域性最小值,下面的k代表迭代次數,mobp為動量項,rate為學習步長: Δw(k+1) = mobp*Δw(k)+rate*Err*Layer 也有很多使用下面的公式,效果上的差別不是太大: Δw(k+1) = mobp*Δw(k)+(1-mobp)rate*Err*Layer

為了提升效能,注意程式實現是在一個while裡面同時計算誤差和調整權重,先將位置定位到倒數第二層(也就是最後一層隱含層)上,然後逐層反向調整,根據L+1層算好的誤差來調整L層的權重,同時計算好L層的誤差,用於下一次迴圈到L-1層時計算權重,以此迴圈下去直到倒數第一層(輸入層)結束。

總結:在整個計算過程中,我們可以看到節點的值是每次計算都在變化的,它是動態不需要儲存的,權重引數和誤差引數是需要儲存的,需要為下一次迭代提供支援,因此,如果我們構思一個分散式的多機平行計算方案,就能理解其他框架中為什麼會有一個Parameter Server的概念。

四、多層神經網路完整程式實現 下面實現程式BpDeep.java可以直接拿去使用,也很容易修改為c,c#,python等其他任何語言實現,因為都是使用的基本語句,沒有用到其他java庫(除了random函式),以下為原創程式,轉載引用時請註明作者和出處。

-

import java.util.Random; -

public class BpDeep{ -

public double[][] layer;//神經網路各層節點 -

public double[][] layerErr;//神經網路各節點誤差 -

public double[][][] layer_weight;//各層節點權重 -

public double[][][] layer_weight_delta;//各層節點權重動量 -

public double mobp;//動量係數 -

public double rate;//學習係數 -

public BpDeep(int[] layernum, double rate, double mobp){ -

this.mobp = mobp; -

this.rate = rate; -

layer = new double[layernum.length][]; -

layerErr = new double[layernum.length][]; -

layer_weight = new double[layernum.length][][]; -

layer_weight_delta = new double[layernum.length][][]; -

Random random = new Random(); -

for(int l=0;l<layernum.length;l++){ -

layer[l]=new double[layernum[l]]; -

layerErr[l]=new double[layernum[l]]; -

if(l+1<layernum.length){ -

layer_weight[l]=new double[layernum[l]+1][layernum[l+1]]; -

layer_weight_delta[l]=new double[layernum[l]+1][layernum[l+1]]; -

for(int j=0;j<layernum[l]+1;j++) -

for(int i=0;i<layernum[l+1];i++) -

layer_weight[l][j][i]=random.nextDouble();//隨機初始化權重 -

} -

} -

} -

//逐層向前計算輸出 -

public double[] computeOut(double[] in){ -

for(int l=1;l<layer.length;l++){ -

for(int j=0;j<layer[l].length;j++){ -

double z=layer_weight[l-1][layer[l-1].length][j]; -

for(int i=0;i<layer[l-1].length;i++){ -

layer[l-1][i]=l==1?in[i]:layer[l-1][i]; -

z+=layer_weight[l-1][i][j]*layer[l-1][i]; -

} -

layer[l][j]=1/(1+Math.exp(-z)); -

} -

} -

return layer[layer.length-1]; -

} -

//逐層反向計算誤差並修改權重 -

public void updateWeight(double[] tar){ -

int l=layer.length-1; -

for(int j=0;j<layerErr[l].length;j++) -

layerErr[l][j]=layer[l][j]*(1-layer[l][j])*(tar[j]-layer[l][j]); -

while(l-->0){ -

for(int j=0;j<layerErr[l].length;j++){ -

double z = 0.0; -

for(int i=0;i<layerErr[l+1].length;i++){ -

z=z+l>0?layerErr[l+1][i]*layer_weight[l][j][i]:0; -

layer_weight_delta[l][j][i]= mobp*layer_weight_delta[l][j][i]+rate*layerErr[l+1][i]*layer[l][j];//隱含層動量調整 -

layer_weight[l][j][i]+=layer_weight_delta[l][j][i];//隱含層權重調整 -

if(j==layerErr[l].length-1){ -

layer_weight_delta[l][j+1][i]= mobp*layer_weight_delta[l][j+1][i]+rate*layerErr[l+1][i];//截距動量調整 -

layer_weight[l][j+1][i]+=layer_weight_delta[l][j+1][i];//截距權重調整 -

} -

} -

layerErr[l][j]=z*layer[l][j]*(1-layer[l][j]);//記錄誤差 -

} -

} -

} -

public void train(double[] in, double[] tar){ -

double[] out = computeOut(in); -

updateWeight(tar); -

} -

}

五、一個運用神經網路的例子

最後我們找個簡單例子來看看神經網路神奇的效果,為了方便觀察資料分佈,我們選用一個二維座標的資料,下面共有4個數據,方塊代表資料的型別為1,三角代表資料的型別為0,可以看到屬於方塊型別的資料有(1,2)和(2,1),屬於三角型別的資料有(1,1),(2,2),現在問題是需要在平面上將4個數據分成1和0兩類,並以此來預測新的資料的型別。

我們可以運用邏輯迴歸演算法來解決上面的分類問題,但是邏輯迴歸得到一個線性的直線做為分界線,可以看到上面的紅線無論怎麼擺放,總是有一個樣本被錯誤的劃分到不同型別中,所以對於上面的資料,僅僅一條直線不能很正確的劃分他們的分類,如果我們運用神經網路演算法,可以得到下圖的分類效果,相當於多條直線求並集來劃分空間,這樣準確性更高。

下面是這個測試程式BpDeepTest.java的原始碼:

-

import java.util.Arrays; -

public class BpDeepTest{ -

public static void main(String[] args){ -

//初始化神經網路的基本配置 -

//第一個引數是一個整型陣列,表示神經網路的層數和每層節點數,比如{3,10,10,10,10,2}表示輸入層是3個節點,輸出層是2個節點,中間有4層隱含層,每層10個節點 -

//第二個引數是學習步長,第三個引數是動量係數 -

BpDeep bp = new BpDeep(new int[]{2,10,2}, 0.15, 0.8); -

//設定樣本資料,對應上面的4個二維座標資料 -

double[][] data = new double[][]{{1,2},{2,2},{1,1},{2,1}}; -

//設定目標資料,對應4個座標資料的分類 -

double[][] target = new double[][]{{1,0},{0,1},{0,1},{1,0}}; -

//迭代訓練5000次 -

for(int n=0;n<5000;n++) -

for(int i=0;i<data.length;i++) -

bp.train(data[i], target[i]); -

//根據訓練結果來檢驗樣本資料 -

for(int j=0;j<data.length;j++){ -

double[] result = bp.computeOut(data[j]); -

System.out.println(Arrays.toString(data[j])+":"+Arrays.toString(result)); -

} -

//根據訓練結果來預測一條新資料的分類 -

double[] x = new double[]{3,1}; -

double[] result = bp.computeOut(x); -

System.out.println(Arrays.toString(x)+":"+Arrays.toString(result)); -

} -

}

總結:執行以上測試程式後,是不是覺的神經網路有很神奇的分類效果,但是實際上神經網路有一定優勢,但也不是接近人腦的萬能演算法,很多時候它會讓你失望的,還需要結合各種場景的資料大量運用去觀察其效果,我們可以把1層隱含層改成n層,並調整每層節點數、迭代次數、學習步長和動量係數來得到一個最優化的結果,但是很多時候n層隱含層的效果並不比1層有明顯提升,反而計算更復雜耗時,我們對對神經網路的認識還需要多實踐多體會。