牛頓法與擬牛頓法詳解

參考網址:http://blog.csdn.net/itplus/article/details/21896453

牛頓法:

http://blog.csdn.net/itplus/article/details/21896453

擬牛頓條件:

http://blog.csdn.net/itplus/article/details/21896619

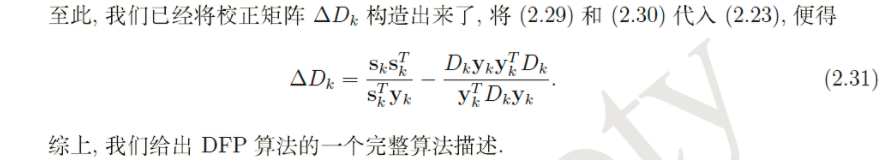

DFP演算法:

http://blog.csdn.net/itplus/article/details/21896981

BFGS演算法

http://blog.csdn.net/itplus/article/details/21897443

F-BFGS演算法

http://blog.csdn.net/itplus/article/details/21897715

相關推薦

牛頓法與擬牛頓法詳解

參考網址:http://blog.csdn.net/itplus/article/details/21896453 牛頓法: http://blog.csdn.net/itplus/article/details/21896453 擬牛頓條件: http://blog.csdn.ne

牛頓法與擬牛頓法學習筆記

機器學習演算法中經常碰到非線性優化問題,如 Sparse Filtering 演算法,其主要工作在於求解一個非線性極小化問題。在具體實現中,大多呼叫的是成熟的軟體包做支撐,其中最常用的一個演算法是 L-BFGS。為了解這個演算法的數學機理,這幾天做了一些調研,現把學習過程中理解的一些東西整

【數學】梯度下降,牛頓法與擬牛頓法

梯度下降 將f(x)f(x)一階泰勒展開: f(x)=f(x0)+(x−x0)f′(x0)f(x)=f(x0)+(x−x0)f′(x0) f(x)=f(x0)+Δxf′(x0)f(x)=f(x0)+Δxf′(x0) 如果當前處於x0x0節點,要使得前進同樣的

牛頓法與擬牛頓法學習筆記(一)牛頓法

機器學習演算法中經常碰到非線性優化問題,如 Sparse Filtering 演算法,其主要工作在於求解一個非線性極小化問題。在具體實現中,大多呼叫的是成熟的軟體包做支撐,其中最常用的一個演算法是 L-BFGS。為了解這個演算法的數學機理,這幾天做了一些調研,現把學習過程

牛頓法與擬牛頓法學習心得

1. 引言 在logistics迴歸中,我們通常使用梯度下降法(Gradient Decend)來優化目標函式。但梯度下降法的策略實際上是比較片面的,因為它只使用了一階導資訊,搜尋方向(梯度方向)比較偏向於區域性資訊。所以,我們引入了牛頓法。 這裡推薦一個牛頓法

牛頓法與擬牛頓法學習筆記(四)BFGS 演算法

機器學習演算法中經常碰到非線性優化問題,如 Sparse Filtering 演算法,其主要工作在於求解一個非線性極小化問題。在具體實現中,大多呼叫的是成熟的軟體包做支撐,其中最常用的

【機器學習詳解】解無約束優化問題:梯度下降、牛頓法、擬牛頓法

無約束優化問題是機器學習中最普遍、最簡單的優化問題。 x∗=minxf(x),x∈Rn 1.梯度下降 梯度下降是最簡單的迭代優化演算法,每一次迭代需求解一次梯度方向。函式的負梯度方向代表使函式值減小最快的方向。它的思想是沿著函式負梯度方向移動逐步逼

最優化學習筆記(五)牛頓法及擬牛頓法

div size -a article fonts alt water src jsb 最優化學習筆記(五)牛頓法及擬牛頓法

常見的幾種最優化方法(梯度下降法、牛頓法、擬牛頓法、共軛梯度法等)

linear 樣本 計算 每次 理學 系統 是否 底部 有效 我們每個人都會在我們的生活或者工作中遇到各種各樣的最優化問題,比如每個企業和個人都要考慮的一個問題“在一定成本下,如何使利潤最大化”等。最優化方法是一種數學方法,它是研究在給定約束之下如何尋求某些因素(的量),以

平面二維任意橢圓數據擬合算法推導及程序實現詳解

tar 擬合 推導 oai http margin oci 二維 詳解 0墾oe辟煽6味h幼瀾6http://t.docin.com/laiys67141 x0涸tj妝06曬妒http://t.docin.com/sina_6267117010 9剿襖2閱b盎忍40ht

建立單鏈表的頭插法與尾插法詳解

建立單鏈表 關於資料結構的入門,就是從順序表和單鏈表開始。 我們不講順序表,直接從單鏈表開始我們的資料結構和演算法的學習之路。 單鏈表就是一種特殊的結構體組合而成的資料結構,關於單鏈表的建立方法有很多種,但都大同小異。 正如這幅圖中所表示的那樣,單鏈表就是由可

無約束演算法-最速下降,牛頓法,擬牛頓,共軛梯度求解二次函式極小值

import numpy as np import math a=np.random.randint(1,10,size=[100,1]) G=(a*a.T)+np.random.randint(1,5)*np.eye(100) b=np.dot(G,np.ones(

最優化方法:牛頓迭代法和擬牛頓迭代法

基礎拐點若曲線圖形在一點由凸轉凹,或由凹轉凸,則稱此點為拐點。直觀地說,拐點是使切線穿越曲線的點。拐點的必要條件:設f(x){\displaystyle f(x)}在(a,b){\displaystyle (a,b)}內二階可導,x0∈ (a,b){\displaystyle

梯度下降法、隨機梯度下降法、批量梯度下降法及牛頓法、擬牛頓法、共軛梯度法

引言 李航老師在《統計學習方法》中將機器學習的三要素總結為:模型、策略和演算法。其大致含義如下: 模型:其實就是機器學習訓練的過程中所要學習的條件概率分佈或者決策函式。 策略:就是使用一種什麼樣的評價,度量模型訓練過程中的學習好壞的方法,同時根據這個方

無約束最優化方法——牛頓法、擬牛頓法、BFGS、LBFGS

這是前一段時間寫的部落格,然後又重新整理了一下 最速下降法 牛頓法 擬牛頓法 SR1 BFGS DFP LBFGS 【最速下降法】 無約束最優化方法不涉及約束條件,所以都是介紹如何尋找搜尋方向以及搜尋步長。 無約束最優化問題的目標函式:

Canny邊緣檢測算法原理及其VC實現詳解(一)

常用 差分 實現圖 還需要 鏈接 傳感器 出了 關系 位置 轉自:http://blog.csdn.net/likezhaobin/article/details/6892176 圖象的邊緣是指圖象局部區域亮度變化顯著的部分,該區域的灰度剖面一般可以看作是一個階躍,既從

算法筆記--sg函數詳解及其模板

clas ref http spa for tail details false art sg函數大神詳解:http://blog.csdn.net/luomingjun12315/article/details/45555495 模板: int f[N],SG[N];

SSD(single shot multibox detector)算法及Caffe代碼詳解[轉]

作者 3.4 pdf 論文 做了 對比度調整 覆蓋 eccv 添加 這篇博客主要介紹SSD算法,該算法是最近一年比較優秀的object detection算法,主要特點在於采用了特征融合。 論文:SSD single shot multibox detector論文鏈接:h

POJ 1061 青蛙的約會(拓展歐幾裏得算法求解模線性方程組詳解)

scrip 坐標 出發點 開心 以及 NPU tdi 青蛙的約會 方程組 題目鏈接: BZOJ: https://www.lydsy.com/JudgeOnline/problem.php?id=1477 POJ: https://cn.vjudge.net/problem

Linux用戶與用戶組詳解

不為 密碼文件 控制 我們 虛擬 切換 得到 管理員 字符 1,用戶和用戶組文件 在linux中,用戶帳號,用戶密碼,用戶組信息和用戶組密碼均是存放在不同的配置文件中的。 在linux系統中,所創建的用戶帳號和其相關信息(密碼除外)均是存放在/etc/passw