最簡單的基於FFmpeg的AVDevice例子 讀取攝像頭

=====================================================最簡單的基於FFmpeg的AVDevice例子文章列表:

最簡單的基於FFmpeg的AVDevice例子(螢幕錄製)=====================================================

FFmpeg中有一個和多媒體裝置互動的類庫:Libavdevice。使用這個庫可以讀取電腦(或者其他裝置上)的多媒體裝置的資料,或者輸出資料到指定的多媒體裝置上。

Libavdevice支援以下裝置作為輸入端:alsaavfoundationbktrdshowdv1394fbdevgdigrabiec61883jacklavfilibcdiolibdc1394openalosspulseqtkitsndiovideo4linux2, v4l2vfwcapx11grabdecklinkLibavdevice支援以下裝置作為輸出端:

alsacacadecklinkfbdevopenglosspulsesdlsndioxv

libavdevice使用

計劃記錄兩個基於FFmpeg的libavdevice類庫的例子,分成兩篇文章寫。本文記錄一個基於FFmpeg的Libavdevice類庫讀取攝像頭資料的例子。下一篇文章記錄一個基於FFmpeg的Libavdevice類庫錄製螢幕的例子。本文程式讀取計算機上的攝像頭的資料並且解碼顯示出來。有關解碼顯示方面的程式碼本文不再詳述,可以參考文章:《100行程式碼實現最簡單的基於FFMPEG+SDL的視訊播放器(SDL1.x)》本文主要記錄使用libavdevice需要注意的步驟。

#include "libavdevice/avdevice.h"avdevice_register_all();AVFormatContext *pFormatCtx = avformat_alloc_context();avformat_open_input(&pFormatCtx, "test.h265" AVFormatContext *pFormatCtx = avformat_alloc_context();AVInputFormat *ifmt=av_find_input_format("vfwcap");avformat_open_input(&pFormatCtx, 0, ifmt,NULL);AVFormatContext *pFormatCtx = avformat_alloc_context();AVInputFormat *ifmt=av_find_input_format("dshow");avformat_open_input(&pFormatCtx,"video=Integrated Camera",ifmt,NULL) ;注意事項

1.URL的格式是"video={裝置名稱}",但是裝置名稱外面不能加引號。例如在上述例子中URL是"video=Integrated Camera",而不能寫成"video=\"Integrated Camera\"",否則就無法開啟裝置。這與直接使用ffmpeg.exe開啟dshow裝置(命令為:ffmpeg -list_options true -f dshow -i video="Integrated Camera")有很大的不同。2.Dshow的裝置名稱必須要提前獲取,在這裡有兩種方法:(1)通過FFmpeg程式設計實現。使用如下程式碼:

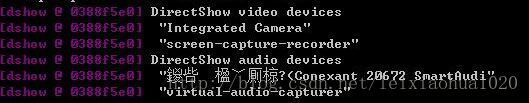

//Show Devicevoid show_dshow_device(){ AVFormatContext *pFormatCtx = avformat_alloc_context(); AVDictionary* options = NULL; av_dict_set(&options,"list_devices","true",0); AVInputFormat *iformat = av_find_input_format("dshow"); printf("Device Info=============\n"); avformat_open_input(&pFormatCtx,"video=dummy",iformat,&options); printf("========================\n");}ffmpeg -list_devices true -f dshow -i dummy 執行的結果如下圖所示:

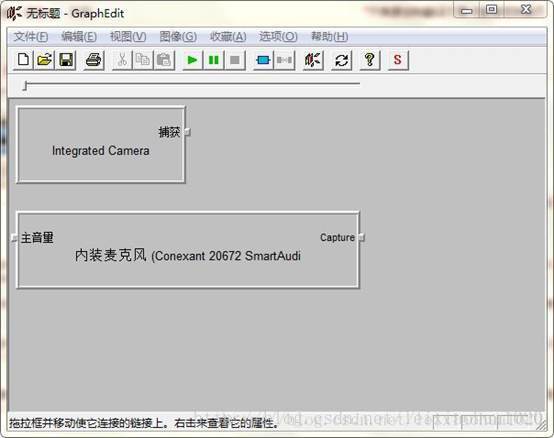

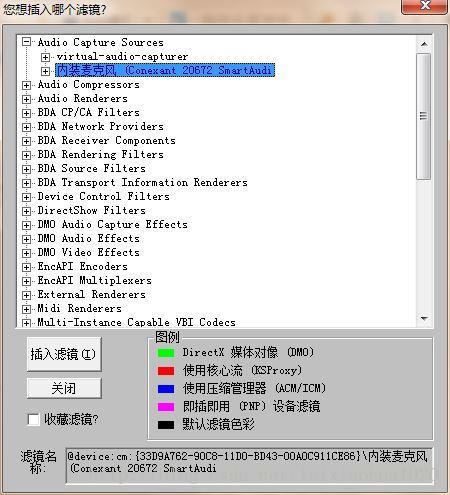

然後就可以通過檢視Audio Capture Sources來檢視音訊輸入裝置的簡體中文名稱了。從圖中可以看出是“內裝麥克風 (Conexant 20672 SmartAudi”。

然後就可以通過檢視Audio Capture Sources來檢視音訊輸入裝置的簡體中文名稱了。從圖中可以看出是“內裝麥克風 (Conexant 20672 SmartAudi”。  在Linux平臺上可以使用video4linux2開啟視訊裝置;在MacOS上,可以使用avfoundation開啟視訊裝置,這裡不再詳述。

在Linux平臺上可以使用video4linux2開啟視訊裝置;在MacOS上,可以使用avfoundation開啟視訊裝置,這裡不再詳述。程式碼

下面直接貼上程式程式碼:

/** * 最簡單的基於FFmpeg的AVDevice例子(讀取攝像頭) * Simplest FFmpeg Device (Read Camera) * * 雷霄驊 Lei Xiaohua * [email protected] * 中國傳媒大學/數字電視技術 * Communication University of China / Digital TV Technology * http://blog.csdn.net/leixiaohua1020 * * 本程式實現了本地攝像頭資料的獲取解碼和顯示。是基於FFmpeg * 的libavdevice類庫最簡單的例子。通過該例子,可以學習FFmpeg中 * libavdevice類庫的使用方法。 * 本程式在Windows下可以使用2種方式讀取攝像頭資料: * 1.VFW: Video for Windows 螢幕捕捉裝置。注意輸入URL是裝置的序號, * 從0至9。 * 2.dshow: 使用Directshow。注意作者機器上的攝像頭裝置名稱是 * “Integrated Camera”,使用的時候需要改成自己電腦上攝像頭設 * 備的名稱。 * 在Linux下可以使用video4linux2讀取攝像頭裝置。 * 在MacOS下可以使用avfoundation讀取攝像頭裝置。 * * This software read data from Computer's Camera and play it. * It's the simplest example about usage of FFmpeg's libavdevice Library. * It's suiltable for the beginner of FFmpeg. * This software support 2 methods to read camera in Microsoft Windows: * 1.gdigrab: VfW (Video for Windows) capture input device. * The filename passed as input is the capture driver number, * ranging from 0 to 9. * 2.dshow: Use Directshow. Camera's name in author's computer is * "Integrated Camera". * It use video4linux2 to read Camera in Linux. * It use avfoundation to read Camera in MacOS. * */#include <stdio.h>#define __STDC_CONSTANT_MACROS#ifdef _WIN32//Windowsextern "C"{#include "libavcodec/avcodec.h"#include "libavformat/avformat.h"#include "libswscale/swscale.h"#include "libavdevice/avdevice.h"#include "SDL/SDL.h"};#else//Linux...#ifdef __cplusplusextern "C"{#endif#include <libavcodec/avcodec.h>#include <libavformat/avformat.h>#include <libswscale/swscale.h>#include <libavdevice/avdevice.h>#include <SDL/SDL.h>#ifdef __cplusplus};#endif#endif//Output YUV420P #define OUTPUT_YUV420P 0//'1' Use Dshow //'0' Use VFW#define USE_DSHOW 0//Refresh Event#define SFM_REFRESH_EVENT (SDL_USEREVENT + 1)#define SFM_BREAK_EVENT (SDL_USEREVENT + 2)int thread_exit=0;int sfp_refresh_thread(void *opaque){ thread_exit=0; while (!thread_exit) { SDL_Event event; event.type = SFM_REFRESH_EVENT; SDL_PushEvent(&event); SDL_Delay(40); } thread_exit=0; //Break SDL_Event event; event.type = SFM_BREAK_EVENT; SDL_PushEvent(&event); return 0;}//Show Dshow Devicevoid show_dshow_device(){ AVFormatContext *pFormatCtx = avformat_alloc_context(); AVDictionary* options = NULL; av_dict_set(&options,"list_devices","true",0); AVInputFormat *iformat = av_find_input_format("dshow"); printf("========Device Info=============\n"); avformat_open_input(&pFormatCtx,"video=dummy",iformat,&options); printf("================================\n");}//Show Dshow Device Optionvoid show_dshow_device_option(){ AVFormatContext *pFormatCtx = avformat_alloc_context(); AVDictionary* options = NULL; av_dict_set(&options,"list_options","true",0); AVInputFormat *iformat = av_find_input_format("dshow"); printf("========Device Option Info======\n"); avformat_open_input(&pFormatCtx,"video=Integrated Camera",iformat,&options); printf("================================\n");}//Show VFW Devicevoid show_vfw_device(){ AVFormatContext *pFormatCtx = avformat_alloc_context(); AVInputFormat *iformat = av_find_input_format("vfwcap"); printf("========VFW Device Info======\n"); avformat_open_input(&pFormatCtx,"list",iformat,NULL); printf("=============================\n");}//Show AVFoundation Devicevoid show_avfoundation_device(){ AVFormatContext *pFormatCtx = avformat_alloc_context(); AVDictionary* options = NULL; av_dict_set(&options,"list_devices","true",0); AVInputFormat *iformat = av_find_input_format("avfoundation"); printf("==AVFoundation Device Info===\n"); avformat_open_input(&pFormatCtx,"",iformat,&options); printf("=============================\n");}int main(int argc, char* argv[]){ AVFormatContext *pFormatCtx; int i, videoindex; AVCodecContext *pCodecCtx; AVCodec *pCodec; av_register_all(); avformat_network_init(); pFormatCtx = avformat_alloc_context(); //Open File //char filepath[]="src01_480x272_22.h265"; //avformat_open_input(&pFormatCtx,filepath,NULL,NULL) //Register Device avdevice_register_all();//Windows#ifdef _WIN32 //Show Dshow Device show_dshow_device(); //Show Device Options show_dshow_device_option(); //Show VFW Options show_vfw_device();#if USE_DSHOW AVInputFormat *ifmt=av_find_input_format("dshow"); //Set own video device's name if(avformat_open_input(&pFormatCtx,"video=Integrated Camera",ifmt,NULL)!=0){ printf("Couldn't open input stream.\n"); return -1; }#else AVInputFormat *ifmt=av_find_input_format("vfwcap"); if(avformat_open_input(&pFormatCtx,"0",ifmt,NULL)!=0){ printf("Couldn't open input stream.\n"); return -1; }#endif#elif defined linux //Linux AVInputFormat *ifmt=av_find_input_format("video4linux2"); if(avformat_open_input(&pFormatCtx,"/dev/video0",ifmt,NULL)!=0){ printf("Couldn't open input stream.\n"); return -1; }#else show_avfoundation_device(); //Mac AVInputFormat *ifmt=av_find_input_format("avfoundation"); //Avfoundation //[video]:[audio] if(avformat_open_input(&pFormatCtx,"0",ifmt,NULL)!=0){ printf("Couldn't open input stream.\n"); return -1; }#endif if(avformat_find_stream_info(pFormatCtx,NULL)<0) { printf("Couldn't find stream information.\n"); return -1; } videoindex=-1; for(i=0; i<pFormatCtx->nb_streams; i++) if(pFormatCtx->streams[i]->codec->codec_type==AVMEDIA_TYPE_VIDEO) { videoindex=i; break; } if(videoindex==-1) { printf("Couldn't find a video stream.\n"); return -1; } pCodecCtx=pFormatCtx->streams[videoindex]->codec; pCodec=avcodec_find_decoder(pCodecCtx->codec_id); if(pCodec==NULL) { printf("Codec not found.\n"); return -1; } if(avcodec_open2(pCodecCtx, pCodec,NULL)<0) { printf("Could not open codec.\n"); return -1; } AVFrame *pFrame,*pFrameYUV; pFrame=av_frame_alloc(); pFrameYUV=av_frame_alloc(); //unsigned char *out_buffer=(unsigned char *)av_malloc(avpicture_get_size(AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height)); //avpicture_fill((AVPicture *)pFrameYUV, out_buffer, AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height); //SDL---------------------------- if(SDL_Init(SDL_INIT_VIDEO | SDL_INIT_AUDIO | SDL_INIT_TIMER)) { printf( "Could not initialize SDL - %s\n", SDL_GetError()); return -1; } int screen_w=0,screen_h=0; SDL_Surface *screen; screen_w = pCodecCtx->width; screen_h = pCodecCtx->height; screen = SDL_SetVideoMode(screen_w, screen_h, 0,0); if(!screen) { printf("SDL: could not set video mode - exiting:%s\n",SDL_GetError()); return -1; } SDL_Overlay *bmp; bmp = SDL_CreateYUVOverlay(pCodecCtx->width, pCodecCtx->height,SDL_YV12_OVERLAY, screen); SDL_Rect rect; rect.x = 0; rect.y = 0; rect.w = screen_w; rect.h = screen_h; //SDL End------------------------ int ret, got_picture; AVPacket *packet=(AVPacket *)av_malloc(sizeof(AVPacket));#if OUTPUT_YUV420P FILE *fp_yuv=fopen("output.yuv","wb+"); #endif struct SwsContext *img_convert_ctx; img_convert_ctx = sws_getContext(pCodecCtx->width, pCodecCtx->height, pCodecCtx->pix_fmt, pCodecCtx->width, pCodecCtx->height, AV_PIX_FMT_YUV420P, SWS_BICUBIC, NULL, NULL, NULL); //------------------------------ SDL_Thread *video_tid = SDL_CreateThread(sfp_refresh_thread,NULL); // SDL_WM_SetCaption("Simplest FFmpeg Read Camera",NULL); //Event Loop SDL_Event event; for (;;) { //Wait SDL_WaitEvent(&event); if(event.type==SFM_REFRESH_EVENT){ //------------------------------ if(av_read_frame(pFormatCtx, packet)>=0){ if(packet->stream_index==videoindex){ ret = avcodec_decode_video2(pCodecCtx, pFrame, &got_picture, packet); if(ret < 0){ printf("Decode Error.\n"); return -1; } if(got_picture){ SDL_LockYUVOverlay(bmp); pFrameYUV->data[0]=bmp->pixels[0]; pFrameYUV->data[1]=bmp->pixels[2]; pFrameYUV->data[2]=bmp->pixels[1]; pFrameYUV->linesize[0]=bmp->pitches[0]; pFrameYUV->linesize[1]=bmp->pitches[2]; pFrameYUV->linesize[2]=bmp->pitches[1]; sws_scale(img_convert_ctx, (const unsigned char* const*)pFrame->data, pFrame->linesize, 0, pCodecCtx->height, pFrameYUV->data, pFrameYUV->linesize);#if OUTPUT_YUV420P int y_size=pCodecCtx->width*pCodecCtx->height; fwrite(pFrameYUV->data[0],1,y_size,fp_yuv); //Y fwrite(pFrameYUV->data[1],1,y_size/4,fp_yuv); //U fwrite(pFrameYUV->data[2],1,y_size/4,fp_yuv); //V #endif SDL_UnlockYUVOverlay(bmp); SDL_DisplayYUVOverlay(bmp, &rect); } } av_free_packet(packet); }else{ //Exit Thread thread_exit=1; } }else if(event.type==SDL_QUIT){ thread_exit=1; }else if(event.type==SFM_BREAK_EVENT){ break; } } sws_freeContext(img_convert_ctx);#if OUTPUT_YUV420P fclose(fp_yuv);#endif SDL_Quit(); //av_free(out_buffer); av_free(pFrameYUV); avcodec_close(pCodecCtx); avformat_close_input(&pFormatCtx); return 0;}結果

程式的執行效果如下。輸出了攝像頭的資料。

#define OUTPUT_YUV420P 0可以通過下面的巨集定義來確定使用VFW或者是Dshow開啟攝像頭:

//'1' Use Dshow //'0' Use VFW#define USE_DSHOW 0下載

Simplest FFmpeg Device

專案主頁

CSDN下載地址:

注:

本工程包含兩個基於FFmpeg的libavdevice的例子: simplest_ffmpeg_grabdesktop:螢幕錄製。 simplest_ffmpeg_readcamera:讀取攝像頭。

更新-1.1(2015.1.9)=========================================

該版本中,修改了SDL的顯示方式,彈出的視窗可以移動了。

更新-1.2 (2015.2.13)=========================================

這次考慮到了跨平臺的要求,調整了原始碼。經過這次調整之後,原始碼可以在以下平臺編譯通過:

VC++:開啟sln檔案即可編譯,無需配置。

cl.exe:開啟compile_cl.bat即可命令列下使用cl.exe進行編譯,注意可能需要按照VC的安裝路徑調整腳本里面的引數。編譯命令如下。

::VS2010 Environmentcall "D:\Program Files\Microsoft Visual Studio 10.0\VC\vcvarsall.bat"::[email protected] INCLUDE=include;%INCLUDE%::[email protected] LIB=lib;%LIB%::compile and linkcl simplest_ffmpeg_readcamera.cpp /MD /link SDL.lib SDLmain.lib avcodec.lib ^avformat.lib avutil.lib avdevice.lib avfilter.lib postproc.lib swresample.lib swscale.lib ^/SUBSYSTEM:WINDOWS /OPT:NOREFMinGW:MinGW命令列下執行compile_mingw.sh即可使用MinGW的g++進行編譯。編譯命令如下。

g++ simplest_ffmpeg_readcamera.cpp -g -o simplest_ffmpeg_readcamera.exe \-I /usr/local/include -L /usr/local/lib \-lmingw32 -lSDLmain -lSDL -lavformat -lavcodec -lavutil -lavdevice -lswscaleGCC(Linux):Linux命令列下執行compile_gcc.sh即可使用GCC進行編譯。編譯命令如下。

gcc simplest_ffmpeg_readcamera.cpp -g -o simplest_ffmpeg_readcamera.out \-I /usr/local/include -L /usr/local/lib -lSDLmain -lSDL -lavformat -lavcodec -lavutil -lavdevice -lswscaleGCC(MacOS):MacOS命令列下執行compile_gcc_mac.sh即可使用GCC進行編譯。Mac的GCC和Linux的GCC差別不大,但是使用SDL1.2的時候,必須加上“-framework Cocoa”引數,否則編譯無法通過。編譯命令如下。

gcc simplest_ffmpeg_readcamera.cpp -g -o simplest_ffmpeg_readcamera.out \-framework Cocoa -I /usr/local/include -L /usr/local/lib -lSDLmain -lSDL -lavformat -lavcodec -lavutil -lavdevice -lswscalePS:相關的編譯命令已經儲存到了工程資料夾中

此外,增加了MacOS下使用avfoundation讀取攝像頭的程式碼。

SourceForge上已經更新。