Hadoop分散式安裝(全網最全)帶註釋

大家好,今天給大家配置下hadoop叢集模式,完全分散式,

配置需求 3臺節點

前提:有3臺乾淨的機器,並且安裝好jdk,SSH免密登陸要配置好

話不多說,直接開幹

1、安裝之前首先確保你已經安裝了JDK,配置好了SSH免密登陸

如果SSH沒有配好的話,https://mp.csdn.net/postedit/82669131可以參考參考

2、上傳解壓hadoop,

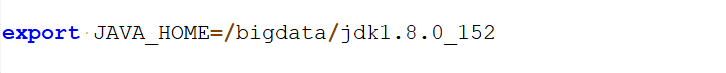

修改hadoop安裝目錄下的 /etc/hadoop hadoop-env.sh yarn-env.sh mapred-env.sh 這3個配置檔案加上java的環境變數

3、修改core-site.xml檔案

<configuration>

<!-- 配置臨時資料存放的儲存目錄-->

<property>

<name>hadoop.tmp.dir</name>

<value>/bigdata/hadoop250/data/tmp</value>

</property>

<!-- 配置操作hdfs的快取大小-->

<property>

<name>io.file.buffer.size</name>

<value>4096</value>

</property>

<!-- 指定HDFS 中 NameNode 的地址-->

<property>

<name>fs.default.name</name>

<value>hdfs://es1:9000</value>

</property>

</configuration>

4、修改yarn-site.xml

<configuration>

<!--指定rm所啟動的伺服器主機名 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>es2</value>

</property>

<!--指定rm的shuffle -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!--指定rm的內部通訊地址 -->

<property>

<name>yarn.resourcemanager.address</name>

<value>es2:8032</value>

</property>

<!--指定rm的scheduler的內部通訊地址 -->

<property>

<description>The address of the scheduler interface.</description>

<name>yarn.resourcemanager.scheduler.address</name>

<value>es2:8030</value>

</property>

<!--指定rm的scheduler-tracjer的內部通訊地址 -->

<property>

<description>The address of the resource tracker interface.</description>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>es2:8031</value>

</property>

<!--指定rm的admin的內部通訊地址 -->

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>es2:8033</value>

</property>

<!--指定rm的web ui監控地址 -->

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>es2:8088</value>

</property>

<!-- 日誌聚集功能使能 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 日誌保留時間設定 7 天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

</configuration>

5、配置mapred-site.xml

<configuration>

<!-- 指定mepreduce執行框架-->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

<final>true</final>

</property>

<property>

<!--歷史服務的通訊地址-->

<name>mapreduce.jobhistory.address</name>

<value>es2:10020</value>

</property>

<!--歷史服務的web ui 地址 -->

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>es2:19888</value>

</property>

</configuration>

6、配置hdfs-site.xml

<configuration>

<!--副本數 -->

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<!--塊大小 -->

<property>

<name>dfs.blocksize</name>

<value>134217728</value>

</property>

<!--hdfs的namenode的web ui地址-->

<property>

<name>dfs.http.address</name>

<value>es1:50070</value>

</property>

<!--hdfs的snn的web ui地址-->

<property>

<name>dfs.secondary.http.address</name>

<value>es1:50090</value>

</property>

<!--是否開啟web啟動的操作hdfs-->

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

<!--是否開啟web的許可權(acl)-->

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

</configuration>

7、開始拷貝hadoo資料夾,將其拷貝到其他機器

scp -r /usr/local/hadoop hadoop02:/usr/local

8、格式化namenode 在配置了namenode的那一臺機器執行如下命令

hadoop namenode -format

9、啟動(命令大全)

全啟動 start-all.sh =start-dfs.sh = start.yarn.sh

模組啟動

start-dfs.sh 進入到hadoop目錄 ./sbin/start-xxx.sh

start-yarn.sh 進入到hadoop目錄 ./sbin/start-xxx.sh

單個程序啟動

hadoop-daemon.sh start/stop namenode

hadoop-daemons.sh start/stop datanode

yarn-daemon.sh start/stop resourcemanager

yarn-daemons.sh start/stop nodemanager

結束了 啟動開啟瀏覽器訪問正常hdfs://es1:9000