NFC身份證識別(二)

1、首先需要了解身份證閱讀器的工作原理與流程。

詳見《居民身份證驗證安全控制模組介面技術規範》,標準GA 467-2004。

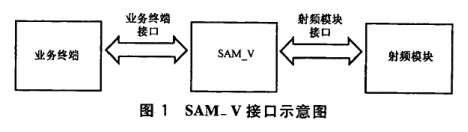

大致原理圖:

sam_v:驗證安全控制模組(secure access and control module for validation)

2、並行與序列:

序列介面:序列介面,簡稱串列埠,也就是COM介面,是採用序列通訊協議的擴充套件介面。串列埠的出現是在1980年前後,資料傳輸率是115kbps~230kbps,串列埠一般用來連線滑鼠和外接Modem以及老式攝像頭和寫字板等裝置,目前部分新主機板已開始取消該介面。

USB:通用序列匯流排(英語:Universal Serial Bus,縮寫:USB)是連線計算機系統與外部裝置的一種串列埠匯流排標準

3、標準中第4部分-射頻模組介面:

主要包括介面型別以及射頻介面模組與SAM_V模組之間通訊,請求和應答等。

4、標準中第5部分-業務終端介面

主要包括介面、通訊方式、資料傳輸格式和命令及應答等。

相關推薦

NFC身份證識別(二)

1、首先需要了解身份證閱讀器的工作原理與流程。 詳見《居民身份證驗證安全控制模組介面技術規範》,標準GA 467-2004。 大致原理圖: sam_v:驗證安全控制模組(secure access and control module for validation) 2、並行與序列: 序列介面:

NFC身份證識別(三)

com 模塊 函數 開發 業務 身份證 height src eight 疑問: 1、廠家提供的開發手冊中主要給了SAM_V(驗證安全控制模塊)接口函數說明,主要為業務終端與SAM_V之間的接口,實現下圖功能。 但是SAM_V如何通過射頻模塊與身份證通信,這塊如何實現以及

JAVA識別身份證號碼,H5識別身份證號碼,tesseract-ocr識別(二)

背景介紹 上一篇博文介紹瞭如何使用JAVA識別身份證號碼,假設在截取了身份證號碼資訊的情況下,這一篇博文主要討論一下思路吧,技術方面都是大家會的。 思路分析 H5拍照上傳 —> 服務端擷取身份證號碼 —–> 識別號碼 —–>

NLPCC2013中文微博細粒度情感識別(二)

token special 環境 美化 lin pil real param annotate 偷懶若幹天後回歸。。在上一篇中我們得到了NLPCC2013的中文微博數據,將其按照8:1:1的比例分成了訓練集,驗證集和測試集。下一步就是對數據進行預處理以及embedding。

Android-谷歌語音識別之離線識別(二)

1/上一篇部落格寫了安卓呼叫本地自帶的谷歌語音識別,但是需要聯網並且在大陸需要翻牆,這文章來講下如何離線進行谷歌的語音識別。 2/因為已經有了上一篇的demo和程式碼,程式碼方面就不多說了。 3/用谷歌離線識別需要下載谷歌離線包,所以一樣需要帶谷歌服務的機子,比如三星。

計算機視覺與模式識別(二)色彩遷移

色彩遷移 這一個學期任務量比較大,主要是計算機視覺這門課和計算機圖形學任務量有點大,所以暑假才有時間更新這系列部落格,這系列部落格主要是利用CImg這個庫來實現一些演算法,而不是應用一些演算法。 下面開始本期的介紹! 1.什麼是色彩遷移? 對於搞CV(Compu

tensorflow實現驗證碼識別(二)

tfrecords 由於有個5W張圖片的訓練集,如果是placeholder的方式來把資料餵給graph的話,那可真蠢。。所以不如用tensorflow官方推薦的tfrecords來進行IO。這種IO方式主要是兩步: 1.先把資料dump成tfrecords檔案 2.用佇列來把資料餵

論文筆記:語音情感識別(二)聲譜圖+CRNN

一:An Attention Pooling based Representation Learning Method for Speech Emotion Recognition(2018 InterSpeech) (1)論文的模型如下圖,輸入聲譜圖,CNN先用兩個不同的卷積核分別提取時域特徵和頻域特徵,c

專案二 CIFAR10與ImageNet影象識別(二)

2.使用tensorflow訓練CIFAR10識別模型 2.1資料增強 通過平移、旋轉、翻轉、裁剪、縮放、顏色變換等資料操作可以增加資料庫的數量,同時也能大大提高模型的泛化能力,並且可以預防過擬合。在應用這個方法的時候,我們可以使用以下方法: # 隨機剪裁 di

java實現opencv人臉識別(二)

Java下使用opencv進行人臉檢測 工作需要,研究下人臉識別,發現opencv比較常用,儘管能檢測人臉,但識別率不高,多數是用來獲取攝像頭的視訊流的,提取裡面的視訊幀,實現人臉識別時通常會和其他框架搭配使用,比如face_recognition、SeetaFace En

MNIST手寫數字識別(二)幾種模型優化方式介紹

本篇的主要內容有: 動態衰減法設定可變學習率 為損失函式新增正則項 滑動平均模型介紹 為了讓MNIST數字識別模型更準確,學習幾種常用的模型優化手段: 學習率的優化 學習率的設定一定程度上也會影響模型的訓練,如果學習率過小,那麼將會經過很長時間才會收斂到想要

第6章 RFID標籤識別(二)

c#中編碼與資料型別的轉換 Encoding:位元組編碼類 Convert:基本資料型別轉換成類 BitConverter:位元組陣列轉換 (一)讀寫標籤的使用。 1.ReadTag函式 語法:ReadTag(IntPtr hCom,byte memBank,by

OpenCV儀表資料識別(二):數字區域自動定位

下載和配置Opencv在網上和書上有很多的講解,這裡不再贅述。 此處附上Opencv的下載連結。 想要對圖片中的數字資訊進行識別首先要對圖片進行預處理,排除干擾的因素,只留下有價值的資訊。 這裡需要兩張圖,一張為有資料的圖片,一張為儀表關閉時沒有資料的圖

3D手勢識別(二)左右、上下滑動判斷

場景:前裝攝像頭。 檢測目標:檢測手左右滑動狀態,手沿x方向滑動,z軸為深度方向,y、z方向相對穩定。 手上下滑動類似。 步驟: 一、影象識別檢測手,左右滑取最上點/上下滑取得手的最前點; 二、資料處理:中值濾波、平滑處理和卡

人臉識別(二)——訓練分類器

上一篇簡單整理了下人臉識別的相關基礎知識,這一篇將著重介紹利用pencv(2.4.9)已有的模型進行分類器訓練。 一、關於ORL人臉資料庫 ORL是一個40個人,每人採取10張人臉頭像構成的一

手勢識別(二)--單目手勢識別演算法總結

手勢有三個主要特徵:手型,方向,運動軌跡 一個基於視覺手勢識別系統的構成應包括:影象的採集,預處理,特徵提取和選擇,分類器的設計,以及手勢識別。其流程大致如下: 上面識別過程,再分解為: 其中有三個步驟是識別系統的關鍵,分別是預處理時手勢的分割,特徵提取和選擇,手勢跟

基於tensorflow的MNIST手寫數字識別(二)--入門篇

一、本文的意義 因為谷歌官方其實已經寫了MNIST入門和深入兩篇教程了,那我寫這些文章又是為什麼呢,只是抄襲?那倒並不是,更準確的說應該是筆記吧,然後用更通俗的語言來解釋,並且補充

【機器學習】人像識別(二)——PCA降維

降維沒有什麼祕訣。我用了python裡sklearn.decomposition模組的IncrementalPCA。 程式碼如下: X = np.array(dots) # do

在YOLO2中增加自己的物體識別(二)

在上一篇在YOLO2中增加自己的物體識別(一)中我們已經得到了一個影象集,在你的Images/myobject目錄下, 一個對該影象集的標註資訊,在你的outpath目錄下, 現在把這2個目錄下的jpeg和txt檔案合併到一個資料夾,我這裡是放到darkne目錄

opencv 人臉識別 (二)訓練和識別

上一篇中我們對訓練資料做了一些預處理,檢測出人臉並儲存在\pic\color\x資料夾下(x=1,2,3,...類別號),本文做訓練和識別。為了識別,首先將人臉訓練資料 轉為灰度、對齊、歸一化,再放入分類器(EigenFaceRecognizer),最後用訓練出的model進