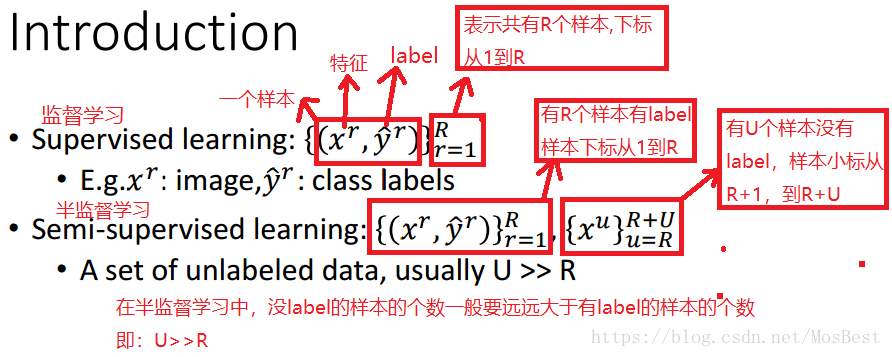

Semi-supervised Learning ;半監督學習

1. 進入半監督學習

2. 半監督學習 出現的原因???

原因:收集樣本資料容易,但是給每個樣本打標籤 成本就很高。

Collecting data is easy, but collecting “labelled” data is expensive.

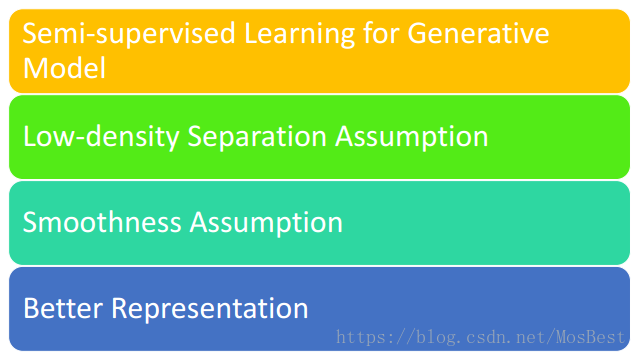

3. 本篇部落格講解的半監督學習的內容?

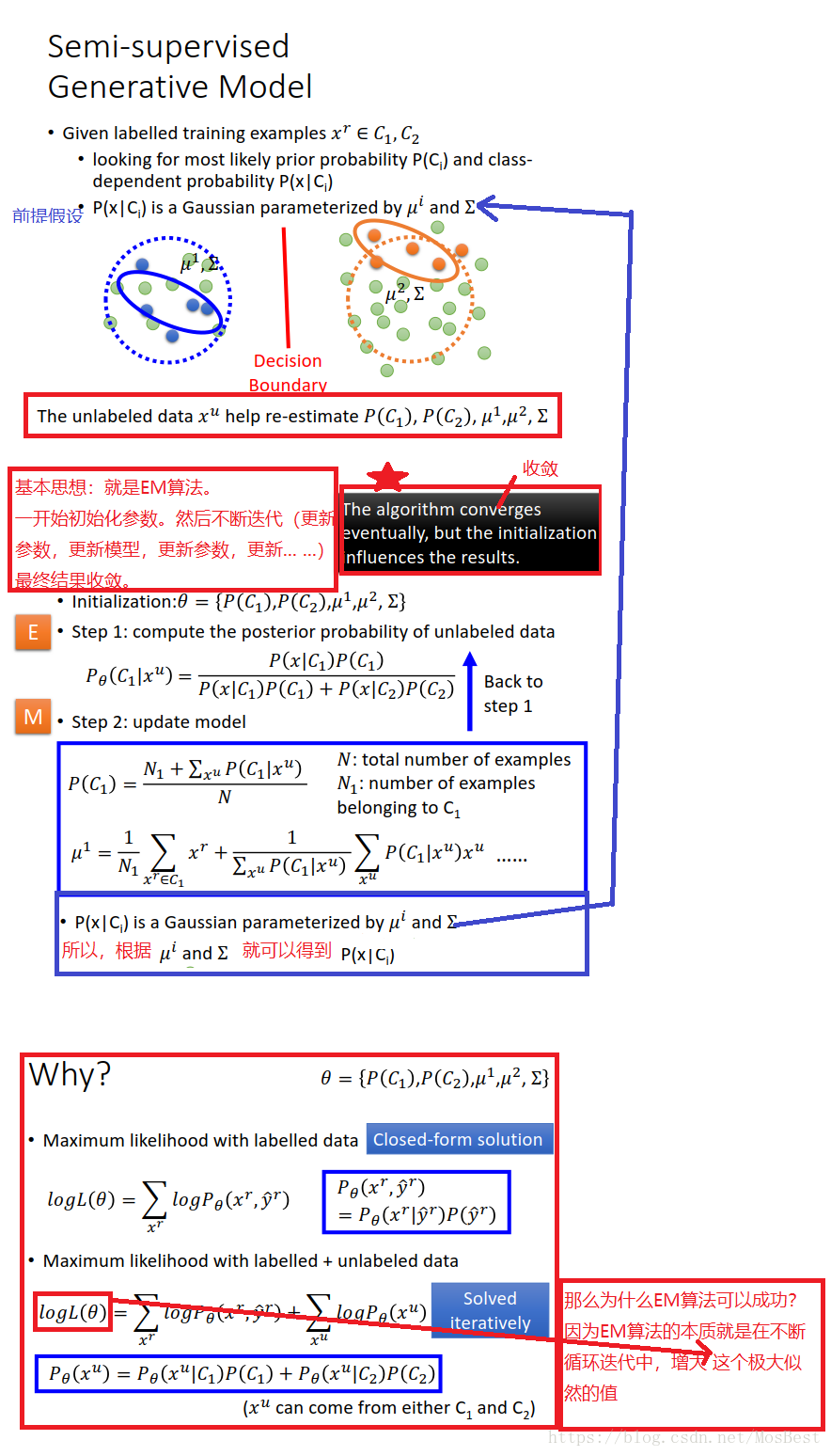

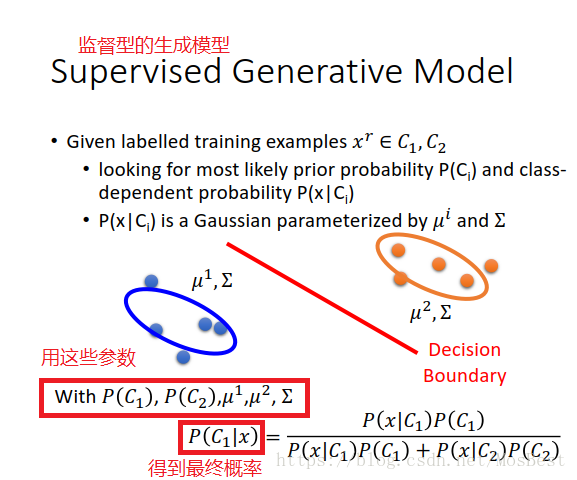

3.1 Semi-supervised Learning for Generative Model(生成式模型)

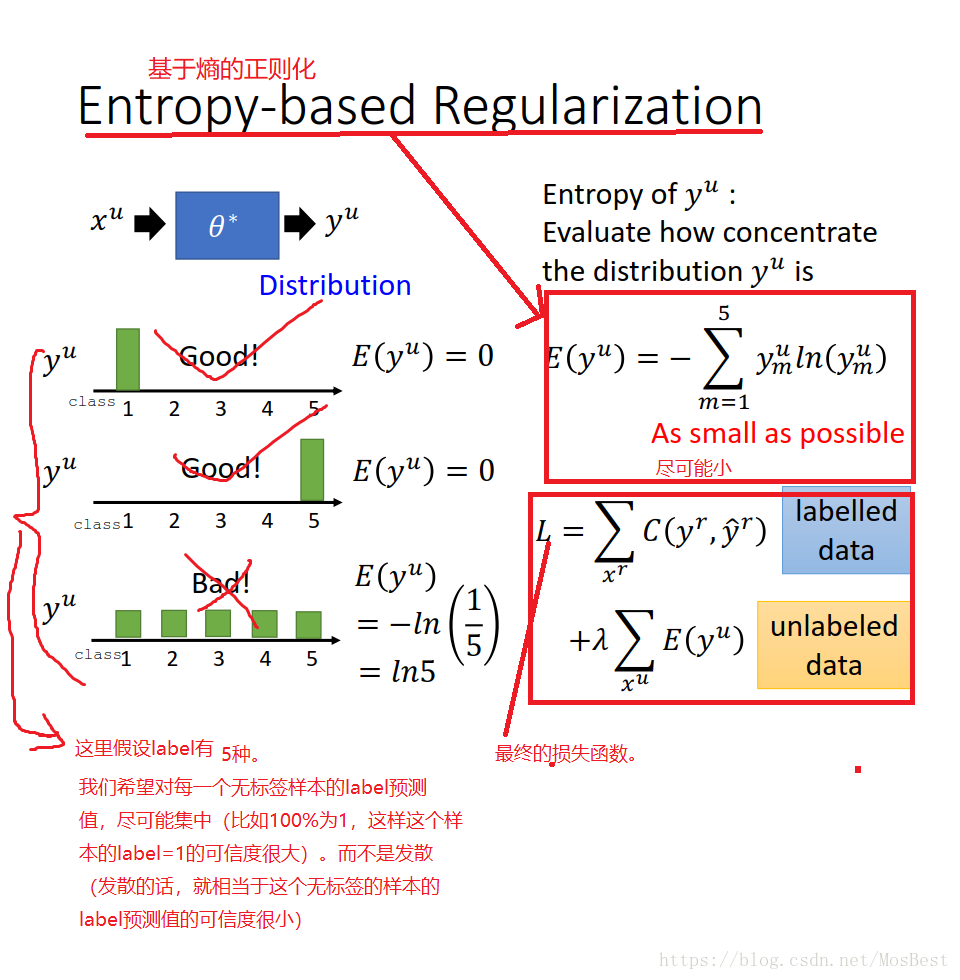

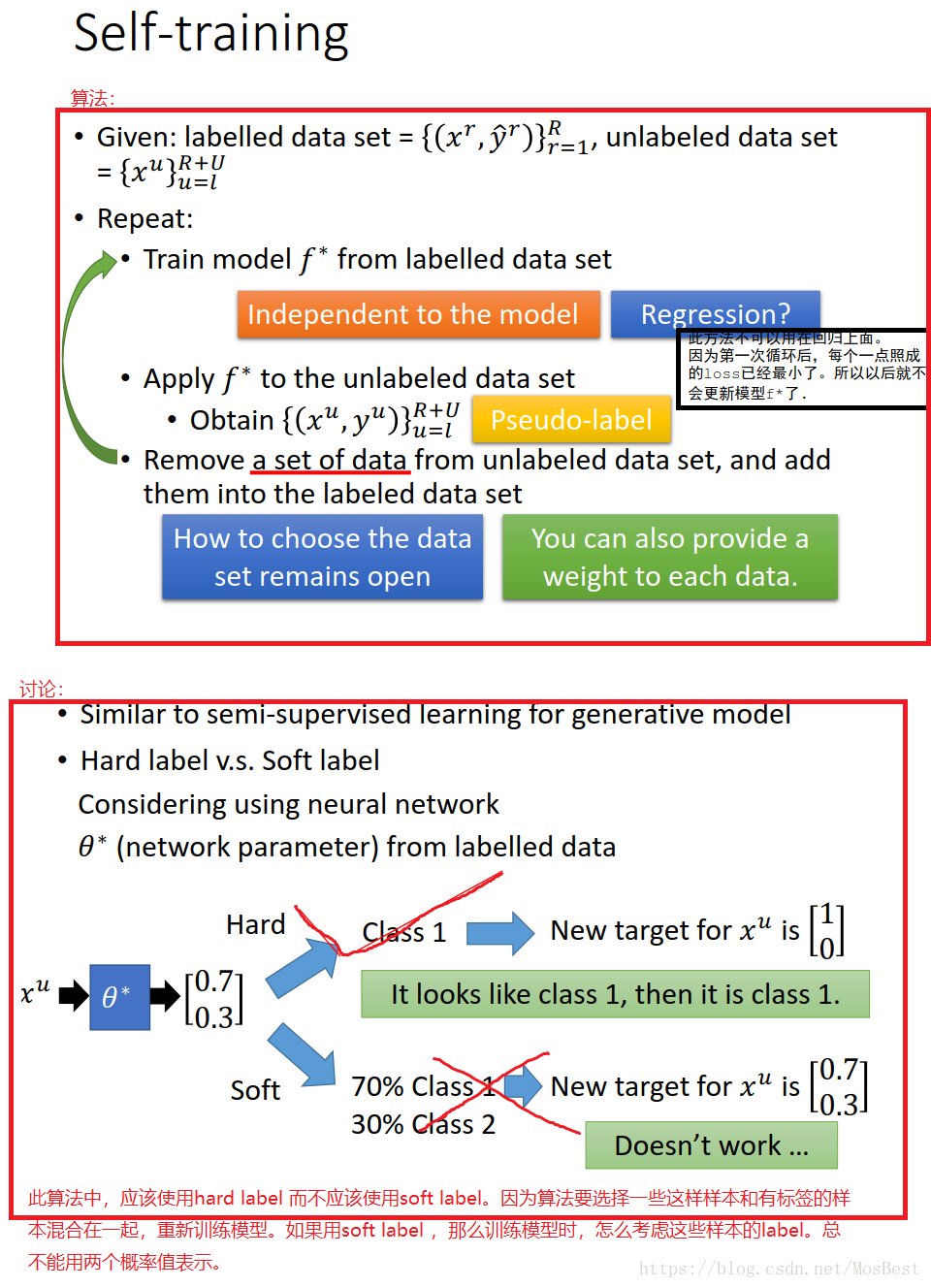

3.2Semi-supervised Learning for Low-density Separation

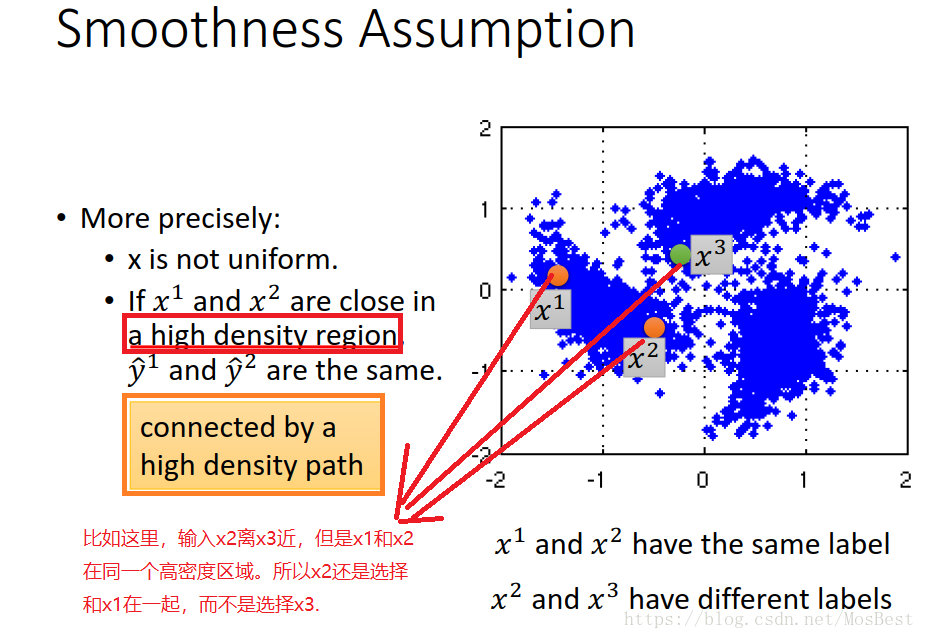

3.3 Semi-supervised Learning for Smoothness Assumption

概述

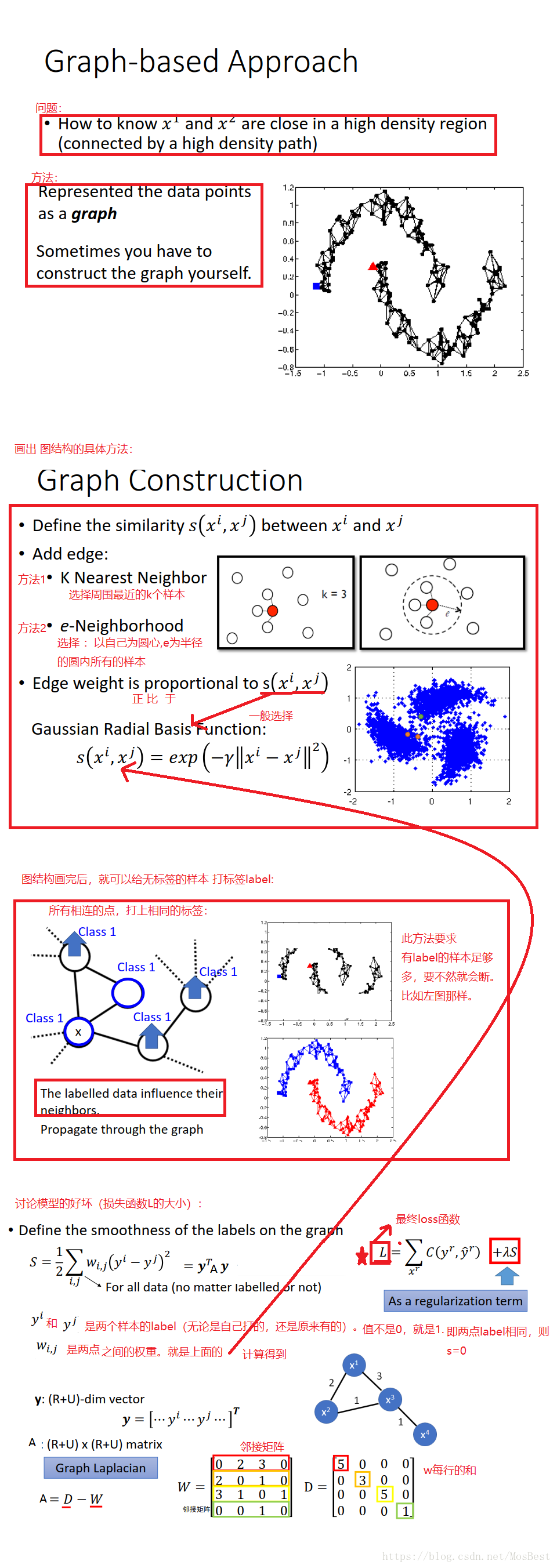

How to know ��1 and ��2 are close in a high density region

3.4 Semi-supervised Learning for Better Representation

意思是:看似複雜的東西,其實他的本質是 很簡單的。所以,找到複雜事物的本質,僅僅對他的本質(簡單的)進行處理。

相關推薦

Semi-supervised Learning ;半監督學習

1. 進入半監督學習 2. 半監督學習 出現的原因??? 原因:收集樣本資料容易,但是給每個樣本打標籤 成本就很高。 Collecting data is easy, but collecting “labelled” data is expensive. 3. 本篇

Strong Baselines for Neural Semi-supervised Learning under Domain Shift半監督學習

2018 ACL 論文 Strong Baselines for Neural Semi-supervised Learning under Domain Shift 不同資料集的遷移學習 MT-Tri方法在情感分析上(無監督域適應)超過DANN方法 半監督學習結合了監督學習和無監督學

機器學習與深度學習系列連載: 第一部分 機器學習(十三)半監督學習(semi-supervised learning)

在實際資料收集的過程中,帶標籤的資料遠遠少於未帶標籤的資料。 我們據需要用帶label 和不帶label的資料一起進行學習,我們稱作半監督學習。 Transductive learning:沒有標籤的資料是測試資料 Inductive learning:沒有標

【GAN ZOO翻譯系列】Cat GAN:UNSUPERVISED AND SEMI-SUPERVISED LEARNING WITH CATEGORICAL GAN 用於監督和半監督學習的GAN

Jost Tobias Springenberg 弗萊堡大學 79110 Freiburg, Germany [email protected] 原文連結https://arxiv.org/abs

【論文解讀】【半監督學習】【Google教你水論文】A Simple Semi-Supervised Learning Framework for Object Detection

題記:最近在做LLL(Life Long Learning),接觸到了SSL(Semi-Supervised Learning)正好讀到了谷歌今年的論文,也是比較有點開創性的,淺顯易懂,對比實驗豐富,非常適合缺乏基礎科學常識和剛剛讀研不會寫論文的同學讀一讀,觸類旁通嘛。 這篇論文思路等等也非常適合剛剛開始

機器學習15:半監督學習semi-supervised

一、why semi-supervised dataset中只有部分資料進行了lable標註,即,有的資料成對出現{輸入,輸出},有的資料只有輸入{輸入}; Transductive learning(直推試學習):unlabled資料作為測試集; Inductive learning(

從零開始-Machine Learning學習筆記(29)-半監督學習

文章目錄 1. 生成式方法 2. 半監督SVM(Semi-Supervised Support Vector Machine, S3VM) 3. 圖半監督學習 3.1 針對於二分類問題的標記傳播

監督學習,無監督學習和半監督學習

思想 learn 尋找 很多 ear 目標 dsm 工作 變量 概念:監督學習、無監督學習與半監督學習 監督學習 : supervised learning 無監督學習 : unsupervised learning 半監督學習 : semi-supervised le

詳解使用EM算法的半監督學習方法應用於樸素貝葉斯文本分類

post target 集中 之間 大量 ise 網上 tar 多項式 1.前言 對大量需要分類的文本數據進行標記是一項繁瑣、耗時的任務,而真實世界中,如互聯網上存在大量的未標註的數據,獲取這些是容易和廉價的。在下面的內容中,我們介紹使用半監督學習和EM算法,充分結合大

有監督學習、無監督學習、半監督學習

class tail detail 局部特征 連續 tails cannot 得到 ica 1.有監督學習:教計算機如何做事情。 對於機器學習來說,有監督學習就是訓練數據既有特征又有標簽,通過訓練,讓機器可以自己找到特征和標簽之間的聯系,在面對只有特征沒有標簽的數據時,

sklearn半監督學習

摘要:半監督學習很重要,為什麼呢?因為人工標註資料成本太高,現在大家參加比賽的資料都是標註好的了,那麼如果老闆給你一份沒有標註的資料,而且有幾百萬條,讓你做個分類什麼的,你怎麼辦?不可能等標註好資料再去訓練模型吧,所以你得會半監督學習演算法。 不過我在這裡先打擊大家一下,用sklearn的包做不

偽標籤:教你玩轉無標籤資料的半監督學習方法

對於每個機器學習專案而言,資料是基礎,是不可或缺的一部分。在本文中,作者將會展示一個名為偽標籤的簡單的半監督學習方法,它可以通過使用無標籤資料來提高機器學習模型的效能。 偽標籤 為了訓練機器學習模型,在監督學習中,資料必須是有標籤的。那這是否意味著無標籤的資料對於諸如分類和迴歸之類的監督任務

【IM】關於半監督學習的理解

基於流形假設的半監督學習:假定輸入概率密度p(x)和條件概率密度p(y|x)之間具有某種關聯,估計p(x)輔助對p(y|x)的估計以提升精度。流形假設,即輸入資料只出現在某個流形上,輸出則在該流形上平滑變化。 拉普拉斯正則化是把輸入資料在流形上進行函式平滑的半監督學習演算法,結合拉普拉斯矩陣(L

半監督學習演算法——標籤傳播演算法(LPA)與其擴充套件

標籤傳播演算法LPA與其擴充套件 1. 什麼是標籤傳播演算法? 標籤傳播演算法(Label Propagation Algorithm,LPA,2007)是基於圖的一種標籤演算法,也是社群發現(Community Detection)領域的一種經典方法。社群發現是為

半監督學習演算法——ATDA(Asymmetric Tri-training for Unsupervised Domain Adaptation)

Asymmetric Tri-training for Unsupervised Domain Adaptation (2017 ICML)論文筆記 Abstract Tri-training(周志華,2005, 無監督學習領域最經典、知名度最高的做法)利用三個分類器按

目標追蹤論文之狼吞虎嚥(5):基於張量的圖嵌入半監督學習及其在判別式目標追蹤的應用

一、摘要 作者將一個影象(image patch)看做是一個保留了原始影象結構的二階張量,然後設計了兩個圖來描繪目標和背景所在的張量樣本中固有的區域性幾何結構,從而構建一個判別式嵌入空間。圖嵌入可以在降低張量維度的同時保留著圖的結構。此外,作者提出了兩種思路(?)用來尋找原始張量樣

【GCN】圖卷積網路的半監督學習脈絡

1、入門: 知乎回答:從CNN到GCN的聯絡與區別——GCN從入門到精(fang)通(qi) 2、論文閱讀: 論文地址:SEMI-SUPERVISED CLASSIFICATION WITH GRAPH CONVOLUTIONAL NETWORKS 論文翻譯1:圖卷積神經網路的半監督

[深度學習]半監督學習、無監督學習之Autoencoders自編碼器(附程式碼)

目錄 自編碼器介紹 從零開始訓練自編碼器 驗證模型訓練結果 視覺化結果 載入預訓練模型 自編碼器介紹 自編碼器的結構簡單,由Encoder和Decoder組成,Encoder產生的Latent variables是潛在變數,它是Decoder的輸入。

[深度學習]半監督學習、無監督學習之DCGAN深度卷積生成對抗網路(附程式碼)

論文全稱:《Generative Adversarial Nets》 論文地址:https://arxiv.org/pdf/1406.2661.pdf 論文全稱:《UNSUPERVISED REPRESENTATION LEARNING WITH DEEP CONVOLUTIONAL GEN

主動學習,半監督學習的概念的區分

(一)從概念上區分 主動學習(active learning) 學習器能夠主動選擇包含資訊量大的未標註的樣例並將其交由專家進行標註,然後置入訓練集進行訓練,從而在訓練集較小的情況下獲得較高的分類正確率,這樣可以有效的降低構建高效能分類器的代價。 學習器能夠主動的提出一些標註請求,將一些經