Android 使用Rtmp音視訊推流(002)

前言

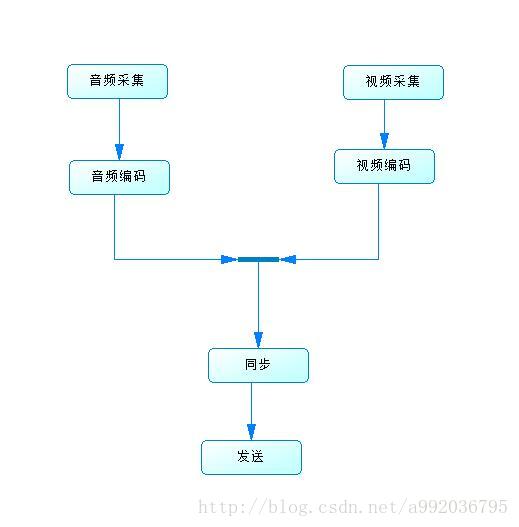

本文介紹的是使用Android攝像頭、麥克風採集的音、視訊進行編碼。然後通過librtmp推送到流媒體伺服器上的功能。

我所使用的環境:Android Studio 2.2.3 、NDK13。

流程

使用到的Api

- 音視訊採集用到的api有:Camera、AudioRecord

- 編碼用的是系統提供的API:MediaCodec (硬編碼)

- 推送使用的開源庫:librtmp。

程式碼

ManActivity.Java

public class MainActivity extends AppCompatActivity implements SurfaceHolder 相關推薦

Android 使用Rtmp音視訊推流(002)

前言 本文介紹的是使用Android攝像頭、麥克風採集的音、視訊進行編碼。然後通過librtmp推送到流媒體伺服器上的功能。 我所使用的環境:Android Studio 2.2.3 、NDK13。 流程 使用到的Api 音視訊採集用到的api有:Camera、AudioRecord編

Android WebRTC 音視訊開發總結(二)

1 public void setTrace(boolean enable, VideoEngine.TraceLevel traceLevel) { 2 if (enable) { 3 vie.setTraceFile("/sdcard/trace.txt", f

Android 音視頻深入 十五 FFmpeg 實現基於Rtmp協議的推流(附源碼下載)

音視頻 FFmpeg Rtmp 推流 源碼地址https://github.com/979451341/Rtmp 1.配置RTMP服務器 這個我不多說貼兩個博客分別是在mac和windows環境上的,大家跟著弄MAC搭建RTMP服務器https://www.jianshu.com/p/6fce

1小時學會:最簡單的iOS直播推流(九)flv 編碼與音視訊時間戳同步

最簡單的iOS 推流程式碼,視訊捕獲,軟編碼(faac,x264),硬編碼(aac,h264),美顏,flv編碼,rtmp協議,陸續更新程式碼解析,你想學的知識這裡都有,願意懂直播技術的同學快來看!! 前文介紹瞭如何獲取音視訊的aac/h2

Nginx-RTMP推流(video)

Camera 採集資料 Camera負責採集資料,把採集來的資料交給 X264進行編碼打包給RTMP進行推流, Camera採集來的資料是NV21, 而X264編碼的輸入資料格式為I420格式。 NV21和I420都是屬於YUV420格式。而NV21是一種two-plane模式,即Y和UV分為兩個Pla

Nginx-RTMP推流(audio)

需要文中完整程式碼的可以前往Github上獲取,順便給個star唄。 AAC編碼 推送音訊跟推送視訊差不多,經過資料採集,編碼,然後通過RTMP推流。資料採集通常有兩種方式,一種是Java層的AudioRecord,另一種是native層opensl es;採集完後就是編碼,相比視訊比較簡單,編碼庫這

Android端實現多人音視訊聊天應用(一)

本文轉載於資深Android開發者“東風玖哥”的部落格。 本系列文章分享了基於Agora SDK 2.1實現多人視訊通話的實踐經驗。 轉載已經過原作者許可。原文地址 自從2016年,鼓吹“網際網路寒冬”的論調甚囂塵上,2017年亦有愈演愈烈之勢。但連麥直播、線上抓娃

一個直播例子:快速整合iOS基於RTMP的視訊推流

效果圖 iTools有點卡, 但是推到伺服器倒是很快的. 推流 前言 這篇blog是iOS視訊直播初窺:<喵播APP>的一個補充. 因為之前傳到github上的專案中沒有整合視訊的推流.有很多朋友簡信和微博上問我推流這部分怎麼實現的. 所以, 我重新集成了RTMP的推流, 合併到了

iOS:基於RTMP的視訊推流

iOS基於RTMP的視訊推流 一、基本介紹 iOS直播一出世,立馬火熱的不行,各種直播平臺如雨後春筍,正因為如此,也同樣帶動了直播的技術快速發展,在IT界精通直播技術的猴子可是很值錢的。直播技術涉及的知識面很廣,最主要的大概就是這幾個:軟硬解碼.h264、美顏處理、推流RTMP、拉流播放、視訊錄製、傳送彈幕

深入理解Android音視訊同步機制(四)MediaSync的使用與原理

MedaiSync是android M新加入的API,可以幫助應用視音訊的同步播放,如同官網介紹的 From Andriod M: MediaSync: class which helps applications to synchronously r

JMeter擴充套件Java請求實現WebRTC本地音視訊推流壓測指令碼

WebRTC是Web Real-Time Communication縮寫,指網頁即時通訊,是一個支援Web瀏覽器進行實時語音或視訊對話的API,實現了基於網頁的視訊會議,比如聲網的Agora Web SDK就是基於WebRTC實現音視訊通訊的。與HTTP不同,WebRTC應用的主要壓力是碼流,JMeter沒有

Android視音頻編碼器(2)——cameraYUV、AudioRecordPCM分別編碼後muxer成mp4

效率 androi mar 視音頻 pop 采集 con 文章 cpu 參考下面這篇文章: http://blog.csdn.net/a992036795/article/details/54286654 一、前言 上一篇文章我講到,我用libx264對視頻

音視訊開發系列(一)

人類的五官能夠直接感受聲音和影象,但計算機只能認識二進位制。在音視訊的開發過程中,我們必須將聲音和影象編碼為二進資料流,才能讓計算機識別,進而加工處理、傳輸和儲存;計算機上為人類服務的,儲存的音視訊資料被使用者獲取後,需要重新解碼為人類能夠直接感受的聲音、影象。 大連哪個醫院看婦

從零開始學習音視訊程式設計技術(四) FFMPEG的使用

零開始學習音視訊程式設計技術(四) FFMPEG的使用 音視訊開發中最常做的就是編解碼的操作了,以H.264為例:如果想要自己實現編碼h.264,需要對H.264非常的瞭解,首先需要檢視H.264的文件,這個文件好像說是三百多頁(本人並沒有看過)。 想到這

從零開始學習音視訊程式設計技術(一) 視訊格式講解(學習筆記)

/* 該型別部落格為學習時載錄筆記,加上自己對一些不理解部分自己的理解。會涉及其他博主的博文的摘錄,會標註出處 */ ==========================================================================

從零開始學習音視訊程式設計技術(二) 音訊格式講解

1. 音訊簡介 前面我們說過視訊有一個每秒鐘採集多少張的概念,這就叫做視訊的幀率。 和視訊的幀率一樣的道理,聲音也有一個頻率,叫做取樣率。 人對頻率的識別範圍是 20HZ - 20000HZ, 如果每秒鐘能對聲音做 20000 個取樣, 回放

百度雲音視訊直播服務(LSS)的使用流程

音視訊直播LSS(Live Streaming Service)是一個直播PaaS服務平臺,旨在幫助企業及個人開發者快速搭建自己的直播平臺及應用,關於LSS的相關介紹請採參考百度雲官網指導文件:https://cloud.baidu.com/doc/LSS/ProductDe

基於webrtc多人音視訊的研究(一)

基於webrtc多人音視訊的研究 眾所周知,WebRTC非常適合點對點(即一對一)的音視訊會話。然而,當我們的客戶要求超越一對一,即一對多、多對一設定多對多的解決方案或者服務,那麼問題就來了:“我們應該採用什麼樣的架構?” 。簡單的呢有人會考慮copy多個p2p就完

從零開始學習音視訊程式設計技術(七) FFMPEG Qt視訊播放器之SDL的使用

前面介紹了使用FFMPEG+Qt解碼視訊並顯示。 現在我們就著手給它加上聲音播放。 播放聲音有很多種方式: 以windows系統為例,可以使用如下方法播放音訊: 1.直接呼叫系統API的wavein、waveout等函式 2.使用directsound播放

從零開始學習音視訊程式設計技術(一) 視訊格式講解

所謂視訊,其實就是將一張一張的圖片連續的放出來,就像放幻燈片一樣,由於人眼的惰性,因此只要圖片的數量足夠多,就會覺得是連續的動作。 所以,只需要將一張一張的圖片儲存下來,這樣就可以構成一個視訊了。 但是,由於目前網路和儲存空間的限制,直接儲存圖片顯然不可行。