Hadoop分散式檔案系統利用 java API 實現

(前提:自己的linux系統中的叢集已搭建完畢 )

1 . 首先在電腦中安裝 hadoop

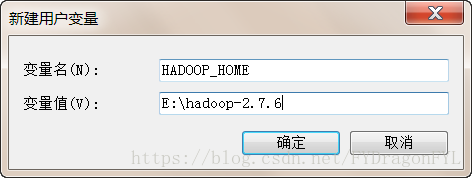

配置環境變數:

右鍵點選“計算機”--> 屬性 --> 高階系統設定 --> 環境變數

建立一個 “HADOOP_HOME”,值為hadoop安裝包的路徑

在“Path”的變數值的最前面,追加{ hadoop-2.7.6\bin } 的路徑。(如果沒有Path,建立一個Path,新增以下內容)

Path=%HADOOP_HOME%\bin;2 . 查詢 hadoop 所需要的jar包

在 { hadoop\share } 目錄下 ,搜尋 <.jar>, 複製後拷貝至{ hadoop-2.7.6 }/_ jar 資料夾備用

在{hadoop_home}/_jar/目錄下查詢<sources>檔案,剪下後拷貝至{hadoop-2.7.6}/_sources/ 備用

在{hadoop_home}/_sources/目錄下查詢<test>檔案,剪下後拷貝至{hadoop-2.7.6}/_test/ 備用

( _jar : jar包 、 _source : 原始碼包 、 _test : 測試包 )

3 . 整合eclipse環境

上網下載 hadoop-eclipse-plugin 的jar包,將此jar包拷貝至{ eclipse_home }/plugin 下。

(eclipse_home 為eclipse所安裝的路徑)

4 . 重啟eclipse

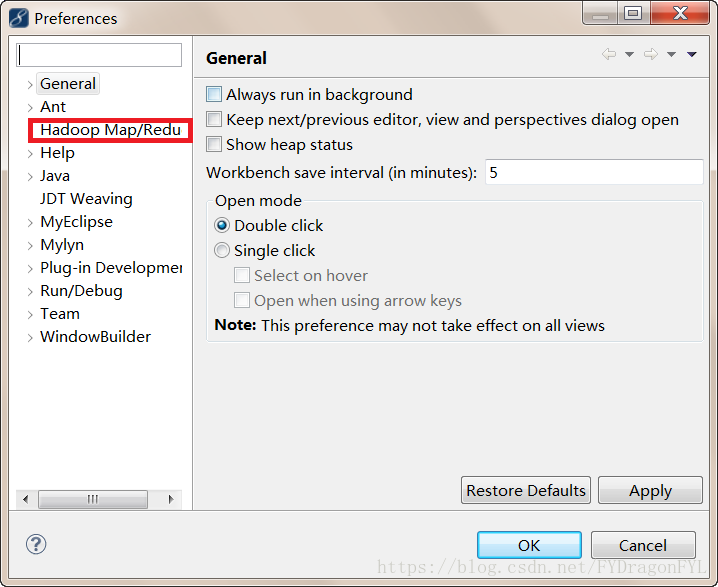

5 . 校驗安裝是否成功

檢視windows-->perferences 是否出現 Hadoop Map/Reduce

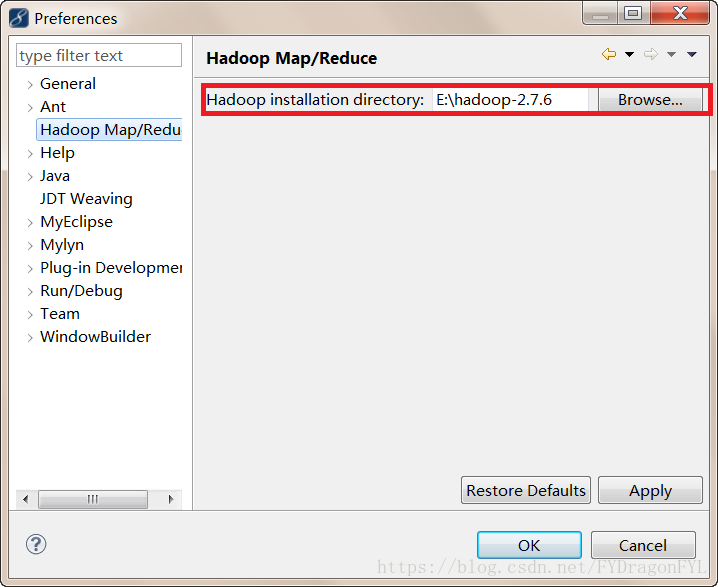

6 . 在【hadoop Mapreduce】檢視下,新增hadoop的安裝路徑

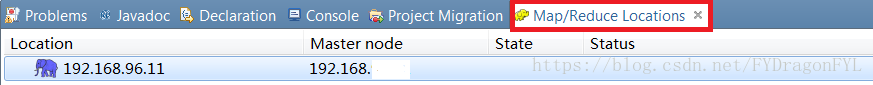

7 . 建立hadoop的連結

a>.開啟【MapReduce Locations】檢視-->右鍵【新建hadoop Location...】-->彈出編輯視窗

b>.dfs RPC 協議埠號為:9000 【注:預設為8020】

mapreduce RPC協議埠號為:9001 【注:預設為8021】

user name:XXXX 【注:叢集名字】

host :主節點的 IP

8 . 配置windows Hadoop工具包

上網下載 hadoop.dll和winutils.exe 兩個檔案,並將其拷貝至{hadoop-2.7.6}\bin;

恭喜你。配置成功~