python中安裝配置pyspark庫教程需要配合spark+hadoop使用

單獨安裝pyspark庫在單機上是沒法執行的,需要有相應的分散式軟體,這裡可以是spark+hadoop,配置安裝教程連結:spark2.3在window10當中來搭建python3的使用環境pyspark

- 配置pyspark庫

之前在安裝spark的時候,提到過pyspark庫的安裝有幾種方法,一種方法是直接將spark自帶的pyspark庫安裝到python的庫當中去;一種是使用命令pip install pyspark安裝;還有一種是單獨下載pyspark的安裝包,解壓以後安裝到python庫當中去。這幾種方法,這裡都會進行講解。

將spark自帶的pyspark庫安裝到python:

以管理員身份開啟cmd,按一下鍵盤上的window鍵,依次選中Windows 系統,右鍵命令提示符,點選更多,點選以管理員身份執行

C:\>cd D:\spark\python

C:\>d:

D:\spark\python>

D:\spark\python>python setup.py install

出現這個圖時pyspark就安裝好了

pip install pyspark命令列方式安裝:

同上面開啟cmd的方式相同,需要以管理員身份執行,按一下鍵盤上的window鍵,依次選中Windows 系統,右鍵命令提示符,點選更多,點選以管理員身份執行

輸入命令 pip install pyspark,等待安裝完成,這裡需要注意的是,pyspark本身的安裝包占用磁碟空間很多,有幾百M,這種方式安裝需要線上下載pyspark,網速不錯的話,是非常推薦的,這種方式最簡單,只需要一行命令就行了。

單獨下載安裝pyspark:

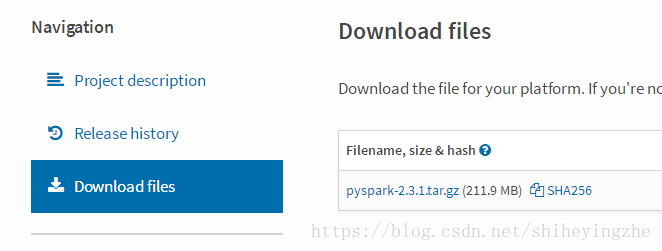

進入pyspark的PyPI的網站,點選左側的Download files,下載pyspark的安裝包,然後解壓好,這裡解壓的路徑是D:\pyspark-2.3.1

同上面開啟cmd的方式相同,需要以管理員身份執行,按一下鍵盤上的window鍵,依次選中Windows 系統,右鍵命令提示符,點選更多,點選以管理員身份執行

進入解壓以後資料夾的目錄

D:\pyspark-2.3.1>python setup.py install

以上幾種方式都可以安裝pyspark,其中最方便的方式是使用命令列 pip install pyspark,pyspark的WordCount示例連結: