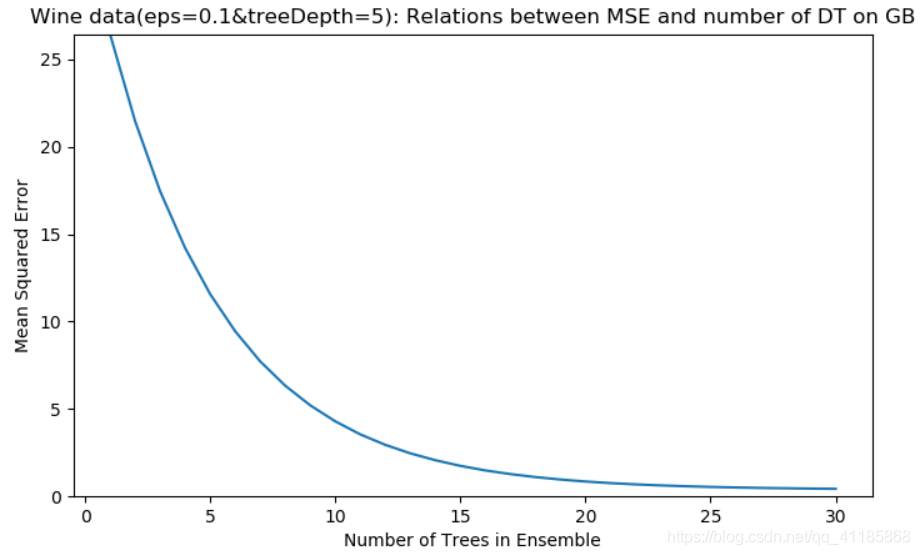

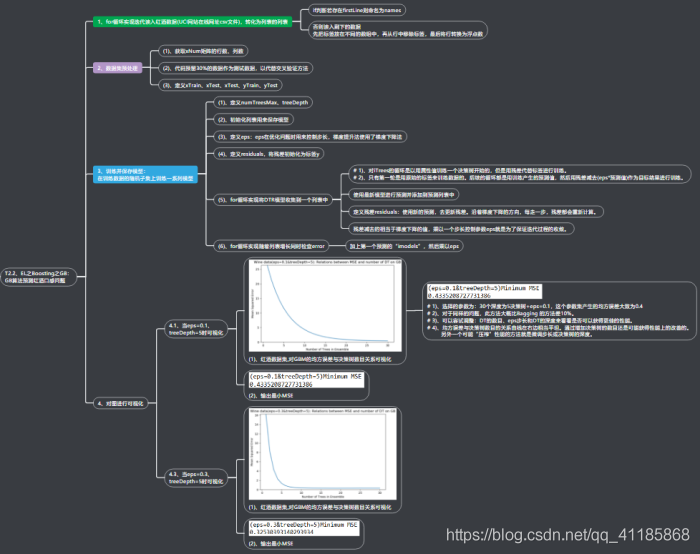

EL之Boosting之GB:利用梯度提升法解決迴歸(對多變數的資料集+實數值評分預測)問題

EL之Boosting之GB:利用梯度提升法解決迴歸(對多變數的資料集+實數值評分預測)問題

輸出結果

![]()

設計思路

核心程式碼

xList = [] labels = [] names = [] firstLine = True for line in data: if firstLine: names = line.decode().strip().split(";") firstLine = False else: row = line.decode().strip().split(";") labels.append(float(row[-1])) row.pop() floatRow = [float(num) for num in row] xList.append(floatRow)

相關推薦

EL之Boosting之GB:利用梯度提升法解決迴歸(對多變數的資料集+實數值評分預測)問題

EL之Boosting之GB:利用梯度提升法解決迴歸(對多變數的資料集+實數值評分預測)問題 輸出結果 設計思路 核心程式碼 xList = [] labels = [] names = [] firstLine = T

EL之隨機性的Bagging:利用隨機選擇屬性的bagging方法解決迴歸(對多變數的資料集+實數值評分預測)問題

EL之隨機性的Bagging:利用隨機選擇屬性的bagging方法解決迴歸(對多變數的資料集+實數值評分預測)問題 輸出結果 設計思路 核心程式碼 for iTrees in range(numTreesMax):

EL之GB(GBR):利用GBR對迴歸問題(實數值評分預測)建模

EL之GB(GBR):利用GBR對迴歸問題(實數值評分預測)建模 輸出結果 設計思路 核心程式碼 wineGBMModel = ensemble.GradientBoostingRegressor(n_estimators=nEst

EL之Bagging:利用Bagging演算法實現迴歸預測(實數值評分預測)問題

EL之Bagging:利用Bagging演算法實現迴歸預測(實數值評分預測)問題 輸出結果 設計思路 核心思路 #4.1、當treeDepth=1,對圖進行視覺化 #(1)、定義numTreesMax、

EL之RF:利用RandomForestRegressor對迴歸問題(實數值評分預測)建模(調2參)

EL之RF:利用RandomForestRegressor對迴歸問題(實數值評分預測)建模(調2參) 輸出結果 設計思路 核心程式碼 mseOos = [] nTreeList = range(100, 1000, 100)

EL之Bagging(DTR):利用Bagging對迴歸問題(實數值評分預測)建模(調2參)

EL之Bagging(DTR):利用Bagging對迴歸問題(實數值評分預測)建模(調2參) 輸出結果 設計思路 核心程式碼 bagFract = 1.0 #----------------------☆☆☆☆☆

ML之PLiR之Glmnet:利用Glmnet演算法求解ElasticNet迴歸型別問題(實數值評分預測)

ML之PLiR之Glmnet演算法:利用Glmnet演算法求解ElasticNet迴歸型別問題(實數值評分預測) 設計思路 輸出結果 0 2 1 2 2 2 3 3 4 3 5 3 6 3 7 3 8 3 9 2

ML之迴歸預測之BE:利用BE演算法解決迴歸(實數值評分預測)問題—線性方法解決非線性問題

ML之迴歸預測之BE:利用BE演算法解決迴歸(實數值評分預測)問題—線性方法解決非線性問題 輸出結果 設計思路 程式碼實現 for row in xList: newRo

ML之迴歸預測之Lasso:利用Lasso演算法解決迴歸(實數值評分預測)問題—優化模型【增加新(組合)屬性】

ML之迴歸預測之Lasso:利用Lasso演算法解決迴歸(實數值評分預測)問題—優化模型【增加新(組合)屬性】 輸出結果 設計思路 核心程式碼 names[-1] = "a^2" names.append("a*b") nrow

ML之迴歸預測之Lasso:利用Lasso演算法解決迴歸(實數值評分預測)問題—在完整資料集上訓練Lasso模型

ML之迴歸預測之Lasso:利用Lasso演算法解決迴歸(實數值評分預測)問題—在完整資料集上訓練Lasso模型 輸出結果 設計思路 核心程式碼 t=3 if t==1: X = numpy.array(xList

ML之迴歸預測之Lasso:利用Lasso演算法解決迴歸(實數值評分預測)問題—採用10折交叉驗證(測試集error)來評估LassoCV模型

ML之迴歸預測之Lasso:利用Lasso演算法解決迴歸(實數值評分預測)問題—採用10折交叉驗證(測試集error)來評估LassoCV模型 輸出結果 設計思路 核心程式碼 if t==1: X = numpy.ar

ML之分類預測之ElasticNet:利用ElasticNet迴歸對二分類資料集構建二分類器(DIY交叉驗證+分類的兩種度量PK)

ML之分類預測之ElasticNet:利用ElasticNet迴歸對二分類資料集構建二分類器(DIY交叉驗證+分類的兩種度量PK) 輸出結果 設計思路 核心程式碼 #(4)交叉驗證 for ixval in range(

SA:利用SA算法解決TSP(數據是14個虛擬城市的橫縱坐標)問題——Jason niu

坐標 emp 定義 end IT || nbsp per body %SA:利用SA算法解決TSP(數據是14個虛擬城市的橫縱坐標)問題——Jason niu X = [16.4700 96.1000 16.4700 94.4400 20.0

利用蠻力法解決最近對問題

#include<iostream>#include<stack>#include<vector>using namespace std;stack<int> KnapSack(int c,vector<int> w

Keras之MLP:利用MLP【Input(8)→(12)(relu)→O(sigmoid+二元交叉)】模型實現預測新資料(利用糖尿病資料集的八個特徵預測一個0或1)

Keras之MLP:利用MLP【Input(8)→(12)(relu)→O(sigmoid+二元交叉)】模型實現預測新資料(利用糖尿病資料集的八個特徵預測一個0或1) 輸出結果 實現程式碼 # load and prepare the dataset

Keras之DNN:基於Keras(sigmoid+linear+mse+predict)利用DNN實現迴歸預測——DIY多分類資料集&預測新資料點

Keras之DNN:基於Keras(sigmoid+linear+mse+predict)利用DNN實現迴歸預測——DIY多分類資料集&預測新資料點 輸出結果 實現程式碼 # coding:utf-8 Xa=[] Xb=[] for i in ra

ML之PLiR之LARS:利用LARS演算法求解ElasticNet迴歸型別問題—評分預測

ML之PLiR之LARS:利用LARS演算法求解ElasticNet迴歸型別問題—評分預測 設計思路 輸出結果 ['"alcohol"', '"volatile acidity"', '"sulphates"', '"total

ML之PLiR之LARS:利用LARS演算法求解ElasticNet迴歸型別(包括類別編碼+屬性重要程度排序)問題(實數值年齡預測)

ML之PLiR之LARS:利用LARS演算法求解ElasticNet迴歸型別(包括類別編碼+屬性重要程度排序)問題(實數值年齡預測) 輸出結果 設計思路 核心程式碼 xCoded = [] for row i

機器學習教程 之 Boosting 與 bagging:整合學習框架

整合學習是機器學習演算法中非常耀眼的一類方法,它通過訓練多個基本的分類器(如支援向量機、神經網路、決策樹等),再通過基本分類器的決策融合,構成一個完整的具有更強學習分辨能力的學習器。在整合學習中,那些基本學習器一般被稱為為“弱學習器“,機器學習的目的就是通過整合

Spark-MLlib的快速使用之五(梯度提升樹GBT 迴歸)

(1)描述 梯度提升樹(GBT)是決策樹的集合。 GBT迭代地訓練決策樹以便使損失函式最小化。 spark.ml實現支援GBT用於二進位制分類和迴歸,可以使用連續和分類特徵。 (2)測試資料 1 153:5 154:63 155:197 181:20 182:254 183:230 1