Mac下部署單機版spark模式

阿新 • • 發佈:2019-01-09

mac下配置單機版Spark相對比較簡單,首先我們從Spark官網上下載Spark的源程式http://spark.apache.org/downloads.html,在頁面中選擇你需要的版本,本文選擇的是最新版本spark-2.1.0-bin-hadoop2.7.tgz

1、下載完成後解壓到某個目錄下:

tar zxvf spark-2.1.0-hadoop2.7.tgz2、配置spark環境變數

Mac環境變數一般在/etc/profile下配置,開啟profile檔案在檔案中新增。

#SPARK VARIABLES START export SPARK_HOME = /usr/local/spark-2.1.0-hadoop2.7 export PATH = ${PATH}:${SPARK_HOME}/bin #SPARK VARIABLES END

3、配置JVAVA環境

同樣在/etc/profile下配置。將java安裝目錄新增到裡面

export JAVA_HOME = /Library/java/javaVirtualMachines/jdk1.8.0_111.jdk/COntents/Home設定完成後,儲存退出。然後使用source /etc/profile 使環境變數生效。

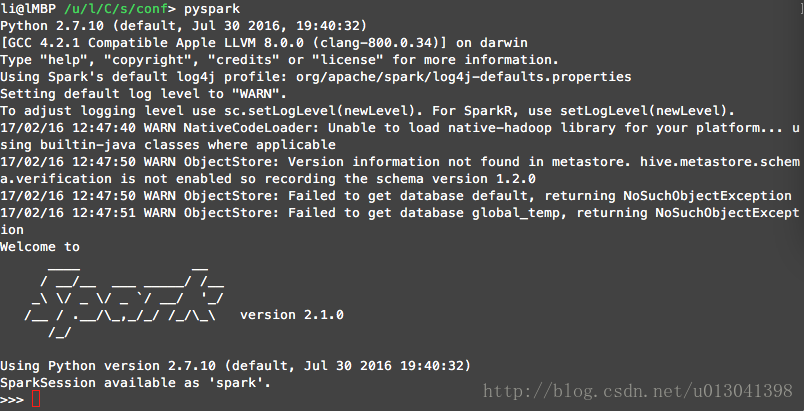

4、測試

開啟終端,輸入

pyspark就會出現下面的畫面。

至此,單機版的pyspark就安裝完成,但是注意的是我們現在配置的是單機版,並沒有涉及spark叢集的配置,所有沒有對spark進行相應的配置,比如設定slaves等。