『演算法學習』輕量級網路MobileNet_v2

前文連結:『演算法學習』深度可分離卷積和MobileNet_v1

一、MobileNet v1 的不足

Relu 和資料坍縮

Moblienet V2文中提出,假設在2維空間有一組由 個點組成的螺旋線

資料,經隨機矩陣

對映到

維並進行ReLU運算,即:

再通過 矩陣的廣義逆矩陣

將

映射回2維空間:

對比 和

發現,當對映維度

時,資料坍塌;當

時,資料基本被儲存。雖然這不是嚴格的數學證明,但是至少說明:channel少的feature map不應後接ReLU,否則會破壞feature map。

簡單說一下上圖:對於一個輸入影象,首先通過一個隨機矩陣T將資料轉換為n維,然後對這n維資料進行ReLU操作,最後再使用T的逆矩陣轉換回來,實驗發現當n很小的時候,後面接ReLU非線性變換的話會導致很多資訊的丟失,而且維度越高還原的圖片和原圖越相似。

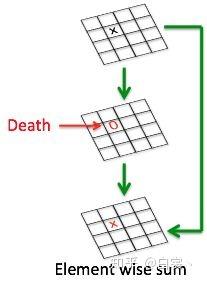

ResNet 、Relu 和神經元死亡

在神經網路訓練中如果節點的值變為0就會“死掉”。因為ReLU對0值的梯度是0,後續無論怎麼迭代這個節點的值都不會恢復了。而通過ResNet結構的特徵複用,可以很大程度上緩解這種特徵退化問題(這也從一個側面說明ResNet為何好於VGG)。另外,一般情況訓練網路使用的是float32浮點數;當使用低精度的float16時,這種特徵複用可以更加有效的減緩退化。

二、Inverted residual block

理解之前的問題後看,其實Mobilenet V2使用的基本卷積單元結構有以下特點:

- 整體上繼續使用Mobilenet V1的Separable convolution降低卷積運算量

- 引入了特徵複用結構,即採取了ResNet的思想

- 採用Inverted residual block結構,對Relu的缺陷進行迴避

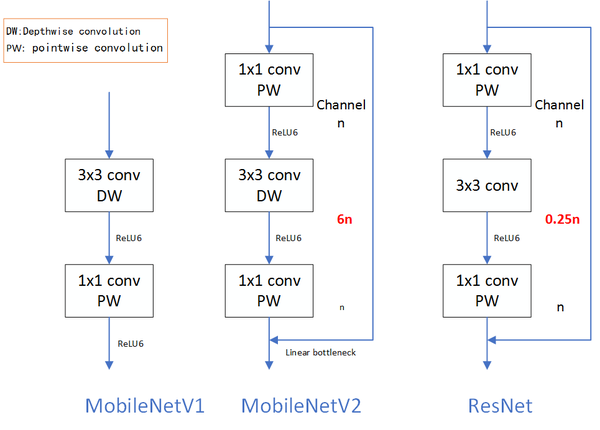

Inverted residuals 可以認為是residual block的拓展,其重點聚焦在殘差網路各層的層數,進入block後會先將特徵維數放大,然後再壓縮回去,呈現梭子的外形,而傳統殘差設計是沙漏形,下面是MobileNetV1、MobileNetV2 和ResNet微結構對比:

可以看到MobileNetV2 和ResNet基本結構很相似。不過ResNet是先降維(0.25倍)、提特徵、再升維。而MobileNetV2 則是先升維(6倍)、提特徵、再降維。、

可以看到MobileNetV2 和ResNet基本結構很相似。不過ResNet是先降維(0.25倍)、提特徵、再升維。而MobileNetV2 則是先升維(6倍)、提特徵、再降維。、

注:模型中使用 ReLU6 作為非線性層,在低精度計算時能壓縮動態範圍,演算法更穩健。

ReLU6 定義為:f(x) = min(max(x, 0), 6),詳見 tf.nn.relu6 API

至於Linear Bottlenecks,論文中用很多公式表達這個思想,但是實現上非常簡單,就是在MobileNetV2微結構中第二個PW後無ReLU6,對於低維空間而言,進行線性對映會儲存特徵,而非線性對映會破壞特徵,實際程式碼如下:

def _bottleneck(inputs, nb_filters, t):

x = Conv2D(filters=nb_filters * t, kernel_size=(1,1), padding='same')(inputs)

x = Activation(relu6)(x)

x = DepthwiseConv2D(kernel_size=(3,3), padding='same')(x)

x = Activation(relu6)(x)

x = Conv2D(filters=nb_filters, kernel_size=(1,1), padding='same')(x)

# do not use activation function

if not K.get_variable_shape(inputs)[3] == nb_filters:

inputs = Conv2D(filters=nb_filters, kernel_size=(1,1), padding='same')(inputs)

outputs = add([x, inputs])

return outputs

相對應的,主結構堆疊上面的block 即可,下面是一個簡單的版本,

def MobileNetV2_relu(input_shape, k):

inputs = Input(shape = input_shape)

x = Conv2D(filters=32, kernel_size=(3,3), padding='same')(inputs)

x = _bottleneck_relu(x, 8, 6)

x = MaxPooling2D((2,2))(x)

x = _bottleneck_relu(x, 16, 6)

x = _bottleneck_relu(x, 16, 6)

x = MaxPooling2D((2,2))(x)

x = _bottleneck_relu(x, 32, 6)

x = GlobalAveragePooling2D()(x)

x = Dense(128, activation='relu')(x)

outputs = Dense(k, activation='softmax')(x)

model = Model(inputs, outputs)

return model

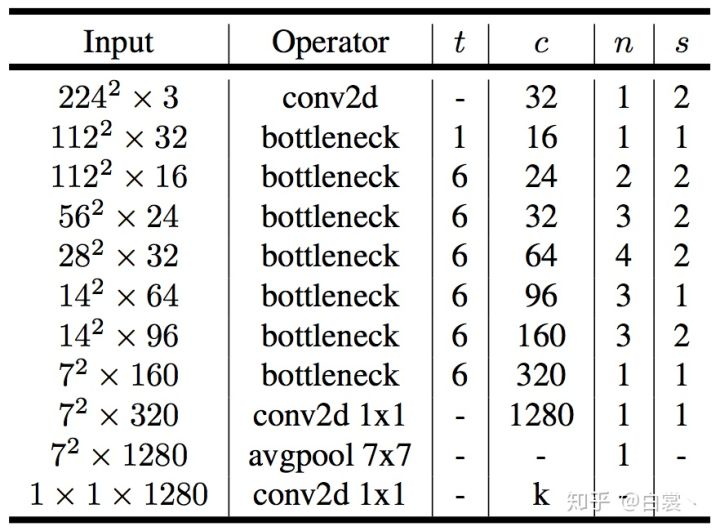

原文網路結構如下: