大資料CDH5環境搭建

一、基礎環境準備(所有伺服器都要做)

1.修改主機名和hosts

# vi /etc/sysconfig/network --修改主機名 NETWORKING=yes HOSTNAME=bigdata01.nebuinfo.com # vi /etc/hosts --修改hosts 127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 192.168.128.51 bigdata01.nebuinfo.com 192.168.128.52 bigdata02.nebuinfo.com 192.168.128.53 bigdata03.nebuinfo.com

2.關閉伺服器防火牆以及selinux

# service iptables stop

# chkconfig iptables off

# vi /etc/selinux/config

將SELINUX=enforcing改為SELINUX=disabled

驗證:

# iptables -L

# getenforce

3.禁用IPv6

# echo "alias net-pf-10 off" >> /etc/modprobe.d/dist.conf

# echo "alias ipv6 off" >> /etc/modprobe.d/dist.conf

4.禁用“透明大頁面”

5.6.1只要這一個命令,後面版本會多出一個命令,注意看警告即可

# echo never > /sys/kernel/mm/transparent_hugepage/defrag

# echo 'echo never > /sys/kernel/mm/transparent_hugepage/defrag' >> /etc/rc.local

5.調整Swappiness

# cat /proc/sys/vm/swappiness 預設是60 修改swappiness值為10 sysctl vm.swappiness=10 為保證重啟有效 # vi /etc/sysctl.conf 新增下面一行 vm.swappiness=10 所有伺服器重啟後驗證hostname 和 SELINUX

6.配置免祕鑰

修改好主機名以後

# ssh-keygen -t rsa -P '' --在本機生成公鑰

# cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys --公鑰寫入自己的認證檔案

# chmod 600 ~/.ssh/authorized_keys

主節點執行

# scp ~/.ssh/id_rsa.pub [email protected]:~

# scp ~/.ssh/id_rsa.pub [email protected]:~

各個節點執行

# cat ~/id_rsa.pub >> ~/.ssh/authorized_keys

# chmod 600 ~/.ssh/authorized_keys

# rm ~/id_rsa.pub

各個節點執行(可不做)

# cd ~/.ssh

# ssh-copy-id -i id_rsa.pub [email protected]

7.利用ntp配置伺服器時間同步

先選定一臺主伺服器,其他伺服器都同步這臺主伺服器的時間

先修改時間

# date -s '2017-10-24 12:48:30' +'%F %T'(實際改成當前時間)

將修改後的時間寫入硬體時鐘,確保重啟有效

# hwclock -w

配置開機啟動

# chkconfig ntpd on

# chkconfig --list ntpd

先配置主伺服器

# vi /etc/ntp.conf

(找到這一行,放開restrict的註釋,並且修改ip地址)

# Hosts on local network are less restricted.

restrict 192.168.128.1 mask 255.255.255.0 nomodify notrap

(找到這一行,註釋下面的server)

# Please consider joining the pool (http://www.pool.ntp.org/join.html).

#server 0.centos.pool.ntp.org iburst

#server 1.centos.pool.ntp.org iburst

#server 2.centos.pool.ntp.org iburst

#server 3.centos.pool.ntp.org iburst

新增下面兩行

server 127.127.1.0 # local clock

fudge 127.127.1.0 stratum 10

配置其他伺服器

# vi /etc/ntp.conf

(找到這一行,放開restrict的註釋,並且修改ip地址)

# Hosts on local network are less restricted.

restrict 192.168.128.1 nomodify notrap noquery

(找到這一行,註釋下面的server)

# Please consider joining the pool (http://www.pool.ntp.org/join.html).

#server 0.centos.pool.ntp.org iburst

#server 1.centos.pool.ntp.org iburst

#server 2.centos.pool.ntp.org iburst

#server 3.centos.pool.ntp.org iburst

指定時間服務

server 192.168.128.51

改好檔案後所有機器重啟ntp服務

# service ntpd restart

5-10分鐘後驗證時間是否同步

# ntpstat

synchronised to NTP server (192.168.128.51) at stratum 12

time correct to within 18 ms

polling server every 64 s

(顯示上面內容說明同步成功)

利用date命令再次驗證

# date

8.JDK1.8安裝及配置

- 登入Linux切換到root使用者

解除安裝系統自帶的JDK

[[email protected] java]# rpm -qa|grep java --查詢目前已裝的JDK java-1.7.0-openjdk-1.7.0.45-2.4.3.3.el6.x86_64 tzdata-java-2013g-1.el6.noarch java-1.6.0-openjdk-1.6.0.0-1.66.1.13.0.el6.x86_64 # rpm -e --nodeps java-1.7.0-openjdk-1.7.0.45-2.4.3.3.el6.x86_64 tzdata-java-2013g-1.el6.noarch java-1.6.0-openjdk-1.6.0.0-1.66.1.13.0.el6.x86_64 --解除安裝相應的JDK在usr目錄下建立java安裝目錄(必須要裝在這個目錄,否則後面會有找不到java_home的報錯)

# mkdir /usr/java將jdk-8u151-linux-x64.gz傳送到java目錄下

解壓jdk到當前目錄

# tar -zxvf jdk-8u151-linux-x64.gz

得到資料夾 jdk1.8.0_151編輯配置檔案,配置環境變數

vi /etc/profile

新增如下內容:JAVA_HOME=/usr/java/jdk1.8.0_151 CLASSPATH=$JAVA_HOME/lib/ PATH=$PATH:$JAVA_HOME/bin export PATH JAVA_HOME CLASSPATH執行命令 :

# source /etc/profile檢視安裝情況

[[email protected] ~]# java -version java version "1.8.0_151" Java(TM) SE Runtime Environment (build 1.8.0_151-b12) Java HotSpot(TM) 64-Bit Server VM (build 25.151-b12, mixed mode)

9.掛載CenterOS映象檔案配置yum源

如果通網際網路可以不做,否則必須做

暫時沒寫,後面補上

二、CDH所需服務搭建

1.MySql安裝及配置

檢視並解除安裝已有的mysql(所有伺服器都要做)

# rpm -qa|grep -i mysql

# rpm -e --nodeps mysql-libs-5.1.71-1.el6.x86_64

# mkdir /app/mysql(只在主節點安裝)

將mysql的安裝包上傳到/app/mysql

MySQL-client-5.6.13-1.el6.x86_64.rpm

MySQL-devel-5.6.13-1.el6.x86_64.rpm

MySQL-server-5.6.13-1.el6.x86_64.rpm

MySQL-shared-compat-5.6.35-1.el6.x86_64.rpm

# cd /app/mysql

# rpm -ivh *

Preparing... ########################################### [100%]

1:MySQL-server ########################################### [ 33%]

安裝成功後啟動

# service mysql start

檢視root初始密碼

# cat /root/.mysql_secret

例如:# The random password set for the root user at Tue Oct 24 17:01:46 2017 (local time): OYRocvL1

# mysql -uroot -pOYRocvL1 (注意密碼前面有個-p)

mysql> SET PASSWORD = PASSWORD('123456'); --先要修改預設的root密碼 否則無法進行下面的操作

切換到mysql的database中,裡面儲存了使用者資訊,可以修改密碼

mysql> use mysql;

為其他客戶端開啟連線許可權

mysql> grant all privileges on *.* to 'root'@'%' identified by '123456';

mysql> flush privileges;//重新整理許可權

建立database和使用者

複製下面命令在mysql命令列下執行:

create database hive;

create database oozie;

grant all on hive.* to 'hive'@'%' identified by 'hive' with grant option;

grant all on oozie.* to 'oozie'@'%' identified by 'oozie' with grant option;

flush privileges;

建立hive和oozie使用者後面會用到,使用者名稱就是密碼

2.Cloudera-Manager和CDH安裝

開啟Http服務(目的是為了提供yum源)

# service httpd start

將提供的cm資料夾放到/var/www/html目錄下

# ll /var/www/html/cm

drwxr-xr-x 4 root root 4096 10月 24 19:30 5.6.1

-rw-r--r-- 1 root root 1690 10月 24 19:30 cloudera-manager-installer.bin

-rw-r--r-- 1 root root 1690 10月 24 19:30 cloudera-manager.repo

-rw-r--r-- 1 root root 1690 10月 24 19:30 RPM-GPG-KEY-cloudera

通過瀏覽器訪問http://192.168.128.51/cm/可以看到相應資料夾

新增mysql驅動包

mysql-connector-java.jar複製到/usr/share/java/

建立目錄mkdir -p /opt/cloudera/parcel-repo

把cdh下的檔案放到此目錄下得到

CDH-5.6.1-1.cdh5.6.1.p0.3-el6.parcel

CDH-5.6.1-1.cdh5.6.1.p0.3-el6.parcel.sha1

manifest.json

把sha1檔案改為sha

# mv CDH-5.6.1-1.cdh5.6.1.p0.3-el6.parcel.sha1 DH-5.6.1-1.cdh5.6.1.p0.3-el6.parcel.sha

給cloudera-manager-installer.bin賦予可執行許可權

# chmod u+x cloudera-manager-installer.bin

配置cloudera-manager yum源

# vi /etc/yum.repos.d/cloudera-manager.repo

修改為以下內容

[cloudera-manager]

name = Cloudera Manager, Version 5.6.1

baseurl = http://192.168.128.51/cm/5.6.1/

gpgcheck = 0

執行cloudera-manager-installer.bin開始安裝

# ./cloudera-manager-installer.bin

會出現安裝介面,用回車選Next,Yes即可

訪問http://192.168.128.51

使用者名稱:admin密碼admin

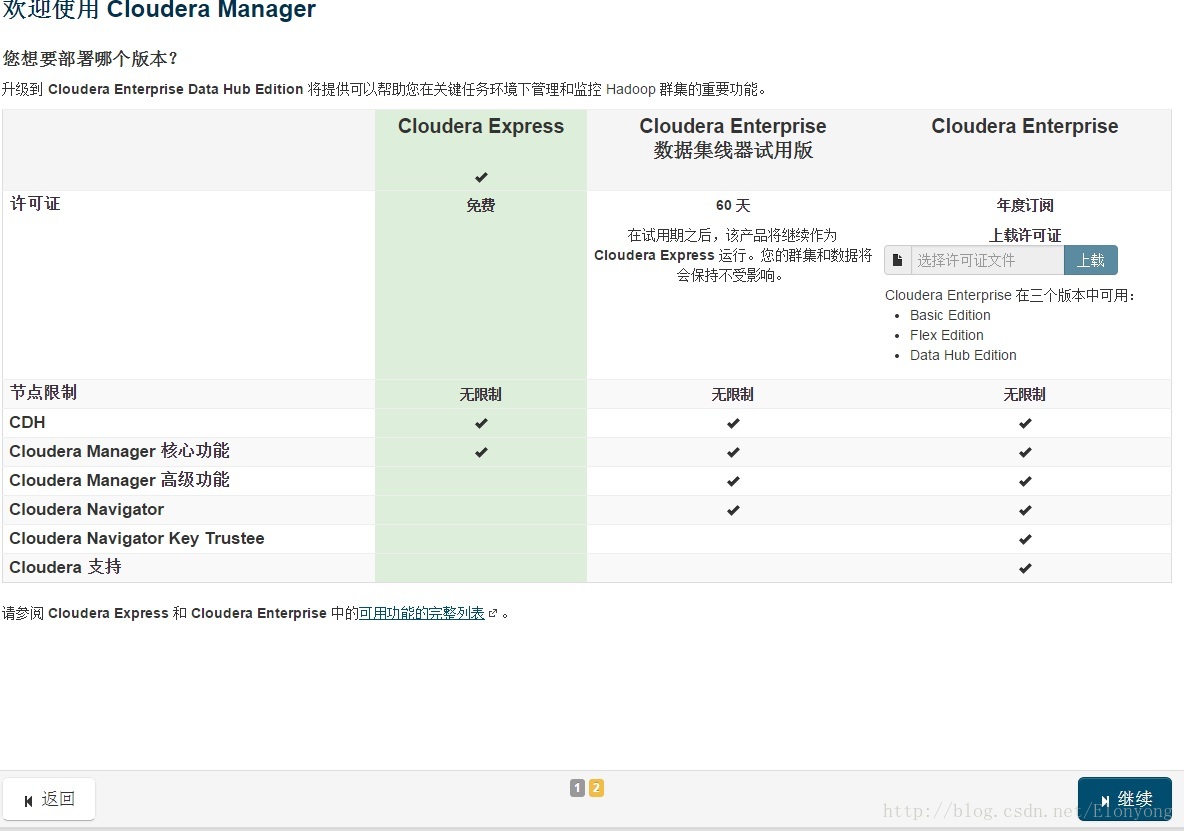

選擇免費版

根據域名搜尋主機

bigdata[01-03].nebuinfo.com

點選搜尋得到以下三臺機器

使用Parcel安裝

選擇CDH5.6.1版本

選擇自定義Cloudera Manager Agent

並且設定包路徑(截圖不太一樣,理解原理就行)

http://192.168.128.51/cm/5.6.1/

不勾選單使用者模式

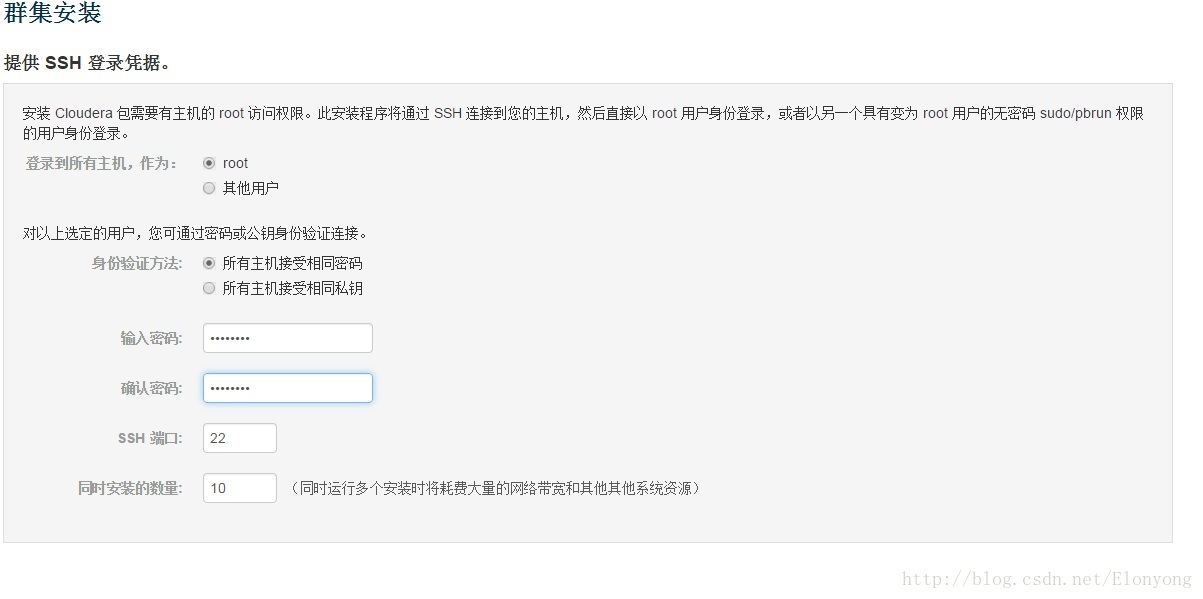

選擇root使用者

並設定密碼admin

等待安裝完畢下一步

等待安裝

如果上面的準備工作都做了應該不會有警告,其他警告要看具體情況

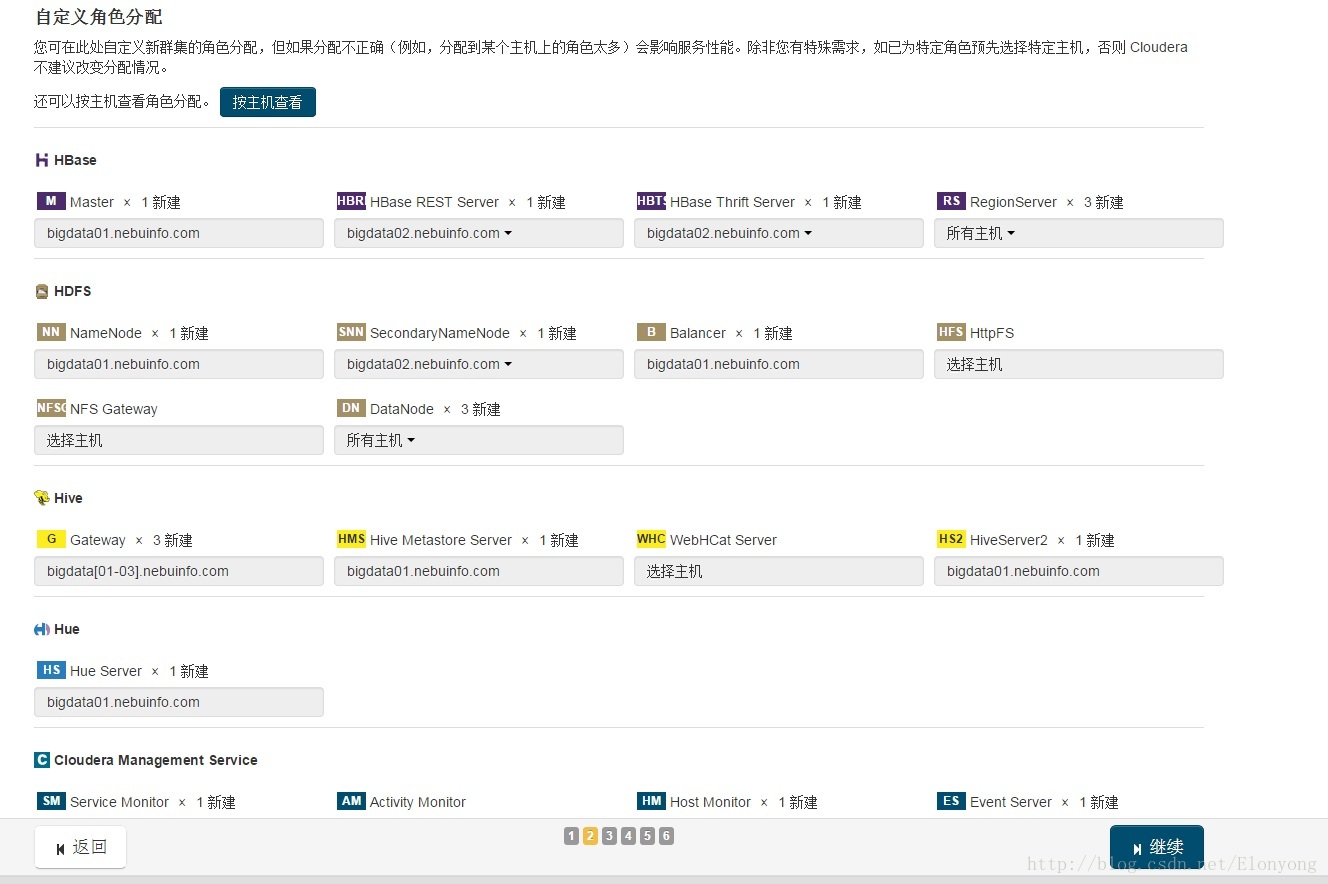

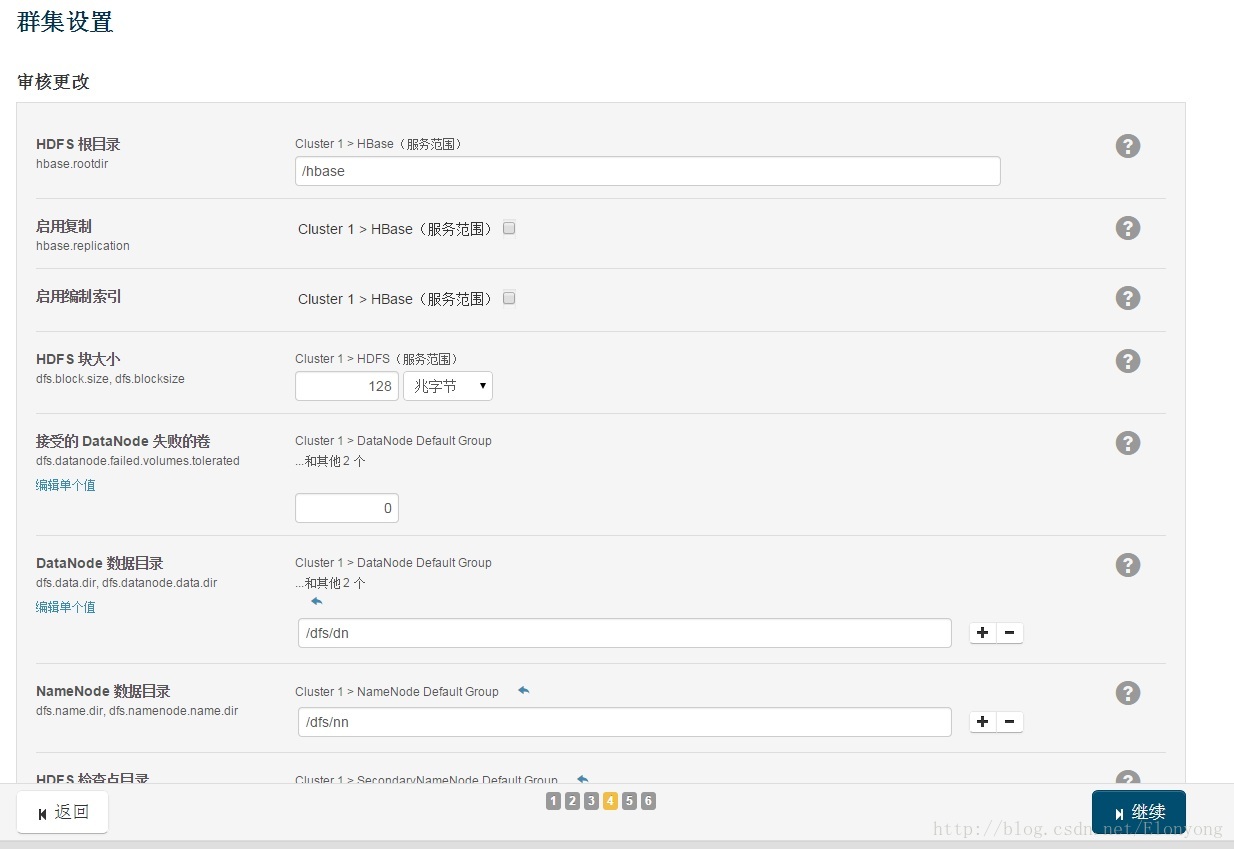

根據伺服器的配置情況儘量分散各個伺服器的壓力

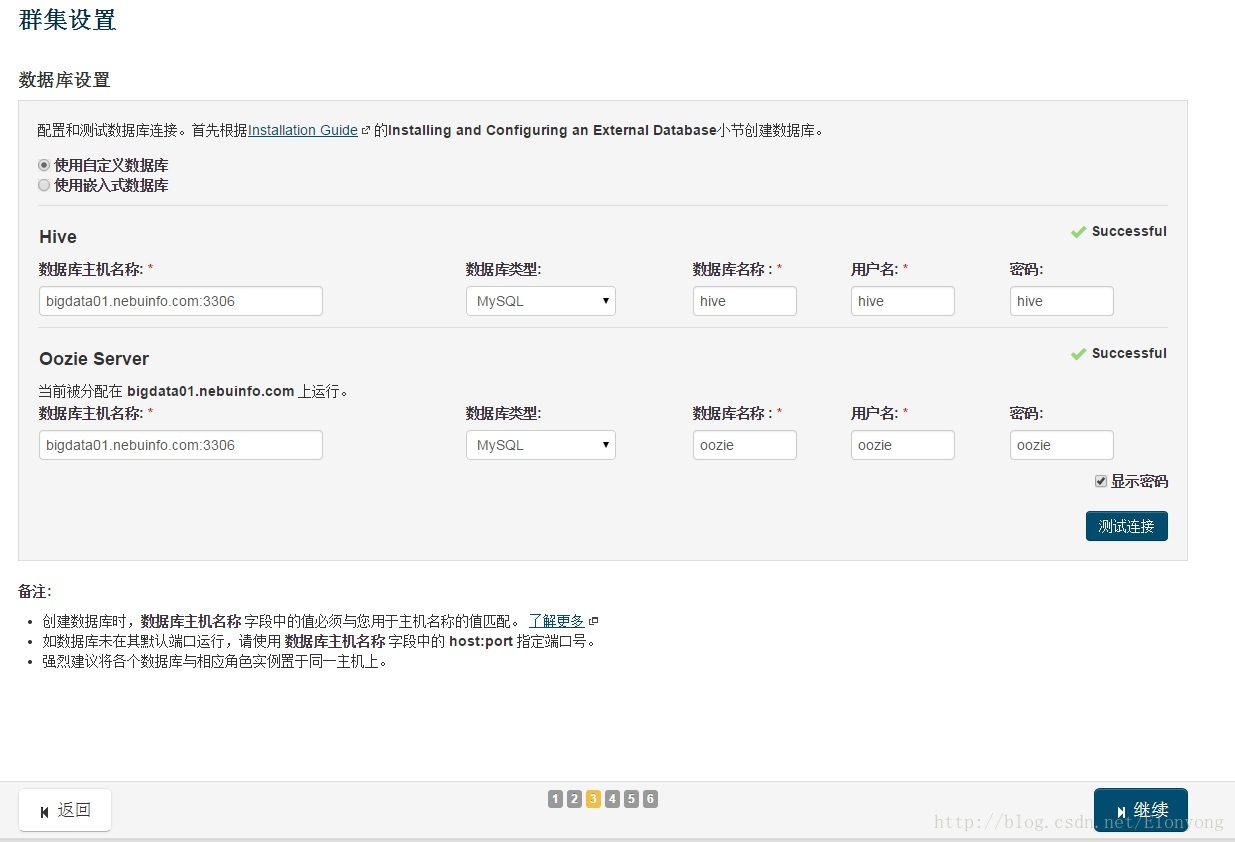

配置前面安裝好的mysql資料庫

預設配置即可

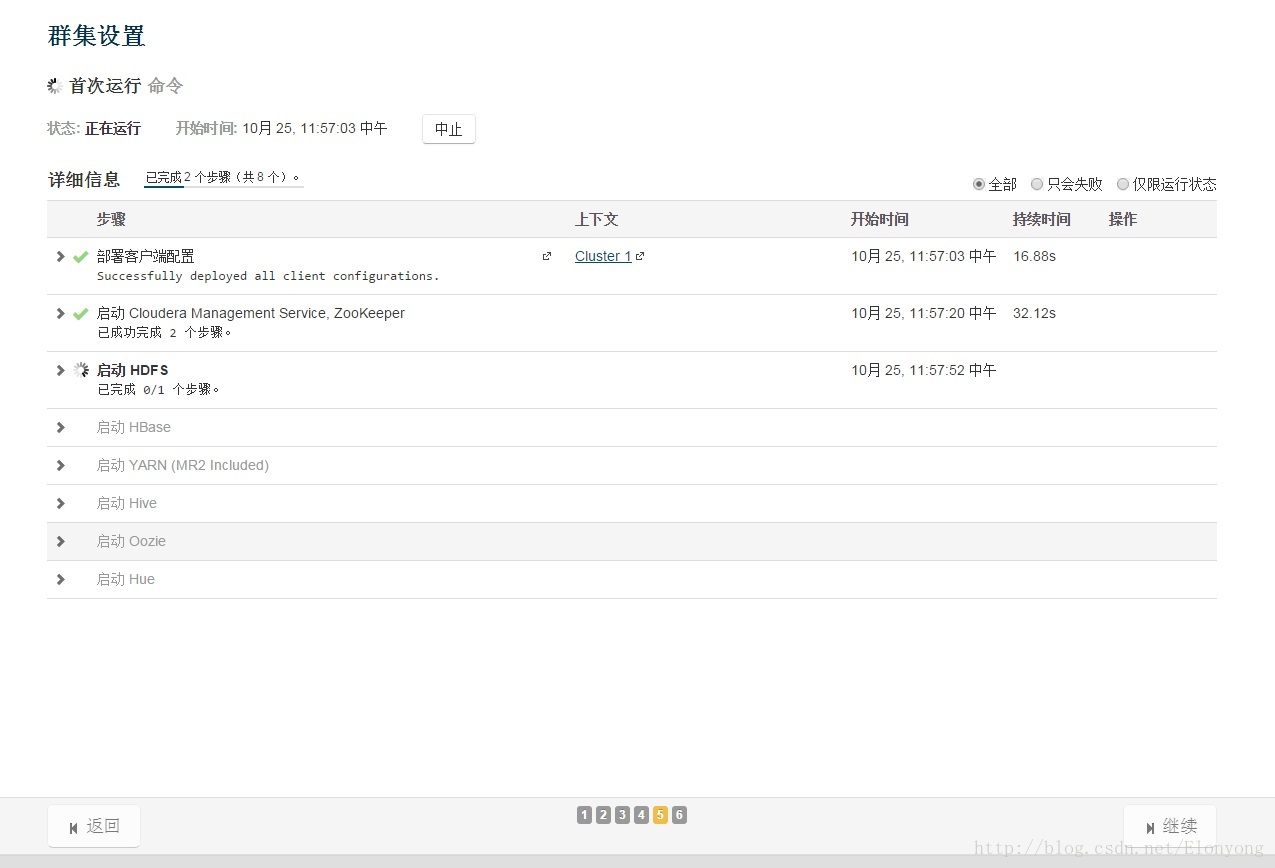

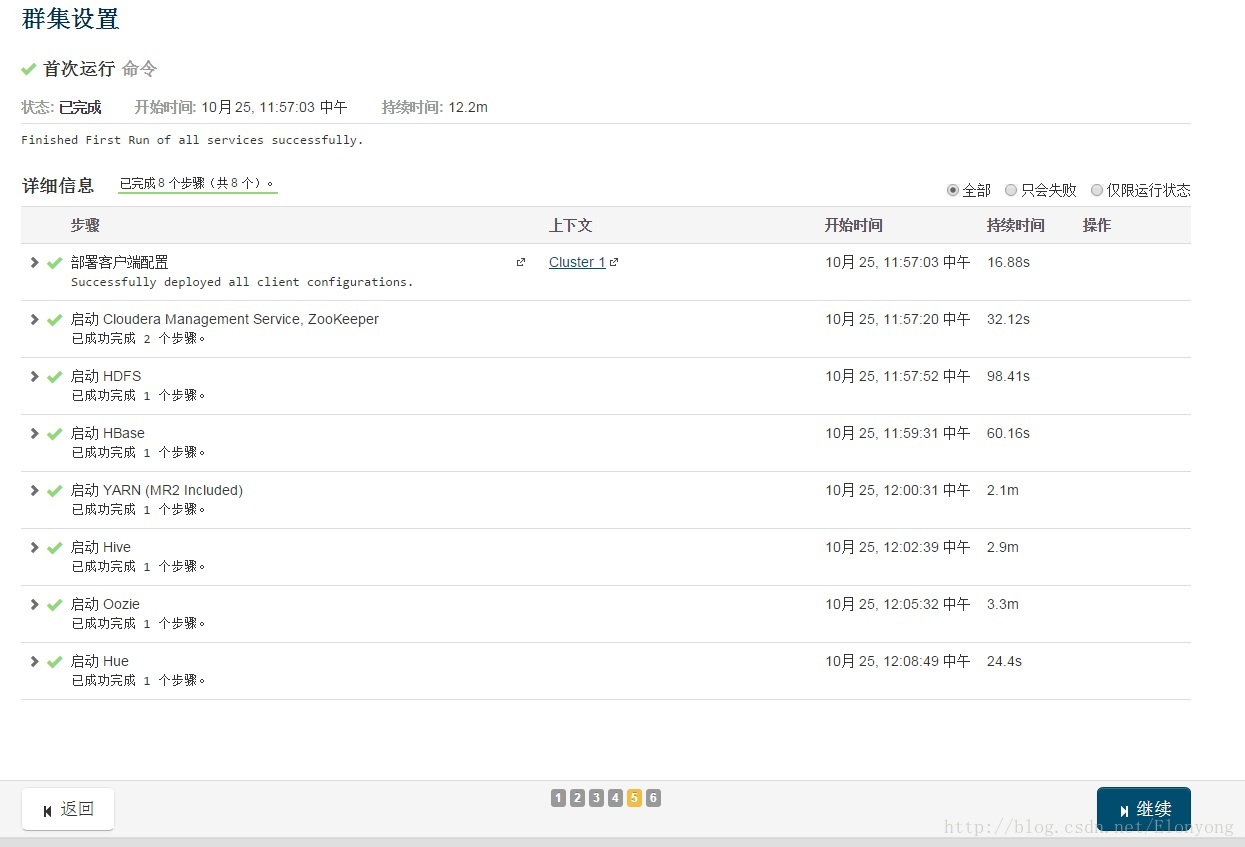

等待安裝

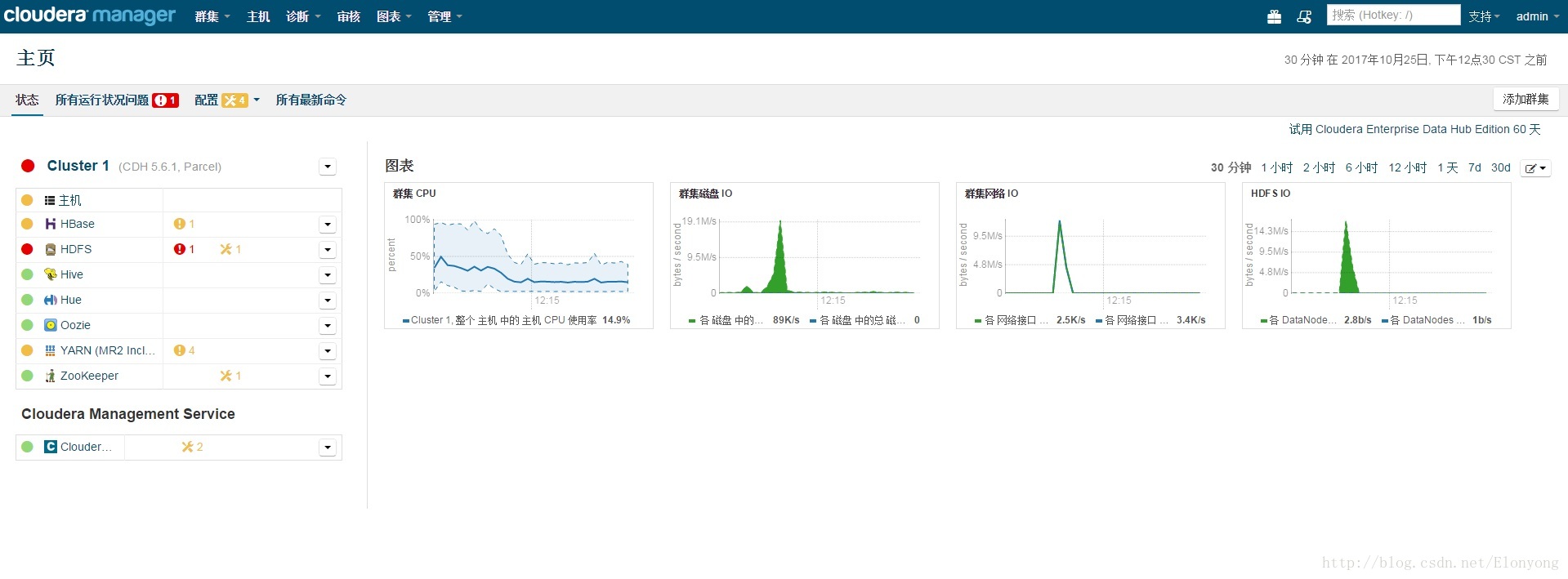

完成後可以看到以下頁面

相關推薦

大資料CDH5環境搭建

一、基礎環境準備(所有伺服器都要做) 1.修改主機名和hosts # vi /etc/sysconfig/network --修改主機名 NETWORKING=yes HOSTNAME=bigdata01.nebuinfo.com # vi /e

大資料入門環境搭建整理、大資料入門系列教程合集、大資料生態圈技術整理彙總、大資料常見錯誤合集、大資料的離線和實時資料處理流程分析

本篇文章主要整理了筆者學習大資料時整理的一些文章,文章是從環境搭建到整個大資料生態圈的常用技術整理,環境希望可以幫助到剛學習大資料到童鞋,大家在學習過程中有問題可以隨時評論回覆! 大資料生態圈涉及技術: Hadoop、MapReduce、HDFS、Hive、Hbase、Spark、Scala

大資料學習環境搭建(CentOS6.9+Hadoop2.7.3+Hive1.2.1+Hbase1.3.1+Spark2.1.1)

node1192.168.1.11node2192.168.1.12node3192.168.1.13備註NameNodeHadoopYY高可用DateNode YYYResourceManager YY高可用NodeManagerYYYJournalNodes YYY奇數個,至少3個節點ZKFC(DFSZK

高效的大資料開發環境搭建及實戰

內容大綱:一、開發環境準備1.IDE開發工具選擇及安裝2.Java SDK版本選擇及安裝3.Spark開發語言 版本選擇及安裝4.下載Spark的安裝程式5.安裝Maven6.安裝sbt7.IDE的外掛選擇、安裝及配置二、從零開始創建第一個Spark程式 - HelloSpa

10大資料-hive 環境搭建

1、將apache-hive-1.2.1-bin.tar.gz上傳到以下目錄 (這個目錄可以自定義,我慣用這個) /opt/modules/app 2、解壓到當前目錄,並且重新命名為hive tar -xzvf apache-hive-1.2.1-bin.tar.gz 3、配置環境

hadoop spark 大資料叢集環境搭建(一)

大資料雲端計算現在比較熱門,未來的一個發展方向,在此分享下技術,有不對的地方歡迎指出 1、軟體環境(會分享到網盤) centos6.5 jdk1.7 hadoop2.4.1(這裡只用到hdfs,namenode不走ha) zookeeper3.4.5 spark1.3.0

在阿里雲中搭建大資料實驗環境

第2步:使用MobaXterm工具遠端連線雲伺服器 MobaXterm遠端登入工具提供了大量為程式設計師,網站管理員,IT管理員以及幾乎所有需要以更簡單的方式處理遠端作業的使用者量身打造的功能。 它不僅支援各種連線和Unix命令,還可以像PuTTY一樣通過SSH連線Raspberry Pi等

D001.5 Docker搭建大資料叢集環境(基礎篇)

0x00 教程內容 0x01 Docker的安裝 1. 2. 3. 0x02 Docker的簡單操作 1. 2. 3. 0x03 Docker資料卷 Docker的資料卷與Centos的

大資料初學者福利:一片文章教你搭建Hadoop大資料處理環境

由於Hadoop需要執行在Linux環境中,而且是分散式的,因此個人學習只能裝虛擬機器,本文都以VMware Workstation為準,安裝CentOS7,具體的安裝此處不作過多介紹,只作需要用到的知識介紹。 VMware的安裝,裝好一個虛擬機器後利用複製虛擬機器的方式建立後面幾個虛擬機器,省

使用python fabric搭建RHEL 7.2大資料基礎環境以及部分優化

大資料系統基本架構: 1.使用python fabric進行Linux基礎配置 使用python,可以讓任何事情高效起來,包括運維工作,fabric正式這樣一套基於python2的類庫,它執行本地或遠端shell命令提供了操作的基本套件(正常或通過sud

Win10不需要Cygwin搭建大資料測試環境(4)---Hive

系列文章 前言 這篇文章是系列文章中的第四篇,主要描述了win10系安裝Hive。 準備工作 1:完成第一篇教程,確保Hadoop正常執行。 2:下載Hive,我安裝的版本是apache-hive-2.1.1-bin。安裝路徑是D:\apach

[大資料]hadoop 環境配置(1)

1 基礎環境搭建 Centos 6.4 環境 hadoop 環境搭建 1 使用者新增 sodo adduser kfk 2 hostname 更改 sudo vi /etc/sysconfig/network 3 hosts 更改 sudo vi /etc/h

CDH:cdh5環境搭建

entos yum epo ger httpd pms mir check ani 其中出現警告解決方案參考:http://www.cnblogs.com/fujiangong/p/5620050.html 安裝環境三臺centos7 vmw:cdh-141 192.16

網路配置、防火牆 (大資料叢集環境)Linux防火牆

網路配置、防火牆 1.大資料叢集環境,形成叢集區域網,使用機器名替代真實IP,如何完成IP地址與機器名的對映? 1)修改機器名 在CenterOS7,使用hostname命令,修改當前機器名,如果重啟節點機器名失效;修改/etc/hostname配置檔案(內容:自定義機器名 例:p

大資料hadoop叢集搭建之後的操作

1.節點的服役和退役(hdfs) [退役] 1.新增退役節點的ip到黑名單,不要更新白名單. [/soft/hadoop/etc/dfs.hosts.exclude.txt] s205 2.配置hdfs-site.xml

程式設計字典-詳細的大資料Hadoop環境設定

Hadoop受GNU / Linux平臺及其風格的支援。因此,我們必須安裝一個Linux作業系統來設定Hadoop環境。如果您的作業系統不是Linux,您可以在其中安裝Virtualbox軟體,並在Virtualbox中安裝Linux。 預安裝安裝程式 在將Ha

HA機制的大資料叢集的搭建過程

叢集規劃 說明: 1、在hadoop2.0中通常由兩個NameNode組成,一個處於active狀態,另一個處於standby狀態。Active NameNode對外提供服務,而Standby NameNode則不對外提供服務,僅同步active nameno

Ambari——大資料平臺的搭建利器

Ambari 是什麼 Ambari 跟 Hadoop 等開源軟體一樣,也是 Apache Software Foundation 中的一個專案,並且是頂級專案。目前最新的釋出版本是 2.0.1,未來不久將釋出 2.1 版本。就 Ambari 的作用來說,就是建立

大資料基礎環境之hbase(3臺虛擬機器)

hbase安裝 注意開啟hbase之前,需要將之前的hadoop叢集開啟 start-all.sh (啟動hadoop) zkServer.sh start(各個節點均執行) 1.同樣先建立工作路徑/usr/hbase,將/opt/soft下的hbase加壓到工作路

Windows10下配置大資料開發環境(1)

一 準備工作 如果安裝的Hadoop是3.1.1版本,應選擇jdk1.8以上版本 3. 搜尋HADOOP在Windows環境需要的工具 二 安裝JDK 安裝JDK後,需要配置JDK的環境,這裡可以自行百度。 三 安裝和配置Hapood環境