FFMPEG 最簡濾鏡filter使用例項(實現視訊縮放,裁剪,水印等)

FFMPEG官網給出了FFMPEG 濾鏡使用的例項,它是將視訊中的畫素點替換成字元,然後從終端輸出。我在該例項的基礎上稍微的做了修改,使它能夠儲存濾鏡處理過後的檔案。在上程式碼之前先明白幾個概念:

Filter:代表單個filter

FilterPad:代表一個filter的輸入或輸出埠,每個filter都可以有多個輸入和多個輸出,只有輸出pad的filter稱為source,只有輸入pad的filter稱為sink

FilterLink:若一個filter的輸出pad和另一個filter的輸入pad名字相同,即認為兩個filter之間建立了link

FilterChain:

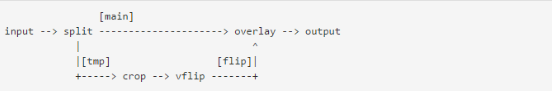

經典示例:

圖中的一系列操作共使用了四個filter,分別是

splite:將輸入的流進行分裂複製,分兩路輸出。

crop:根據給定的引數,對視訊進行裁剪

vflip:根據給定引數,對視訊進行翻轉等操作

overlay:將一路輸入覆蓋到另一路之上,合併輸出為一路視訊

下面上程式碼:

/*============================================================================= # FileName: filter_video.c # Desc: an example of ffmpeg fileter # Author: licaibiao # LastChange: 2017-03-16 =============================================================================*/ #define _XOPEN_SOURCE 600 /* for usleep */ #include <unistd.h> #include "avcodec.h" #include "avformat.h" #include "avfiltergraph.h" #include "avcodec.h" #include "buffersink.h" #include "buffersrc.h" #include "opt.h" #define SAVE_FILE const char *filter_descr = "scale=iw*2:ih*2"; static AVFormatContext *fmt_ctx; static AVCodecContext *dec_ctx; AVFilterContext *buffersink_ctx; AVFilterContext *buffersrc_ctx; AVFilterGraph *filter_graph; static int video_stream_index = -1; static int64_t last_pts = AV_NOPTS_VALUE; static int open_input_file(const char *filename) { int ret; AVCodec *dec; if ((ret = avformat_open_input(&fmt_ctx, filename, NULL, NULL)) < 0) { av_log(NULL, AV_LOG_ERROR, "Cannot open input file\n"); return ret; } if ((ret = avformat_find_stream_info(fmt_ctx, NULL)) < 0) { av_log(NULL, AV_LOG_ERROR, "Cannot find stream information\n"); return ret; } /* select the video stream 判斷流是否正常 */ ret = av_find_best_stream(fmt_ctx, AVMEDIA_TYPE_VIDEO, -1, -1, &dec, 0); if (ret < 0) { av_log(NULL, AV_LOG_ERROR, "Cannot find a video stream in the input file\n"); return ret; } video_stream_index = ret; dec_ctx = fmt_ctx->streams[video_stream_index]->codec; av_opt_set_int(dec_ctx, "refcounted_frames", 1, 0); /* refcounted_frames 幀引用計數 */ /* init the video decoder */ if ((ret = avcodec_open2(dec_ctx, dec, NULL)) < 0) { av_log(NULL, AV_LOG_ERROR, "Cannot open video decoder\n"); return ret; } return 0; } static int init_filters(const char *filters_descr) { char args[512]; int ret = 0; AVFilter *buffersrc = avfilter_get_by_name("buffer"); /* 輸入buffer filter */ AVFilter *buffersink = avfilter_get_by_name("buffersink"); /* 輸出buffer filter */ AVFilterInOut *outputs = avfilter_inout_alloc(); AVFilterInOut *inputs = avfilter_inout_alloc(); AVRational time_base = fmt_ctx->streams[video_stream_index]->time_base; /* 時間基數 */ #ifndef SAVE_FILE enum AVPixelFormat pix_fmts[] = { AV_PIX_FMT_GRAY8, AV_PIX_FMT_NONE }; #else enum AVPixelFormat pix_fmts[] = { AV_PIX_FMT_YUV420P, AV_PIX_FMT_NONE }; #endif filter_graph = avfilter_graph_alloc(); /* 建立graph */ if (!outputs || !inputs || !filter_graph) { ret = AVERROR(ENOMEM); goto end; } /* buffer video source: the decoded frames from the decoder will be inserted here. */ snprintf(args, sizeof(args), "video_size=%dx%d:pix_fmt=%d:time_base=%d/%d:pixel_aspect=%d/%d", dec_ctx->width, dec_ctx->height, dec_ctx->pix_fmt, time_base.num, time_base.den, dec_ctx->sample_aspect_ratio.num, dec_ctx->sample_aspect_ratio.den); /* 建立並向FilterGraph中新增一個Filter */ ret = avfilter_graph_create_filter(&buffersrc_ctx, buffersrc, "in", args, NULL, filter_graph); if (ret < 0) { av_log(NULL, AV_LOG_ERROR, "Cannot create buffer source\n"); goto end; } /* buffer video sink: to terminate the filter chain. */ ret = avfilter_graph_create_filter(&buffersink_ctx, buffersink, "out", NULL, NULL, filter_graph); if (ret < 0) { av_log(NULL, AV_LOG_ERROR, "Cannot create buffer sink\n"); goto end; } /* Set a binary option to an integer list. */ ret = av_opt_set_int_list(buffersink_ctx, "pix_fmts", pix_fmts, AV_PIX_FMT_NONE, AV_OPT_SEARCH_CHILDREN); if (ret < 0) { av_log(NULL, AV_LOG_ERROR, "Cannot set output pixel format\n"); goto end; } /* * Set the endpoints for the filter graph. The filter_graph will * be linked to the graph described by filters_descr. */ /* * The buffer source output must be connected to the input pad of * the first filter described by filters_descr; since the first * filter input label is not specified, it is set to "in" by * default. */ outputs->name = av_strdup("in"); outputs->filter_ctx = buffersrc_ctx; outputs->pad_idx = 0; outputs->next = NULL; /* * The buffer sink input must be connected to the output pad of * the last filter described by filters_descr; since the last * filter output label is not specified, it is set to "out" by * default. */ inputs->name = av_strdup("out"); inputs->filter_ctx = buffersink_ctx; inputs->pad_idx = 0; inputs->next = NULL; /* Add a graph described by a string to a graph */ if ((ret = avfilter_graph_parse_ptr(filter_graph, filters_descr, &inputs, &outputs, NULL)) < 0) goto end; /* Check validity and configure all the links and formats in the graph */ if ((ret = avfilter_graph_config(filter_graph, NULL)) < 0) goto end; end: avfilter_inout_free(&inputs); avfilter_inout_free(&outputs); return ret; } #ifndef SAVE_FILE static void display_frame(const AVFrame *frame, AVRational time_base) { int x, y; uint8_t *p0, *p; int64_t delay; if (frame->pts != AV_NOPTS_VALUE) { if (last_pts != AV_NOPTS_VALUE) { /* sleep roughly the right amount of time; * usleep is in microseconds, just like AV_TIME_BASE. */ /* 計算 pts 是用來把時間戳從一個時基調整到另外一個時基時候用的函式 */ delay = av_rescale_q(frame->pts - last_pts, time_base, AV_TIME_BASE_Q); if (delay > 0 && delay < 1000000) usleep(delay); } last_pts = frame->pts; } /* Trivial ASCII grayscale display. */ p0 = frame->data[0]; puts("\033c"); for (y = 0; y < frame->height; y++) { p = p0; for (x = 0; x < frame->width; x++) putchar(" .-+#"[*(p++) / 52]); putchar('\n'); p0 += frame->linesize[0]; } fflush(stdout); } #else FILE * file_fd; static void write_frame(const AVFrame *frame) { static int printf_flag = 0; if(!printf_flag){ printf_flag = 1; printf("frame widht=%d,frame height=%d\n",frame->width,frame->height); if(frame->format==AV_PIX_FMT_YUV420P){ printf("format is yuv420p\n"); } else{ printf("formet is = %d \n",frame->format); } } fwrite(frame->data[0],1,frame->width*frame->height,file_fd); fwrite(frame->data[1],1,frame->width/2*frame->height/2,file_fd); fwrite(frame->data[2],1,frame->width/2*frame->height/2,file_fd); } #endif int main(int argc, char **argv) { int ret; AVPacket packet; AVFrame *frame = av_frame_alloc(); AVFrame *filt_frame = av_frame_alloc(); int got_frame; #ifdef SAVE_FILE file_fd = fopen("test.yuv","wb+"); #endif if (!frame || !filt_frame) { perror("Could not allocate frame"); exit(1); } if (argc != 2) { fprintf(stderr, "Usage: %s file\n", argv[0]); exit(1); } av_register_all(); avfilter_register_all(); if ((ret = open_input_file(argv[1])) < 0) goto end; if ((ret = init_filters(filter_descr)) < 0) goto end; /* read all packets */ while (1) { if ((ret = av_read_frame(fmt_ctx, &packet)) < 0) break; if (packet.stream_index == video_stream_index) { got_frame = 0; ret = avcodec_decode_video2(dec_ctx, frame, &got_frame, &packet); if (ret < 0) { av_log(NULL, AV_LOG_ERROR, "Error decoding video\n"); break; } if (got_frame) { frame->pts = av_frame_get_best_effort_timestamp(frame); /* pts: Presentation Time Stamp */ /* push the decoded frame into the filtergraph */ if (av_buffersrc_add_frame_flags(buffersrc_ctx, frame, AV_BUFFERSRC_FLAG_KEEP_REF) < 0) { av_log(NULL, AV_LOG_ERROR, "Error while feeding the filtergraph\n"); break; } /* pull filtered frames from the filtergraph */ while (1) { ret = av_buffersink_get_frame(buffersink_ctx, filt_frame); if (ret == AVERROR(EAGAIN) || ret == AVERROR_EOF) break; if (ret < 0) goto end; #ifndef SAVE_FILE display_frame(filt_frame, buffersink_ctx->inputs[0]->time_base); #else write_frame(filt_frame); #endif av_frame_unref(filt_frame); } /* Unreference all the buffers referenced by frame and reset the frame fields. */ av_frame_unref(frame); } } av_packet_unref(&packet); } end: avfilter_graph_free(&filter_graph); avcodec_close(dec_ctx); avformat_close_input(&fmt_ctx); av_frame_free(&frame); av_frame_free(&filt_frame); if (ret < 0 && ret != AVERROR_EOF) { fprintf(stderr, "Error occurred: %s\n", av_err2str(ret)); exit(1); } #ifdef SAVE_FILE fclose(file_fd); #endif exit(0); }

該工程中,我的Makefile檔案如下:

OUT_APP = test

INCLUDE_PATH = /usr/local/include/

INCLUDE = -I$(INCLUDE_PATH)libavutil/ -I$(INCLUDE_PATH)libavdevice/ \

-I$(INCLUDE_PATH)libavcodec/ -I$(INCLUDE_PATH)libswresample \

-I$(INCLUDE_PATH)libavfilter/ -I$(INCLUDE_PATH)libavformat \

-I$(INCLUDE_PATH)libswscale/

FFMPEG_LIBS = -lavformat -lavutil -lavdevice -lavcodec -lswresample -lavfilter -lswscale

SDL_LIBS =

LIBS = $(FFMPEG_LIBS)$(SDL_LIBS)

COMPILE_OPTS = $(INCLUDE)

C = c

OBJ = o

C_COMPILER = cc

C_FLAGS = $(COMPILE_OPTS) $(CPPFLAGS) $(CFLAGS)

LINK = cc -o

LINK_OPTS = -lz -lm -lpthread

LINK_OBJ = test.o

.$(C).$(OBJ):

$(C_COMPILER) -c $(C_FLAGS) $<

$(OUT_APP): $(LINK_OBJ)

$(LINK) 執行結果如下:

[email protected]:~/test/FFMPEG/filter$ ls

Makefile school.flv test test.c test.o

[email protected]:~/test/FFMPEG/filter$ ./test school.flv

[flv @ 0x12c16c0] video stream discovered after head already parsed

[flv @ 0x12c16c0] audio stream discovered after head already parsed

frame widht=1024,frame height=576

format is yuv420p

[email protected]:~/test/FFMPEG/filter$ ls

Makefile school.flv test test.c test.o test.yuv在這裡,我打印出來了輸出視訊的格式和圖片的長和寬,該例項生成的是一個YUV420 格式的視訊,使用YUV播放器播放視訊的時候,需要設定正確的視訊長度和寬度。在程式碼中通過設定enum AVPixelFormat pix_fmts[] = { AV_PIX_FMT_YUV420P, AV_PIX_FMT_NONE };來設定輸出格式。

過濾器的引數設定是通過const char *filter_descr = "scale=iw*2:ih*2"; 來設定。它表示將視訊的長和框都拉伸到原來的兩倍。具體的filter引數可以通過命令:ffmpeg -filters 來查詢。結果如下:

Filters:

T.. = Timeline support

.S. = Slice threading

..C = Command support

A = Audio input/output

V = Video input/output

N = Dynamic number and/or type of input/output

| = Source or sink filter

... abench A->A Benchmark part of a filtergraph.

... acompressor A->A Audio compressor.

... acrossfade AA->A Cross fade two input audio streams.

... acrusher A->A Reduce audio bit resolution.

.............................................................................在上面的程式碼中,我們設定的是將圖片拉昇到原來影象的兩倍,其顯示效果如下,可能是截圖的問題,這裡看好像沒有拉伸到兩倍。

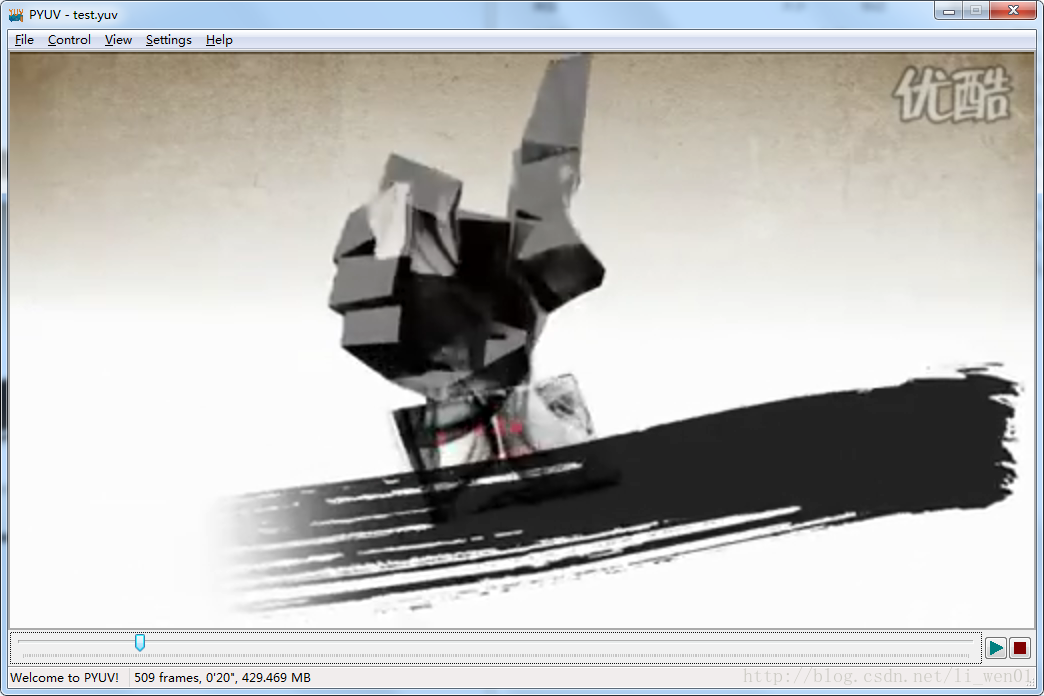

原圖

在上面的程式碼中,我們設定的是:

const char *filter_descr = "scale=iw*2:ih*2"; iw 表示輸入視訊的寬,ih表示輸入視訊的高。可以任意比例的縮放視訊。這裡*2 表示放大兩倍,如果是/2表示縮小兩倍。

視訊縮放還可以直接設定:

const char *filter_descr = "scale=320:240"; 設定視訊輸出寬為320,高位240,當然也是可以隨意的設定其他的引數。

視訊的裁剪可以設定為:

const char *filter_descr = "crop=320:240:0:0"; 具體含義是 crop=width:height:x:y,其中 width 和 height 表示裁剪後的尺寸,x:y 表示裁剪區域的左上角座標。

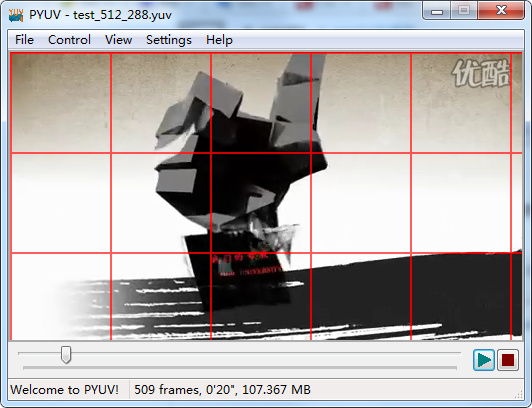

視訊新增一個網格水印可以設定為:

const char *filter_descr = "drawgrid=width=100:height=100:thickness=2:[email protected]"; 具體含義是 width 和 height 表示新增網格的寬和高,thickness表示網格的線寬,color表示顏色 。其效果如下:

相關推薦

FFMPEG 最簡濾鏡filter使用例項(實現視訊縮放,裁剪,水印等)

FFMPEG官網給出了FFMPEG 濾鏡使用的例項,它是將視訊中的畫素點替換成字元,然後從終端輸出。我在該例項的基礎上稍微的做了修改,使它能夠儲存濾鏡處理過後的檔案。在上程式碼之前先明白幾個概念: Filter:代表單個filter FilterPa

php圖片上傳類(支持縮放、裁剪、圖片縮略功能)

php圖片上傳類(支持縮放、裁剪、圖片縮代碼: /** * @author [Lee] <[<[email protected]>]> * 1、自動驗證文件是表單提交的文件還是base64流提交的文件 * 2、驗證圖片類型是否合法 * 3、驗證圖片尺寸是否合法 * 4、驗證圖片大小是否合法

【FFMpeg視訊開發與應用基礎】八、 呼叫FFMpeg SDK實現視訊縮放

《FFMpeg視訊開發與應用基礎——使用FFMpeg工具與SDK》視訊教程已經在“CSDN學院”上線,視訊中包含了從0開始逐行程式碼實現FFMpeg視訊開發的過程,歡迎觀看!連結地址:FFMpeg視訊開發與應用基礎——使用FFMpeg工具與SDK

CSS3屬性transform(旋轉:rotate,縮放:scale,傾斜:skew,移動:translate)

在CSS3中,可以利用transform功能來實現文字或影象的旋轉、縮放、傾斜、移動這四種類型的變形處理。 注意:都是以中心點為原點進行移動旋轉縮放傾斜的。 skew的預設原點是transform-origin是這個物件的中心點。 transform-origin:設定元素原點位置;

CSS3屬性transform詳解之(旋轉:rotate,縮放:scale,傾斜:skew,移動:translate)

一.旋轉 rotate 用法:transform: rotate(45deg); 共一個引數“角度”,單位deg為度的意思,正數為順時針旋轉,負數為逆時針旋轉,上述程式碼作用是順時針旋轉45度。 二.縮放 scale 用法:transform: scale(0.5

CSS技巧收集——毛玻璃效果(深入理解濾鏡filter)

* { margin: 0px; padding: 0px; } html, body { font-size: 19px; font-family: 'Verdana', 'Arial'; color: rgba(0, 0, 0, 0.8); wi

FFmpeg中的濾鏡(四):視訊濾鏡 -- subtitles

subtitles 描述: 該濾鏡呼叫libass庫,講字幕添新增到輸入視訊中。如果要使用該濾鏡,需要在編譯FFmpeg時使用--enable-libass配置項。這個濾鏡需要配合使用 libavcodec和libavformat將輸入的字幕檔案轉換為ASS(ASS格式見

HTML5----CSS3圖片濾鏡(filter)特效

拖動 ner hot war str term min jquer onchange 支持Chrome: 暫不支持瀏覽器:FF,IE... 希望後者努力 效果圖: CSS: <style type="text/css"> @-webkit-key

CoreImage中濾鏡filter的屬性

"Affine Clamp" = "AffineClamp"; "Affine Tile" = "AffineTile"; "Bars Swipe" = "棒狀滑動 (Bars Swipe)"; "Bars Swipe Transition" = "棒狀滑動過渡轉場 (Bars Sw

(轉)FFMPEG filter使用實例(實現視頻縮放,裁剪,水印等)

mina fort clean target mes dev 更多 nom 連接 本文轉載自http://blog.csdn.net/li_wen01/article/details/62442162 FFMPEG官網給出了FFMPEG 濾鏡使用的實例,它是將視頻中

CSS3濾鏡filter: blur,使圖片或背景模糊(毛玻璃)

CSS毛玻璃效果可以通過filter: blur()實現,類似PS高斯模糊,圖片和背景都可以使用;但在移動端,會造成卡頓,不建議在移動端使用; CSS: .blur{ -webkit-filter: blur(5px); -moz-filter: blur(5px);

iOS中濾鏡的使用(二)濾鏡組合

iOS中濾鏡的使用(二) 濾鏡組合 首先 要載入圖片並轉化為CIImage CIImage *ciImage = [[CIImage alloc] initWithImage:[UIImage imageNamed:@"IMG_0160

如何使用busybox編譯和生成最簡linux根檔案系統(rootfs)

繼前幾天對uboot和核心編譯進行了初步瞭解之後,昨天開始研究如何製作rootfs根檔案系統。昨晚對busybox這個工具有了初步的瞭解,今天繼續深入研究,終於成功的製作出了一套完整可用的最簡linux rootfs根檔案系統。現記錄詳細步驟以備日後查閱。 一

C#--TCP例項(實現了client)

如果你耐得住寂寞,這個聊天軟體你可以玩一年 這是客戶端的程式碼: using System; using System.Collections.Generic; using System.Linq; using System.Text; using System.Thr

史上最簡單清晰的查詢講解(紅黑樹、散列表、B樹)

我們會用三種經典的資料型別來實現高效的符號表:二叉查詢數、紅黑樹、散列表。二分查詢我們使用有序陣列儲存鍵,經典的二分查詢能夠根據陣列的索引大大減少每次查詢所需的比較次數。在查詢時,我們先將被查詢的鍵和子陣列的中間鍵比較。如果被查詢的鍵小於中間鍵,我們就在左子陣列中繼續查詢,如

Varnish的部署與使用例項(內附一鍵安裝部署指令碼github連結)

Varnish的部署與使用 指令碼及原始碼安裝包連結 概述 Varnish是一款高效能且開源的反向代理伺服器和http加速器 與傳統的Squid相比,Varnish具有效能更高,速度更快,管理更方便等諸多優點。 編譯安裝 這裡展

ACM-ICPC 2015 Asia Tsukuba Regional Online Open Contest B(兩擋板之間放著圓球,求擋板最短距離)

一開始想得很麻煩,然後發現又讀漏了可以簡化題目的資訊……好不容易想到的方法一定要記錄一下。。。 #include<iostream> #include<algorithm> #include<string> #inclu

獲取數值型數組的最大值和最小值,使用遍歷獲取每一個值,然後記錄最大值和最小值的方式。(數組遍歷嵌套if判斷語句)

if判斷 增強 ++ pre sta 方法 最小值 test 記錄 package com.Summer_0420.cn; /** * @author Summer * .獲取數值型數組的最大值、最小值 * 方法:遍歷獲取每一個值,記錄最大值; *

【轉】淺談一個網頁打開的全過程(涉及DNS、CDN、Nginx負載均衡等)

位置 filters 產生 多種方法 tps windows cnblogs 這就是 廣東 1、概要 從用戶在瀏覽器輸入域名開始,到web頁面加載完畢,這是一個說復雜不復雜,說簡單不簡單的過程,下文暫且把這個過程稱作網頁加載過程。下面我將依靠自己的經驗,總結一下整個過程

java入門(類型轉換、字符串操作等)

過程 boolean ava 字符串 符號 兩個 uppercase rim 算術 java基礎數據類型:不能=null; 四類八種: 整數型: byte 2的8次方 short 2的16次方 int 2的32次方