一文讀懂APU/BPU/CPU/DPU/EPU/FPU/GPU等處理器

隨著AI概念火爆全球,做AI晶片的公司也層出不窮。為了讓市場和觀眾能記住自家的產品,各家在晶片命名方面都下了點功夫,既要獨特,又要和公司產品契合,還要朗朗上口,也要容易讓人記住。比較有意思的是,很多家都採用了“xPU”的命名方式。

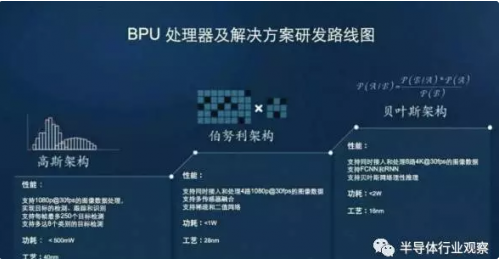

本文就來盤點一下目前各種“xPU”命名AI晶片,以及晶片行業裡的各種“xPU”縮寫,供吃瓜群眾消遣,也供後來者起名參考。此外,除了“xPU”命名方式,本文也擴充套件了一些“xxP”方式的以Processor命名的晶片或IP。此外的此外,拍腦袋拍出了一些xPU命名備選方案,用下劃線標示,並歡迎讀者一起來開腦洞。有心在AI晶片發力的公司,趕緊先搶個字母吧。APUAccelerated Processing Unit。目前還沒有AI公司將自己的 Biological Processing Unit。一個口號“21 世紀是生物學的世紀”忽悠了無數的有志青年跳入了生物領域的大坑。其實,這句話需要這麼理解,生物學的進展會推動21世紀其他學科的發展。比如,對人腦神經系統的研究成果就會推動AI領域的發展,SNN結構就是對人腦神經元的模擬。不管怎麼說,隨著時間的推移,坑總會被填平的。不知道生物處理器在什麼時間會有質的發展。Bio-Recognition Processing Unit。生物特徵識別現在已經不是紙上談兵的事情了。指紋識別已經是近來智慧手機的標配,電影裡的黑科技虹膜識別也上了手機,聲紋識別可以支付了...不過,除了指紋識別有專門的ASIC晶片外,其他生物識別還基本都是sensor加通用cpu/dsp的方案。不管怎樣,這些晶片都沒佔用BPU或BRPU這個寶貴位置。CPU

Biological Processing Unit。一個口號“21 世紀是生物學的世紀”忽悠了無數的有志青年跳入了生物領域的大坑。其實,這句話需要這麼理解,生物學的進展會推動21世紀其他學科的發展。比如,對人腦神經系統的研究成果就會推動AI領域的發展,SNN結構就是對人腦神經元的模擬。不管怎麼說,隨著時間的推移,坑總會被填平的。不知道生物處理器在什麼時間會有質的發展。Bio-Recognition Processing Unit。生物特徵識別現在已經不是紙上談兵的事情了。指紋識別已經是近來智慧手機的標配,電影裡的黑科技虹膜識別也上了手機,聲紋識別可以支付了...不過,除了指紋識別有專門的ASIC晶片外,其他生物識別還基本都是sensor加通用cpu/dsp的方案。不管怎樣,這些晶片都沒佔用BPU或BRPU這個寶貴位置。CPU TensTorrent 一家位於Toronto的start-up,研發專為深度學習和智慧硬體而設計的高效能處理器,技術人員來自NVDIA和AMD。Deep Learning Unit。深度學習單元。Fujitsu(富士通)最近高調宣佈了自家的AI晶片,命名為DLU。名字雖然沒什麼創意,但是可以看到DLU已經被富士通標了“TM”,雖然TM也沒啥用。在其公佈的資訊裡可以看到,DLU的ISA是重新設計的,DLU的架構中包含眾多小的DPU(Deep Learning Processing Unit)和幾個大的master core(控制多個DPU和memory訪問)。每個DPU中又包含了16個DPE(Deep-Learning Processing Element),共128個執行單元來執行SIMD指令。富士通預計2018財年內推出DLU。

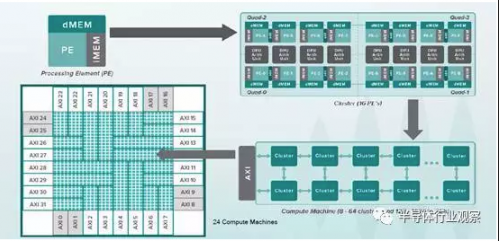

TensTorrent 一家位於Toronto的start-up,研發專為深度學習和智慧硬體而設計的高效能處理器,技術人員來自NVDIA和AMD。Deep Learning Unit。深度學習單元。Fujitsu(富士通)最近高調宣佈了自家的AI晶片,命名為DLU。名字雖然沒什麼創意,但是可以看到DLU已經被富士通標了“TM”,雖然TM也沒啥用。在其公佈的資訊裡可以看到,DLU的ISA是重新設計的,DLU的架構中包含眾多小的DPU(Deep Learning Processing Unit)和幾個大的master core(控制多個DPU和memory訪問)。每個DPU中又包含了16個DPE(Deep-Learning Processing Element),共128個執行單元來執行SIMD指令。富士通預計2018財年內推出DLU。 Deep Learning Accelerator。深度學習加速器。NVIDA宣佈將這個DLA開源,給業界帶來了不小的波瀾。大家都在猜測開源DLA會給其他AI公司帶來什麼。參考這篇吧"從Nvidia開源深度學習加速器說起"Dataflow Processing Unit。資料流處理器。創立於2010年的wave computing公司將其開發的深度學習加速處理器稱為Dataflow Processing Unit(DPU),應用於資料中心。Wave的DPU內整合1024個cluster。每個Cluster對應一個獨立的全定製版圖,每個Cluster內包含8個算術單元和16個PE。其中,PE用非同步邏輯設計實現,沒有時鐘訊號,由資料流驅動,這就是其稱為Dataflow Processor的緣由。使用TSMC 16nm FinFET工藝,DPU die面積大概400mm^2,內部單口sram至少24MB,功耗約為200W,等效頻率可達10GHz,效能可達181TOPS。前面寫過一篇他家DPU的分析,見傳輸門AI晶片|淺析Yann LeCun提到的兩款Dataflow Chip。

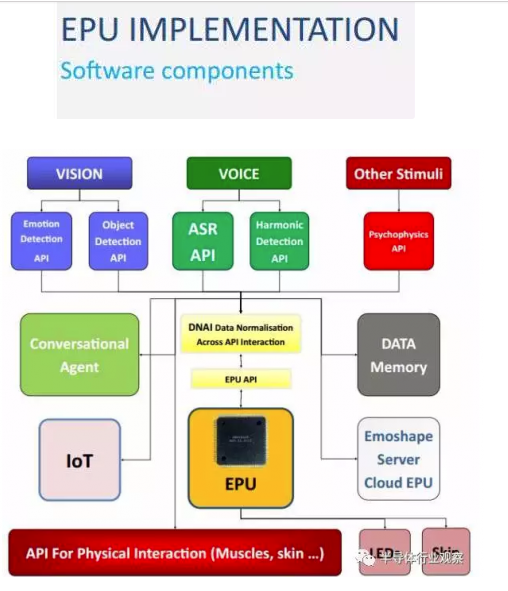

Deep Learning Accelerator。深度學習加速器。NVIDA宣佈將這個DLA開源,給業界帶來了不小的波瀾。大家都在猜測開源DLA會給其他AI公司帶來什麼。參考這篇吧"從Nvidia開源深度學習加速器說起"Dataflow Processing Unit。資料流處理器。創立於2010年的wave computing公司將其開發的深度學習加速處理器稱為Dataflow Processing Unit(DPU),應用於資料中心。Wave的DPU內整合1024個cluster。每個Cluster對應一個獨立的全定製版圖,每個Cluster內包含8個算術單元和16個PE。其中,PE用非同步邏輯設計實現,沒有時鐘訊號,由資料流驅動,這就是其稱為Dataflow Processor的緣由。使用TSMC 16nm FinFET工藝,DPU die面積大概400mm^2,內部單口sram至少24MB,功耗約為200W,等效頻率可達10GHz,效能可達181TOPS。前面寫過一篇他家DPU的分析,見傳輸門AI晶片|淺析Yann LeCun提到的兩款Dataflow Chip。 Digital Signal Processor。數字訊號處理器。晶片行業的人對DSP都不陌生,設計DSP的公司也很多,TI,Qualcomm,CEVA,Tensilica,ADI,Freescale等等,都是大公司,此處不多做介紹。相比於CPU,DSP通過增加指令並行度來提高數字計算的效能,如SIMD、VLIW、SuperScalar等技術。面對AI領域新的計算方式(例如CNN、DNN等)的挑戰,DSP公司也在馬不停蹄地改造自己的DSP,推出支援神經網路計算的晶片系列。在後面VPU的部分,會介紹一下針對Vision應用的DSP。和CPU一樣,DSP的技術很長時間以來都掌握在外國公司手裡,國內也不乏兢兢業業在這方向努力的科研院所,如清華大學微電子所的Lily DSP(VLIW架構,有獨立的編譯器),以及國防科大的YHFT-QDSP和矩陣2000。但是,也有臭名昭著的“漢芯”。EPUEmotion Processing Unit。Emoshape 並不是這兩年才推出EPU的,號稱是全球首款情緒合成(emotion synthesis)引擎,可以讓機器人具有情緒。但是,從官方渠道訊息看,EPU本身並不複雜,也不需要做任務量巨大的神經網路計算,是基於MCU的晶片。結合應用API以及雲端的增強學習演算法,EPU可以讓機器能夠在情緒上了解它們所讀或所看的內容。結合自然語言生成(NLG)及WaveNet技術,可以讓機器個性化的表達各種情緒。例如,一部能夠朗讀的Kindle,其語音將根據所讀的內容充滿不同的情緒狀態。

Digital Signal Processor。數字訊號處理器。晶片行業的人對DSP都不陌生,設計DSP的公司也很多,TI,Qualcomm,CEVA,Tensilica,ADI,Freescale等等,都是大公司,此處不多做介紹。相比於CPU,DSP通過增加指令並行度來提高數字計算的效能,如SIMD、VLIW、SuperScalar等技術。面對AI領域新的計算方式(例如CNN、DNN等)的挑戰,DSP公司也在馬不停蹄地改造自己的DSP,推出支援神經網路計算的晶片系列。在後面VPU的部分,會介紹一下針對Vision應用的DSP。和CPU一樣,DSP的技術很長時間以來都掌握在外國公司手裡,國內也不乏兢兢業業在這方向努力的科研院所,如清華大學微電子所的Lily DSP(VLIW架構,有獨立的編譯器),以及國防科大的YHFT-QDSP和矩陣2000。但是,也有臭名昭著的“漢芯”。EPUEmotion Processing Unit。Emoshape 並不是這兩年才推出EPU的,號稱是全球首款情緒合成(emotion synthesis)引擎,可以讓機器人具有情緒。但是,從官方渠道訊息看,EPU本身並不複雜,也不需要做任務量巨大的神經網路計算,是基於MCU的晶片。結合應用API以及雲端的增強學習演算法,EPU可以讓機器能夠在情緒上了解它們所讀或所看的內容。結合自然語言生成(NLG)及WaveNet技術,可以讓機器個性化的表達各種情緒。例如,一部能夠朗讀的Kindle,其語音將根據所讀的內容充滿不同的情緒狀態。 FPU先說一個最常用的FPU縮寫:Floating Point Unit。浮點單元,不多做解釋了。現在高效能的CPU、DSP、GPU內都集成了FPU做浮點運算。Force Processing Unit。原力處理器,助你成為絕地武士。酷!GPUGraphics Processing Unit。圖形處理器。GPU原來最大的需求來自PC市場上各類遊戲對圖形處理的需求。但是隨著移動裝置的升級,在移動端也逐漸發展起來。NVIDIA 說起GPU,毫無疑問現在的老大是NVIDIA。這家成立於1993年的晶片公司一直致力於設計各種GPU:針對個人和遊戲玩家的GeForce系列,針對專業工作站的Quadro系列,以及針對伺服器和高效能運算的Tesla系列。隨著AI的發展,NVIDIA在AI應用方面不斷髮力,推出了針對自動駕駛的DRIVE系列,以及專為AI打造的VOLTA架構。特別提一下VOLTA,今年5月份,NVIDIA釋出的Tesla V100採用TSMC 12nm工藝,面積竟然815mm^2,號稱相關研發費用高達30億美元。得益於在AI領域的一家獨大,NVIFIA的股價在過去一年的時間裡狂漲了300%。最後,也別忘了NVIDIA家還有集成了GeForce GPU的Tegra系列移動處理器。AMD 這幾年NVIDIA的火爆,都快讓大家忘了AMD的存在了。AMD是晶片行業中非常古老的一家晶片公司,成立於1969年,比NVIDIA要早很多年。AMD最出名的GPU品牌Radeon來自於其2006年以54億美元收購的ATI公司(暴露年齡地說,本人的第一臺PC的顯示卡就是ATI的)。本文第一個詞條APU就是AMD家的產品。AMD新出的MI系列GPU將目標對準AI。

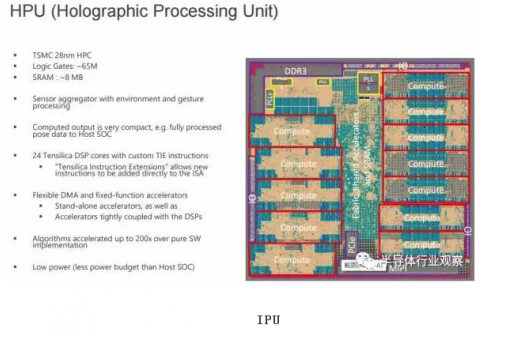

FPU先說一個最常用的FPU縮寫:Floating Point Unit。浮點單元,不多做解釋了。現在高效能的CPU、DSP、GPU內都集成了FPU做浮點運算。Force Processing Unit。原力處理器,助你成為絕地武士。酷!GPUGraphics Processing Unit。圖形處理器。GPU原來最大的需求來自PC市場上各類遊戲對圖形處理的需求。但是隨著移動裝置的升級,在移動端也逐漸發展起來。NVIDIA 說起GPU,毫無疑問現在的老大是NVIDIA。這家成立於1993年的晶片公司一直致力於設計各種GPU:針對個人和遊戲玩家的GeForce系列,針對專業工作站的Quadro系列,以及針對伺服器和高效能運算的Tesla系列。隨著AI的發展,NVIDIA在AI應用方面不斷髮力,推出了針對自動駕駛的DRIVE系列,以及專為AI打造的VOLTA架構。特別提一下VOLTA,今年5月份,NVIDIA釋出的Tesla V100採用TSMC 12nm工藝,面積竟然815mm^2,號稱相關研發費用高達30億美元。得益於在AI領域的一家獨大,NVIFIA的股價在過去一年的時間裡狂漲了300%。最後,也別忘了NVIDIA家還有集成了GeForce GPU的Tegra系列移動處理器。AMD 這幾年NVIDIA的火爆,都快讓大家忘了AMD的存在了。AMD是晶片行業中非常古老的一家晶片公司,成立於1969年,比NVIDIA要早很多年。AMD最出名的GPU品牌Radeon來自於其2006年以54億美元收購的ATI公司(暴露年齡地說,本人的第一臺PC的顯示卡就是ATI的)。本文第一個詞條APU就是AMD家的產品。AMD新出的MI系列GPU將目標對準AI。 在移動端市場,GPU被三家公司瓜分,但是也阻止不了新的競爭者殺入。ARM家的Mali Mali不是ARM的自創GPU品牌,來自於ARM於2006年收購的Falanx公司。Falanx最初的GPU是面向PC市場的,但是根本就無法參與到NVIDIA和ATI的競爭中去,於是轉向移動市場;並且Falanx最初的GPU的名字也不是Mali,而是Maliak,為了好記,改為Mali,來自羅馬尼亞文,意思是small,而不是我們熟悉的吃蘑菇救公主的超級瑪麗(SuperMALI)。Imagination的PowerVR 主要客戶是蘋果,所以主要精力都在支援蘋果,對其他客戶的支援不足。但是,蘋果突然宣佈放棄PVR轉為自研,對Imagination打擊不小,股價大跌六成。Imagination現在正在尋求整體出售,土財快追,但是,美國未必批。Qualcomm的Adreno 技術來自於AMD收購ATI後出售的移動GPU品牌Imageon。有意思的是,名字改自於ATI的知名GPU品牌Radeon;VeriSilicon的Vivante Vivante(圖芯)是一家成立於2004年的以做嵌入式GPU為主的晶片公司,於2015年被VSI收購。Vivante的市場佔有率較低。這裡多加一段小八卦,Vivante的創始人叫戴偉進,VSI的創始人叫戴偉民,一句話對這次收購進行總結就是,戴家老大收購了戴家老二。哦,對了,戴家還有一個三妹戴偉立,創立的公司名號更響亮:Marvell。Samsung的。。。哦,三星沒有自己的GPU。作為一個IDM巨頭,對於沒有自家的GPU,三星一直耿耿於懷。三星也宣佈要研發自家的移動端GPU晶片,不過要等到2020年了。再簡單補充國內的兩家開發GPU的公司:上海兆芯 兆芯是VIA(威盛)分離出來的。兆芯於2016年針對移動端出了一款GPU晶片ZX-2000,名字有點簡單直接。主要技術來源於威盛授權,GPU核心技術來自收購的美國S3 Graphics。長沙景嘉微電子 於2014年推出一款GPU晶片JM5400。這是一家有國防科大背景的公司,與龍芯為合作伙伴,晶片主要應用在軍用飛機和神舟飛船上。Graph Streaming Processor。圖形流處理器。這是ThinCI(取意think-eye)提出的縮寫。ThinCI是一家致力於打造deep learning和computer vision晶片的start-up,由4名Intel前員工創立於2010年,總部在Sacramento,在印度也有研發人員。ThinCI的視覺晶片瞄準了自動駕駛應用,投資方有世界頂級汽車零部件供應商公司日本電裝DENSO。在剛結束的hotchip會議上,ThinCI介紹了他們的GSP(於是本文作者將ThinCI從VPU部分移到了這裡),使用了多種結構性技術來實現任務級、執行緒級、資料級和指令級的並行。GSP使用TSMC 28nm HPC+工藝,功耗預計2.5W。HPUHolographic Processing Unit。全息處理器。Microsoft專為自家Hololens應用開發的。第一代HPU採用28nm HPC工藝,使用了24個Tensilica DSP並進行了定製化擴充套件。HPU支援5路cameras、1路深度感測器(Depth sensor)和1路動作感測器(Motion Sensor)。Microsoft 在最近的CVPR 2017上宣佈了HPU2的一些資訊。HPU2將搭載一顆支援DNN的協處理器,專門用於在本地執行各種深度學習。指的一提的是,HPU是一款為特定應用所打造的晶片,這個做產品的思路可以學習。據說Microsoft評測過Movidius(見VPU部分)的晶片,但是覺得無法滿足演算法對效能、功耗和延遲的要求,所有才有了HPU。

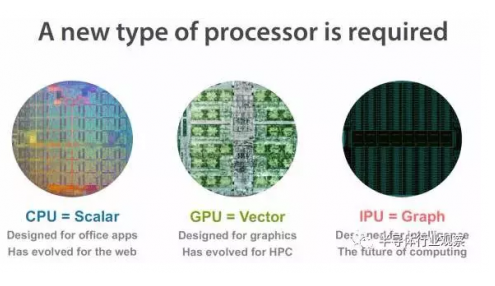

在移動端市場,GPU被三家公司瓜分,但是也阻止不了新的競爭者殺入。ARM家的Mali Mali不是ARM的自創GPU品牌,來自於ARM於2006年收購的Falanx公司。Falanx最初的GPU是面向PC市場的,但是根本就無法參與到NVIDIA和ATI的競爭中去,於是轉向移動市場;並且Falanx最初的GPU的名字也不是Mali,而是Maliak,為了好記,改為Mali,來自羅馬尼亞文,意思是small,而不是我們熟悉的吃蘑菇救公主的超級瑪麗(SuperMALI)。Imagination的PowerVR 主要客戶是蘋果,所以主要精力都在支援蘋果,對其他客戶的支援不足。但是,蘋果突然宣佈放棄PVR轉為自研,對Imagination打擊不小,股價大跌六成。Imagination現在正在尋求整體出售,土財快追,但是,美國未必批。Qualcomm的Adreno 技術來自於AMD收購ATI後出售的移動GPU品牌Imageon。有意思的是,名字改自於ATI的知名GPU品牌Radeon;VeriSilicon的Vivante Vivante(圖芯)是一家成立於2004年的以做嵌入式GPU為主的晶片公司,於2015年被VSI收購。Vivante的市場佔有率較低。這裡多加一段小八卦,Vivante的創始人叫戴偉進,VSI的創始人叫戴偉民,一句話對這次收購進行總結就是,戴家老大收購了戴家老二。哦,對了,戴家還有一個三妹戴偉立,創立的公司名號更響亮:Marvell。Samsung的。。。哦,三星沒有自己的GPU。作為一個IDM巨頭,對於沒有自家的GPU,三星一直耿耿於懷。三星也宣佈要研發自家的移動端GPU晶片,不過要等到2020年了。再簡單補充國內的兩家開發GPU的公司:上海兆芯 兆芯是VIA(威盛)分離出來的。兆芯於2016年針對移動端出了一款GPU晶片ZX-2000,名字有點簡單直接。主要技術來源於威盛授權,GPU核心技術來自收購的美國S3 Graphics。長沙景嘉微電子 於2014年推出一款GPU晶片JM5400。這是一家有國防科大背景的公司,與龍芯為合作伙伴,晶片主要應用在軍用飛機和神舟飛船上。Graph Streaming Processor。圖形流處理器。這是ThinCI(取意think-eye)提出的縮寫。ThinCI是一家致力於打造deep learning和computer vision晶片的start-up,由4名Intel前員工創立於2010年,總部在Sacramento,在印度也有研發人員。ThinCI的視覺晶片瞄準了自動駕駛應用,投資方有世界頂級汽車零部件供應商公司日本電裝DENSO。在剛結束的hotchip會議上,ThinCI介紹了他們的GSP(於是本文作者將ThinCI從VPU部分移到了這裡),使用了多種結構性技術來實現任務級、執行緒級、資料級和指令級的並行。GSP使用TSMC 28nm HPC+工藝,功耗預計2.5W。HPUHolographic Processing Unit。全息處理器。Microsoft專為自家Hololens應用開發的。第一代HPU採用28nm HPC工藝,使用了24個Tensilica DSP並進行了定製化擴充套件。HPU支援5路cameras、1路深度感測器(Depth sensor)和1路動作感測器(Motion Sensor)。Microsoft 在最近的CVPR 2017上宣佈了HPU2的一些資訊。HPU2將搭載一顆支援DNN的協處理器,專門用於在本地執行各種深度學習。指的一提的是,HPU是一款為特定應用所打造的晶片,這個做產品的思路可以學習。據說Microsoft評測過Movidius(見VPU部分)的晶片,但是覺得無法滿足演算法對效能、功耗和延遲的要求,所有才有了HPU。 IPUIntelligence Processing Unit。智慧處理器。以IPU命名晶片的有兩家公司。Graphcore Graphcore公司的IPU是專門針對graph的計算而打造的。稍微說說Graph,Graphcore認為Graph是知識模型及相應演算法的非常自然的表示,所以將Graph作為機器智慧的基礎表示方法,既適用於神經網路,也適用於貝葉斯網路和馬爾科夫場,以及未來可能出現的新的模型和演算法。Graphcore的IPU一直比較神祕,直到近期才有一些細節的資訊釋出。比如:16nm,同構多核(>1000)架構,同時支援training和inference,使用大量片上sram,效能優於Volta GPU和TPU2,預計2017年底會有產品釋出,等等。多八卦一點,Graphcore的CEO和CTO以前創立的做無線通訊晶片的公司Icera於2011年被Nvidia收購併於2015年關閉。關於IPU更細節的描述,可以看唐博士的微信公號的一篇文章,傳輸門:解密又一個xPU:Graphcore的IPU。

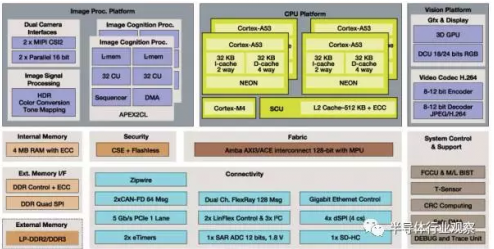

IPUIntelligence Processing Unit。智慧處理器。以IPU命名晶片的有兩家公司。Graphcore Graphcore公司的IPU是專門針對graph的計算而打造的。稍微說說Graph,Graphcore認為Graph是知識模型及相應演算法的非常自然的表示,所以將Graph作為機器智慧的基礎表示方法,既適用於神經網路,也適用於貝葉斯網路和馬爾科夫場,以及未來可能出現的新的模型和演算法。Graphcore的IPU一直比較神祕,直到近期才有一些細節的資訊釋出。比如:16nm,同構多核(>1000)架構,同時支援training和inference,使用大量片上sram,效能優於Volta GPU和TPU2,預計2017年底會有產品釋出,等等。多八卦一點,Graphcore的CEO和CTO以前創立的做無線通訊晶片的公司Icera於2011年被Nvidia收購併於2015年關閉。關於IPU更細節的描述,可以看唐博士的微信公號的一篇文章,傳輸門:解密又一個xPU:Graphcore的IPU。 Mythic 另外一家剛融了$9.3 million的start-up公司Mythic也提到了IPU:“Mythic's intelligence processing unit (IPU) adds best-in-class intelligence to any device”。和現在流行的數位電路平臺方案相比,Mythic號稱可以將功耗降到1/50。之所以這麼有信心,是因為他們使用的“processing in memory”結構。關於Processing in Memory,又可以大寫一篇了,這裡就不擴充套件了。有興趣的,可以google一下“UCSB 謝源”,從他的研究開始瞭解。Image Cognition Processor。影象認知處理器ICP,加拿大公司CogniVue開發的用於視覺處理和影象認知的IP。跑個題,CogniVue一開始是Freescale的IP供應商,後來於2015年被Freescale收購以進一步加強ADAS晶片的整合開發;隨後,Freescale又被NXP 118億美元拿下;還沒完,高通近400億美元吞併了NXP。 現在NXP家的ADAS SOC晶片S32V系列中,就用到了兩個ICP IP。

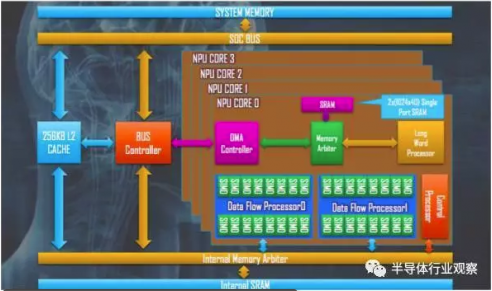

Mythic 另外一家剛融了$9.3 million的start-up公司Mythic也提到了IPU:“Mythic's intelligence processing unit (IPU) adds best-in-class intelligence to any device”。和現在流行的數位電路平臺方案相比,Mythic號稱可以將功耗降到1/50。之所以這麼有信心,是因為他們使用的“processing in memory”結構。關於Processing in Memory,又可以大寫一篇了,這裡就不擴充套件了。有興趣的,可以google一下“UCSB 謝源”,從他的研究開始瞭解。Image Cognition Processor。影象認知處理器ICP,加拿大公司CogniVue開發的用於視覺處理和影象認知的IP。跑個題,CogniVue一開始是Freescale的IP供應商,後來於2015年被Freescale收購以進一步加強ADAS晶片的整合開發;隨後,Freescale又被NXP 118億美元拿下;還沒完,高通近400億美元吞併了NXP。 現在NXP家的ADAS SOC晶片S32V系列中,就用到了兩個ICP IP。 Image Processing Unit。影象處理器。一些SOC晶片中將處理靜態影象的模組稱為IPU。但是,IPU不是一個常用的縮寫,更常見的處理影象訊號的處理器的縮寫為下面的ISP。Image Signal Processor 。影象訊號處理器。這個話題也不是一個小話題。ISP的功能,簡單的來說就是處理camera等攝像裝置的輸出訊號,實現降噪、Demosaicing、HDR、色彩管理等功能。以前是各種數碼相機、單反相機中的標配。Canon、Nikon、Sony等等,你能想到的出數碼相機的公司幾乎都有自己的ISP。進入手機攝影時代,人們對攝影攝像的要求也越來越高,ISP必不可少。說回AI領域,camera採集影象資料,也要先經過ISP進行處理之後,再由視覺演算法(執行在CPU、GPU或ASIC加速器上的)進行分析、識別、分類、追蹤等進一步處理。也許,隨著AI技術發展,ISP的一些操作會直接被end-2-end的視覺演算法統一。JPU請原諒鄙人的詞彙量,沒什麼新奇的想法。。。。KPUKnowledge Processing Unit。 嘉楠耘智(canaan)號稱2017年將釋出自己的AI晶片KPU。嘉楠耘智要在KPU單一晶片中整合人工神經網路和高效能處理器,主要提供異構、實時、離線的人工智慧應用服務。這又是一家向AI領域擴張的不差錢的礦機公司。作為一家做礦機晶片(自稱是區塊鏈專用晶片)和礦機的公司,嘉楠耘智累計獲得近3億元融資,估值近33億人民幣。據說嘉楠耘智近期將啟動股改並推進IPO。另:Knowledge Processing Unit這個詞並不是嘉楠耘智第一個提出來的,早在10年前就已經有論文和書籍講到這個詞彙了。只是,現在嘉楠耘智將KPU申請了註冊商標。LPU誰給我點靈感?MPUMicro Processing Unit。微處理器。MPU,CPU,MCU,這三個概念差不多,知道就行了。Mind Processing Unit。意念處理器,聽起來不錯。“解讀腦電波”,“意念交流”,永恆的科幻話題。如果採集大量人類“思考”的腦電波資料,通過深度學習,再加上強大的意念處理器MPU,不知道能否成為mind-reader。如果道德倫理上無法接受,先了解一下家裡寵物貓寵物狗的“想法”也是可以的嗎。再進一步,從mind-reader發展為mind-writer,持續升級之後,是不是就可以成為冰與火中的Skinchanger?Mobile Processing Unit。移動處理器,似乎沒什麼意思。Motion Processing Unit。運動處理器。解析人類、動物的肌肉運動?題外話:並不是所有的xPU都是處理器,比如有個MPU,是Memory Protection Unit的縮寫,是記憶體保護單元,是ARM核中配備的具有記憶體區域保護功能的模組。NPUNeural-Network Processing Unit。與GPU類似,神經網路處理器NPU已經成為了一個通用名詞,而非某家公司的專用縮寫。由於神經網路計算的型別和計算量與傳統計算的區別,導致在進行NN計算的時候,傳統CPU、DSP甚至GPU都有算力、效能、能效等方面的不足,所以激發了專為NN計算而設計NPU的需求。這裡羅列幾個以NPU名義釋出過產品的公司,以及幾個學術圈的神經網路加速器。中星微電子(Vimicro)的星光智慧一號。中星微於2016年搶先發布了“星光智慧一號”NPU。但是,這不是一個專為加速Neural Network而開發的處理器。業內都知道其內部集成了多個DSP核(其稱為NPU core),通過SIMD指令的排程來實現對CNN、DNN的支援。以這個邏輯,似乎很多晶片都可以叫NPU,其他以DSP為計算核心的SOC晶片的命名和宣傳都相對保守了。

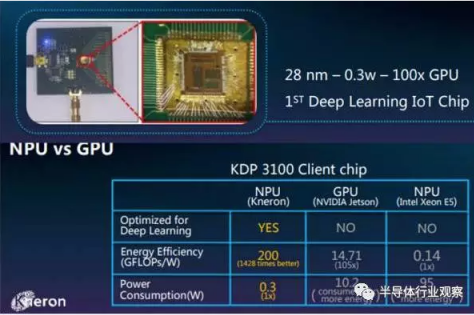

Image Processing Unit。影象處理器。一些SOC晶片中將處理靜態影象的模組稱為IPU。但是,IPU不是一個常用的縮寫,更常見的處理影象訊號的處理器的縮寫為下面的ISP。Image Signal Processor 。影象訊號處理器。這個話題也不是一個小話題。ISP的功能,簡單的來說就是處理camera等攝像裝置的輸出訊號,實現降噪、Demosaicing、HDR、色彩管理等功能。以前是各種數碼相機、單反相機中的標配。Canon、Nikon、Sony等等,你能想到的出數碼相機的公司幾乎都有自己的ISP。進入手機攝影時代,人們對攝影攝像的要求也越來越高,ISP必不可少。說回AI領域,camera採集影象資料,也要先經過ISP進行處理之後,再由視覺演算法(執行在CPU、GPU或ASIC加速器上的)進行分析、識別、分類、追蹤等進一步處理。也許,隨著AI技術發展,ISP的一些操作會直接被end-2-end的視覺演算法統一。JPU請原諒鄙人的詞彙量,沒什麼新奇的想法。。。。KPUKnowledge Processing Unit。 嘉楠耘智(canaan)號稱2017年將釋出自己的AI晶片KPU。嘉楠耘智要在KPU單一晶片中整合人工神經網路和高效能處理器,主要提供異構、實時、離線的人工智慧應用服務。這又是一家向AI領域擴張的不差錢的礦機公司。作為一家做礦機晶片(自稱是區塊鏈專用晶片)和礦機的公司,嘉楠耘智累計獲得近3億元融資,估值近33億人民幣。據說嘉楠耘智近期將啟動股改並推進IPO。另:Knowledge Processing Unit這個詞並不是嘉楠耘智第一個提出來的,早在10年前就已經有論文和書籍講到這個詞彙了。只是,現在嘉楠耘智將KPU申請了註冊商標。LPU誰給我點靈感?MPUMicro Processing Unit。微處理器。MPU,CPU,MCU,這三個概念差不多,知道就行了。Mind Processing Unit。意念處理器,聽起來不錯。“解讀腦電波”,“意念交流”,永恆的科幻話題。如果採集大量人類“思考”的腦電波資料,通過深度學習,再加上強大的意念處理器MPU,不知道能否成為mind-reader。如果道德倫理上無法接受,先了解一下家裡寵物貓寵物狗的“想法”也是可以的嗎。再進一步,從mind-reader發展為mind-writer,持續升級之後,是不是就可以成為冰與火中的Skinchanger?Mobile Processing Unit。移動處理器,似乎沒什麼意思。Motion Processing Unit。運動處理器。解析人類、動物的肌肉運動?題外話:並不是所有的xPU都是處理器,比如有個MPU,是Memory Protection Unit的縮寫,是記憶體保護單元,是ARM核中配備的具有記憶體區域保護功能的模組。NPUNeural-Network Processing Unit。與GPU類似,神經網路處理器NPU已經成為了一個通用名詞,而非某家公司的專用縮寫。由於神經網路計算的型別和計算量與傳統計算的區別,導致在進行NN計算的時候,傳統CPU、DSP甚至GPU都有算力、效能、能效等方面的不足,所以激發了專為NN計算而設計NPU的需求。這裡羅列幾個以NPU名義釋出過產品的公司,以及幾個學術圈的神經網路加速器。中星微電子(Vimicro)的星光智慧一號。中星微於2016年搶先發布了“星光智慧一號”NPU。但是,這不是一個專為加速Neural Network而開發的處理器。業內都知道其內部集成了多個DSP核(其稱為NPU core),通過SIMD指令的排程來實現對CNN、DNN的支援。以這個邏輯,似乎很多晶片都可以叫NPU,其他以DSP為計算核心的SOC晶片的命名和宣傳都相對保守了。 Kneron 這是一家位於San Diego的start-up公司,針對IOT應用領域做deep learning IP開發。Kneron開發的NPU實現了39層CNN,28nm下的功耗為0.3W,能效200GFLOPs/W。其主頁上給出的另一個能效資料是600GOPs/W。此外,Kneron同時也在FPGA開發雲端的硬體IP。據可靠訊息,Kneron也要在中國大陸建立研發部門了,地點涉及北京、上海、深圳。

Kneron 這是一家位於San Diego的start-up公司,針對IOT應用領域做deep learning IP開發。Kneron開發的NPU實現了39層CNN,28nm下的功耗為0.3W,能效200GFLOPs/W。其主頁上給出的另一個能效資料是600GOPs/W。此外,Kneron同時也在FPGA開發雲端的硬體IP。據可靠訊息,Kneron也要在中國大陸建立研發部門了,地點涉及北京、上海、深圳。 VeriSilicon(芯原)的VIP8000。VSI創立於2001年。VSI於今年5月以神經網路處理器IP的名義釋出了這款代號VIP8000的IP。從其公佈的訊息“VeriSilicon’s Vivante VIP8000 Neural Network Processor IP Delivers Over 3 Tera MACs Per Second”來看,這款晶片使用的並不是其DSP core,而是內建了其2015年收購的Vivante的GPU core。按照VSI的說法,VIP8000在16nm FinFET工藝下的計算力超過3 TMAC/s,能效高於1.5 GMAC/s/mW。

VeriSilicon(芯原)的VIP8000。VSI創立於2001年。VSI於今年5月以神經網路處理器IP的名義釋出了這款代號VIP8000的IP。從其公佈的訊息“VeriSilicon’s Vivante VIP8000 Neural Network Processor IP Delivers Over 3 Tera MACs Per Second”來看,這款晶片使用的並不是其DSP core,而是內建了其2015年收購的Vivante的GPU core。按照VSI的說法,VIP8000在16nm FinFET工藝下的計算力超過3 TMAC/s,能效高於1.5 GMAC/s/mW。 DNPU。Deep Neural-Network Processing Unit。DNPU來自於KAIST在ISSCC2017上發表的一篇文章。我把DNPU當做是NPU的一種別名,畢竟現在業內做的支援神經網路計算的晶片沒有隻支援“非深度”神經網路的。關於DNPU可以參考“從ISSCC Deep Learning處理器論文到人臉識別產品”。Eyeriss。MIT的神經網路專案,針對CNN的進行高能效的計算加速設計。Thinker。清華微電子所設計的一款可重構多模態神經計算晶片,可以平衡CNN和RNN在計算和頻寬之間的資源衝突。Neural/Neuromorphic Processing Unit。神經/神經形態處理器。這和上面的神經網路處理器還有所不同。而且,一般也不以“處理器”的名字出現,更多的時候被稱為“神經形態晶片(Neuromorphic Chip)”或者是“類腦晶片(Brain-Inspired Chip)”。這類AI晶片不是用CNN、DNN等網路形式來做計算,而是以更類似於腦神經組成結構的SNN(Spiking Neural Network)的形式來進行計算。隨便列幾個,都不是“xPU”的命名方式。Qualcomm的Zeroth。高通幾年前將Zeroth定義為一款NPU,配合以軟體,可以方便的實現SNN的計算。但是,NPU似乎不見了蹤影,現在只剩下了同名的機器學習引擎Zeroth SDK。IBM的TrueNorth。IBM2014年公佈的TrueNorth。在一顆晶片上集成了4096個並行的core,每個core包含了256個可程式設計的神經元neurons,一共1百萬個神經元。每個神經元有256個突觸synapses,共256 Mlillion。TrueNorth使用了三星的28nm的工藝,共5.4 billion個電晶體。BrainChip的SNAP(Spiking Neuron Adaptive Processor )。已經有了賭場的應用。GeneralVision的CM1K、NM500 chip,以及NeuroMem IP。這家公司的CM1K晶片有1k個神經元,每個神經元對應256Byte儲存。雖然無法和強大的TrueNorth相提並論,但是已有客戶應用。並且,提供BrainCard,上面有FPGA,並且可以直接和Arduino以及Raspberry Pi連線。Knowm 這家start-up在憶阻器(memristor)技術基礎上做“processing in memory”的AI晶片研發。不過,與前面提到的Mythic(IPU部分)不同的是,Known做的是類腦晶片。Knowm所用的關鍵技術是一種稱為熱力學記憶體(kT-RAM)的memory,是根據AHaH理論(Anti-Hebbian and Hebbian)發展而來。Koniku 成立於2014年的start-up,要利用生物神經元來做計算,"Biological neurons on a chip"。主頁在倒計時,可能要有重要進展公佈,期待。OPUOptical-Flow Processing Unit。光流處理器。有需要用專門的晶片來實現光流演算法嗎?不知道,但是,用ASIC IP來做加速應該是要的。PPUPhysical Processing Unit。物理處理器。要先解釋一下物理運算,就知道物理處理器是做什麼的了。物理計算,就是模擬一個物體在真實世界中應該符合的物理定律。具體的說,可以使虛擬世界中的物體運動符合真實世界的物理定律,可以使遊戲中的物體行為更加真實,例如布料模擬、毛髮模擬、碰撞偵測、流體力學模擬等。開發物理計算引擎的公司有那麼幾家,使用CPU來完成物理計算,支援多種平臺。但是,Ageia應該是唯一一個使用專用晶片來加速物理計算的公司。Ageia於2006年釋出了PPU晶片PhysX,還發布了基於PPU的物理加速卡,同時提供SDK給遊戲開發者。2008年被NVIDIA收購後,PhysX加速卡產品被逐漸取消,現在物理計算的加速功能由NVIDIA的GPU實現,PhysX SDK被NVIDIA重新打造。QPUQuantum Processing Unit。量子處理器。量子計算機也是近幾年比較火的研究方向。作者承認在這方面所知甚少。可以關注這家成立於1999年的公司D-Wave System。DWave大概每兩年可以將其QPU上的量子位個數翻倍一次。RPUResistive Processing Unit。阻抗處理單元RPU。這是IBM Watson Research Center的研究人員提出的概念,真的是個處理單元,而不是處理器。RPU可以同時實現儲存和計算。利用RPU陣列,IBM研究人員可以實現80TOPS/s/W的效能。Ray-tracing Processing Unit。光線追蹤處理器。Ray tracing是計算機圖形學中的一種渲染演算法,RPU是為加速其中的資料計算而開發的加速器。現在這些計算都是GPU的事情了。SPUStreaming Processing Unit。流處理器。流處理器的概念比較早了,是用於處理視訊資料流的單元,一開始出現在顯示卡晶片的結構裡。可以說,GPU就是一種流處理器。甚至,還曾經存在過一家名字為“Streaming Processor Inc”的公司,2004年創立,2009年,隨著創始人兼董事長被挖去NVIDIA當首席科學家,SPI關閉。Speech-Recognition Processing Unit。語音識別處理器,SPU或SRPU。這個縮寫還沒有公司拿來使用。現在的語音識別和語義理解主要是在雲端實現的,比如科大訊飛。科大訊飛最近推出了一個翻譯機,可以將語音傳回雲端,做實時翻譯,內部硬體沒有去專門瞭解。和語音識別相關的晶片如下。啟英泰倫(chipintelli) 於2015年11月在成都成立。該公司的CI1006是一款集成了神經網路加速硬體來做語音識別的晶片,可實現單晶片本地離線大詞彙量識別。

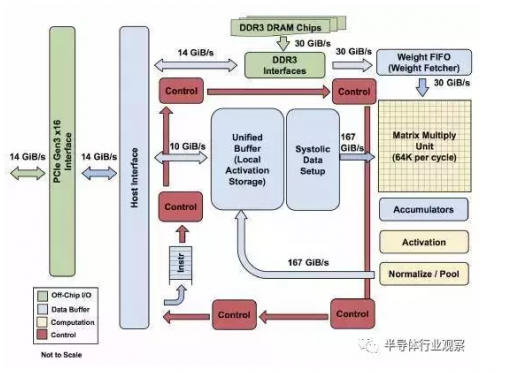

DNPU。Deep Neural-Network Processing Unit。DNPU來自於KAIST在ISSCC2017上發表的一篇文章。我把DNPU當做是NPU的一種別名,畢竟現在業內做的支援神經網路計算的晶片沒有隻支援“非深度”神經網路的。關於DNPU可以參考“從ISSCC Deep Learning處理器論文到人臉識別產品”。Eyeriss。MIT的神經網路專案,針對CNN的進行高能效的計算加速設計。Thinker。清華微電子所設計的一款可重構多模態神經計算晶片,可以平衡CNN和RNN在計算和頻寬之間的資源衝突。Neural/Neuromorphic Processing Unit。神經/神經形態處理器。這和上面的神經網路處理器還有所不同。而且,一般也不以“處理器”的名字出現,更多的時候被稱為“神經形態晶片(Neuromorphic Chip)”或者是“類腦晶片(Brain-Inspired Chip)”。這類AI晶片不是用CNN、DNN等網路形式來做計算,而是以更類似於腦神經組成結構的SNN(Spiking Neural Network)的形式來進行計算。隨便列幾個,都不是“xPU”的命名方式。Qualcomm的Zeroth。高通幾年前將Zeroth定義為一款NPU,配合以軟體,可以方便的實現SNN的計算。但是,NPU似乎不見了蹤影,現在只剩下了同名的機器學習引擎Zeroth SDK。IBM的TrueNorth。IBM2014年公佈的TrueNorth。在一顆晶片上集成了4096個並行的core,每個core包含了256個可程式設計的神經元neurons,一共1百萬個神經元。每個神經元有256個突觸synapses,共256 Mlillion。TrueNorth使用了三星的28nm的工藝,共5.4 billion個電晶體。BrainChip的SNAP(Spiking Neuron Adaptive Processor )。已經有了賭場的應用。GeneralVision的CM1K、NM500 chip,以及NeuroMem IP。這家公司的CM1K晶片有1k個神經元,每個神經元對應256Byte儲存。雖然無法和強大的TrueNorth相提並論,但是已有客戶應用。並且,提供BrainCard,上面有FPGA,並且可以直接和Arduino以及Raspberry Pi連線。Knowm 這家start-up在憶阻器(memristor)技術基礎上做“processing in memory”的AI晶片研發。不過,與前面提到的Mythic(IPU部分)不同的是,Known做的是類腦晶片。Knowm所用的關鍵技術是一種稱為熱力學記憶體(kT-RAM)的memory,是根據AHaH理論(Anti-Hebbian and Hebbian)發展而來。Koniku 成立於2014年的start-up,要利用生物神經元來做計算,"Biological neurons on a chip"。主頁在倒計時,可能要有重要進展公佈,期待。OPUOptical-Flow Processing Unit。光流處理器。有需要用專門的晶片來實現光流演算法嗎?不知道,但是,用ASIC IP來做加速應該是要的。PPUPhysical Processing Unit。物理處理器。要先解釋一下物理運算,就知道物理處理器是做什麼的了。物理計算,就是模擬一個物體在真實世界中應該符合的物理定律。具體的說,可以使虛擬世界中的物體運動符合真實世界的物理定律,可以使遊戲中的物體行為更加真實,例如布料模擬、毛髮模擬、碰撞偵測、流體力學模擬等。開發物理計算引擎的公司有那麼幾家,使用CPU來完成物理計算,支援多種平臺。但是,Ageia應該是唯一一個使用專用晶片來加速物理計算的公司。Ageia於2006年釋出了PPU晶片PhysX,還發布了基於PPU的物理加速卡,同時提供SDK給遊戲開發者。2008年被NVIDIA收購後,PhysX加速卡產品被逐漸取消,現在物理計算的加速功能由NVIDIA的GPU實現,PhysX SDK被NVIDIA重新打造。QPUQuantum Processing Unit。量子處理器。量子計算機也是近幾年比較火的研究方向。作者承認在這方面所知甚少。可以關注這家成立於1999年的公司D-Wave System。DWave大概每兩年可以將其QPU上的量子位個數翻倍一次。RPUResistive Processing Unit。阻抗處理單元RPU。這是IBM Watson Research Center的研究人員提出的概念,真的是個處理單元,而不是處理器。RPU可以同時實現儲存和計算。利用RPU陣列,IBM研究人員可以實現80TOPS/s/W的效能。Ray-tracing Processing Unit。光線追蹤處理器。Ray tracing是計算機圖形學中的一種渲染演算法,RPU是為加速其中的資料計算而開發的加速器。現在這些計算都是GPU的事情了。SPUStreaming Processing Unit。流處理器。流處理器的概念比較早了,是用於處理視訊資料流的單元,一開始出現在顯示卡晶片的結構裡。可以說,GPU就是一種流處理器。甚至,還曾經存在過一家名字為“Streaming Processor Inc”的公司,2004年創立,2009年,隨著創始人兼董事長被挖去NVIDIA當首席科學家,SPI關閉。Speech-Recognition Processing Unit。語音識別處理器,SPU或SRPU。這個縮寫還沒有公司拿來使用。現在的語音識別和語義理解主要是在雲端實現的,比如科大訊飛。科大訊飛最近推出了一個翻譯機,可以將語音傳回雲端,做實時翻譯,內部硬體沒有去專門瞭解。和語音識別相關的晶片如下。啟英泰倫(chipintelli) 於2015年11月在成都成立。該公司的CI1006是一款集成了神經網路加速硬體來做語音識別的晶片,可實現單晶片本地離線大詞彙量識別。 MIT專案。今年年初媒體爆過MIT的一款黑科技晶片,其實就是MIT在ISSCC2017上發表的paper裡的晶片,也是可以實現單晶片離線識別上k個單詞。可以參考閱讀“分析一下MIT的智慧語音識別晶片”。雲知聲(UniSound)。雲知聲是一家專攻智慧語音識別技術的公司,成立於2012年6月,總部在北京。雲知聲剛剛獲得3億人民幣戰略投資,其中一部分將用來研發其稍早公佈的AI晶片計劃,命名“UniOne”。據官方透漏,UniOne將內建DNN處理單元,相容多麥克風、多作業系統。並且,晶片將以模組的形式提供給客戶,讓客戶直接擁有一整套雲端芯的服務。Smart Processing Unit。聰明的處理器,聽起來很Q。Space Processing Unit。空間處理器,高大上,有沒有。全景攝像,全息成像,這些還都是處理我們的生活空間。當面對廣闊的太陽系、銀河系這些宇宙空間,是不是需要新的更強大的專用處理器呢?飛向M31仙女座星系,對抗黑暗武士,只靠x86估計是不行的。TPUTensor Processing Unit。Google的張量處理器。2016年AlphaGo打敗李世石,2017年AlphaGo打敗柯潔,兩次人工智慧催化事件給晶片行業帶來的衝擊無疑就是TPU的出現和解密。Google在2017年5月的開發者I/O大會上正式公佈了TPU2,又稱Cloud TPU。相比於TPU1,TPU2既可以用於training,又可以用於inference。TPU1使用了脈動陣列的流處理結構,具體的細節可以參考如下的文章“Google TPU 揭密”。

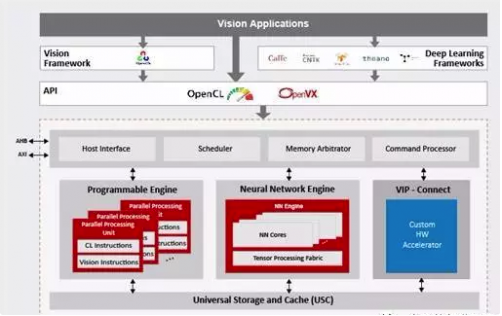

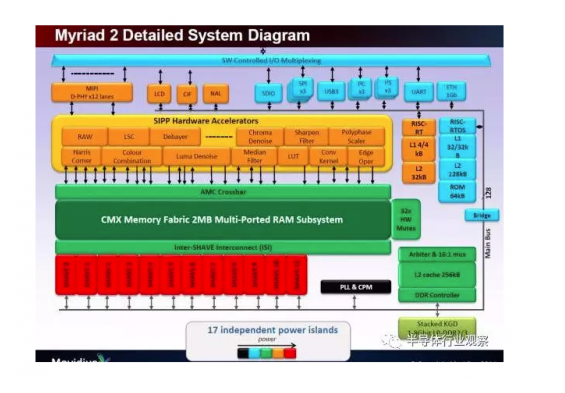

MIT專案。今年年初媒體爆過MIT的一款黑科技晶片,其實就是MIT在ISSCC2017上發表的paper裡的晶片,也是可以實現單晶片離線識別上k個單詞。可以參考閱讀“分析一下MIT的智慧語音識別晶片”。雲知聲(UniSound)。雲知聲是一家專攻智慧語音識別技術的公司,成立於2012年6月,總部在北京。雲知聲剛剛獲得3億人民幣戰略投資,其中一部分將用來研發其稍早公佈的AI晶片計劃,命名“UniOne”。據官方透漏,UniOne將內建DNN處理單元,相容多麥克風、多作業系統。並且,晶片將以模組的形式提供給客戶,讓客戶直接擁有一整套雲端芯的服務。Smart Processing Unit。聰明的處理器,聽起來很Q。Space Processing Unit。空間處理器,高大上,有沒有。全景攝像,全息成像,這些還都是處理我們的生活空間。當面對廣闊的太陽系、銀河系這些宇宙空間,是不是需要新的更強大的專用處理器呢?飛向M31仙女座星系,對抗黑暗武士,只靠x86估計是不行的。TPUTensor Processing Unit。Google的張量處理器。2016年AlphaGo打敗李世石,2017年AlphaGo打敗柯潔,兩次人工智慧催化事件給晶片行業帶來的衝擊無疑就是TPU的出現和解密。Google在2017年5月的開發者I/O大會上正式公佈了TPU2,又稱Cloud TPU。相比於TPU1,TPU2既可以用於training,又可以用於inference。TPU1使用了脈動陣列的流處理結構,具體的細節可以參考如下的文章“Google TPU 揭密”。 UPUUniverse Processing Unit。宇宙處理器。和Space Processing Unit相比,你更喜歡哪個?VPUVision Processing Unit。視覺處理器VPU也有希望成為通用名詞。作為現今最火熱的AI應用領域,計算機視覺的發展的確能給使用者帶來前所未有的體驗。為了處理計算機視覺應用中遇到的超大計算量,多家公司正在為此設計專門的VPU。Movidius(已被Intel收購)。Movidius成立於2006年,總部位於矽谷的San Mateo,創始人是兩個愛爾蘭人,所以在愛爾蘭有分部。Movidius早期做的是將舊電影轉為3D電影的業務,後期開始研發應用於3D渲染的晶片,並開始應用於計算機視覺應用領域(這說明:1,晶片行業才是高技術含量、高門檻、高價值的行業;2,初創公司要隨著發展調整自己的戰略)。Movidius開發的Myriad系列VPU專門為計算機視覺進行優化,可以用於 3D 掃描建模、室內導航、360°全景視訊等更前沿的計算機視覺用途。例如,2014年,谷歌的Project Tango專案用 Myriad 1幫助打造室內三維地圖;2016年,大疆的“精靈4”和“御”都採用了Movidius 的 Myriad 2晶片。採用TSMC 28nm工藝的Myriad2中集成了12個向量處理器SHAVE (Streaming Hybrid Architecture Vector Engine)。按照Movidius的說法,SHAVE是一種混合型流處理器,集成了GPU、 DSP和RISC的優點,支援8/16/32 bit定點和16/32 bit浮點計算,而且硬體上支援稀疏資料結構。此外,Myriad2中有兩個RISC核以及video硬體加速器。據稱,Myriad2可以同時處理多個視訊流。

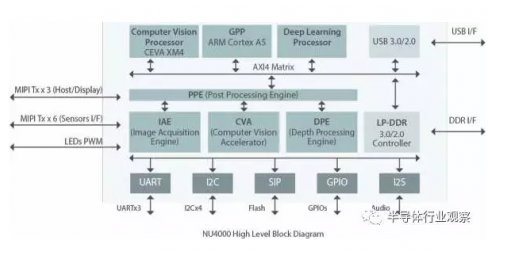

UPUUniverse Processing Unit。宇宙處理器。和Space Processing Unit相比,你更喜歡哪個?VPUVision Processing Unit。視覺處理器VPU也有希望成為通用名詞。作為現今最火熱的AI應用領域,計算機視覺的發展的確能給使用者帶來前所未有的體驗。為了處理計算機視覺應用中遇到的超大計算量,多家公司正在為此設計專門的VPU。Movidius(已被Intel收購)。Movidius成立於2006年,總部位於矽谷的San Mateo,創始人是兩個愛爾蘭人,所以在愛爾蘭有分部。Movidius早期做的是將舊電影轉為3D電影的業務,後期開始研發應用於3D渲染的晶片,並開始應用於計算機視覺應用領域(這說明:1,晶片行業才是高技術含量、高門檻、高價值的行業;2,初創公司要隨著發展調整自己的戰略)。Movidius開發的Myriad系列VPU專門為計算機視覺進行優化,可以用於 3D 掃描建模、室內導航、360°全景視訊等更前沿的計算機視覺用途。例如,2014年,谷歌的Project Tango專案用 Myriad 1幫助打造室內三維地圖;2016年,大疆的“精靈4”和“御”都採用了Movidius 的 Myriad 2晶片。採用TSMC 28nm工藝的Myriad2中集成了12個向量處理器SHAVE (Streaming Hybrid Architecture Vector Engine)。按照Movidius的說法,SHAVE是一種混合型流處理器,集成了GPU、 DSP和RISC的優點,支援8/16/32 bit定點和16/32 bit浮點計算,而且硬體上支援稀疏資料結構。此外,Myriad2中有兩個RISC核以及video硬體加速器。據稱,Myriad2可以同時處理多個視訊流。 Inuitive 一家以色列公司,提供3D影象和視覺處理方案,用於AR/VR、無人機等應用場景。Inuitive的下一代視覺處理器NU4000採用28nm工藝,選擇使用CEVA的XM4 DSP,並集成了深度學習處理器(自己開發?或者購買IP?)和深度處理引擎等硬體加速器。

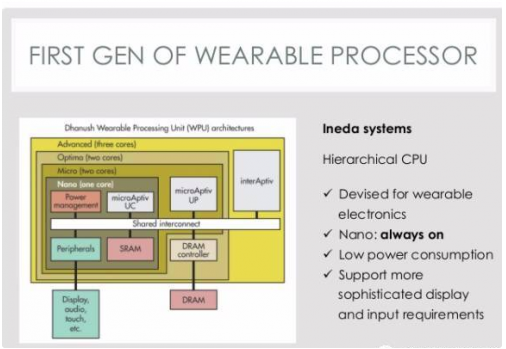

Inuitive 一家以色列公司,提供3D影象和視覺處理方案,用於AR/VR、無人機等應用場景。Inuitive的下一代視覺處理器NU4000採用28nm工藝,選擇使用CEVA的XM4 DSP,並集成了深度學習處理器(自己開發?或者購買IP?)和深度處理引擎等硬體加速器。 DeepVision 一家總部位於Palo Alto的start-up,為嵌入式裝置設計和開發低功耗VPU,以支援深度學習、CNN以及傳統的視覺演算法,同時提供實時處理軟體。Visual Processing Unit。這裡是visual,不是vision。ATI一開始稱自家顯示卡上的晶片為VPU,後來見賢思齊,都改叫GPU了。Video Processing Unit。視訊處理器。處理動態視訊而不是影象,例如進行實時編解碼。Vector Processing Unit。向量處理器。標量處理器、向量處理器、張量處理器,這是以處理器處理的資料型別進行的劃分。現在的CPU已經不再是單純的標量處理器,很多CPU都集成了向量指令,最典型的就是SIMD。向量處理器在超級計算機和高效能運算中,扮演著重要角色。基於向量處理器研發AI領域的專用晶片,也是很多公司的選項。例如,前面剛提到Movidius的Myriad2中,就包含了12個向量處理器。Vision DSP。針對AI中的計算機視覺應用,各家DSP公司都發布了DSP的Vision系列IP。簡單羅列如下。CEVA的XM4,最新的XM6 DSP。除了可以連線支援自家的硬體加速器HWA(CEVA Deep Neural Network Hardware Accelerator ),也可以支援第三方開發的HWA。前面提到的Inuitive使用了XM4。可以參考“處理器IP廠商的機器學習方案 - CEVA”。Tensilica(2013年被Cadence以3.8億美元收購)的P5、P6,以及最新的C5 DSP。一個最大的特色就是可以用TIE語言來定製指令。前面微軟的HPU中使用他家的DSP。可以參考“神經網路DSP核的一桌麻將終於湊齊了”。Synopsys的EV5x和EV6x系列DSP。可以參考“處理器IP廠商的機器學習方案 - Synopsys”。Videantis的v-MP4系列。Videantis成立於1997年,總部位於德國漢諾頓。v-MP4雖然能做很多機器視覺的任務,但還是傳統DSP增強設計,並沒有針對神經網路做特殊設計。WPUWearable Processing Unit。一家印度公司Ineda Systems在2014年大肆宣傳了一下他們針對IOT市場推出的WPU概念,獲得了高通和三星的注資。Ineda Systems研發的這款“Dhanush WPU”分為四個級別,可適應普通級別到高階級別的可穿戴裝置的運算需求,可以讓可穿戴裝置的電池達到30天的持續續航、減少10x倍的能耗。但是,一切似乎在2015年戛然而止,沒有了任何訊息。只在主頁的最下端有文字顯示,Ineda將WPU申請了註冊商標。有關WPU的資訊只有大概結構,哦,對了,還有一個美國專利。

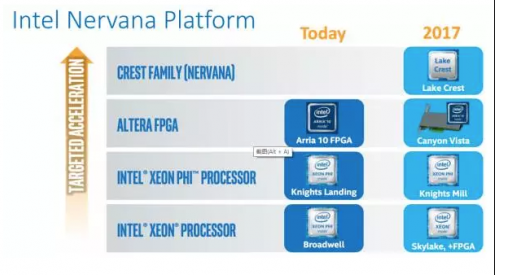

DeepVision 一家總部位於Palo Alto的start-up,為嵌入式裝置設計和開發低功耗VPU,以支援深度學習、CNN以及傳統的視覺演算法,同時提供實時處理軟體。Visual Processing Unit。這裡是visual,不是vision。ATI一開始稱自家顯示卡上的晶片為VPU,後來見賢思齊,都改叫GPU了。Video Processing Unit。視訊處理器。處理動態視訊而不是影象,例如進行實時編解碼。Vector Processing Unit。向量處理器。標量處理器、向量處理器、張量處理器,這是以處理器處理的資料型別進行的劃分。現在的CPU已經不再是單純的標量處理器,很多CPU都集成了向量指令,最典型的就是SIMD。向量處理器在超級計算機和高效能運算中,扮演著重要角色。基於向量處理器研發AI領域的專用晶片,也是很多公司的選項。例如,前面剛提到Movidius的Myriad2中,就包含了12個向量處理器。Vision DSP。針對AI中的計算機視覺應用,各家DSP公司都發布了DSP的Vision系列IP。簡單羅列如下。CEVA的XM4,最新的XM6 DSP。除了可以連線支援自家的硬體加速器HWA(CEVA Deep Neural Network Hardware Accelerator ),也可以支援第三方開發的HWA。前面提到的Inuitive使用了XM4。可以參考“處理器IP廠商的機器學習方案 - CEVA”。Tensilica(2013年被Cadence以3.8億美元收購)的P5、P6,以及最新的C5 DSP。一個最大的特色就是可以用TIE語言來定製指令。前面微軟的HPU中使用他家的DSP。可以參考“神經網路DSP核的一桌麻將終於湊齊了”。Synopsys的EV5x和EV6x系列DSP。可以參考“處理器IP廠商的機器學習方案 - Synopsys”。Videantis的v-MP4系列。Videantis成立於1997年,總部位於德國漢諾頓。v-MP4雖然能做很多機器視覺的任務,但還是傳統DSP增強設計,並沒有針對神經網路做特殊設計。WPUWearable Processing Unit。一家印度公司Ineda Systems在2014年大肆宣傳了一下他們針對IOT市場推出的WPU概念,獲得了高通和三星的注資。Ineda Systems研發的這款“Dhanush WPU”分為四個級別,可適應普通級別到高階級別的可穿戴裝置的運算需求,可以讓可穿戴裝置的電池達到30天的持續續航、減少10x倍的能耗。但是,一切似乎在2015年戛然而止,沒有了任何訊息。只在主頁的最下端有文字顯示,Ineda將WPU申請了註冊商標。有關WPU的資訊只有大概結構,哦,對了,還有一個美國專利。 Wisdom Processing Unit。智慧處理器。這個WPU聽起來比較高大上,拿去用,不謝。不過,有點“腦白金”的味道。XPU不如干脆就叫XPU,X可以表示未知,一切皆有可能,類似X Man,X File,SpaceX。就在這篇快收尾的時候,獲悉在今年的hotchip會議上,Baidu公開了其FPGA Accelerator的名字,就叫XPU。還沒有具體細節可說,拭目以待吧。YPUY?沒想法,需要求助各位讀者了。ZPUZylin CPU。挪威公司Zylin的CPU的名字。為了在資源有限的FPGA上能擁有一個靈活的微處理器,Zylin開發了ZPU。ZPU是一種stack machine(堆疊結構機器),指令沒有運算元,程式碼量很小,並有GCC工具鏈支援,被稱為“The worlds smallest 32 bit CPU with GCC toolchain”。Zylin在2008年將ZPU在opencores上開源。有組織還將Arduino的開發環境進行了修改給ZPU用。其他非xPU的AI晶片寒武紀科技(Cambricon) 中科院背景的寒武紀並沒有用xPU的方式命名自家的處理器。媒體的文章既有稱之為深度學習處理器DPU的,也有稱之為神經網路處理器NPU的。陳氏兄弟的DianNao系列晶片架構連續幾年在各大頂級會議上刷了好幾篇best paper,為其公司的成立奠定了技術基礎。寒武紀Cambricon-X指令集是其一大特色。目前其晶片IP已擴大範圍授權整合到手機、安防、可穿戴裝置等終端晶片中。據流傳,2016年就已拿到一億元訂單。在一些特殊領域,寒武紀的晶片將在國內具有絕對的佔有率。最新報道顯示,寒武紀又融了1億美元。Intel Intel在智慧手機晶片市場的失利,讓其痛定思痛,一改當年的猶豫,在AI領域的幾個應用方向上接連發了狠招。什麼狠招呢,就是三個字:買,買,買。在資料中心/雲端計算方面,167億美金收購的Altera,4億美金收購Nervana;在移動端的無人機、安防監控等方面,收購Movidius(未公佈收購金額);在ADAS方面,153億美金收購Mobileye。Movidius在前面VPU部分進行了介紹,這裡補充一下Nervana和Mobileye(基於視覺技術做ADAS方案,不是單純的視覺處理器,所以沒寫在VPU部分)。Nervana Nervana成立於2014年,總部在SanDiego,以提供AI全棧軟體平臺Nervana Cloud為主要業務。和硬體扯上關係的是,Nervana Cloud除了支援CPU、GPU甚至Xeon Phi等後臺硬體外,還提供有自家定製的Nervana Engine硬體架構。根據 The Next Platform的報道“Deep Learning Chip Upstart Takes GPUs to Task”,Nervana Engine 使用TSMC 28nm工藝,算力55 TOPS。報道釋出不到24小時,就被Intel收購了,全部48位員工併入Intel。Intel以Nervana Engine為核心打造了Crest Family系列晶片。專案程式碼為“Lake Crest”的晶片是第一代Nervana Engine,“Knights Crest”為第二代。哦,對了,Nervana的CEO在創立Nervana之前,在高通負責一個神經形態計算的研究專案,就是上面提到的Zeroth。

Wisdom Processing Unit。智慧處理器。這個WPU聽起來比較高大上,拿去用,不謝。不過,有點“腦白金”的味道。XPU不如干脆就叫XPU,X可以表示未知,一切皆有可能,類似X Man,X File,SpaceX。就在這篇快收尾的時候,獲悉在今年的hotchip會議上,Baidu公開了其FPGA Accelerator的名字,就叫XPU。還沒有具體細節可說,拭目以待吧。YPUY?沒想法,需要求助各位讀者了。ZPUZylin CPU。挪威公司Zylin的CPU的名字。為了在資源有限的FPGA上能擁有一個靈活的微處理器,Zylin開發了ZPU。ZPU是一種stack machine(堆疊結構機器),指令沒有運算元,程式碼量很小,並有GCC工具鏈支援,被稱為“The worlds smallest 32 bit CPU with GCC toolchain”。Zylin在2008年將ZPU在opencores上開源。有組織還將Arduino的開發環境進行了修改給ZPU用。其他非xPU的AI晶片寒武紀科技(Cambricon) 中科院背景的寒武紀並沒有用xPU的方式命名自家的處理器。媒體的文章既有稱之為深度學習處理器DPU的,也有稱之為神經網路處理器NPU的。陳氏兄弟的DianNao系列晶片架構連續幾年在各大頂級會議上刷了好幾篇best paper,為其公司的成立奠定了技術基礎。寒武紀Cambricon-X指令集是其一大特色。目前其晶片IP已擴大範圍授權整合到手機、安防、可穿戴裝置等終端晶片中。據流傳,2016年就已拿到一億元訂單。在一些特殊領域,寒武紀的晶片將在國內具有絕對的佔有率。最新報道顯示,寒武紀又融了1億美元。Intel Intel在智慧手機晶片市場的失利,讓其痛定思痛,一改當年的猶豫,在AI領域的幾個應用方向上接連發了狠招。什麼狠招呢,就是三個字:買,買,買。在資料中心/雲端計算方面,167億美金收購的Altera,4億美金收購Nervana;在移動端的無人機、安防監控等方面,收購Movidius(未公佈收購金額);在ADAS方面,153億美金收購Mobileye。Movidius在前面VPU部分進行了介紹,這裡補充一下Nervana和Mobileye(基於視覺技術做ADAS方案,不是單純的視覺處理器,所以沒寫在VPU部分)。Nervana Nervana成立於2014年,總部在SanDiego,以提供AI全棧軟體平臺Nervana Cloud為主要業務。和硬體扯上關係的是,Nervana Cloud除了支援CPU、GPU甚至Xeon Phi等後臺硬體外,還提供有自家定製的Nervana Engine硬體架構。根據 The Next Platform的報道“Deep Learning Chip Upstart Takes GPUs to Task”,Nervana Engine 使用TSMC 28nm工藝,算力55 TOPS。報道釋出不到24小時,就被Intel收購了,全部48位員工併入Intel。Intel以Nervana Engine為核心打造了Crest Family系列晶片。專案程式碼為“Lake Crest”的晶片是第一代Nervana Engine,“Knights Crest”為第二代。哦,對了,Nervana的CEO在創立Nervana之前,在高通負責一個神經形態計算的研究專案,就是上面提到的Zeroth。

相關推薦

一文讀懂APU/BPU/CPU/DPU/EPU/FPU/GPU等處理器

隨著AI概念火爆全球,做AI晶片的公司也層出不窮。為了讓市場和觀眾能記住自家的產品,各家在晶片命名方面都下了點功夫,既要獨特,又要和公司產品契合,還要朗朗上口,也要容易讓人記住。比較有意思的是,很多家都採用了“xPU”的命名方式。本文就來盤點一下目前各種“xPU”命名AI晶片

一文讀懂大數據計算框架與平臺

ddr 不同 失敗 克服 可定制 同時 數據庫引擎 後處理 alc 1.前言 計算機的基本工作就是處理數據,包括磁盤文件中的數據,通過網絡傳輸的數據流或數據包,數據庫中的結構化數據等。隨著互聯網、物聯網等技術得到越來越廣泛的應用,數據規模不斷增加,TB、PB量級成為常

一文讀懂 超簡單的 structured stream 源碼解讀

ket exec res exce bus sin imp += work 為了讓大家理解structured stream的運行流程,我將根據一個代碼例子,講述structured stream的基本運行流程和原理。 下面是一段簡單的代碼: 1 val spark =

一文讀懂Spring Boot、微服務架構和大數據治理之間的故事

Springboot微服務架構 微服務的誕生並非偶然,它是在互聯網高速發展,技術日新月異的變化以及傳統架構無法適應快速變化等多重因素的推動下誕生的產物。互聯網時代的產品通常有兩類特點:需求變化快和用戶群體龐大,在這種情況下,如何從系統架構的角度出發,構建靈活、易擴展的系統,快速應對需求的變化;同時,隨著用戶的

一文讀懂阻塞、非阻塞、同步、異步IO

UC max register class 掃描 基本 角度 cloud 問題: 介紹 在談及網絡IO的時候總避不開阻塞、非阻塞、同步、異步、IO多路復用、select、poll、epoll等這幾個詞語。在面試的時候也會被經常問到這幾個的區別。本文就來講一下這幾個詞

一文讀懂架構師都不知道的isinstance檢查機制

Python起步通過內建方法 isinstance(object, classinfo) 可以判斷一個對象是否是某個類的實例。但你是否想過關於鴨子協議的對象是如何進行判斷的呢? 比如 list 類的父類是繼 object 類的,但通過 isinstance([], typing.Iterable) 返回的卻是

【深度學習】一文讀懂機器學習常用損失函數(Loss Function)

back and 們的 wiki 導出 歐氏距離 classes 自變量 關於 最近太忙已經好久沒有寫博客了,今天整理分享一篇關於損失函數的文章吧,以前對損失函數的理解不夠深入,沒有真正理解每個損失函數的特點以及應用範圍,如果文中有任何錯誤,請各位朋友指教,謝謝~

從HTTP/0.9到HTTP/2:一文讀懂HTTP協議的歷史演變和設計思路

eight 結果 key 視頻 this sso單點登陸 會有 研究 patch 本文原作者阮一峰,作者博客:ruanyifeng.com。 1、引言 HTTP 協議是最重要的互聯網基礎協議之一,它從最初的僅為瀏覽網頁的目的進化到現在,已經是短連接通信的事實工業標準,最新版

一文讀懂以太坊代幣合約

規則 sta ini class 2015年 交易 存在 部分 生活 本文首發自 https://www.secpulse.com/archives/73696.html ,轉載請註明出處。 工欲善其事,必先利其器。要想挖掘和分析智能合約的漏洞,你必須要先學會看

什麽是音視頻直播雲服務 ? 一文讀懂

type 限制 推流 數據 優缺點 視頻通訊系統 最終 通訊 地理 說到音視頻雲服務,大多數人可能聯想到的是網絡直播應用場景,實際上,硬件對音視頻雲服務的需求也在逐漸提升。而這樣的市場需求也推動了整個行業的發展,目前,阿裏雲、騰訊雲和網易雲等巨頭都已入局,除此之外還有即構科

一文讀懂機器學習大殺器XGBoost原理

結構 近似算法 機器 form con gin fff .cn tran http://blog.itpub.net/31542119/viewspace-2199549/ XGBoost是boosting算法的其中一種。Boosting算法的思想是將許多弱分類器集成在

一文讀懂什麽是Java中的自動拆裝箱

.com 空指針異常 http har 三目運算 容器 ava eof 關系 基本數據類型 基本類型,或者叫做內置類型,是Java中不同於類(Class)的特殊類型。它們是我們編程中使用最頻繁的類型。 Java是一種強類型語言,第一次申明變量必須說明數據類型,第一次變量

一文讀懂高性能網絡編程中的I/O模型

好的 min tcp 輸入 其中 那些事 follow hand 實現 1、前言 隨著互聯網的發展,面對海量用戶高並發業務,傳統的阻塞式的服務端架構模式已經無能為力。本文(和下篇《高性能網絡編程(六):一文讀懂高性能網絡編程中的線程模型》)旨在為大家提供有用的高性能網絡編程

一文讀懂充電寶usb接口電路及制作原理詳細

合規 其它 註意 pan 排列 ron 充電寶 需要 資料 轉自:http://www.elecfans.com/dianlutu/dianyuandianlu/20180511675801.html USB充電器套件,又名MP3/MP4充電器,輸入AC160-240V,5

一文讀懂AI網路結構:LeNet-5 AlexNet VGG Inception ResNet MobileNet

1 引言 當前深度學習十分火熱,深度學習網路模型對於降低錯誤率的重要作用不言而喻。深度學習應用場景主要分為三類:物體識別與分類,物體檢測,自然語言處理。在物體識別與分類領域,隨著AlexNet在2012年一炮走紅,深度學習重新燃起了一片熱情。從Lenet5第一次使用卷積開始,經歷了AlexNet

一文讀懂環形簽名技術

區塊鏈錢包人人都聽說過。實際上錢包這個詞並不十分恰當。在一般人的理解裡,錢包是用來存錢的,電子錢包——如支付寶等——也只是把現實中的貨幣電子化,本質上是一樣的,而區塊鏈錢包並非如此。區塊鏈錢包實際上並不儲存任何數字貨幣,它主要是用來儲存和管理私鑰,並通過私鑰進行交易。這樣看來,將其命名為“私鑰管理平

【機器學習】一文讀懂機器學習常用損失函式

損失函式(loss function)是用來估量模型的預測值f(x)與真實值Y的不一致程度,它是一個非負實值函式,通常使用L(Y, f(x))來表示,損失函式越小,模型的魯棒性就越好。損失函式是經驗風險函式的核心部分,也是結構風險函式重要組成部分。模型的結構風險函式包括了經驗風險項和正則項,通常可以

一文讀懂大資料技術驅動的銀行客戶畫像

2018年上半年我國GDP增速6.8%,在貿易戰和去槓桿的影響下,雖然金融市場震盪明顯,但銀行受到網際網路、移動計算到雲端計算、大資料、物聯網、人工智慧等技術變革的影響,仍舊保持了較好盈利。在採取了業務轉型與創新、同業業務從線下向線上轉移、資產結構的進一步優化等諸多調整措施的過程中,“手機銀行、P2

一文讀懂 KMP 演算法

來源:阮一峰http://www.ruanyifeng.com/blog/2013/05/Knuth–Morris–Pratt_algorithm.html 字串匹配是計算機的基本任務之一。舉例來說,有一個字串"BBC ABCDAB ABCDABCDABDE",我想知道,裡面是否包

區塊鏈vs.DAG, 區別到底是什麼? 一文讀懂燒腦的資料結構之爭

作者 | 劉春明 DAG(有向無環圖)是一種非線性資料結構,可以替代區塊鏈,用於分散式賬本的儲存。這種結構在併發的場景下有更好的效能表現,但在實際應用中會面臨更多的技術挑戰。 其中,最大的挑戰在於,基於DAG結構實現智慧合約,要比基於區塊鏈結構困難得多。 本文將討論DAG和