Python 實現感知器模型、兩層神經網路

阿新 • • 發佈:2019-02-05

python 3.4 因為使用了 numpy

這裡我們首先實現一個感知器模型來實現下面的對應關係

[[0,0,1], ——- 0

[0,1,1], ——- 1

[1,0,1], ——- 0

[1,1,1]] ——- 1

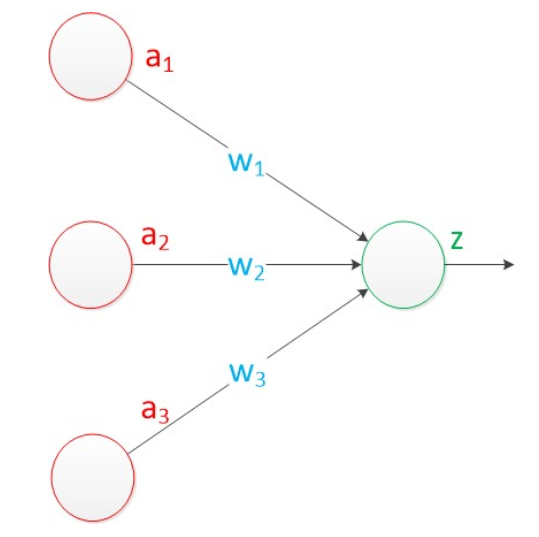

從上面的資料可以看出:輸入是三通道,輸出是單通道。

這裡的啟用函式我們使用 sigmoid 函式 f(x)=1/(1+exp(-x))

其導數推導如下所示:

L0=W*X;

z=f(L0);

error=y-z;

delta =error * f'(L0) * X;

W=W+delta;// python 程式碼如下:

import numpy as np

#sigmoid function

def nonlin(x, deriv = False):

if(deriv==True):

return x*(1-x)

return 1/(1+np.exp(-x))

# input dataset

X=np.array([[0,0,1],

[0,1,1],

[1,0,1],

[1,1,1]])

# output dataset

y=np.array([[0,1,0,1]]).T

#seed( ) 用於指定隨機數生成時所用演算法開始的整數值, 從輸出結果可以看出基本實現了對應關係。

下面再用兩層網路來實現上面的任務,這裡加了一個隱層,隱層包含4個神經元。

import numpy as np

def nonlin(x, deriv = False):

if(deriv == True):

return x*(1-x)

else:

return 1/(1+np.exp(-x))

#input dataset

X = np.array([[0,0,1],

[0,1,1],

[1,0,1],

[1,1,1]])

#output dataset

y = np.array([[0,1,1,0]]).T

#the first-hidden layer weight value

syn0 = 2*np.random.random((3,4)) - 1

#the hidden-output layer weight value

syn1 = 2*np.random.random((4,1)) - 1

for j in range(60000):

l0 = X

#the first layer,and the input layer

l1 = nonlin(np.dot(l0,syn0))

#the second layer,and the hidden layer

l2 = nonlin(np.dot(l1,syn1))

#the third layer,and the output layer

l2_error = y-l2

#the hidden-output layer error

if(j%10000) == 0:

print "Error:"+str(np.mean(l2_error))

l2_delta = l2_error*nonlin(l2,deriv = True)

l1_error = l2_delta.dot(syn1.T)

#the first-hidden layer error

l1_delta = l1_error*nonlin(l1,deriv = True)

syn1 += l1.T.dot(l2_delta)

syn0 += l0.T.dot(l1_delta)

print "outout after Training:"

print l2