Python併發程式設計(十一):程序池,執行緒池,協程

目錄

注意

1、不能無限的開程序和執行緒,最常用的就是開程序池,開執行緒池。

2、其中回撥函式非常重要,回撥函式其實可以作為一種程式設計思想,函數語言程式設計。誰好了誰就去執行。

3、只要你用併發,就會有鎖的問題,但是你不能一直去自己加鎖吧,那麼我們就用QUEUE,這樣還解決了自動加鎖的問題。

4、由Queue延伸出的一個點也非常重要的概念,以後寫程式也會用到這個思想,就是生產者與消費者問題。

一、Python標準模組--concurrent.futures(併發未來)

concurent.future模組需要了解的內容:

1.concurent.future模組是用來建立並行的任務,提供了更高級別的介面,為了非同步執行呼叫

2.concurent.future這個模組用起來非常方便,它的介面也封裝的非常簡單

3.concurent.future模組既可以實現程序池,也可以實現執行緒池

4.模組匯入程序池和執行緒池

from concurrent.futures import ProcessPoolExecutor,ThreadPoolExecutor

還可以匯入一個Executor,但是你別這樣導,這個類是一個抽象類抽象類的目的是規範他的子類必須有某種方法(並且抽象類的方法必須實現),但是抽象類不能被例項化

5.

p = ProcessPoolExecutor(max_works)對於程序池如果不寫max_works:預設的是cpu的數目,預設是4個(程序池)p = ThreadPoolExecutor(max_works)對於執行緒池如果不寫max_works: 預設的是cpu的數目*5(執行緒池)

6.如果是程序池,得到的結果如果是一個物件。我們得用一個.get()方法得到結果

但是現在用了concurent.future模組,我們可以用obj.result方法

p.submit(task,i) #相當於apply_async非同步方法

p.shutdown() #預設有個引數wite=True (相當於close和join)

二、執行緒池

那麼什麼是執行緒池呢?我們來了解一下

程序池:就是在一個程序內控制一定個數的執行緒

基於concurent.future模組的程序池和執行緒池 (他們的同步執行和非同步執行是一樣的)

基於concurrent.futures模組的程序池

1 # 1.同步執行--------------

2 from concurrent.futures import ProcessPoolExecutor,ThreadPoolExecutor

3 import os,time,random

4 def task(n):

5 print('[%s] is running'%os.getpid())

6 time.sleep(random.randint(1,3)) #I/O密集型的,,一般用執行緒,用了程序耗時長

7 return n**2

8 if __name__ == '__main__':

9 start = time.time()

10 p = ProcessPoolExecutor()

11 for i in range(10): #現在是開了10個任務, 那麼如果是上百個任務呢,就不能無線的開程序,那麼就得考慮控制

12 # 執行緒數了,那麼就得考慮到池了

13 obj = p.submit(task,i).result() #相當於apply同步方法

14 p.shutdown() #相當於close和join方法

15 print('='*30)

16 print(time.time() - start) #17.36499309539795

17

18

19 # 2.非同步執行-----------

20 # from concurrent.futures import ProcessPoolExecutor,ThreadPoolExecutor

21 # import os,time,random

22 # def task(n):

23 # print('[%s] is running'%os.getpid())

24 # time.sleep(random.randint(1,3)) #I/O密集型的,,一般用執行緒,用了程序耗時長

25 # return n**2

26 # if __name__ == '__main__':

27 # start = time.time()

28 # p = ProcessPoolExecutor()

29 # l = []

30 # for i in range(10): #現在是開了10個任務, 那麼如果是上百個任務呢,就不能無線的開程序,那麼就得考慮控制

31 # # 執行緒數了,那麼就得考慮到池了

32 # obj = p.submit(task,i) #相當於apply_async()非同步方法

33 # l.append(obj)

34 # p.shutdown() #相當於close和join方法

35 # print('='*30)

36 # print([obj.result() for obj in l])

37 # print(time.time() - start) #5.362306594848633基於concurrent.futures模組的執行緒池

1 from concurrent.futures import ProcessPoolExecutor,ThreadPoolExecutor

2 from threading import currentThread

3 import os,time,random

4 def task(n):

5 print('%s:%s is running'%(currentThread().getName(),os.getpid())) #看到的pid都是一樣的,因為執行緒是共享了一個程序

6 time.sleep(random.randint(1,3)) #I/O密集型的,,一般用執行緒,用了程序耗時長

7 return n**2

8 if __name__ == '__main__':

9 start = time.time()

10 p = ThreadPoolExecutor() #執行緒池 #如果不給定值,預設cup*5

11 l = []

12 for i in range(10): #10個任務 # 執行緒池效率高了

13 obj = p.submit(task,i) #相當於apply_async非同步方法

14 l.append(obj)

15 p.shutdown() #預設有個引數wite=True (相當於close和join)

16 print('='*30)

17 print([obj.result() for obj in l])

18 print(time.time() - start) #3.001171827316284應用執行緒池(下載網頁並解析)

from concurrent.futures import ThreadPoolExecutor,ProcessPoolExecutor

import requests

import time,os

def get_page(url):

print('<%s> is getting [%s]'%(os.getpid(),url))

response = requests.get(url)

if response.status_code==200: #200代表狀態:下載成功了

return {'url':url,'text':response.text}

def parse_page(res):

res = res.result()

print('<%s> is getting [%s]'%(os.getpid(),res['url']))

with open('db.txt','a') as f:

parse_res = 'url:%s size:%s\n'%(res['url'],len(res['text']))

f.write(parse_res)

if __name__ == '__main__':

# p = ThreadPoolExecutor()

p = ProcessPoolExecutor()

l = [

'http://www.baidu.com',

'http://www.baidu.com',

'http://www.baidu.com',

'http://www.baidu.com',

]

for url in l:

res = p.submit(get_page,url).add_done_callback(parse_page) #這裡的回撥函式拿到的是一個物件。得

# 先把返回的res得到一個結果。即在前面加上一個res.result() #誰好了誰去掉回撥函式

# 回撥函式也是一種程式設計思想。不僅開執行緒池用,開執行緒池也用

p.shutdown() #相當於程序池裡的close和join

print('主',os.getpid())map函式的應用

# map函式舉例

obj= map(lambda x:x**2 ,range(10))

print(list(obj))

#執行結果[0, 1, 4, 9, 16, 25, 36, 49, 64, 81]可以和上面的開程序池/執行緒池的對比著看,就能發現map函式的強大了

map函式具體應用

1 # 我們的那個p.submit(task,i)和map函式的原理類似。我們就

2 # 可以用map函式去代替。更減縮了程式碼

3 from concurrent.futures import ProcessPoolExecutor,ThreadPoolExecutor

4 import os,time,random

5 def task(n):

6 print('[%s] is running'%os.getpid())

7 time.sleep(random.randint(1,3)) #I/O密集型的,,一般用執行緒,用了程序耗時長

8 return n**2

9 if __name__ == '__main__':

10 p = ProcessPoolExecutor()

11 obj = p.map(task,range(10))

12 p.shutdown() #相當於close和join方法

13 print('='*30)

14 print(obj) #返回的是一個迭代器

15 print(list(obj))三、協程介紹

協程:單執行緒下實現併發(提高效率)

說到協程,我們先說一下協程聯想到的知識點

yield複習

切換關鍵的一點是:儲存狀態(從原來停留的地方繼續切)

return:只能執行一次,結束函式的標誌

yield:函式中但凡有yield,這個函式的執行結果就變成了一個生成器,

生成器本質就是一個迭代器,那麼迭代器怎麼用呢?用一個next()方法

1.yield語句的形式:yield 1

yield功能1:可以用來返回值,可以返回多次值

yield功能2:可以把函式暫停住,儲存原來的狀態

2.yield表示式的形式:x = yieldsend可以把一個函式的結果傳給另一個函式,以此實現單執行緒內程式之間的切換

send()要想用就得先next()一下

但是要用send至少要用兩個yield

yield功能示例1

yield功能示例2

1 3.yield功能2(可以吧函式暫停住,儲存原來的狀態)--------------

2 def f1():

3 print('first')

4 yield 1

5 print('second')

6 yield 2

7 print('third')

8 yield 3

9 # print(f1()) #加了yield返回的是一個生成器

10 g = f1()

11 print(next(g)) #當遇見了yield的時候就返回一個值,而且儲存原來的狀態

12 print(next(g)) #當遇見了yield的時候就返回一個值

13 print(next(g)) #當遇見了yield的時候就返回一個值yield表示式示例

1 # 3.yield表示式(對於表示式的yield)--------------------

2 import time

3 def wrapper(func):

4 def inner(*args,**kwargs):

5 ret =func(*args,**kwargs)

6 next(ret)

7 return ret

8 return inner

9 @wrapper

10 def consumer():

11 while True:

12 x= yield

13 print(x)

14

15 def producter(target):

16 '''生產者造值'''

17 # next(g) #相當於g.send(None)

18 for i in range(10):

19 time.sleep(0.5)

20 target.send(i)#要用send就得用兩個yield

21 producter(consumer())協程的本質

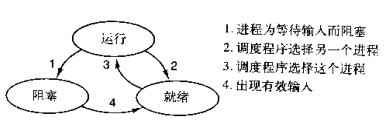

本節主題是實現單執行緒下的併發,即只在一個主執行緒,並且很明顯的是,可利用的cpu只有一個情況下實現併發,

為此我們需要先回顧下併發的本質:切換+儲存狀態

cpu正在執行一個任務,會在兩種情況下切走去執行其他的任務(切換由作業系統強制控制),

一種情況是該任務發生了阻塞,另外一種情況是該任務計算的時間過長

其中第二種情況並不能提升效率,只是為了讓cpu能夠雨露均沾,實現看起來大家都被執行的效果,如果多個程式都是純計算任務,這種切換反而會降低效率。為此我們可以基於yield來驗證。

yield本身就是一種在單執行緒下可以儲存任務執行狀態的方法,我們來簡單複習一下:

1 、yiled可以儲存狀態,yield的狀態儲存與作業系統的儲存執行緒狀態很像,但是yield是程式碼級別控制的,更輕量級

2 、send可以把一個函式的結果傳給另外一個函式,以此實現單執行緒內程式之間的切換

單純的切換反而會影響效率

序列執行

1 #序列執行

2 import time

3 def consumer(res):

4 '''任務1:接收資料,處理資料'''

5 pass

6

7 def producer():

8 '''任務2:生產資料'''

9 res=[]

10 for i in range(10000000):

11 res.append(i)

12 return res

13

14 start=time.time()

15 #序列執行

16 res=producer()

17 consumer(res)

18 stop=time.time()

19 print(stop-start) #1.5536692142486572基於yield併發執行

1 import time

2 def wrapper(func):

3 def inner(*args,**kwargs):

4 ret =func(*args,**kwargs)

5 next(ret)

6 return ret

7 return inner

8 @wrapper

9 def consumer():

10 while True:

11 x= yield

12 print(x)

13

14 def producter(target):

15 '''生產者造值'''

16 # next(g) #相當於g.send(None)

17 for i in range(10):

18 time.sleep(0.5)

19 target.send(i)#要用send就得用兩個yield

20 producter(consumer())對於單執行緒下,我們不可避免程式中出現io操作,但如果我們能在自己的程式中(即使用者程式級別,而非作業系統級別)控制單執行緒下多個任務能遇到io就切換,這樣就保證了該執行緒能夠最大限度地處於就緒態,即隨時都可以被cpu執行的狀態,相當於我們在使用者程式級別將自己的io操作最大限度地隱藏起來,對於作業系統來說:這哥們(該執行緒)好像是一直處於計算過程的,io比較少。

協程的本質就是在單執行緒下,由使用者自己控制一個任務遇到io阻塞了就切換另外一個任務去執行,以此來提升效率。

因此我們需要找尋一種可以同時滿足以下條件的解決方案:

1. 可以控制多個任務之間的切換,切換之前將任務的狀態儲存下來(重新執行時,可以基於暫停的位置繼續)

2. 作為1的補充:可以檢測io操作,在遇到io操作的情況下才發生切換

四、Greenlet

Greenlet模組和yield沒有什麼區別,就只是單純的切換,跟效率無關。

只不過比yield更好一點,切的時候方便一點。但是仍然沒有解決效率

Greenlet可以讓你在多個任務之間來回的切

#安裝

pip3 install greenlet 1 from greenlet import greenlet

2 import time

3 def eat(name):

4 print('%s eat 1' %name)

5 time.sleep(10) #當遇到IO的時候它也沒有切,這就得用gevent了

6 g2.switch('egon')

7 print('%s eat 2' %name)

8 g2.switch()

9 def play(name):

10 print('%s play 1' %name)

11 g1.switch()

12 print('%s play 2' %name)

13

14 g1=greenlet(eat)

15 g2=greenlet(play)

16

17 g1.switch('egon')#可以在第一次switch時傳入引數,以後都不需要如果所有上面的方法都不可行,那麼這就用到了Gevert ,也就是協程。它解決了單執行緒實現併發的問題,還提升了效率

五、Gevent介紹

#安裝

pip3 install geventGevent 是一個第三方庫,可以輕鬆通過gevent實現併發同步或非同步程式設計,在gevent中用到的主要模式是Greenlet,

它是以C擴充套件模組形式接入Python的輕量級協程。 Greenlet全部執行在主程式作業系統程序的內部,但它們被協作式地排程。

#用法

g1=gevent.spawn(func,1,,2,3,x=4,y=5)建立一個協程物件g1,spawn括號內第一個引數是函式名,如eat,後面可以有多個引數,可以是位置實參或關鍵字實參,都是傳給函式eat的

g2=gevent.spawn(func2)

g1.join() #等待g1結束

g2.join() #等待g2結束

#或者上述兩步合作一步:gevent.joinall([g1,g2])

g1.value#拿到func1的返回值gevent的一些方法(重要)

1 from gevent import monkey;monkey.patch_all()

2 import gevent

3 import time

4 def eat(name):

5 print('%s eat 1' %name)

6 time.sleep(2) #我們用等待的時間模擬IO阻塞

7 ''' 在gevent模組裡面要用gevent.sleep(2)表示等待的時間

8 然而我們經常用time.sleep()用習慣了,那麼有些人就想著

9 可以用time.sleep(),那麼也不是不可以。要想用,就得在

10 最上面匯入from gevent import monkey;monkey.patch_all()這句話

11 如果不匯入直接用time.sleep(),就實現不了單執行緒併發的效果了

12 '''

13 # gevent.sleep(2)

14 print('%s eat 2' %name)

15 return 'eat'

16 def play(name):

17 print('%s play 1' %name)

18 time.sleep(3)

19 # gevent.sleep(3)

20 print('%s play 2' %name)

21 return 'paly' #當有返回值的時候,gevent模組也提供了返回結果的操作

22

23 start = time.time()

24 g1 = gevent.spawn(eat,'egon') #執行任務

25 g2 = gevent.spawn(play,'egon') #g1和g2的引數可以不一樣

26 # g1.join() #等待g1

27 # g2.join() #等待g2

28 #上面等待的兩句也可以這樣寫

29 gevent.joinall([g1,g2])

30 print('主',time.time()-start) #3.001171588897705

31

32 print(g1.value)

33 print(g2.value)需要說明的是:

gevent.sleep(2)模擬的是gevent可以識別的io阻塞,而time.sleep(2)或其他的阻塞,gevent是不能直接識別的,需要用下面一行程式碼來打補丁,就可以識別了

from gevent import monkey;monkey.patch_all()必須放到被打補丁者的前面,如time,socket模組之前

或者我們乾脆記憶成要用gevent,需要將from gevent import monkey;monkey.patch_all()放到檔案的開頭

六、Gevent之同步於非同步

1 from gevent import spawn,joinall,monkey;monkey.patch_all()

2

3 import time

4 def task(pid):

5 """

6 Some non-deterministic task

7 """

8 time.sleep(0.5)

9 print('Task %s done' % pid)

10

11

12 def synchronous():

13 for i in range(10):

14 task(i)

15

16 def asynchronous():

17 g_l=[spawn(task,i) for i in range(10)]

18 joinall(g_l)

19

20 if __name__ == '__main__':

21 print('Synchronous:')

22 synchronous()

23

24 print('Asynchronous:')

25 asynchronous()

26 #上面程式的重要部分是將task函式封裝到Greenlet內部執行緒的gevent.spawn。 初始化的greenlet列表存放在陣列threads中,此陣列被傳給gevent.joinall 函式,後者阻塞當前流程,並執行所有給定的greenlet。執行流程只會在 所有greenlet執行完後才會繼續向下走。七、Gevent之應用舉例一

協程應用爬蟲

1 from gevent import monkey;monkey.patch_all() #打補丁

2 import gevent

3 import requests

4 import time

5 def get_page(url):

6 print('get :%s'%url)

7 response = requests.get(url)

8 if response.status_code==200: #下載成功的狀態

9 print('%d bytes received from:%s'%(len(response.text),url))

10 start=time.time()

11 gevent.joinall([

12 gevent.spawn(get_page,'http://www.baidu.com'),

13 gevent.spawn(get_page, 'https://www.yahoo.com/'),

14 gevent.spawn(get_page, 'https://github.com/'),

15 ])

16 stop = time.time()

17 print('run time is %s' %(stop-start))協程應用爬蟲加了回撥函式的

from gevent import joinall,spawn,monkey;monkey.patch_all()

import requests

from threading import current_thread

def parse_page(res):

print('%s PARSE %s' %(current_thread().getName(),len(res)))

def get_page(url,callback=parse_page):

print('%s GET %s' %(current_thread().getName(),url))

response=requests.get(url)

if response.status_code == 200:

callback(response.text)

if __name__ == '__main__':

urls=[

'https://www.baidu.com',

'https://www.taobao.com',

'https://www.openstack.org',

]

tasks=[]

for url in urls:

tasks.append(spawn(get_page,url))

joinall(tasks)八、Gevent之應用舉例二

也可以利用協程實現併發

服務端利用協程

1 #!usr/bin/env python

2 # -*- coding:utf-8 -*-

3 from gevent import monkey;monkey.patch_all()

4 import gevent

5 from socket import *

6 print('start running...')

7 def talk(conn,addr):

8 while True:

9 data = conn.recv(1024)

10 print('%s:%s %s'%(addr[0],addr[1],data))

11 conn.send(data.upper())

12 conn.close()

13 def server(ip,duankou):

14 server = socket(AF_INET, SOCK_STREAM)

15 server.setsockopt(SOL_SOCKET, SO_REUSEADDR, 1)

16 server.bind((ip,duankou))

17 server.listen(5)

18 while True:

19 conn,addr = server.accept() #等待連結

20 gevent.spawn(talk,conn,addr) #非同步執行 (p =Process(target=talk,args=(coon,addr))

21 # p.start())相當於開程序裡的這兩句

22 server.close()

23 if __name__ == '__main__':

24 server('127.0.0.1',8081)客戶端開了100個程序

1 #!usr/bin/env python

2 # -*- coding:utf-8 -*-

3 from multiprocessing import Process

4 from gevent import monkey;monkey.patch_all()

5 from socket import *

6 def client(ip,duankou):

7 client = socket(AF_INET, SOCK_STREAM)

8 client.connect((ip,duankou))

9 while True:

10 client.send('hello'.encode('utf-8'))

11 data = client.recv(1024)

12 print(data.decode('utf-8'))

13 if __name__ == '__main__':

14 for i in range(100):

15 p = Process(target=client,args=(('127.0.0.1',8081)))

16 p.start()