基於SparkStreaming對銀行日誌處理系列--整體技術框架

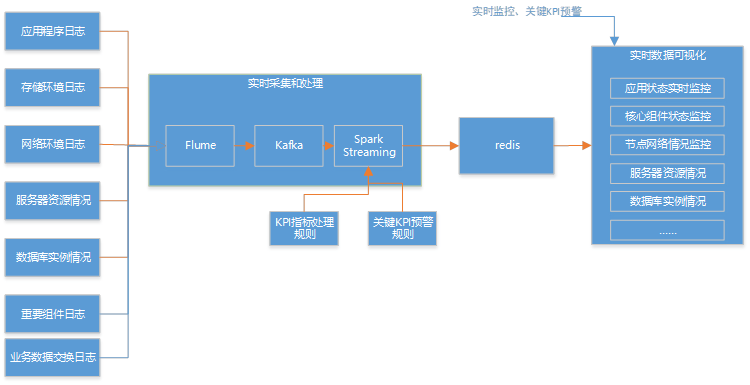

基於SparkStreaming對銀行日誌分析,實時技術架構圖

通過flume實時採集原日誌,送到kafka快取,SparkStreaming準實時從kafka拿資料,經過ETL、聚合計算送到redis,供前端展示,具體技術及程式碼見後面部落格;

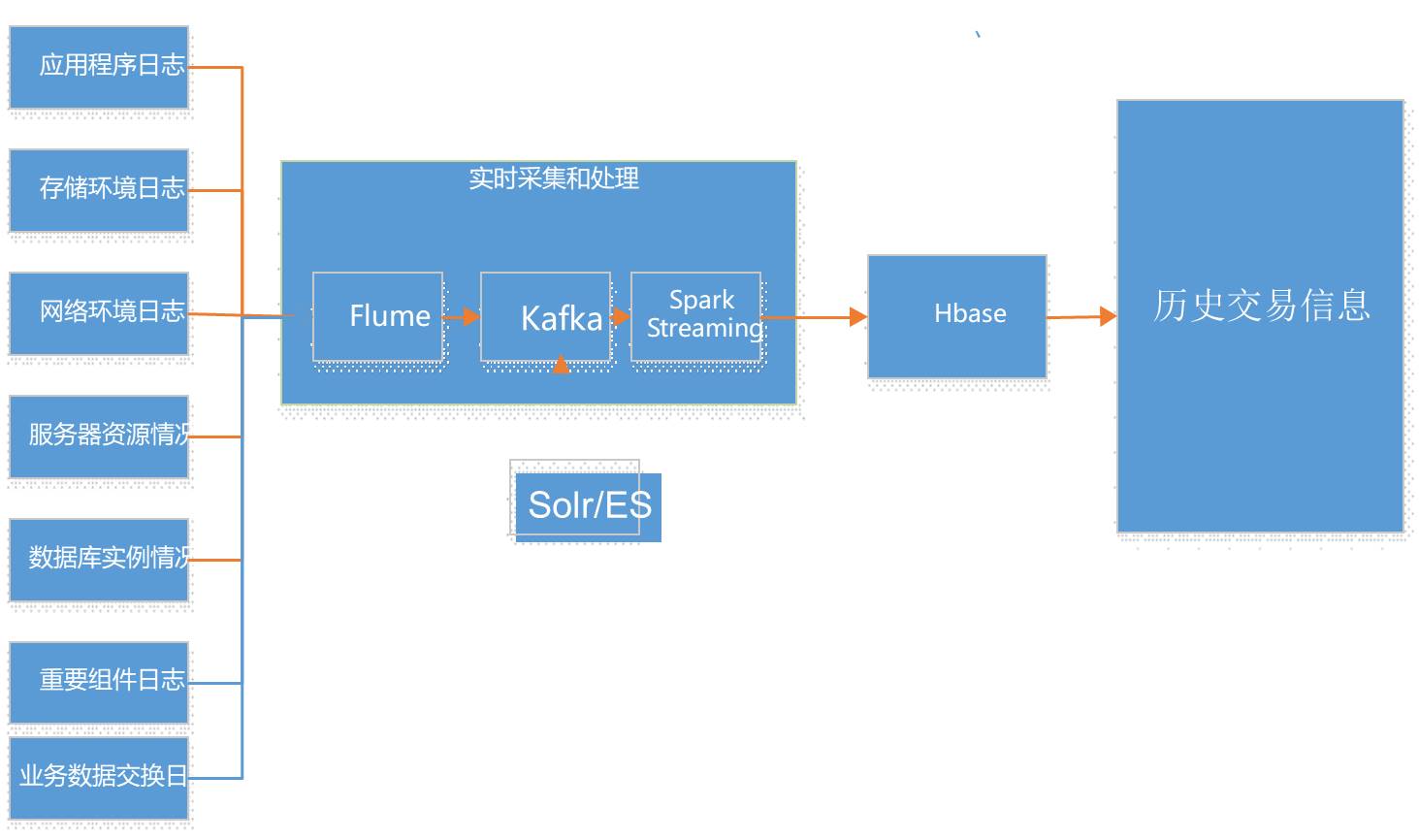

除了實時部分,還有離線這一塊,技術框架如下:

前面都一樣,只是通過SparkStreaming ETL後,不聚合計算直接插入hbase,供做離線批量和歷史查詢,主要是注意Hbase

rowkey的設定,具體技術和程式碼見後面部落格。

相關推薦

基於SparkStreaming對銀行日誌處理系列--整體技術框架

基於SparkStreaming對銀行日誌分析,實時技術架構圖 通過flume實時採集原日誌,送到kafka快取,SparkStreaming準實時從kafka拿資料,經過ETL、聚合計算送到redis,供前端展示,具體技術及程式碼見後面部落格; 除了實時部分,還有離線這一塊,技術框架如下: 前面都一樣,

java的江湖——對基於java的web應用開發之整體認識

話說在上個世紀九十年代的中期,Internet開始商業化,他所帶來的便利性使人們趨之若鶩,人們尤其是一些大的企業都想用這個東西給自己的工作、生活以及學習帶來便利,但是這個時候計算機的軟硬體環境差異很大,經常會發現你在A環境中開發的軟體系統並不能在B環境中執行,在這樣的大背景下,java攜

CAS原始碼追蹤系列三:cas-server端對請求的處理

目錄 InitialFlowSetupAction ServiceAuthorizationCheck AuthenticationViaFormAction SendTicketGrantingTicketAction GenerateServiceTicketAction 第一

springboot2.0---05、基於AOP日誌處理

@Aspect @Component public class LogAop { private final Logger log = LoggerFactory.getLogger(LogA

基於Docker的Kafka+Flume+flink日誌處理實驗

目錄 目錄 一、序言 驗證資料 一、序言 實驗用到的元件有:docker、kafka、kafka-manager、zookeeper、flume;由於資源限制使用docker下安裝kafka和zookeeper,在試驗

C#中基於GDI+(Graphics)影象處理系列之高質量縮圖

簡介 生成圖片縮圖的功能在Web開發的工作是經常遇到的,比如使用者上傳一張圖片作為使用者頭像,根據業務的需要生成若干不同尺寸的縮圖,不同的功能使用不同尺寸的圖片等等。 大家知道Image類有一個GetThumbnailImage的方法來生成縮圖,但是這貨表現

Spire.XLS資料處理系列教程:如何設定數字格式和文字對齊方式

Spire.XLS for .NET 是一款專業的 .NET Excel 元件, 它可以用在各種.NET 框架中,

SpringBoot系列(十三)統一日誌處理,logback+slf4j AOP+自定義註解,走起!

**往期精彩推薦** [SpringBoot系列(一)idea新建Springboot專案](https://www.cnblogs.com/swzx-1213/p/12345330.html) [SpringBoot系列(二)入門知識](https://www.cnblogs.com/swzx-1213

基於flink和drools的實時日誌處理

1、背景 日誌系統接入的日誌種類多、格式複雜多樣,主流的有以下幾種日誌: filebeat採集到的文字日誌,格式多樣 winbeat採集到的作業系統日誌 裝置上報到logstash的syslog日誌 接入到kafka的業務日誌 以上通過各種渠道接入的日誌,存在2個主要的問題: 格式不統一、不規範、標準化

【Spark深入學習 -10】基於spark構建企業級流處理系統

變現 大內存 空間換時間 detail python 訪問量 新版本 kafak 計算框架 ----本節內容------- 1.流式處理系統背景 1.1 技術背景 1.2 Spark技術很火 2.流式處理技術介紹 2.1流式處理技術概念 2.

學習筆記17_網站異常和日誌處理

add asa asp 日誌類 cte clob rect string 學習 *在clobal.asax中,寫protected void Application_Error() { Respone.Redirect("Default.aspx");//發生錯誤能在此

人工智能會促成一張基於物聯網可自主處理的數據互聯網絡

雲計算 物聯網 邊緣計算 移動互聯 雲計算——信息和數據爆炸的自然產物互聯網發展至今,總結下來大概經歷了這麽三個歷史時期或階段,分別是IT時代、ICT時代、DT時代。IT時代可以理解為桌面時代,那個時候網絡剛起步發展,人們只是通過桌面機進行簡單的信息展示或者獲取,雖然很多設備當時都處於脫

三、面向對象——11-處理對象

span 對象 -s str 打印 string ext left strong 11-處理對象 1.打印對象 2.toString方法 3.= =和equals方法三、面向對象——11-處理對象

controller層統一攔截進行日誌處理

uuid final asp end sna ogg long lan tostring 前言 在項目中添加統一日誌時,我們往往會用到aop進行切面處理,常用在controller層添加切面,以處理請求和返回的各項參數數據。 使用切面進行日誌處理 下面我們就看一個例子說明基

Python 對cookies的處理——urllib2

res ces build cookie值 ons for cookie value pre import urllib2 import cookielib cookie = cookielib.CookieJar() opener = urllib2.bui

YAML 對中文的處理

odin enc import int 中文 Coding pen all true from yaml import load,dump f = open(‘xx.ymal‘,encoding=‘utf-8‘) l = load(f) print(f) w

Fastjson對範型處理的bug

getter per onu fastjson 這樣的 width 部分 strong 由於 由於沒有寫博客的習慣,一直堅持不下來。 但是這次在重構中遇到這個bug忍不住要寫下來。太有趣啦。 問題是這樣的: 為了方便app對返回的數據處理,空數組返回[],空對象返回nu

python面向對象( item系列,__enter__ 和__exit__,__call__方法,元類)

屬性 eba callable 好處 繼承方式 類的創建 完成 __weak 依次 python面向對象進階(下) item系列 __slots__方法 __next__ 和 __iter__實現叠代器 析構函數 上下文管理協議 元類一

實現基於MySQL管理rsyslog日誌

mysql 管理 rsyslog 實驗概要: 本實驗主機默認采用系統為Centos 6.9 host1主機作為遠程日誌客戶端 安裝:rsyslog (默認安裝)、rsyslog-mysql host2主機作為日誌服務器 安裝:mysql(默認安裝,也可安裝

基於LAMP實現web日誌管理查看

日誌 web 管理 前言:日誌是一個重要的信息庫,如何高效便捷的查看系統中的日誌信息,是系統管理員管理系統的必備的技術。實現方式: 1、將日誌存儲於數據庫。 2、采用LAMP架構,搭建PHP應用,通過web服務訪問數據庫,提取日誌信息,展現到web頁面。基本結構圖:一、搭建日誌服務器