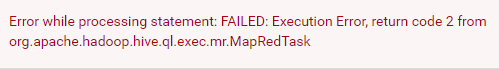

hive統計parquet表報錯

hue執行:

SELECT count(*) FROM tt_sales_order;

首先查看錶源資料:

parquet列式儲存格式,所以優先統計某一列:

SELECT count(salesorder_id) FROM tt_sales_order;

相關推薦

hive統計parquet表報錯

hue執行: SELECT count(*) FROM tt_sales_order; 首先查看錶源資料: parquet列式儲存格式,所以優先統計某一列: SELECT count(salesorder_id) FROM tt_sales_order;

hive刪除表報錯

option fatal erro 5.6 def near resp odata ror metastore.RetryingHMSHandler: HMSHandler Fatal error: javax.jdo.JDODataStoreException: You

load資料到hive分割槽表報錯: FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.MoveTas

在啟動hive建立表的時候,興許你們回碰到這個錯誤:http://blog.csdn.net/qq_35732963/article/details/54139581;百度一下,說是字元編碼的問題,那

建立hive和hbase整合表報錯原因之一

我的hive版本是apache-hive-1.2.1-bin.tar在hive裡建立hive和hbase整合表的內部表報錯資訊如下:FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.ex

在hibernate5中,關於讓hibernate自動創建表報錯的問題。

dia per div error tin 創建表 之前 dial dialect 問題描述:在讓hibernate創建自動建表時報了一下錯誤: Error executing DDL via JDBC Statement 問題解決:在hibernate.cfg.xml

hibernate中使用schemaExport生成數據表報錯解決方法

驅動 生成 和數 解決方法 and 報錯解決 itl ava con 【解決方法】 1.hibernate中使用schemaexport生成數據表,很多教材是教你這麽寫的: SchemaExport schemaExport = new SchemaExp

MySQL數據庫創建表報錯的解決方案

show tool cfg.xml 數據 nfa server url mapping odi 實體類 package com.tao.pojo; public class Student { private String id; private

hive連線MySQL報錯

錯誤如下: [[email protected] /usr/local/apache-hive-1.2.1-bin]#./bin/hive Logging initialized using configuration in jar:file:/usr/local/apache-h

hive安裝瘋狂報錯的坑(困擾我4天之久)

ERROR XBM0H: Directory /bin/metastore_db cannot be created. 這個錯誤是啟動hive之後,輸入show databases; 時報出來的,怎麼都解決不了,部落格都翻爛了,配置也找不到其他可以改的了。 看錯誤大概意思是hive還是用de

Hive on spark 報錯FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.spark

cp /opt/cloudera/parcels/CDH-5.13.3-1.cdh5.13.3.p0.2/lib/spark/lib/spark-assembly.jar /opt/cloudera/parcels/CDH-5.13.3-1.cdh5.13.3.p0.2/lib/hive/lib

kettle-java程式碼執行hive相關ktr時報錯: database type with plugin id [HIVE2] couldn't be found!

kettle-java程式碼執行hive相關ktr時報錯: database type with plugin id [HIVE2] couldn't be found! 轉 2018年08月13日 16:47:30 lisery1993 閱讀數:305 1.在jav

ORA-03001,GATHER_TABLE_STATS資料庫自動收集統計資訊報錯

1.根據Alert報錯資訊,查詢Trace日誌 /oracle/app/oracle/admin/fgsquery/bdump/fgsquery_j001_11111.trc Oracle Database 10g Enterprise Edition Release 10.2.0.4.0 - 64b

Mycat查表報錯find no Route:select * from `db_user`.`users` limit 0, 100

修改schema.xml的 checkSQLschema=“false”,改為true即可 <schema name="db_store" checkSQLschema="true" sqlMaxLimit="100"> 當該值為true時,例如我們執行語句selec

大資料hive之啟動報錯:system:java.io.tmpdir

解決方法: 在hive下建立個tmpdir目錄 在hive-site.xml中新增以下內容 <property> <name>system:java.io.tmpdir</name> <value&

自然周與自然月的Hive統計SQL

按照周或者月統計活躍數: 周: SELECT week, COUNT(DISTINCT pin), business_type FROM ( SELECT DISTINCT user_log_acct AS pin,weekofyear(dt) AS week , CASE locate('b

關於水晶報表報錯log4net

水晶報表異常“CrystalDecisions.ReportSource.ReportSourceFactory”的型別初始值設定項引發異常,未能載入檔案或程式集“log4net。。。 搞了很久,上方法:右擊工程屬性,將目標平臺改成x86,即可。

hive刪除表時報錯,解決方案

報錯: 1、檢視hive使用的mysql連線的jar包, 若為:mysql-connector-java-5.1.17.jar(沒帶bin的jar包),修改為mysql-connector-java-5.1.46-bin.jar(帶bin的jar包之後),就可以

搭建Hive遠端模式在初始化Hive的時候報錯Access denied for user 'hiveowner'@'127.0.0.1' (using password: YES)

報錯資訊如下: [[email protected] conf]# schematool -dbType mysql -initSchema SLF4J: Class path contains multiple SLF4J bindings. SLF4J: Found binding

Spark實現HIVE統計結果匯入到HBase操作

由於HIVE更新的機制極其不適應SPARK環境,於是利用HBase來執行HIVE中某些統計結果的更新。首先要做的是實現Spark + Hive訪問,得到RDD,再將這個RDD匯入到HBase中操作。

【報錯總結】Hive連線MySQL報錯

【報錯描述】安裝好Hive和Mysql後,要將Hive整合MySQL,但Hive始終不能連上MySQL,mysql中也沒有出現metastore資料庫,鍵入命令/bin/hive,報錯如下: [[email protected] hive-0.13.1]$ bin/hive