機器學習與數學基礎知識(一)

最近,朋友分享給我一套“七月線上”的機器學習視訊,我幾經思量之後,決定從視訊量最少的數學基礎部分開始看起,今天學習完了第一個視訊,長達2小時,感覺老師講的挺不錯的。以前自己就對機器學習很感興趣,做了一些瞭解和嘗試性地學習,也看了一點經典的林軒田和吳恩達系列的視訊,個人覺得再經典的機器學習視訊也需要一個良好的數學基礎來入門。

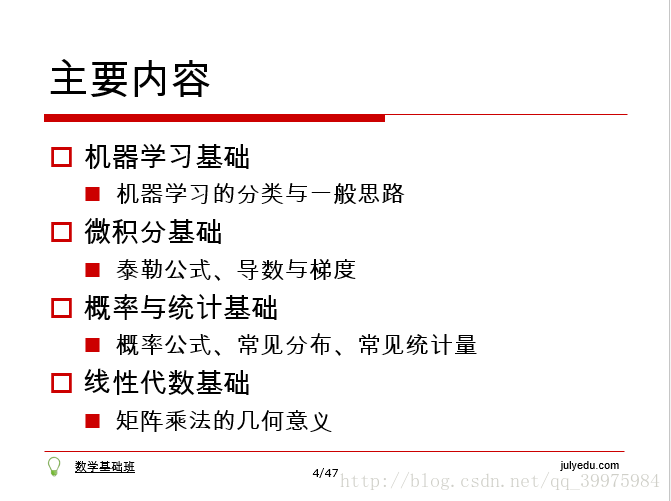

第一集的視訊主要是系統介紹了機器學習基礎與相關數學基礎的一些概念,具體的內容會在以後的視訊中展開。

一 機器學習基礎

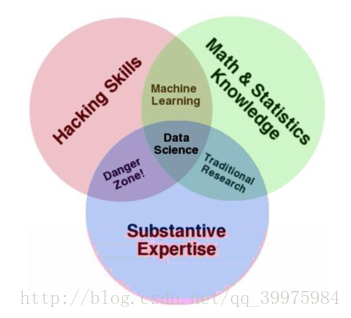

這是一張解釋 計算機程式設計能力(左上),個人專業領域(下面)和數學統計學知識(右上)關係的圖片。對於個人專業領域,是你從事的某一方向或者專業,比如影象處理,資料探勘,語音識別等這些可以用到機器學習的領域;在當今AI的大趨勢下,很多人都想轉型到AI的領域分一杯羹,那麼這些人大多是個人專業領域很強和程式設計能力很強的結合體,屬於危險區域(Danger Zone),你可以直接使用機器學習的模型,簡單的帶入資料,讓程式跑起來,解決工程問題,但是僅限於簡單的機器學習演算法,稍微複雜的機器學習演算法,必然要以強大的數學基礎為支撐,來保證你正確使用,維護和優化機器學習演算法。如果你個人專業領域很強,而且數學基礎也很棒,但缺乏程式碼能力,那麼你很適合做一個研究者,去研究和開發機器學習演算法,不必做過多的工程實踐,類似專碩研究生和博士的區別一樣。總的來說,數學統計學基礎尤為重要,打好數學基礎,有助於你更好的入門機器學習。

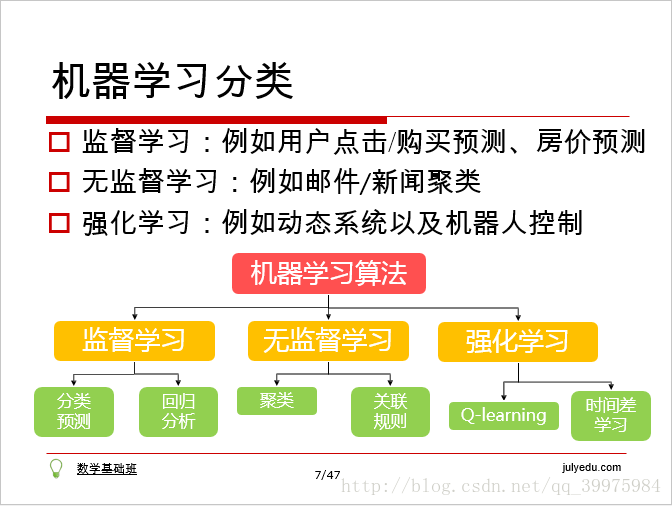

這張圖片為機器學習演算法的分類,這裡簡單提一下監督學習和無監督學習。大家都知道,機器學習演算法就跟人的大腦一樣,人的大腦基於觀察形成經驗對事情做出判斷,機器學習基於資料(樣本)形成模型對目標(標籤)做出預測;那麼,樣本分為兩類,一類為目標已知的資料(樣本),一類是目標未知的資料(樣本),基於前者形成的模型是監督學習,基於後者的是無監督學習。(因為本文重點在於闡明機器學習中的數學基礎,對於機器學習的概念不作詳細介紹,這部分目的是要你知道數學對機器學習的重要性)

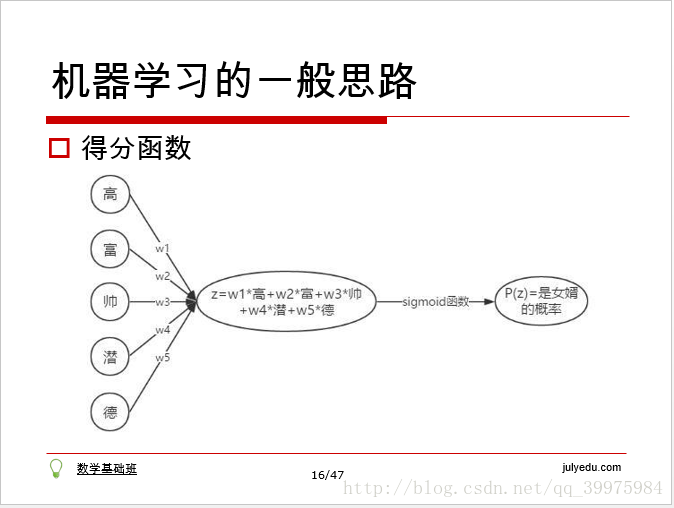

這個是第一部分“機器學習基礎”的重點——機器學習的一般思路。舉例:鳳姐的女兒去和100個男人相親,鳳姐根據高,富,帥,潛,德共五方面(可以理解為自變數)來決定其成為自己女婿的概率(可以理解為因變數)。根據這五方面在鳳姐心中的重要性,鳳姐會選擇權重w1,w2,w3,w4,w5列出一個得分函式z。而這些權重值w1,w2,w3,w4,w5是由損失函式(圖中給出了兩種損失函式模型,非凸函式和凸函式)得出的,即損失函式的最優化問題,這裡可以將損失函式的橫座標理解為(w1,w2,w3,w4,w5)組成的向量,最優化的解即為損失函式縱座標取最小值時對應的橫座標(w1,w2,w3,w4,w5),這樣就找到了得分函式z,即該問題的機器學習演算法模型

二 微積分基礎

這部分作者只是提到了一些微積分中比較重要的概念及其幾何意義,並未具體展開進行講解,相信大家在本科階段都學過高數,並且掌握了其知識點,那麼我這裡做一個分條整理:

1 夾逼準則:用來求極限的一種方法。

2 導數:一階導數表示曲線變化的快慢,即斜率,二階導數表示斜率變化的快慢,即凹凸性。

3 方向導數:標量;可以類比一階導數理解,只不過不是對x方向的求導,而是對某一方向的求導。

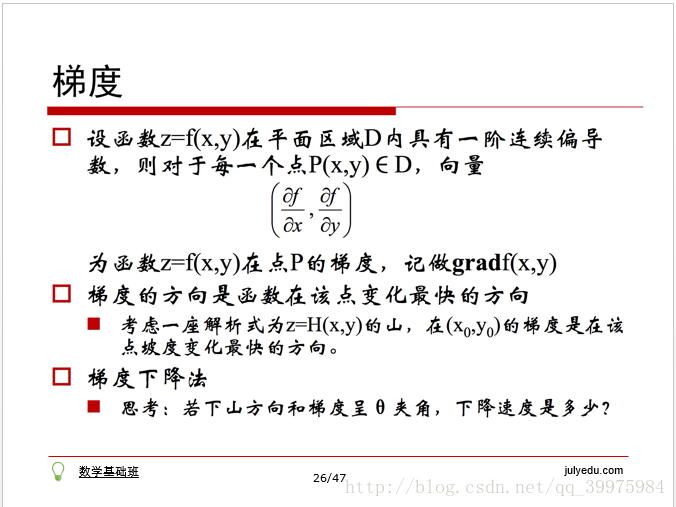

4 梯度:向量;模值表示方向導數的最大值,方向表示方向導數取最大值時的方向。

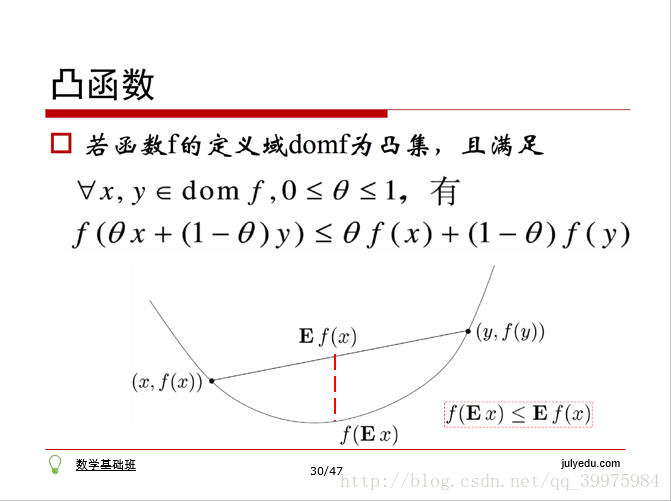

5 凸函式:Jensen不等式f[E(x)]<=E[f(x)]要理解。

下面貼出梯度和凸函式的圖片,梯度圖片中,最下面有一個“梯度下降法”,主要用在損失函式的最優化中;凸函式圖中,標出了Jensen不等式的幾何意義,有助於大家理解。

三 概率與統計基礎

這部分的知識點適合以圖片的方式呈現(大家注意區分概率,統計是兩個概念)。

1 概率

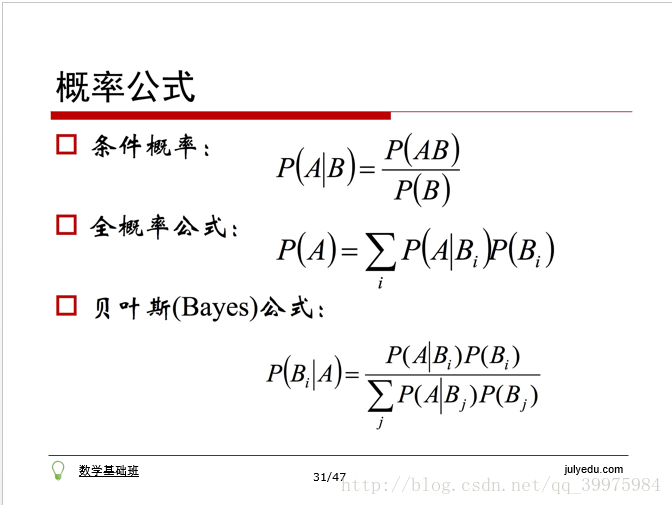

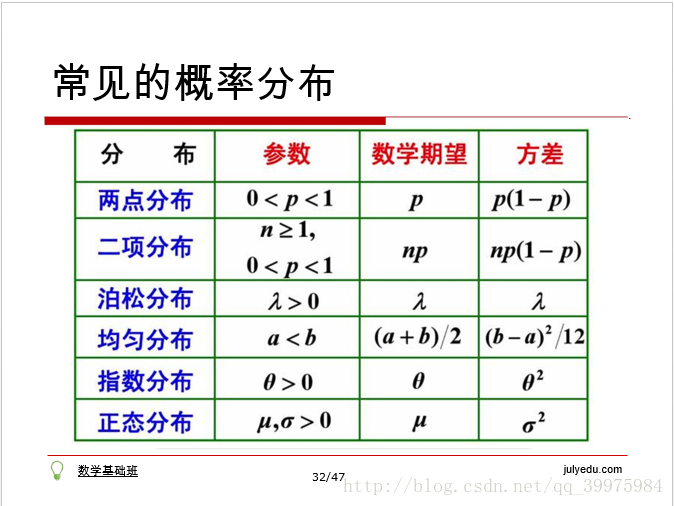

概率的知識點主要分兩部分:概率公式和概率分佈,如下圖。

2 統計

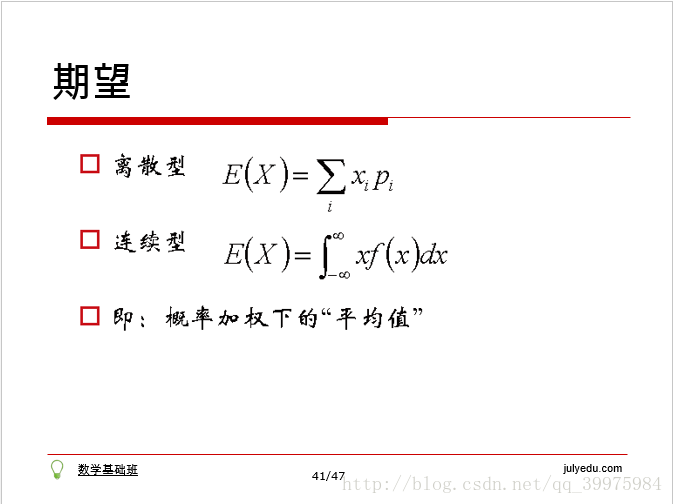

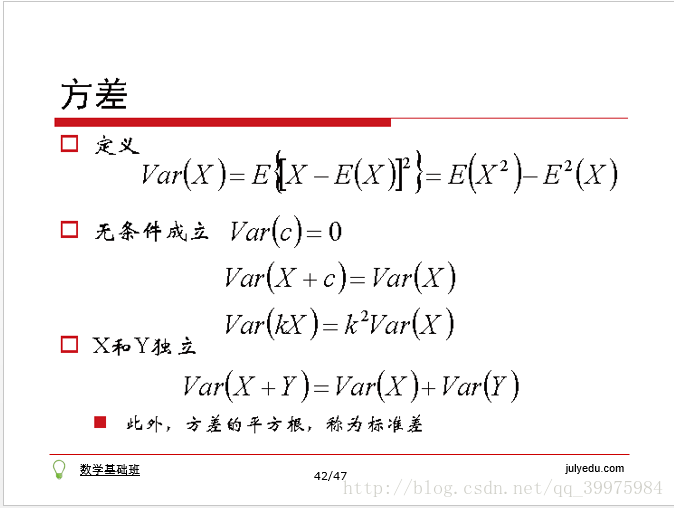

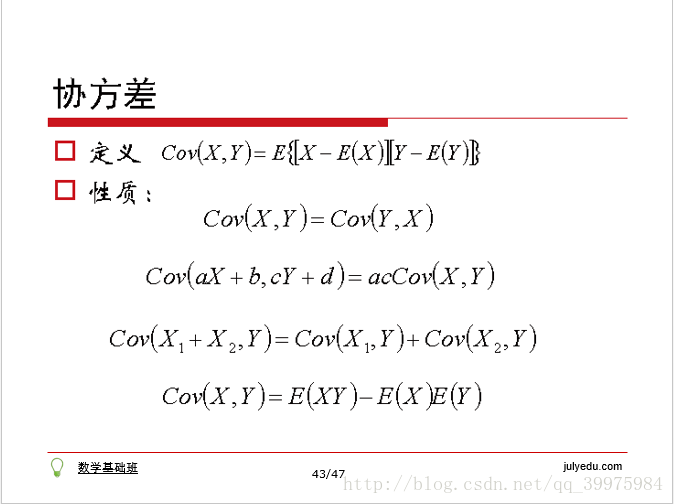

統計的知識點分為三個重要的統計量:期望,方差,協方差。

3 概率與統計

“概率”是已知隨機變數的分佈,計算某一事件發生的概率。“統計”是對總體作抽樣,得到樣本,對樣本進行估計,然後得到樣本的分佈情況後,進而得到總體的分佈情況。4 概率統計與機器學習

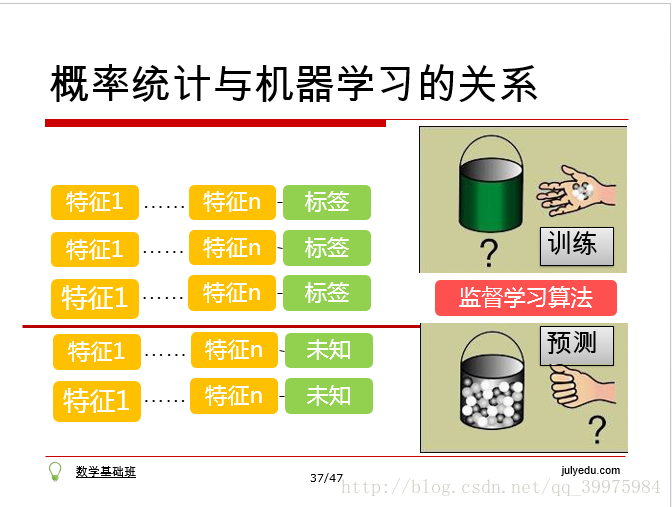

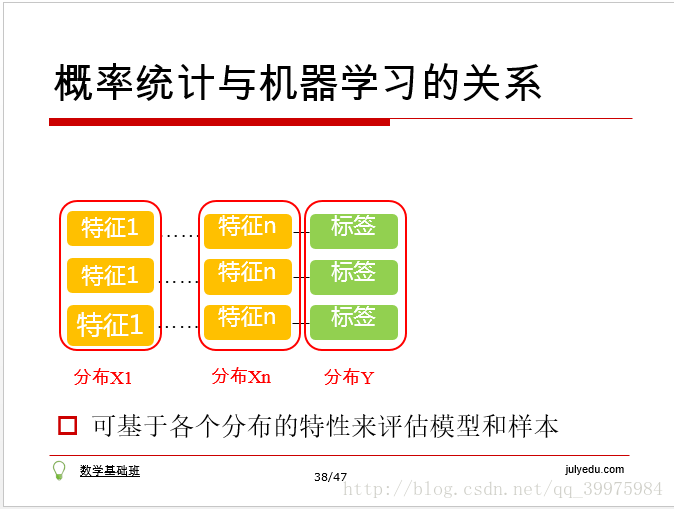

第一幅圖展示的是機器學習的分類——監督學習演算法的例子,該演算法基於樣本(資料)進行訓練得出模型,利用模型可以預測未知的標籤值。訓練相當於統計過程(得出分佈),而預測相當於概率的計算過程(得出標籤值)。第二幅圖是對樣本(資料)的特徵進行統計,得出其分佈X1,X2...Xn,並對標籤也進行統計得出分佈Y,通過分別計算分佈X1,X2...Xn與Y的協方差值,協方差的幾何意義是線性相關程度,這樣就可以把協方差值極小的分佈對應的特徵在訓練之前排除,減小了計算量,還可以使訓練的模型更為準確。四 線性代數基礎

線性代數這塊,與機器學習有關的主要是矩陣乘法的幾何意義,我們在本科階段學習了線性代數,掌握了矩陣相乘,卻從未考慮過矩陣相乘的幾何意義是什麼,當然,老師一般也很少提及。 舉例來說:下圖中(1)為一個矩陣相乘,很多人會自然想到它可以看作線性方程組 即(2),而矩陣相乘真正的幾何意義在於(3)和(4),即列向量的線性疊加和歐幾里得空間的向量合成與分解。

然後,對於矩陣乘法,還有如下優勢: