Celery 分布式任務隊列入門

一、Celery介紹和基本使用

Celery 是一個 基於python開發的分布式異步消息任務隊列,通過它可以輕松的實現任務的異步處理, 如果你的業務場景中需要用到異步任務,就可以考慮使用celery, 舉幾個實例場景中可用的例子:

- 你想對100臺機器執行一條批量命令,可能會花很長時間 ,但你不想讓你的程序等著結果返回,而是給你返回 一個任務ID,你過一段時間只需要拿著這個任務id就可以拿到任務執行結果, 在任務執行ing進行時,你可以繼續做其它的事情。

- 你想做一個定時任務,比如每天檢測一下你們所有客戶的資料,如果發現今天 是客戶的生日,就給他發個短信祝福

Celery 在執行任務時需要通過一個消息中間件來接收和發送任務消息,以及存儲任務結果, 一般使用rabbitMQ or Redis,後面會講

1.1 Celery有以下優點:

- 簡單:一單熟悉了celery的工作流程後,配置和使用還是比較簡單的

- 高可用:當任務執行失敗或執行過程中發生連接中斷,celery 會自動嘗試重新執行任務

- 快速:一個單進程的celery每分鐘可處理上百萬個任務

- 靈活: 幾乎celery的各個組件都可以被擴展及自定制

Celery基本工作流程圖

1.2 Celery安裝使用

Celery的默認broker是RabbitMQ, 我這裏使用redis,僅需配置一行就可以

broker_url=‘amqp://guest:[email protected]:5672//‘

使用Redis做broker也可以

broker_url = ‘redis://:[email protected]:6379‘

註意:celery任務隊列執行使用的中間件和取結果的中間件是彼此分離的,在使用中都需要各自配置

1. 3 開始使用Celery啦

安裝celery模塊

pip3 install celery

創建一個celery application 用來定義你的任務列表

創建一個任務文件就叫tasks.py吧

from celery import Celery

#app是一個worker,負責執行任務,多個worker執行時,任務執行順序為搶占式,並不會按照類似於rabbitmq分配任務 app = Celery(‘tasks‘, broker=‘redis://:[email protected]

啟動Celery Worker來開始監聽並執行任務

celery -A celery_test worker -l debug

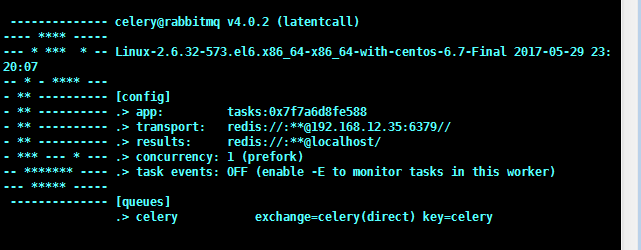

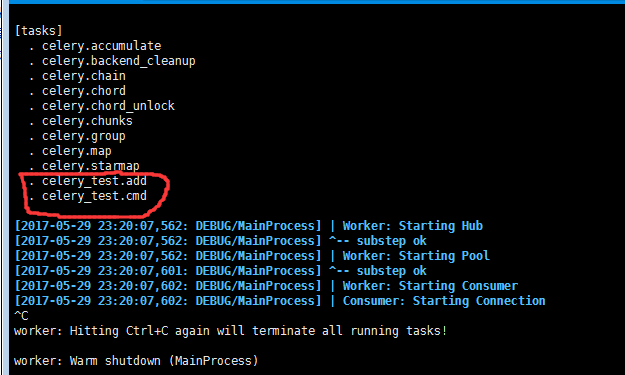

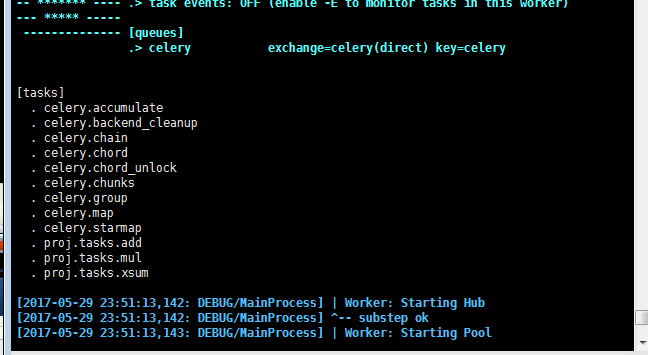

打印結果如下:

上面顯示配置信息

下面紅線內為自定義任務:

調用任務

再打開一個終端, 進行命令行模式,調用任務

>>> from celery_test import add >>> add.delay(4, 4)

看你的worker終端會顯示收到 一個任務,此時你想看任務結果的話,需要在調用 任務時 賦值個變量

>>> result = add.delay(4, 4)

如果想查看任務是否完成,可調用下面命令,返回布爾值

>>> result.ready()

想拿到任務執行結果,調用下面命令(註意:想拿到結果首先得配置接收任務的中間件,否則會報錯)

result.get()

二、在項目中如何使用celery

可以把celery配置成一個應用

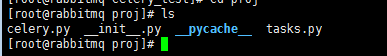

目錄格式如下

proj/__init__.py

/celery.py #配置信息

/tasks.py #任務

配置結果如下:

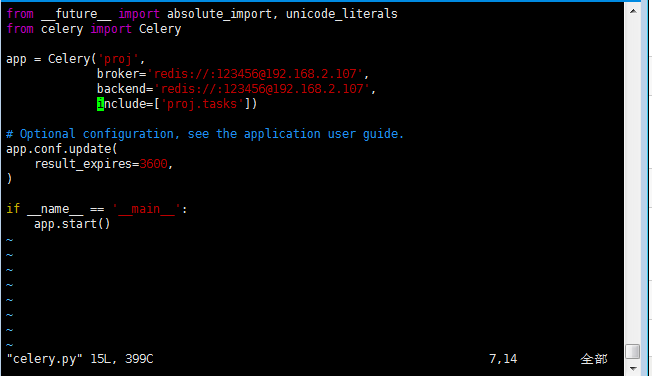

編輯proj/celery.py文件:

from __future__ import absolute_import, unicode_literals #聲明celery從python包絕對路徑裏導入celery包

from celery import Celery

app = Celery(‘proj‘,

broker=‘amqp://‘,

backend=‘amqp://‘,

include=[‘proj.tasks‘]) #任務文件路徑列表,可添加多個任務

# Optional configuration, see the application user guide.

app.conf.update(

result_expires=3600, #任務結果保存時間

)

if __name__ == ‘__main__‘:

app.start()

編輯proj/tasks.py中的內容

from __future__ import absolute_import, unicode_literals

from .celery import app #導入同級目錄下celery文件中的app

@app.task

def add(x, y):

return x + y

@app.task

def mul(x, y):

return x * y

@app.task

def xsum(numbers):

return sum(numbers)

cd到proj文件夾上一級啟動worker ,命令如下

celery -A proj worker -l debug

執行結果:

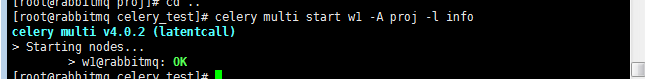

同時啟動多個worker:

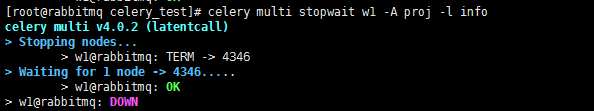

停止某個worker:(stopwait是等待當前任務完成停止,stop是立即停止)

三:celery+django項目

django 可以輕松跟celery結合實現異步任務,只需簡單配置即可

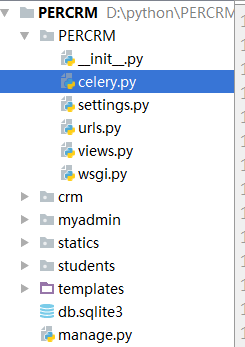

第一步:在settings.py同級目錄下,創建celery.py文件

from __future__ import absolute_import, unicode_literals import os from celery import Celery # set the default Django settings module for the ‘celery‘ program. os.environ.setdefault(‘DJANGO_SETTINGS_MODULE‘, ‘PERCRM.settings‘) #根據具體項目配置 app = Celery(‘PERCRM‘) # Using a string here means the worker don‘t have to serialize # the configuration object to child processes. # - namespace=‘CELERY‘ means all celery-related configuration keys # should have a `CELERY_` prefix. app.config_from_object(‘django.conf:settings‘, namespace=‘CELERY‘) # Load task modules from all registered Django app configs. app.autodiscover_tasks() #自動發現各個app裏面創建的celery任務,可以創建多個任務

@app.task(bind=True) def debug_task(self): print(‘Request: {0!r}‘.format(self.request))

第二步:配置settings.py同級目錄下的__init__.py文件

from __future__ import absolute_import, unicode_literals # This will make sure the app is always imported when # Django starts so that shared_task will use this app. from .celery import app as celery_app __all__ = [‘celery_app‘]

第三步:配置settings.py文件

CELERY_BROKER_URL = ‘redis://:[email protected] CELERY_RESULT_BACKEND = ‘redis://:[email protected]

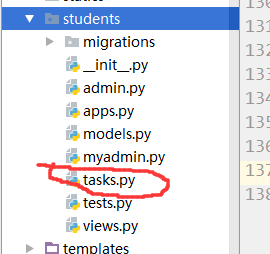

第四步:創建任務文件,在APP下創建tasks.py文件

任務內容格式如下:

# Create your tasks here

from __future__ import absolute_import, unicode_literals

from celery import shared_task #可以跟其他APP共享任務

@shared_task

def add(x, y):

return x + y

@shared_task

def mul(x, y):

return x * y

@shared_task

def xsum(numbers):

return sum(numbers)

此時,基本的配置就完了,加上一條對應的視圖,整個項目就可以結合celery運行了

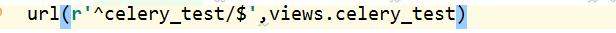

urls.py:

views.py

from students.tasks import add,mul

def celery_test(request):

task = add.delay(123,456)

return HttpResponse(task.id)

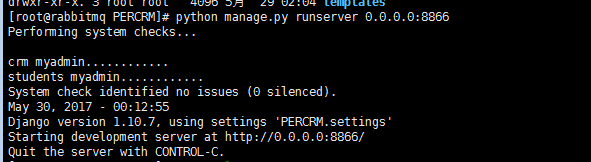

現在我們啟動項目:

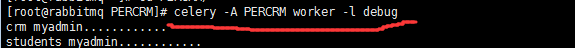

進到項目裏面啟動celery

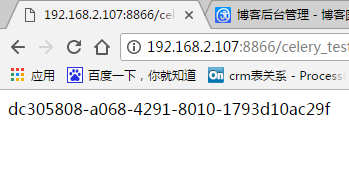

此時在瀏覽器訪問http://192.168.2.107:8866/celery_test/

結果如下,返回了celery任務id,一個簡單的celery與django結合的項目就完成了

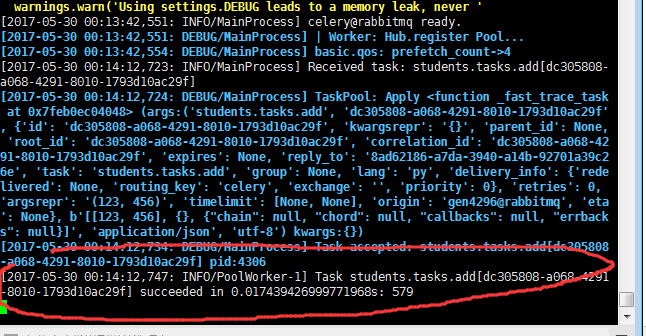

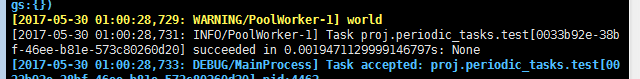

再查看服務端celery

四、Celery 定時任務

celery支持定時任務,設定好任務的執行時間,celery就會定時自動幫你執行, 這個定時任務模塊叫celery beat

寫一個腳本 叫periodic_task.py

from celery import Celery

from celery.schedules import crontab

app = Celery()

@app.on_after_configure.connect #裝飾器作用:只要腳本一啟動便立刻自動執行被裝飾的函數

def setup_periodic_tasks(sender, **kwargs):

# Calls test(‘hello‘) every 10 seconds.

sender.add_periodic_task(10.0, test.s(‘hello‘), name=‘add every 10‘) #每隔十秒鐘,執行test函數,傳入參數‘hello’,

# Calls test(‘world‘) every 30 seconds

sender.add_periodic_task(30.0, test.s(‘world‘), expires=10) #expires任務結果保存十秒鐘

# Executes every Monday morning at 7:30 a.m.

sender.add_periodic_task(

crontab(hour=7, minute=30, day_of_week=1),

test.s(‘Happy Mondays!‘), #每周一早上十點半執行test函數

)

@app.task

def test(arg):

print(arg)

add_periodic_task 會添加一條定時任務

上面是通過調用函數添加定時任務,也可以像寫配置文件 一樣的形式添加, 下面是每30s執行的任務

app.conf.beat_schedule = {

‘add-every-30-seconds‘: {

‘task‘: ‘tasks.add‘,

‘schedule‘: 30.0,

‘args‘: (16, 16)

},

}

app.conf.timezone = ‘UTC‘

任務添加好了,需要讓celery單獨啟動一個進程來定時發起這些任務, 註意, 這裏是發起任務,不是執行,這個進程只會不斷的去檢查你的任務計劃, 每發現有任務需要執行了,就發起一個任務調用消息,交給celery worker去執行

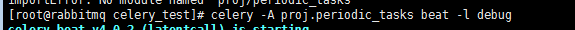

啟動任務調度器 celery beat,(註意:需寫上具體的任務名)

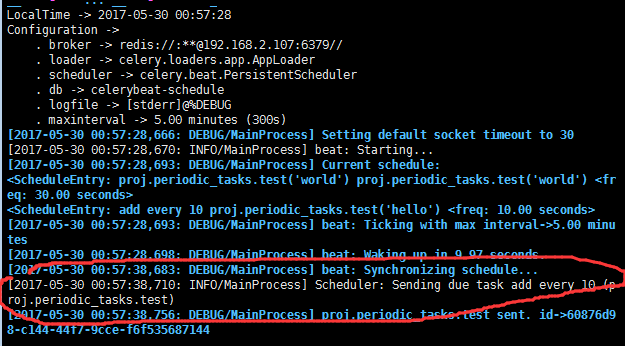

輸出:

worker打印輸出:

五、在django中使用計劃任務功能

第一步:安裝模塊

pip3 install django-celery-beat

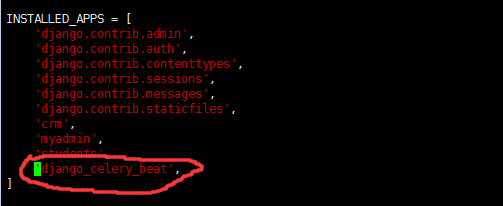

第二步:在django項目的settings.py中INSTALLED_APPS的配置

第三步:配置完之後,需要同步數據庫,執行migrate與makemigrations命令

以上操作完成之後,啟動django項目,訪問http://192.168.2.107:8866/admin/

在admin頁面我們會看到底部多了一個三張表出來

配置完長這樣

此時啟動你的celery beat 和worker,會發現每隔2分鐘,beat會發起一個任務消息讓worker執行scp_task任務

註意,經測試,每添加或修改一個任務,celery beat都需要重啟一次,要不然新的配置不會被celery beat進程讀到

Celery 分布式任務隊列入門