智能小車項目計劃

深度神經網絡的自主學習能力是自動駕駛汽車開發的重要因素: 機器能夠像人類一樣, 逐步從經驗中調整權重獲得良好的駕駛技能.

困難在於, 駕駛過程中出現的問題難以從代碼層面發現漏洞, 學習好的機器是個黑箱(被數據量包裹);

對自動駕駛汽車而言, 這種“不透明性”造成的後果非常嚴重:

無人車犯錯了,按正常的邏輯來說,肯定是得讓工程師找到病根,進而對漏洞進行修復,確保它不會再犯同樣的錯誤。目前有一種方法是借助模擬的形式,先展示給機器大腦一個特征,之後再提供另一個特征,以此類推,以便找出影響其決策的關鍵因素。

車用AI芯片供應商英偉達聯合卡內基·梅隆大學的研究人員, 找到了一種能夠讓人工智能系統決策過程變得更透明的簡單方法.

英偉達汽車部門高級主管 Danny Shapiro 介紹稱, 深度神經網絡能夠通過自主學習逐步提升駕駛經驗,但這樣的經驗是無法通過手動編程提供的。即便如此,我們仍然有能力向大家解釋為什麽系統會做出這樣或那樣的決策”。

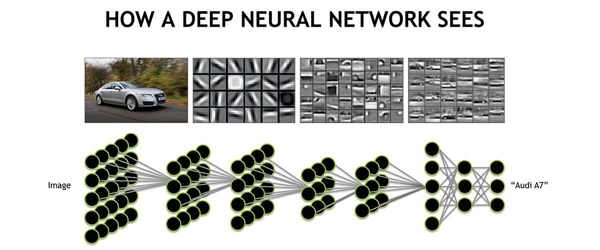

Shapiro表示,這個方法的關鍵在於它能夠利用可視化地圖將神經網絡在看到圖片後標記的重要特征進行定位。下面這幾張圖片是在汽車前置攝像頭采集數據的基礎上進行可視化加工而成的,而開發人員還只是在進行「利用深度神經網絡控制車輛轉向以保證其在車道線內行駛」領域的研究。

由於整個深度神經網絡是由不同的層構成的,先將分析結果進行提取(已經獲得了輸入圖像的重要特征),隨後將結果附加至下層網絡,作平均處理後再繼續向下,直到將最終結果附加至原始輸入的圖片上。上面這幾幅可視化地圖中,綠色的部分表示深度神經網絡高度優先關註的環境特征。而且你會發現,如果讓人類來識別的話,這些特征(車道線、道路邊緣,停著的其它車輛,沿線的綠籬等)同樣是一個老司機不會忽視的重要區域。

當然,為了確保這些圖像特征是機器進行決策的關鍵,研究人員還將所有的像素塊分成了兩類:I. 包含有明顯對駕駛決策有影響的顯著特征的圖像;II. 一般是背景圖,有一些和駕駛決策不太相關的非明顯特征。通過對這兩類圖像進行人為數字操作,研究人員發現,改變“明顯特征”這個變量會導致轉向角度發生線性變化,這跟換掉整個圖像的結果幾乎是一致的;而如果只是將背景畫面進更改,汽車的轉向角度基本不會發生什麽變化。

不過話又說回來了,目前工程師其實對人工智能系統出現的bug仍然束手無策,而回到本源,深度神經網絡並不是由人工代碼架構而成的,所以其實這裏可能用“bug”都不是很合適,整個系統中對最終決策最關鍵的其實是一系列的識別特征。

將重要特征值進行可視化, 是方便人們搞明白機器是如何進行思考的重要一步.

智能小車項目計劃