linux的bond模式綁定及模式區別

【linux的bond模式配置】

原理:

多塊網卡虛擬成一張,實現冗余;多張網卡對外顯示一張,具有同一個IP;

工作在網卡是混雜模式的情況下;

對於多物理網卡的 Bond 網卡而言,其中一塊物理網卡會被設置為 Master,其他的網卡都是 Slave,Bond 網卡的 MAC 地址取自標誌為 Master 的物理網卡,然後將這個 MAC 地址復制到其他物理網卡上;

工作模式:

在主備模式下 , 只有主網卡 eth0 工作,eth1 作為備份網卡是不工作的,只有當一個網絡接口失效時 ( 例如主交換機掉電等 ),為了不會出現網絡中斷,系統會按照配置指定的網卡順序啟動工作,保證機器仍能對外服務,起到了失效保護的功能。

在負載均衡模式下,由於兩塊網卡都正常工作,它能提供兩倍的帶寬,在這種情況下出現一塊網卡失效,僅僅會是服務器出口帶寬下降,也不會影響網絡使用。

# service NetworkManager stop (關閉NetworkManager服務)

# service NetworkManager stop (關閉NetworkManager服務)

【配置操作】

測試環境qinlin7

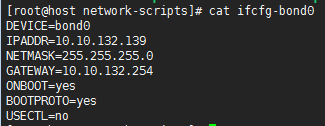

1、添加並更改ifcfg-bond0

DEVICE=bond0

IPADDR=10.10.132.139

NETMASK=255.255.255.0

GATEWAY=10.10.132.254

ONBOOT=yes

BOOTPROTO=yes

說明:截圖中的USERCTL參數可以不設置!!

2、編輯ifcfg-eth0

BOOTPROTO=none

DEVICE=eth0

MASTER=bond0

SLAVE=yes ##註意:若配置,則不需要再配置/etc/rc.d/rc.local

ONBOOT=yes

GWADDR=00:50:56:a1:6b:c5 ###可以不要

3、編輯ifcfg-eth1

BOOTPROTE=none

DEVICE=eth1

MASTER=bond0

SLAVE=yes

ONBOOT=yes

HQADDR=00:50:a1:3f:73 ###可以不要

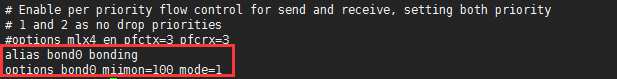

4、此系統中沒有/etc/modprobe.conf

則編輯# vim /etc/modprobe.d/mlx4.conf

alias bond0 bonding

options bond0 miimon=100 mode=1

說明:

mode=0表示load balancing (round-robin)為負載均衡方式;

mode=1表示fault-tolerance (active-backup)提供冗余功能;

若在bond配置文件中配置BONDING_OPTS="mode=5 miimon=100",該地方可以不配置

5、加載bonding模塊

# modprobe bonding

6、重啟物理機

# init 6 && reboot

說明:init 6重啟速度會比較快!!!

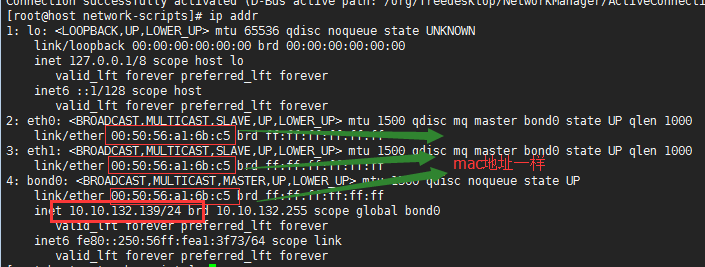

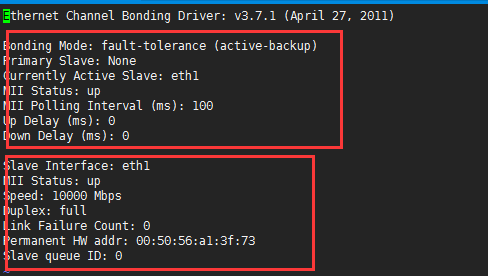

7、查看ifconfig

8、查看bond綁定狀態

# vim /proc/net/bonding/bond0

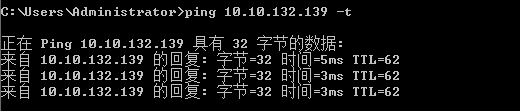

9、測試:

# ifdown eth0

bonding後,eth1仍然工作,虛擬機網絡仍是通的;剩余eth1和bonding的mac地址仍然一樣;

查看網絡是否還通著:

查看bonding的狀態:

附錄:

七種bond模式說明:

第一種模式:mod=0 ,即:(balance-rr)Round-robin policy(平衡掄循環策略)

特點:傳輸數據包順序是依次傳輸(即:第1個包走eth0,下一個包就走eth1….一直循環下去,直到最後一個傳輸完畢),此模式提供負載平衡和容錯能力;但是我們知道如果一個連接或者會話的數據包從不同的接口發出的話,中途再經過不同的鏈路,在客戶端很有可能會出現數據包無序到達的問題,而無序到達的數據包需要重新要求被發送,這樣網絡的吞吐量就會下降

第二種模式:mod=1,即: (active-backup)Active-backup policy(主-備份策略)

特點:只有一個設備處於活動狀態,當一個宕掉另一個馬上由備份轉換為主設備。mac地址是外部可見得,從外面看來,bond的MAC地址是唯一的,以避免switch(交換機)發生混亂。此模式只提供了容錯能力;由此可見此算法的優點是可以提供高網絡連接的可用性,但是它的資源利用率較低,只有一個接口處於工作狀態,在有 N 個網絡接口的情況下,資源利用率為1/N

第三種模式:mod=2,即:(balance-xor)XOR policy(平衡策略)

特點:基於指定的傳輸HASH策略傳輸數據包。缺省的策略是:(源MAC地址 XOR 目標MAC地址)% slave數量。其他的傳輸策略可以通過xmit_hash_policy選項指定,此模式提供負載平衡和容錯能力

第四種模式:mod=3,即:broadcast(廣播策略)

特點:在每個slave接口上傳輸每個數據包,此模式提供了容錯能力

第五種模式:mod=4,即:(802.3ad)IEEE 802.3ad Dynamic link aggregation(IEEE802.3ad 動態鏈接聚合)

特點:創建一個聚合組,它們共享同樣的速率和雙工設定。根據802.3ad規範將多個slave工作在同一個激活的聚合體下。外出流量的slave選舉是基於傳輸hash策略,該策略可以通過xmit_hash_policy選項從缺省的XOR策略改變到其他策略。需要註意的 是,並不是所有的傳輸策略都是802.3ad適應的,尤其考慮到在802.3ad標準43.2.4章節提及的包亂序問題。不同的實現可能會有不同的適應 性。

必要條件:

條件1:ethtool支持獲取每個slave的速率和雙工設定

條件2:switch(交換機)支持IEEE802.3ad Dynamic link aggregation

條件3:大多數switch(交換機)需要經過特定配置才能支持802.3ad模式

第六種模式:mod=5,即:(balance-tlb)Adaptive transmit load balancing(適配器傳輸負載均衡)

特點:不需要任何特別的switch(交換機)支持的通道bonding。在每個slave上根據當前的負載(根據速度計算)分配外出流量。如果正在接受數據的slave出故障了,另一個slave接管失敗的slave的MAC地址。

該模式的必要條件:ethtool支持獲取每個slave的速率

第七種模式:mod=6,即:(balance-alb)Adaptive load balancing(適配器適應性負載均衡)

特點:該模式包含了balance-tlb模式,同時加上針對IPV4流量的接收負載均衡(receiveload balance, rlb),而且不需要任何switch(交換機)的支持。接收負載均衡是通過ARP協商實現的。bonding驅動截獲本機發送的ARP應答,並把源硬件地址改寫為bond中某個slave的唯一硬件地址,從而使得不同的對端使用不同的硬件地址進行通信。

來自服務器端的接收流量也會被均衡。當本機發送ARP請求時,bonding驅動把對端的IP信息從ARP包中復制並保存下來。當ARP應答從對端到達時,bonding驅動把它的硬件地址提取出來,並發起一個ARP應答給bond中的某個slave。使用ARP協商進行負載均衡的一個問題是:每次廣播 ARP請求時都會使用bond的硬件地址,因此對端學習到這個硬件地址後,接收流量將會全部流向當前的slave。這個問題可以通過給所有的對端發送更新(ARP應答)來解決,應答中包含他們獨一無二的硬件地址,從而導致流量重新分布。當新的slave加入到bond中時,或者某個未激活的slave重新 激活時,接收流量也要重新分布。接收的負載被順序地分布(roundrobin)在bond中最高速的slave上當某個鏈路被重新接上,或者一個新的slave加入到bond中,接收流量在所有當前激活的slave中全部重新分配,通過使用指定的MAC地址給每個 client發起ARP應答。下面介紹的updelay參數必須被設置為某個大於等於switch(交換機)轉發延時的值,從而保證發往對端的ARP應答 不會被switch(交換機)阻截。

必要條件:

條件1:ethtool支持獲取每個slave的速率;

條件2:底層驅動支持設置某個設備的硬件地址,從而使得總是有個slave(curr_active_slave)使用bond的硬件地址,同時保證每個 bond 中的slave都有一個唯一的硬件地址。如果curr_active_slave出故障,它的硬件地址將會被新選出來的 curr_active_slave接管其實mod=6與mod=0的區別:mod=6,先把eth0流量占滿,再占eth1,….ethX;而mod=0的話,會發現2個口的流量都很穩定,基本一樣的帶寬。而mod=6,會發現第一個口流量很高,第2個口只占了小部分流量

linux的bond模式綁定及模式區別