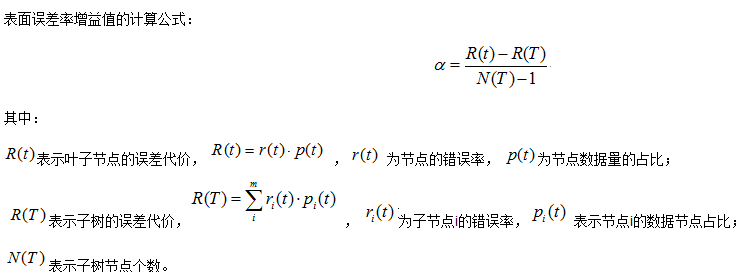

統計學習方法五 決策樹分類

阿新 • • 發佈:2017-09-03

回歸 element row tps 樣本 pan 類別 表示 splay

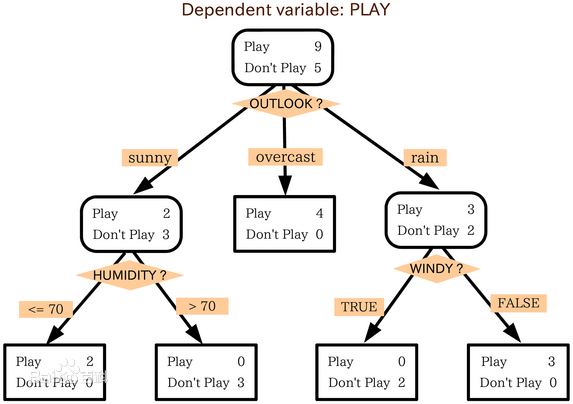

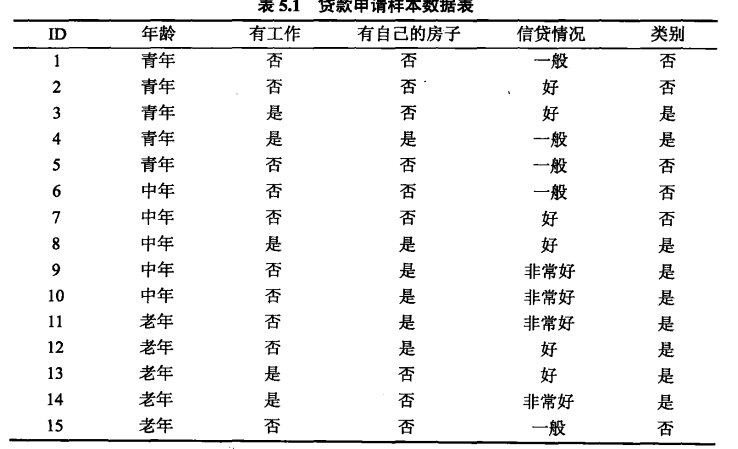

決策樹分類

1,概念

2,決策樹算法

2.1,特征選擇:

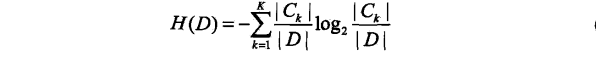

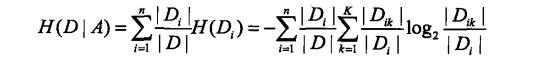

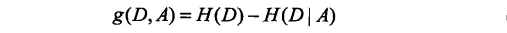

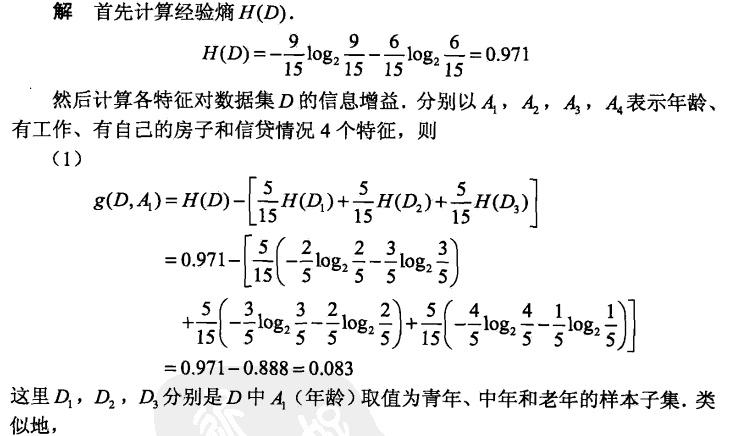

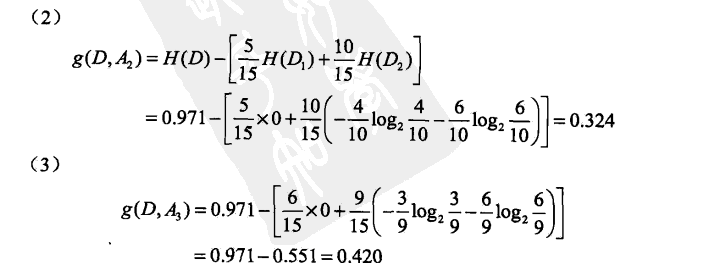

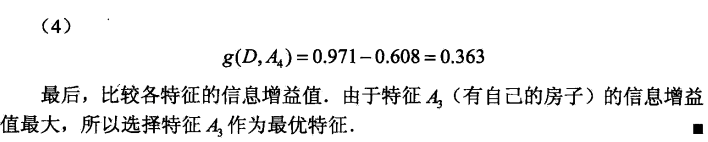

熵:值越大,不確定性因素越大;條件熵:條件對結果的影響不確定性;信息增益;信息增益比

2.2,決策樹生成算法

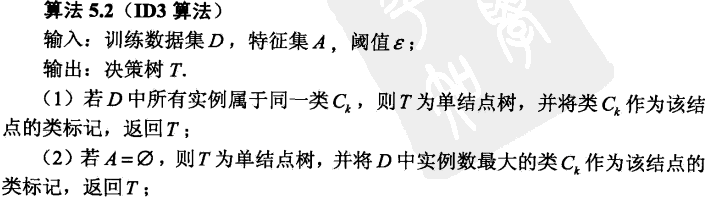

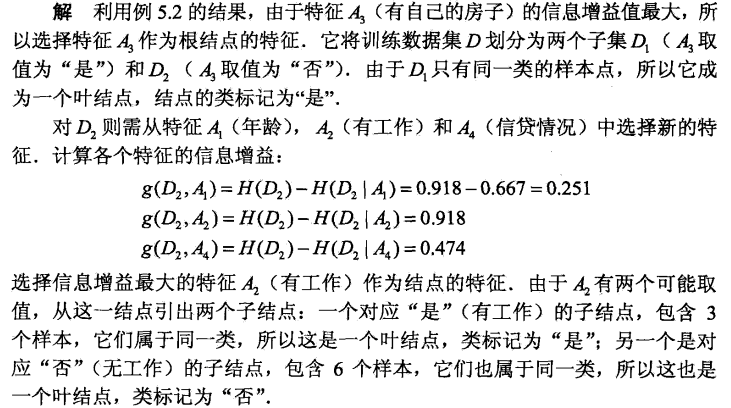

1,ID3算法

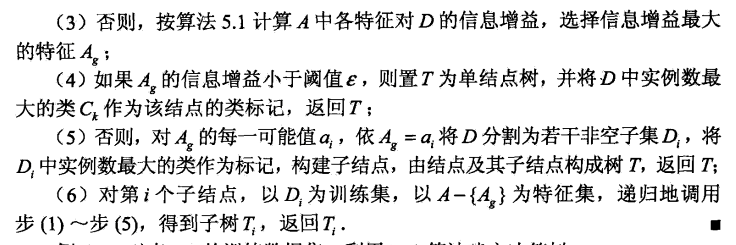

2,c4.5算法

3,實例說明

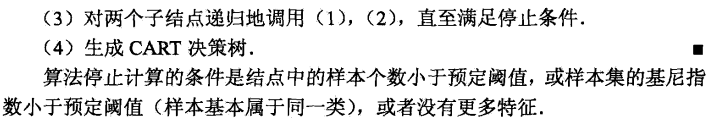

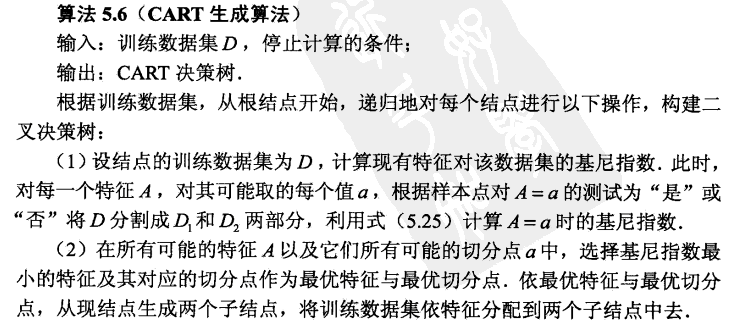

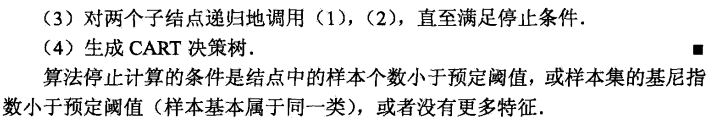

4,CART決策樹算法

4.1 決策樹生成

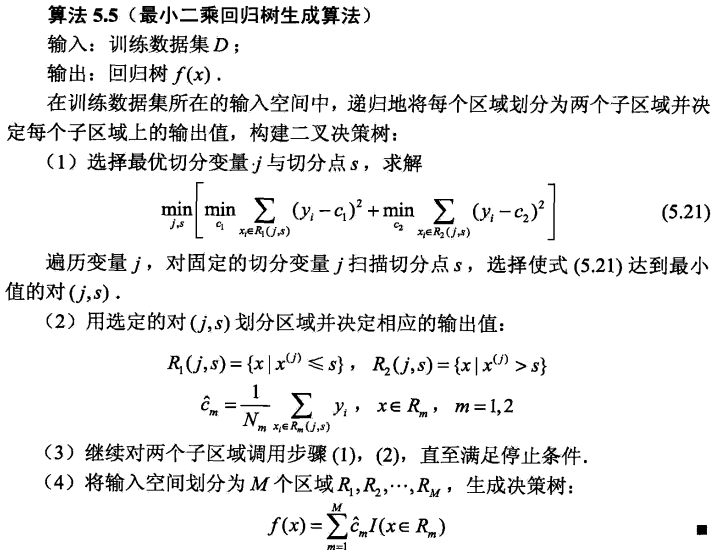

回歸樹生成

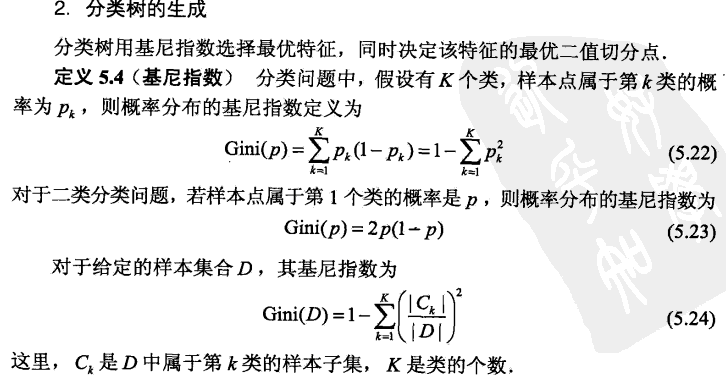

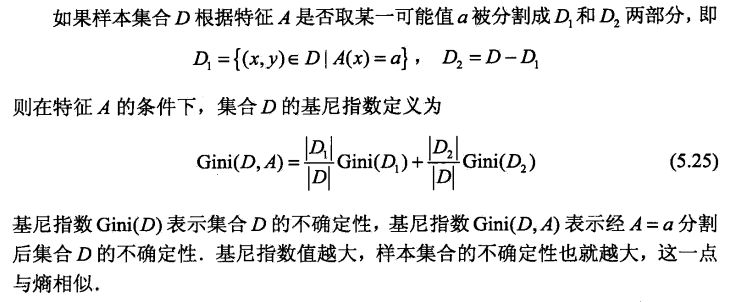

分類樹生成

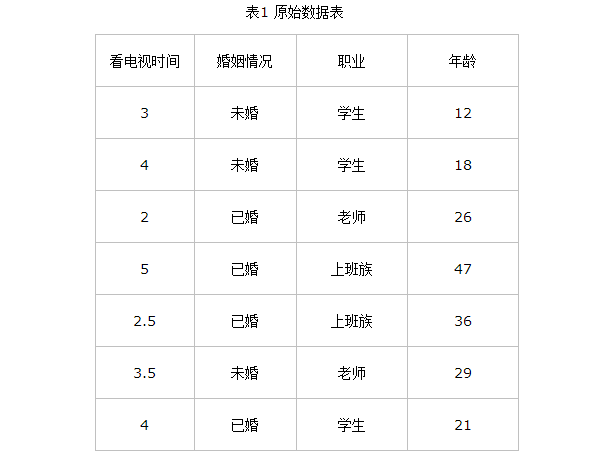

舉個例子:

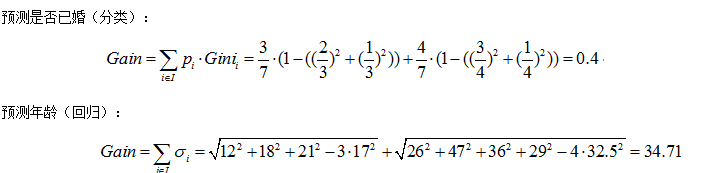

第一種劃分方法:{“學生”}、{“老師”、“上班族”} 來預測婚姻

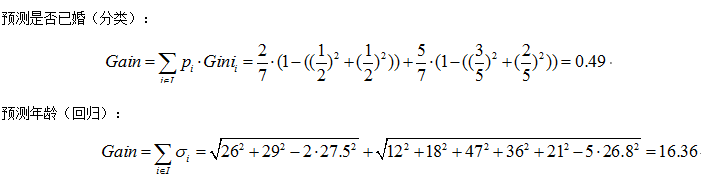

第二種劃分方法:{“老師”}、{“學生”、“上班族”}

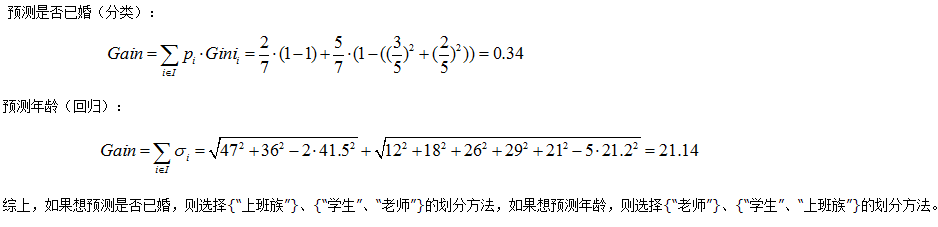

第三種劃分方法:{“上班族”}、{“學生”、“老師”}

4.2,決策樹剪枝

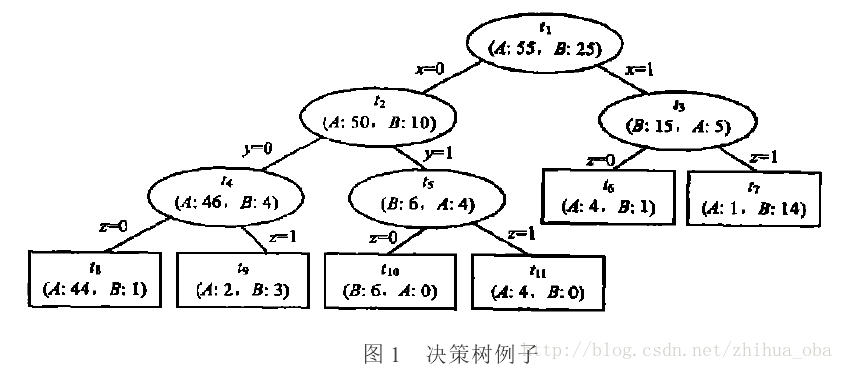

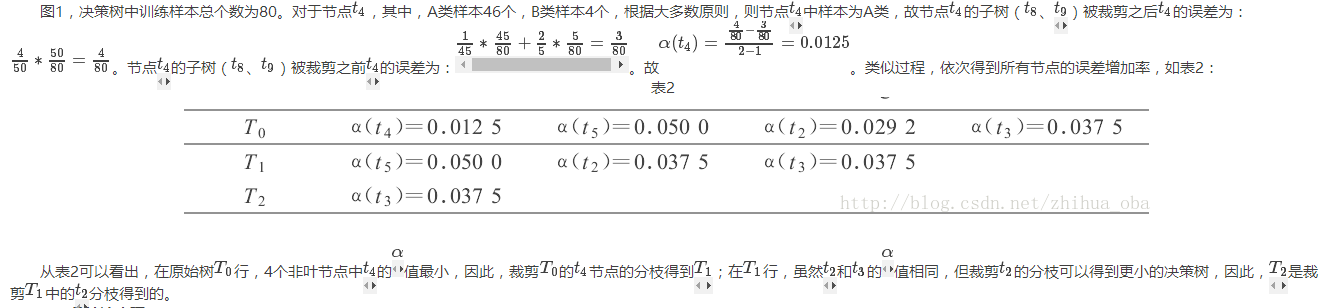

例如:圖1中ti表示決策樹中第i個節點,A、B表示訓練集中的兩個類別,A、B之後的數據表示落入該節點分別屬於A類、B類的樣本個數。

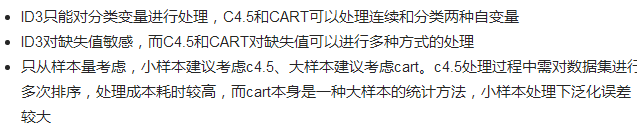

5,決策樹算法比較

6,總結

個人認為算法通過使用訓練集構建一個決策樹後,獲得一系列的規則,輸入測試集後,按照規則獲取到葉節點,然後根據葉節點最大占有比的那個類為該測試集所屬的類,從而達到分類效果

參考網址:

1,cart例子

2,剪枝例子

3,決策樹比較

統計學習方法五 決策樹分類