Scrapy簡單入門及實例講解

原文地址:https://www.cnblogs.com/kongzhagen/p/6549053.html

github地址:https://github.com/zhu-xb/scrapy-movie-demo

Scrapy是一個為了爬取網站數據,提取結構性數據而編寫的應用框架。 其可以應用在數據挖掘,信息處理或存儲歷史數據等一系列的程序中。其最初是為了頁面抓取 (更確切來說, 網絡抓取 )所設計的, 也可以應用在獲取API所返回的數據(例如 Amazon Associates Web Services ) 或者通用的網絡爬蟲。Scrapy用途廣泛,可以用於數據挖掘、監測和自動化測試。

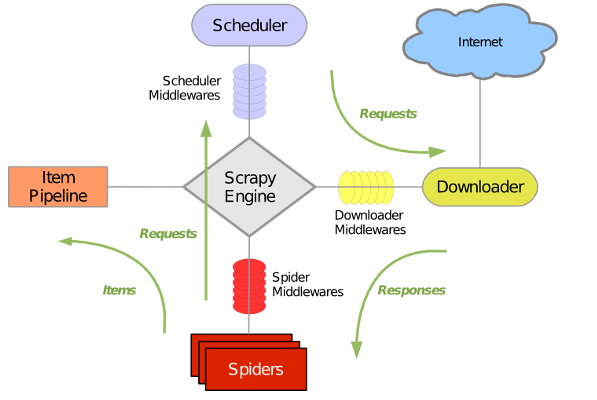

Scrapy 使用了 Twisted異步網絡庫來處理網絡通訊。整體架構大致如下

Scrapy主要包括了以下組件:

- 引擎(Scrapy) 用來處理整個系統的數據流, 觸發事務(框架核心)

- 調度器(Scheduler) 用來接受引擎發過來的請求, 壓入隊列中, 並在引擎再次請求的時候返回. 可以想像成一個URL(抓取網頁的網址或者說是鏈接)的優先隊列, 由它來決定下一個要抓取的網址是什麽, 同時去除重復的網址

- 下載器(Downloader) 用於下載網頁內容, 並將網頁內容返回給蜘蛛(Scrapy下載器是建立在twisted這個高效的異步模型上的)

- 爬蟲(Spiders) 爬蟲是主要幹活的, 用於從特定的網頁中提取自己需要的信息, 即所謂的實體(Item)。用戶也可以從中提取出鏈接,讓Scrapy繼續抓取下一個頁面

- 項目管道(Pipeline) 負責處理爬蟲從網頁中抽取的實體,主要的功能是持久化實體、驗證實體的有效性、清除不需要的信息。當頁面被爬蟲解析後,將被發送到項目管道,並經過幾個特定的次序處理數據。

- 下載器中間件(Downloader Middlewares) 位於Scrapy引擎和下載器之間的框架,主要是處理Scrapy引擎與下載器之間的請求及響應。

- 爬蟲中間件(Spider Middlewares) 介於Scrapy引擎和爬蟲之間的框架,主要工作是處理蜘蛛的響應輸入和請求輸出。

- 調度中間件(Scheduler Middewares) 介於Scrapy引擎和調度之間的中間件,從Scrapy引擎發送到調度的請求和響應。

Scrapy運行流程大概如下:

- 引擎從調度器中取出一個鏈接(URL)用於接下來的抓取

- 引擎把URL封裝成一個請求(Request)傳給下載器

- 下載器把資源下載下來,並封裝成應答包(Response)

- 爬蟲解析Response

- 解析出實體(Item),則交給實體管道進行進一步的處理

- 解析出的是鏈接(URL),則把URL交給調度器等待抓取

一、安裝

pip install Scrapy

註:windows平臺需要依賴pywin32,請根據自己系統32/64位選擇下載安裝,https://sourceforge.net/projects/pywin32/

二、爬蟲舉例

入門篇:美劇天堂前100最新(http://www.meijutt.com/new100.html)

1、創建工程

scrapy startproject movie

2、創建爬蟲程序

cd movie

scrapy genspider meiju meijutt.com

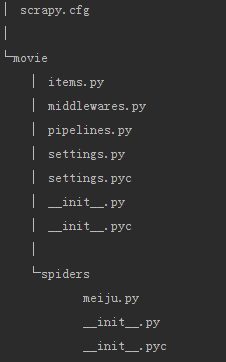

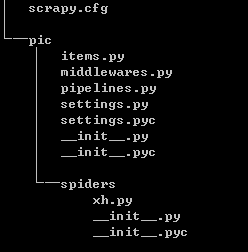

3、自動創建目錄及文件

4、文件說明:

- scrapy.cfg 項目的配置信息,主要為Scrapy命令行工具提供一個基礎的配置信息。(真正爬蟲相關的配置信息在settings.py文件中)

- items.py 設置數據存儲模板,用於結構化數據,如:Django的Model

- pipelines 數據處理行為,如:一般結構化的數據持久化

- settings.py 配置文件,如:遞歸的層數、並發數,延遲下載等

- spiders 爬蟲目錄,如:創建文件,編寫爬蟲規則

註意:一般創建爬蟲文件時,以網站域名命名

5、設置數據存儲模板

items.py

import scrapy class MovieItem(scrapy.Item): # define the fields for your item here like: name = scrapy.Field()

6、編寫爬蟲

meiju.py

# -*- coding: utf-8 -*- import scrapy from movie.items import MovieItem class MeijuSpider(scrapy.Spider): name = ‘meiju‘ allowed_domains = [‘meijutt.com‘] start_urls = [‘http://meijutt.com/‘] def parse(self, response): movies = response.xpath(‘//div[@class="list_2"]/ul/li‘) for each_movie in movies: item = MovieItem() item[‘name‘] = each_movie.xpath(‘./a/@title‘).extract()[0] yield item

7、設置配置文件

settings.py增加如下內容

ITEM_PIPELINES = {‘movie.pipelines.MoviePipeline‘:100}

8、編寫數據處理腳本

pipelines.py

class MoviePipeline(object): def process_item(self, item, spider): with open("my_meiju.txt",‘a‘) as fp: fp.write(item[‘name‘].encode("utf8") + ‘\n‘)

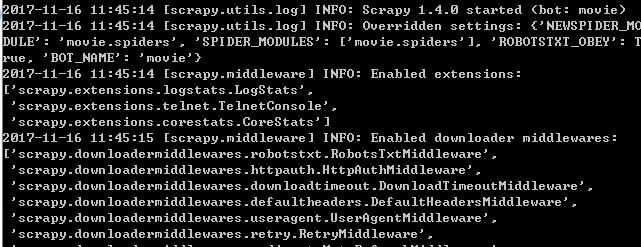

9、執行爬蟲

scrapy crawl meiju --nolog

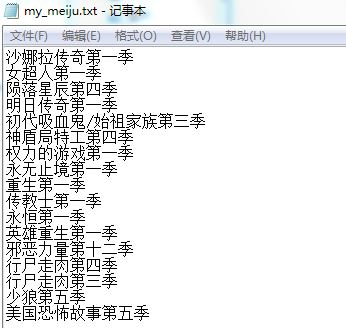

10、結果

進階篇:爬取校花網(http://www.xiaohuar.com/list-1-1.html)

1、創建一個工程

?| 1 |

scrapy startproject pic

|

2、創建爬蟲程序

?| 1 2 |

cd pic

scrapy genspider xh xiaohuar.com

|

3、自動創建目錄及文件

4、文件說明:

- scrapy.cfg 項目的配置信息,主要為Scrapy命令行工具提供一個基礎的配置信息。(真正爬蟲相關的配置信息在settings.py文件中)

- items.py 設置數據存儲模板,用於結構化數據,如:Django的Model

- pipelines 數據處理行為,如:一般結構化的數據持久化

- settings.py 配置文件,如:遞歸的層數、並發數,延遲下載等

- spiders 爬蟲目錄,如:創建文件,編寫爬蟲規則

註意:一般創建爬蟲文件時,以網站域名命名

5、設置數據存儲模板

?| 1 2 3 4 5 6 7 8 |

import scrapy

class PicItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

addr = scrapy.Field()

name = scrapy.Field()

|

6、編寫爬蟲

?

| 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 |

# -*- coding: utf-8 -*-

import scrapy

import os

# 導入item中結構化數據模板

from pic.items import PicItem

class XhSpider(scrapy.Spider):

# 爬蟲名稱,唯一

name = "xh"

# 允許訪問的域

allowed_domains = ["xiaohuar.com"]

# 初始URL

start_urls = [‘http://www.xiaohuar.com/list-1-1.html‘]

def parse(self, response):

# 獲取所有圖片的a標簽

allPics = response.xpath(‘//div[@class="img"]/a‘)

for pic in allPics:

# 分別處理每個圖片,取出名稱及地址

item = PicItem()

name = pic.xpath(‘./img/@alt‘).extract()[0]

addr = pic.xpath(‘./img/@src‘).extract()[0]

addr = ‘http://www.xiaohuar.com‘+addr

item[‘name‘] = name

item[‘addr‘] = addr

# 返回爬取到的數據

yield item

|

7、設置配置文件

?| 1 2 |

# 設置處理返回數據的類及執行優先級

ITEM_PIPELINES = {‘pic.pipelines.PicPipeline‘:100}

|

8、編寫數據處理腳本

?| 1 2 3 4 5 6 7 8 9 10 11 |

import urllib2

import os

class PicPipeline(object):

def process_item(self, item, spider):

headers = {‘User-Agent‘: ‘Mozilla/5.0 (Windows NT 6.1; WOW64; rv:52.0) Gecko/20100101 Firefox/52.0‘}

req = urllib2.Request(url=item[‘addr‘],headers=headers)

res = urllib2.urlopen(req)

file_name = os.path.join(r‘D:\my\down_pic‘,item[‘name‘]+‘.jpg‘)

with open(file_name,‘wb‘) as fp:

fp.write(res.read())

|

9、執行爬蟲

?| 1 2 |

cd pic

scrapy crawl xh --nolog

|

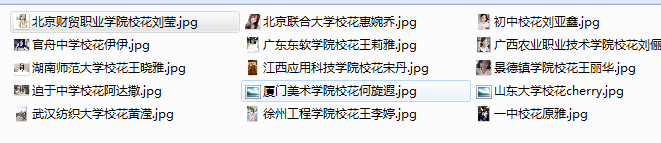

結果:

終極篇:我想要所有校花圖

註明:基於進階篇再修改為終極篇

# xh.py

?| 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 |

# -*- coding: utf-8 -*-

import scrapy

import os

from scrapy.http import Request

# 導入item中結構化數據模板

from pic.items import PicItem

class XhSpider(scrapy.Spider):

# 爬蟲名稱,唯一

name = "xh"

# 允許訪問的域

allowed_domains = ["xiaohuar.com"]

# 初始URL

start_urls = [‘http://www.xiaohuar.com/hua/‘]

# 設置一個空集合

url_set = set()

def parse(self, response):

# 如果圖片地址以http://www.xiaohuar.com/list-開頭,我才取其名字及地址信息

if response.url.startswith("http://www.xiaohuar.com/list-"):

allPics = response.xpath(‘//div[@class="img"]/a‘)

for pic in allPics:

# 分別處理每個圖片,取出名稱及地址

item = PicItem()

name = pic.xpath(‘./img/@alt‘).extract()[0]

addr = pic.xpath(‘./img/@src‘).extract()[0]

addr = ‘http://www.xiaohuar.com‘+addr

item[‘name‘] = name

item[‘addr‘] = addr

# 返回爬取到的信息

yield item

# 獲取所有的地址鏈接

urls = response.xpath("//a/@href").extract()

for url in urls:

# 如果地址以http://www.xiaohuar.com/list-開頭且不在集合中,則獲取其信息

if url.startswith("http://www.xiaohuar.com/list-"):

if url in XhSpider.url_set:

pass

else:

XhSpider.url_set.add(url)

# 回調函數默認為parse,也可以通過from scrapy.http import Request來指定回調函數

# from scrapy.http import Request

# Request(url,callback=self.parse)

yield self.make_requests_from_url(url)

else:

pass

|

Scrapy簡單入門及實例講解