第八次作業-----#聚類--K均值演算法:自主實現與sklearn.cluster.KMeans呼叫

阿新 • • 發佈:2018-11-06

1. 用python實現K均值演算法

K-means是一個反覆迭代的過程,演算法分為四個步驟:

(x,k,y)

1) 選取資料空間中的K個物件作為初始中心,每個物件代表一個聚類中心;

def initcenter(x, k): kc

2) 對於樣本中的資料物件,根據它們與這些聚類中心的歐氏距離,按距離最近的準則將它們分到距離它們最近的聚類中心(最相似)所對應的類;

def nearest(kc, x[i]): j

def xclassify(x, y, kc):y[i]=j

3) 更新聚類中心:將每個類別中所有物件所對應的均值作為該類別的聚類中心,計算目標函式的值;

def kcmean(x, y, kc, k):

4) 判斷聚類中心和目標函式的值是否發生改變,若不變,則輸出結果,若改變,則返回2)。

while flag:

y = xclassify(x, y, kc)

kc, flag = kcmean(x, y, kc, k)

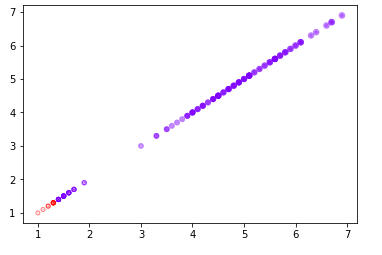

2. 鳶尾花花瓣長度資料做聚類並用散點圖顯示。

3. 用sklearn.cluster.KMeans,鳶尾花花瓣長度資料做聚類並用散點圖顯示.

4. 鳶尾花完整資料做聚類並用散點圖顯示.

參考官方文件: http://scikit-learn.org/stable/modules/generated/sklearn.cluster.KMeans.html#sklearn.cluster.KMeans

1.初始化

from sklearn.datasets import load_iris

iris = load_iris()

iris.keys()

data = iris['data']

data

2.分類

iris.target

3.初始聚類中心陣列

def initcenter(x,k):

return x[:k]

4.陣列中的值,與聚類中心最新距離所在類別的索引號

def nearest(kc,i): d = (abs(kc - i)) w = np.where(d == np.min(d)) return w[0][0]

5.對陣列的每個組分類

def xclassify(x,y,kc):

for i in range(x.shape[0]):

y[i]=nearest(kc,x[i])

return y

6.更新聚類中心,將每個類別中所有物件所對應的均值作為該類別的聚類中心,計算目標函式的值

def kcmean(x,y,kc,k):

l = list(kc)

flag = False

for c in range(k):

m = np.where(y == c)

print(c,x)

n = np.mean(x[m])

print(kc[c],n)

if l[c] != n:

l[c] = n

flag = True

print(l,flag)

return(np.array(l),flag)

7.判斷聚類中心和目標函式的值是否發生改變,若不變,則輸出結果,若改變,則返回2

flag = True

# print(x,y,kc,flag)

while flag:

y = xclassify(x,y,kc)

kc,flag = kcmean(x,y,kc,k)

print(y,kc)

print(x,y)

8.初始化iris

from sklearn.datasets import load_iris

iris = load_iris()

datas = iris.data

iris_length = datas[:,2]

9.用鳶尾花花瓣作分析並用散點圖顯示

import matplotlib.pyplot as plt

import numpy as np

data=load_iris()

data_length=data['data'][:,2] # 取出鳶尾花花瓣的長度

x=data_length

y=np.zeros(x.shape[0])

kc = start_center(x,3)

flag=True

while flag:

y=xclassify(x,y,kc)

kc,flag=kcmean(x,y,kc,k)

print(y,kc)

10.用散點圖來展示 plt.scatter(x,x,s=x,c=y,cmap='rainbow',alpha=0.5,linewidths=4) plt.show()