python opencv SIFT,獲取特徵點的座標位置

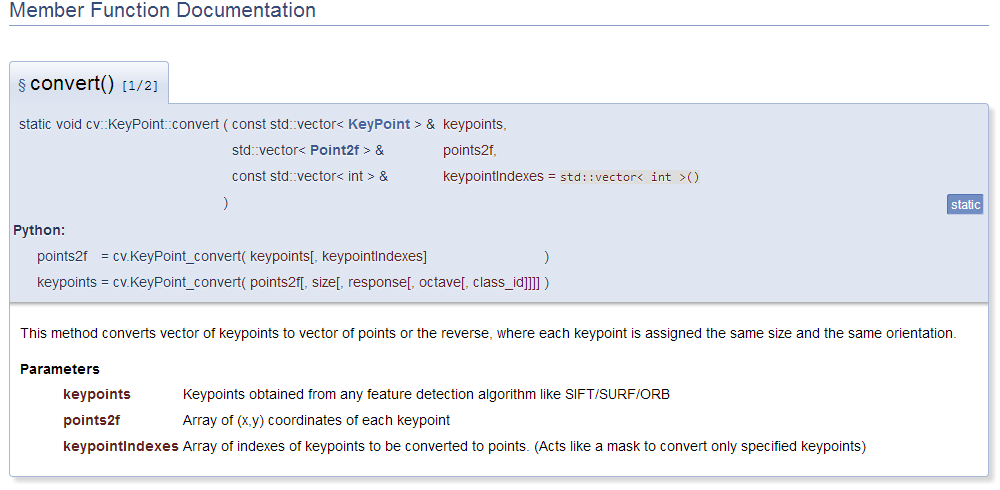

參考地址:https://docs.opencv.org/3.4/d2/d29/classcv_1_1KeyPoint.html

測試程式碼:

import cv2 import numpy as np img = cv2.imread('4.jpg',cv2.IMREAD_COLOR) gray = cv2.cvtColor(img,cv2.COLOR_BGR2GRAY) # cv2.imshow('origin',img) #SIFT detector = cv2.xfeatures2d.SIFT_create() keypoints = detector.detect(gray,None) cv2.drawKeypoints(gray,keypoints,img) points2f= cv2.KeyPoint_convert(keypoints) #將KeyPoint格式資料中的xy座標提取出來。 print(keypoints) print(points2f) cv2.imshow('test',img) cv2.waitKey(0) cv2.destroyAllWindows()

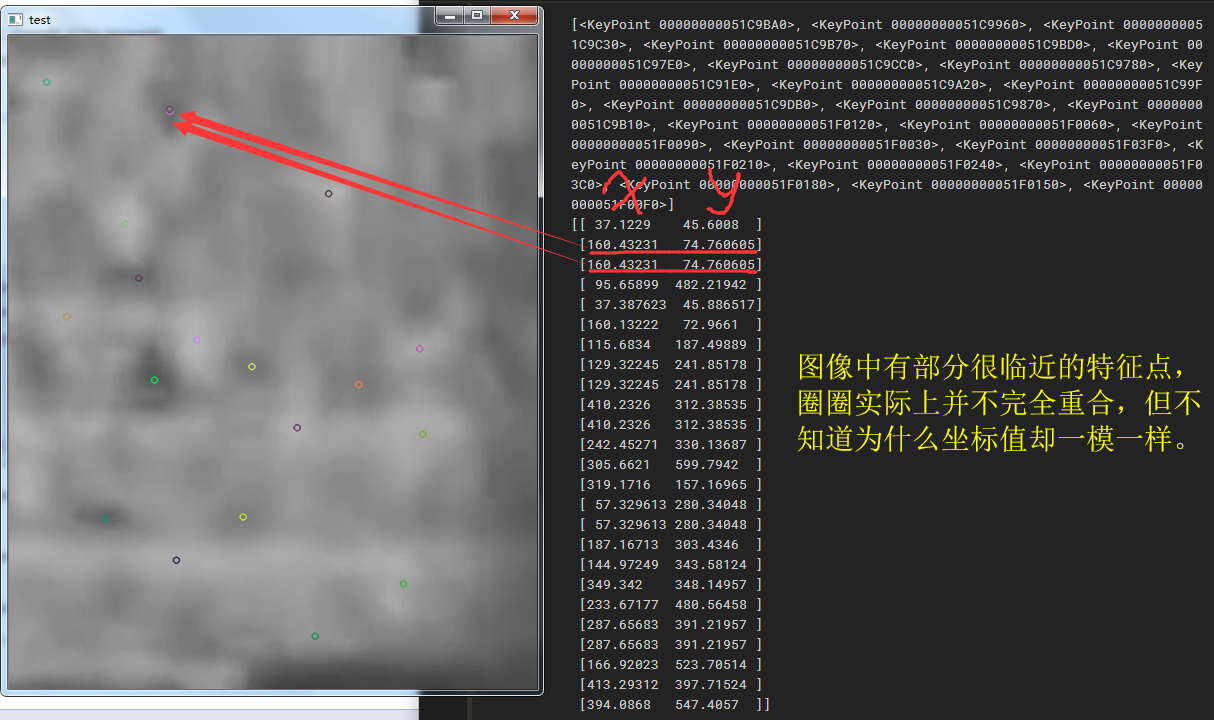

測試效果:

相關推薦

python opencv SIFT,獲取特徵點的座標位置

參考地址:https://docs.opencv.org/3.4/d2/d29/classcv_1_1KeyPoint.html 測試程式碼: import cv2 import numpy as np img = cv2.imread('4.jpg',cv2.IM

OpenCV中feature2D學習——SURF和SIFT運算元實現特徵點檢測

概述 在opencv的features2d中實現了SIFT和SURF演算法,可以用於影象特徵點的自動檢測。具體實現是採用SurfFeatureDetector/SiftFeatureDetector類的detect函式檢測SURF/SIFT特徵的關鍵點,並儲存

Python-OpenCV:sift(),SURF() 特徵提取

1、SIFT、SURF SURF特徵是SIFT特徵的一個更快的特徵提取版,詳細請參閱文獻[1]。以下將展示python open cv 的 SURF 的特徵提取命令,及繪製命令。 python opecv-3.0 參考這裡 2、特徵提取 # -*-

Android 獲取觸控點座標,判斷滑動方向,滑動距離

activity 或 fragment 實現介面 View.OnTouchListener 如:public class MyFragment extends Fragment implements View.OnTouchListener{ 重寫實現方法

python+opencv+PIL,在圖片和視訊中寫入中文(漢字)

原部落格地址:https://blog.csdn.net/wyx100/article/details/80412101 效果 程式碼 #!/usr/bin/env python # -*- coding: utf-8 -*- from PIL import Ima

微信分享,獲取分享點選事件,登入後才可以分享

1.登入微信公眾平臺 2.獲取開發者ID(AppID),開發者密碼(AppSecret) 3.配置js安全域名,下載.txt檔案放到專案跟目錄 4.控制器 <?php namespace M\Controller; use Think\Controller; class

JavaScript 獲取滑鼠點選位置座標

謝謝博主對我學習上的幫助 在一些DOM操作中我們經常會跟元素的位置打交道,滑鼠互動式一個經常用到的方面,令人失望的是不同的瀏覽器下會有不同的結果甚至是有的瀏覽器下沒結果,這篇文章就上滑鼠點選位置座標獲取做一些簡單的總結,沒特殊宣告程式碼在IE8,FireFox,Chro

【OpenCV入門教程之十七】OpenCV重對映 SURF特徵點檢測合輯

本篇文章中,我們一起探討了OpenCV中重對映和SURF特徵點檢測相關的知識點,主要一起了解OpenCV中重對映相關的函式remap,SURF演算法在OpenCV中的體現與應用。此博文一共有三個配套的麻雀雖小但五臟俱全的示例程式,其經過淺墨詳細註釋過的程式碼都在文中貼出,且文章

JS 獲取螢幕點選位置座標 並 新增icon

.tips { position: absolute; z-index: 99; background: rgba(0,0,0,0.5); color: #fff; } (function ($) { var $selectedViewList = $

從傳統方法到深度學習,人臉特徵點定位方法綜述

人臉關鍵點檢測是人臉識別和分析領域中的關鍵一步,它是諸如自動人臉識別、表情分析、三維人臉重建及三維動畫等其它人臉相關問題的前提和突破口。近些年來,深度學習方法由於其自動學習及持續學習能力,已被成功應用到了影象識別與分析、語音識別和自然語言處理等很多領域,且在這些方面都帶來

Android開發——後臺獲取使用者點選位置座標(可獲取使用者支付寶密碼)

1. getevent命令我們首先是根據adb shell getevent命令獲取到被點選位置的資訊。這裡要說明的是,不同的手機手機獲得的點選輸出是不一樣的。以我的真機為例,輸出如下/dev/inpu

openCV-人臉檢測與特徵點識別

綜述 最近在做計算機視覺的一些基礎訓練,用opencv做了做人臉檢測。 注意opencv的人臉檢測不是基於深度學習的。後期我還做了用tensorflow搞人臉識別的demo,到時候再發一下。 環境 mac os pycharm 使用opencv3

Opencv Sift和Surf特徵實現影象無縫拼接生成全景影象

Sift和Surf演算法實現兩幅影象拼接的過程是一樣的,主要分為4大部分: 1. 特徵點提取和描述2. 特徵點配對,找到兩幅影象中匹配點的位置3. 通過配對點,生成變換矩陣,並對影象1應用變換矩陣生成對影象2的對映影象4. 影象2拼接到對映影象上,完成拼接 過程1、2

滑動螢幕來獲取當前的座標位置

package com.bawei.myapplication.gesture; import android.content.Context; import android.graphics.Canvas; import android.graphics.Color; import a

JS-設定/獲取滑鼠游標所在位置;獲取滑鼠點選位置

滑鼠游標所在位置 // 設定滑鼠游標所在位置. function setCaretPosition(elem, pos){//設定游標位置函式 if(elem.setSelectionRange) { elem.focus(); elem.setS

【opencv】特徵點檢測方法--GFTT,SIFT,FAST,SURF

一. 特徵點檢測方法總結 二.關於特徵點分析對比的相關論文 1. 有關特徵點:Shi-Tmoasi,SIFT,SURF 方法:基於opencv,通過RGB分解,比較特徵點的個數和魯棒性 2. 有關特徵點:FAST 方法:主要是

OpenCV計算機視覺學習(13)——影象特徵點檢測(Harris角點檢測,sift演算法)

如果需要處理的原圖及程式碼,請移步小編的GitHub地址 傳送門:請點選我 如果點選有誤:https://github.com/LeBron-Jian/ComputerVisionPractice 前言 特徵點檢測廣泛應用到目標匹配,目標跟蹤,三維重建等應用中,在進行目標建模時會對影象進行目標特徵

unity3d滑鼠點選,獲取世界座標

unity中有關於滑鼠位置的函式,Input.mousePosition。但不得不說,這個函式不到位,可以用一個print函式輸出一下這個座標會發現,只有X,Y值在改變,Z值沒有發生變化,並且在螢幕的左下角固定為(0,0,0),檢視文件後發現,文件上是這麼寫的。 The current mo

Python OpenCV _3形態學處理(腐蝕膨脹,開閉運算,以及利用形態學進行邊緣角點檢測)

Python OpenCV這個初級影象處理系列是參考他人的文章寫的,有些地方做了一些改動,沒有太多理論,側重程式碼實現,主要目的是將這些基本操作程式碼系統地梳理一遍,也是為了以後能快速查詢。 此係列原始碼在我的GitHub裡:https://github.com/yeyujujishou19/P

opencv學習筆記二十九:SIFT特徵點檢測與匹配

SIFT(Scale-invariant feature transform)是一種檢測區域性特徵的演算法,該演算法通過求一幅圖中的特徵點(interest points,or corner points)及其有關scale 和 orientation 的描述子得到特徵並進行