python 爬蟲總結

阿新 • • 發佈:2018-11-09

一,爬蟲是什麼

爬蟲:一段自動抓取網際網路資訊的程式,從網際網路上抓取對於我們有價值的資訊。

二,爬蟲的基本構架

爬蟲分為五個基本構架:

- 排程器:相當於一臺電腦的CPU,主要負責排程URL管理器、下載器、解析器之間的協調工作。

- URL管理器:包括待爬取的URL地址和已爬取的URL地址,防止重複抓取URL和迴圈抓取URL,實現URL管理器主要用三種方式,通過記憶體、資料庫、快取資料庫來實現。

- 網頁下載器:通過傳入一個URL地址來下載網頁,將網頁轉換成一個字串,網頁下載器有urllib2(Python官方基礎模組)包括需要登入、代理、和cookie,requests(第三方包)

- 網頁解析器:將一個網頁字串進行解析,可以按照我們的要求來提取出我們有用的資訊,也可以根據DOM樹的解析方式來解析。網頁解析器有正則表示式(直觀,將網頁轉成字串通過模糊匹配的方式來提取有價值的資訊,當文件比較複雜的時候,該方法提取資料的時候就會非常的困難)、html.parser(Python自帶的)、beautifulsoup(第三方外掛,可以使用Python自帶的html.parser進行解析,也可以使用lxml進行解析,相對於其他幾種來說要強大一些)、lxml(第三方外掛,可以解析 xml 和 HTML),html.parser 和 beautifulsoup 以及 lxml 都是以 DOM 樹的方式進行解析的。

- 資料儲存器:用於將HTML解析器解析出來的資料通過檔案或者資料庫形式儲存起來

三,瀏覽網頁時經歷的過程

瀏覽器 (請求request)-> 輸入URL地址(http://www.baidu.com/index.html file:///mnt ftp://172.25.254.250/pub

-> http協議確定, www.baidu.com訪問的域名確定 -> DNS伺服器解析到IP地址

-> 確定要訪問的網頁內容 -> 將獲取到的頁面內容返回給瀏覽器(響應過程)

四,爬取網頁

1).基本方法

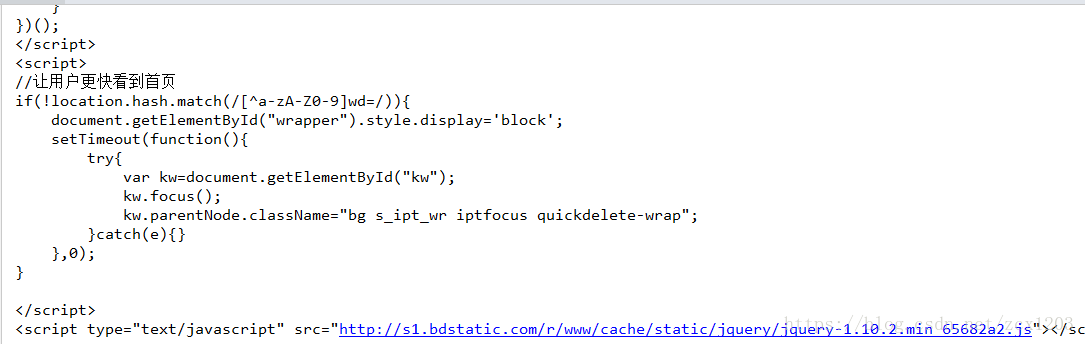

from urllib import request from urllib.error import URLError try: response = request.urlopen('http://www.baidu.com') content = response.read().decode('utf-8') print(content) except URLError as e: print("訪問超時",e.reason)

2).使用Reauest物件(可以新增其他的頭部資訊)

from urllib import request

from urllib.error import URLError

url = 'http://www.cbrc.gov.cn/chinese/jrjg/index.html'

headers = {'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64; rv:62.0) Gecko/20100101 Firefox/62.0'}

try:

# 例項化request物件, 可以自定義請求的頭部資訊;

req = request.Request(url, headers=headers)

# urlopen不僅可以傳遞url地址, 也可以傳遞request物件;

content = request.urlopen(req).read().decode('utf-8')

print(content)

except URLError as e:

print(e.reason)

else:

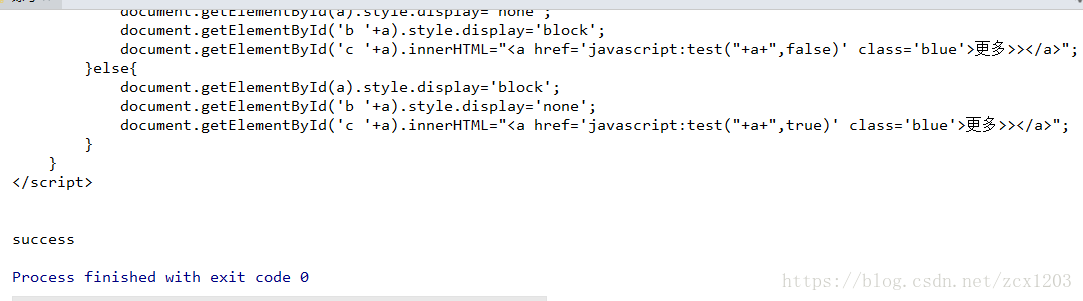

print("success")

** 後續新增頭部資訊

from urllib import request

from urllib.error import URLError

url = 'http://www.cbrc.gov.cn/chinese/jrjg/index.html'

user_agent = ':'Mozilla/5.0 (Windows NT 10.0; Win64; x64; rv:62.0) Gecko/20100101 Firefox/62.0''

try:

# 例項化request物件, 可以自定義請求的頭部資訊;

req = request.Request(url)

req.add_header('User-Agent',user_agent)

# urlopen不僅可以傳遞url地址, 也可以傳遞request物件;

content = request.urlopen(req).read().decode('utf-8')

print(content)

except URLError as e:

print(e.reason)

else:

print("success")

反爬蟲策略

1) 模擬瀏覽器

1.Android

Mozilla/5.0 (Linux; Android 4.1.1; Nexus 7 Build/JRO03D) AppleWebKit/535.19 (KHTML, like Gecko) Chrome/18.0.1025.166 Safari/535.19

Mozilla/5.0 (Linux; U; Android 4.0.4; en-gb; GT-I9300 Build/IMM76D) AppleWebKit/534.30 (KHTML, like Gecko) Version/4.0 Mobile Safari/534.30

Mozilla/5.0 (Linux; U; Android 2.2; en-gb; GT-P1000 Build/FROYO) AppleWebKit/533.1 (KHTML, like Gecko) Version/4.0 Mobile Safari/533.1

2.Firefox

Mozilla/5.0 (Windows NT 6.2; WOW64; rv:21.0) Gecko/20100101 Firefox/21.0

Mozilla/5.0 (Android; Mobile; rv:14.0) Gecko/14.0 Firefox/14.0

3.Google Chrome

Mozilla/5.0 (Windows NT 6.2; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/27.0.1453.94 Safari/537.36

Mozilla/5.0 (Linux; Android 4.0.4; Galaxy Nexus Build/IMM76B) AppleWebKit/535.19 (KHTML, like Gecko) Chrome/18.0.1025.133 Mobile Safari/535.19

4.iOS

Mozilla/5.0 (iPad; CPU OS 5_0 like Mac OS X) AppleWebKit/534.46 (KHTML, like Gecko) Version/5.1 Mobile/9A334 Safari/7534.48.3

- IP代理

當抓取網站時, 程式的執行速度很快, 如果通過爬蟲去訪問, 一個固定的ip訪問頻率很高,

網站如果做反爬蟲策略, 那麼就會封掉ip;

如何解決?

- 設定延遲;time.sleep(random.randint(1,5))

- 使用IP代理, 讓其他IP代替你的IP訪問;

如何獲取代理IP?

http://www.xicidaili.com/

如何實現步驟?

1). 呼叫urllib.request.ProxyHandler(proxies=None);傳入一個代理,這個代理是一個字典,字典的key依賴於代理伺服器能夠接收的型別,一般是http或者是https,值是 'ip:port'(免費代理伺服器可以選擇http://www.xicidaili.com/wt/)

2). 使用上一步建立的Handler,以及request.build_opener建立一個opener

3).安裝不同的opener物件作為urlopen()使用的全域性opener。

4). 代理IP的選擇

from urllib import request

from urllib.error import URLError

# url = 'https://www.whatismyip.com/'

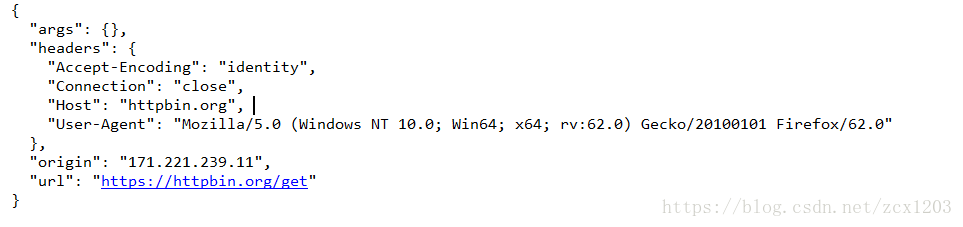

url = 'https://httpbin.org/get'

proxy = {'https':'171.221.239.11:808', 'http':'218.14.115.211:3128'}

user_agent = 'Mozilla/5.0 (X11; Linux x86_64; rv:45.0) Gecko/20100101 Firefox/45.0'

# 1).呼叫urllib.request.ProxyHandler(proxies=None);傳入一個代理,這個代理是一個字典,字典的key依賴於代理伺服器能夠接收的型別,一般是http或者是https,值是 'ip:port'(免費代理伺服器可以選擇http://www.xicidaili.com/wt/)

handler = request.ProxyHandler(proxy)

# 2).呼叫Opener - -- 使用上一步建立的Handler,以及request.build_opener建立一個opener

opener = request.build_opener(handler)

# 偽裝瀏覽器

opener.addheaders = [('User-Agent',user_agent)]

# 3).安裝不同的opener物件作為urlopen()使用的全域性opener。

request.install_opener(opener)

# 4).代理IP的選擇

response = request.urlopen(url)

content = response.read().decode('utf-8')

print(content)