hadoop偽分散式叢集的搭建

叢集配置:

jdk1.8.0_161

hadoop-2.6.1

linux系統環境:Centos6.5

建立普通使用者 dummy

Hadoop偽分散式叢集搭建:

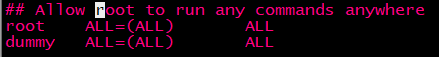

為普通使用者新增sudo許可權:

設定之前必須得安裝sudo,先su 輸入密碼進入root使用者,執行 yum install sudo

安裝完後修改sudo配置檔案 vi /etc/sudoers

進入配置檔案,輸入/root 查詢root 按N下一個,直到找到

原本只有一行的,下面是自己複製上面的,改一下使用者名稱,新增完成按Esc 再輸入:wq儲存退出

注意:修改只讀檔案時,可以先 chmod u+w 只讀檔名 修改檔案的許可權(u代表使用者,+w代表增加可寫),修改完之後再 chmod u-w 只讀檔名 還原許可權

伺服器網路設定:NAT模式

SecureCRT遠端連線:

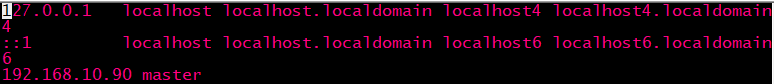

域名設定: vi /etc/hosts

主機名設定:

root身份:vi /etc/sysconfig/network

普通使用者身份:sudo vi /etc/sysconfig/network

重啟伺服器init 6

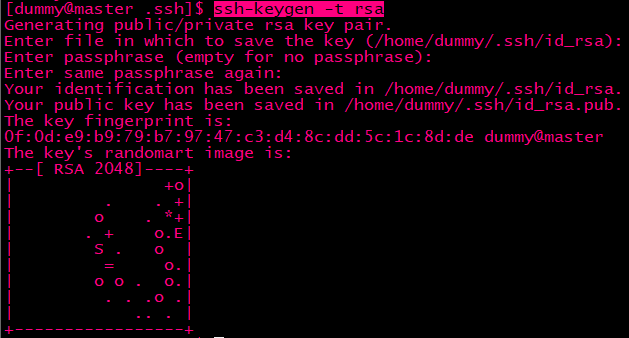

SSH免登入配置:

如果沒有就建立.ssh:mkdir .ssh

cd .ssh進入.ssh

rm -rf *刪除所有檔案

輸入ssh-keygen -t rsa,敲三次回車

然後ssh-copy-id master 輸入yes 再輸入密碼

關閉防火牆:

進入root,chkconfig iptables --list 檢視防火牆

chkconfig iptables off 關閉防火牆(每臺主機都關掉)

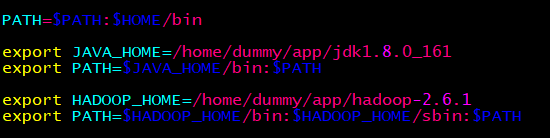

修改環境變數:

vi ~/.bash_profile

最後

修改配置檔案:

進入hadoop的安裝目錄

偽分散式的hadoop叢集

1、編輯etc/hadoop/core-site.xml <configuration>

<property>

<!-- 指定HDFS中NameNode的地址 -->

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<!-- 指定hadoop臨時目錄 -->

<property>

<name>hadoop.tmp.dir </name>

<value>/home/dummy/app/hadoop-2.6.1/hdpdata</value>

</property> </configuration>

2、編輯etc/hadoop/hdfs-site.xml

<configuration>

<!-- 指定HDFS副本的數量,預設為3 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

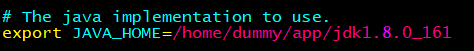

</configuration> 3、編輯etc/hadoop/hadoop-env.shl

修改JAVA_HOME的路徑

第一次啟動hdfs,首要進行格式化處理,在/bin目錄下

hdfs namenode -format

啟動hdfs,首先啟動namenode,/sbin目錄下

hadoop-daemon.sh start namenode

再啟動datanode /sbin目錄下

hadoop-daemon.sh start datanode

通過jps,檢視程序,是否存在namenode和datanode的程序