基於TP-GAN的側臉人像恢復

C新智元報道

作者:聞菲

【新智元導讀】中科院自動化所(CASIA),中科院大學和南昌大學的一項合作研究,提出了雙路徑 GAN(TP-GAN),通過單一側面照片合成正面人臉影象,取得了當前最好的結果。研究人員提出了一個像人類一樣能夠考慮整體和區域性資訊的 GAN 結構,合成的影象非常逼真且很好地保留了身份特徵,並且可以處理大量不同姿勢的照片。研究人員指出,這些合成的影象有可能用於人臉分析的任務。

首先,讓我們來看上面這張圖,中間一欄是側面 90°照片,你能看出計算機根據側面照合成的正臉是左邊一欄,還是右邊一欄嗎?

答案將在文末揭曉。

作為補充資訊,下面這張圖全部是計算機合成的,展示了從90°、75°和45°的輪廓的合成正面人臉檢視。

根據側面照片合成正面人臉一直是個難題,現在,由中科院自動化所(CASIA)、中科院大學和南昌大學的 Rui Huang、Shu Zhang、Tianyu Li、Ran He 合作的一項研究,首次解決了這一個問題,他們受人類視覺識別過程啟發,結合對抗生成網路(GAN)的強大效能,提出了一個雙路徑 GAN(TP-GAN),能夠在關注整體結構的同時,處理人臉面部細節,在不同的角度、光照條件都取得了很好的結果。不僅如此,這種方法還能夠處理大量不同姿勢的照片。

作者表示,他們這項工作是使用合成的人臉影象進行影象識別任務的首次有效嘗試。

作者在論文中寫道,他們的這項工作主要貢獻在於三個方面:

1)提出了一個像人類一樣能夠考慮整體和區域性資訊的 GAN 結構,能夠根據單一的影象合成正面人臉檢視,合成的影象非常逼真且很好地保留了身份特徵,而且可以應對大量不同的姿勢。

2)將從資料分佈(對抗訓練)得來的先驗知識,和人臉領域知識(對稱性、身份保留損失)結合起來,將從三維物體投射到二維影象空間時固有的缺失資訊精確地恢復了出來。

3)展示了一個“通過生成進行識別”(recognition via generation)的框架的可能性,並且在大量不同姿勢下取得了目前最好的識別結果。

真實應用場景中,不同姿勢的識別沒有很好的解決方案

雖然計算機識別影象已經在多個基準資料集中超越了人類,但真實應用場景中,對於不同姿勢的識別問題仍然沒有得到很好地解決。

現有方法可以分為兩類,一類是採用手繪的(hand-crafted)特徵或學習不同姿態的特徵,另一類則是致力於在大量不同姿態的人臉中獲取(recover)一個正面人臉檢視,然後用這個檢視進行人臉識別。

但是,第一類方法由於要在不變和可識別之間做出權衡,往往無法有效處理大量不同的姿勢。

第二類方法,早期的嘗試是先將二維影象與通用或有確切身份的3D模型對齊,然後利用三維幾何變換渲染正面人臉檢視。但是,這種方法遇到大量不同姿勢的影象時,紋理損失嚴重,效能也不好。

近來,有研究者提出了由資料驅動的深度學習方法,讓系統在學習估計正面檢視的同時,分辨身份和姿勢表徵。雖然結果喜人,但合成的影象在細節方面有所欠缺,再一次地,這種方法也無法很好應對大量不同的姿勢,因此合成的影象也無法用於法醫取證或屬性估計。

更重要的是,從優化的角度看,從觀察到的不完全側面臉部恢復正面檢視,本身就是一個不合理而且也沒有很好定義的問題。恢復的影象的質量嚴重依賴於訓練過程中的先驗或約束條件。

以往的方法通常採用配對監督學習的方式(pairwise supervision),極少在訓練過程中引入約束條件(constraints),因此,才導致合成的影象模糊不清。

TP-GAN:受人類視覺啟發,結合 GAN 強大的效能

當人類在進行視覺合成的時候,我們首先是通過觀察到的側臉,在以往的經驗/知識基礎上,推測出整張臉的結構(或草圖)。然後,我們會將注意力轉向臉部的細節,比如眼睛、鼻子、嘴脣,將這些細節在剛才那張草圖上“填滿”。

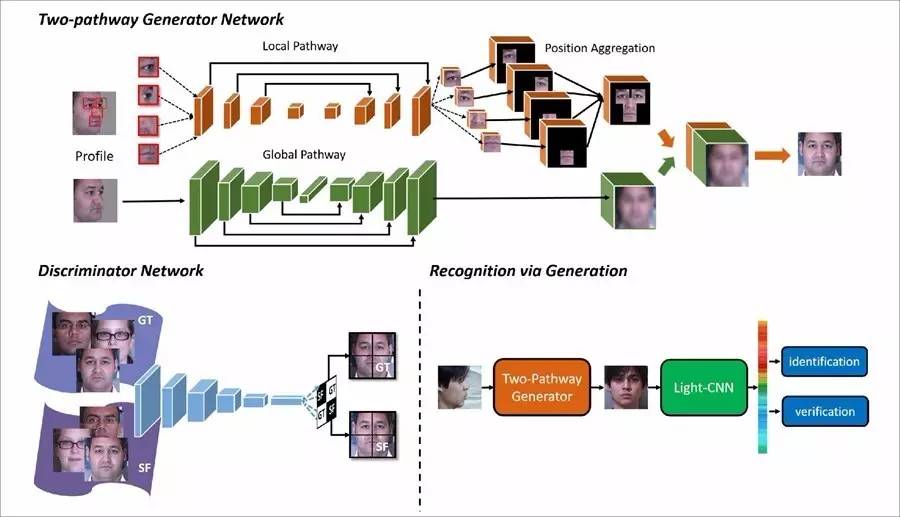

受此啟發,作者提出了一個有兩條路徑的深度架構(TP-GAN),用於正面人臉影象合成。這兩條路徑,一條專注於推理全域性結構,另一條則推理區域性的紋理,分別得到兩個特徵地圖。這兩個特徵圖會融合在一起,用於接下來的最終合成。

TP-GAN總結構示意圖。生成器包含兩個路徑,一個處理全域性資訊,一個處理區域性變換。判別器在合成的正面(SF)檢視和真實相片(GT)。

不僅如此,作者還將正面人臉分佈的資訊併入了一個生成對抗網路(GAN),由此對恢復過程進行了很好的約束。

GAN 在二維資料分佈建模方面的卓越效能(capacity)極大地改善了很多不合理的低階視覺問題,比如超解析度和修復(inpainting)。

組合多種 Loss,合成缺失部分,保留面部突出特徵

作者還根據人臉是對稱結構這一點,提出了一個對稱性損失(symmetry loss),用於補全被遮擋住的部分。

困難場景。面部特徵,包括鬍鬚、眼鏡,TP-GAN 都保留了下來。最右邊一欄,上面那張圖將臉頰恢復了出來,下面那張圖則是側面看不見額頭,但 TP-GAN 成功地將額頭恢復了出來。

為了忠實地保留一個人臉部最突出的特徵,作者在壓縮特徵空間中除了畫素級別的 L1 loss,還使用了一個感知損失(perceptual loss)。

最後,關鍵一環,將身份保留損失(identity preserving loss)整合進來,實現忠實的正面臉部合成,影象質量得到大幅提升。

TP-GAN 根據不同姿勢合成的結果。從左到右:90°、75°、45°、60°、30°和 15°。最後一欄是真實相片。

在不同的光線條件下合成的結果。上面一行是合成結果,下面一行是原始照片。

作者指出,這些影象有可能用於人臉分析的任務。

論文 | 超越臉部旋轉:使用整體和區域性感知 GAN 生成逼真、保留特徵的正面人臉影象

使用單一臉部影象合成逼真的正面臉部檢視在人臉識別領域中有著廣泛的應用。儘管此前有研究試圖從大量面部資料中尋求解決方案,也即資料驅動的深度學習方法,但這個問題仍然具有挑戰性,因為它本質上是個不合理的問題(ill-posed)。

本文提出了雙通道生成對抗網路(Two-Pathway Generative Adversarial Network,TP-GAN),通過同時感知全域性結構和區域性細節,合成逼真的正面人臉檢視。

除了常用的全域性編碼器-解碼器網路之外,論文還提出了4個定位標記的補丁網路(landmark located patch networks)處理區域性紋理。除了全新的架構,我們將這個不合理的問題進行了很好的轉化,引入了對抗性損失(adversarial loss)、對稱性損失(symmetry loss)和身份保留損失(identity preserving loss)的組合。這一損失的組合能夠利用正面臉部的分佈和預訓練識別深度臉部模型(pre-trained discriminative deep face models),指導身份保留推理從正面臉部檢視合成側面照。不同於以往的深度學習模型主要依靠中間特徵用於識別的方法,我們的方法直接利用合成的、保留身份的影象用於下游任務,比如人臉識別和歸因估計。實驗結果表明,我們的方法不僅在視覺上令人信服,也在多種人臉識別中超越了現有最佳方法。

對了,還有一開始問題的答案:左邊一欄是 TP-GAN 合成的結果。你答對了嗎?

論文地址:https://arxiv.org/pdf/1704.04086.pdf

。