關於深度優先和廣度優先

在爬蟲系統中,待抓取URL佇列是很重要的一部分,待抓取URL佇列中的URL以什麼樣的順序排佇列也是一個很重要的問題,因為這涉及到先抓取哪個頁面,後抓取哪個頁面。而決定這些URL排列順序的方法,叫做抓取策略。下面是常用的兩種策略:深度優先、廣度優先

scrapy框架預設的是深度優先演算法

深度優先與廣度優先演算法避免爬蟲執行的時候,需要返回造成資料重複

深度優先

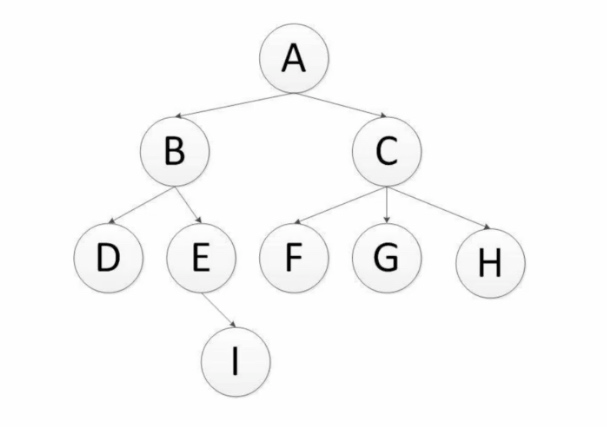

這裡是深度優先,所以這裡的爬取的順序式:

A-B-D-E-I-C-F-G-H (遞迴實現)

深度優先演算法程式碼實現(虛擬碼):

廣度優先:

廣度優先,有人也叫寬度優先,是指將新下載網頁發現的連結直接插入到待抓取URL佇列的末尾,也就是指網路爬蟲會先抓取起始頁中的所有網頁,然後在選擇其中的一個連線網頁,繼續抓取在此網頁中連結的所有網頁,通過下圖進行理解:

還是以這個圖為例子,廣度優先的爬取順序為:

A-B-C-D-E-F-G-H-I (佇列實現)

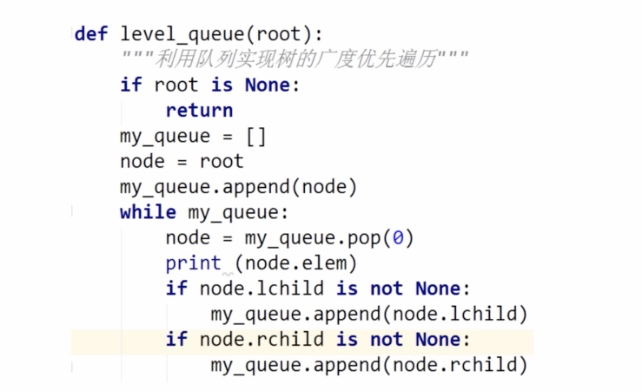

廣度優先程式碼的實現(虛擬碼):

相關推薦

深度優先和廣度優先的基礎應用

logs node con min fan step 分享 lin 判斷 圖來自啊哈算法 這裏描述的問題就是如何從1,1走到4,3 這裏有兩個解決方案,一個是用深度優先算法 初始化地圖,和標記點 int[,] ditu = new int[5,

第三篇 深度優先和廣度優先

-h oot -c 廣度優先遍歷 code 技術分享 sub depth not PS:一個網站下除了主域名,還會有多個子域名 需要通過遍歷把所有域名取到 深度優先的算法,根據上面的截圖,爬取url的順序是A--B--D--E--I---C--F-G--

圖的遍歷之深度優先和廣度優先

優先 ges sky 深度優先 們的 老師 ear blog earch 圖的遍歷之深度優先和廣度優先 深度優先遍歷 假設給定圖G的初態是所有頂點均未曾訪問過。在G中任選一頂點v為初始出發點(源點),則深度優先遍歷可定義如下:首先訪問出發點v,並將其標記為已訪問過;然後依

深度優先和廣度優先算法

後序遍歷 wid span cde 廣度 str 特殊 產生 求解 1、深度優先算法 遍歷規則:不斷地沿著頂點的深度方向遍歷。頂點的深度方向是指它的鄰接點方向。 最後得出的結果為:ABDECFHG。 Python代碼實現的偽代碼如下: 2、廣度優先算法: 遍歷規

ES優化聚合查詢之深度優先和廣度優先

策略 字段 示例 pre collect 功率 模式 二層 信息 1.優化聚合查詢示例 假設我們現在有一些關於電影的數據集,每條數據裏面會有一個數組類型的字段存儲表演該電影的所有演員的名字。 { "actors" : [ "Fred Jones"

淺談深度優先和廣度優先(scrapy-redis)

首先先談談深度優先和廣度優先的定義 深度優先搜尋演算法(英語:Depth-First-Search,DFS)是一種用於遍歷或搜尋樹或圖的演算法。沿著樹的深度遍歷樹的節點,儘可能深的搜尋樹的分支。當節點v的所在邊都己被探尋過,搜尋將回溯到發現節點v的那條邊的起始節點。這一過程一直進行到已發現從源節點可達的所有

關於深度優先和廣度優先

在爬蟲系統中,待抓取URL佇列是很重要的一部分,待抓取URL佇列中的URL以什麼樣的順序排佇列也是一個很重要的問題,因為這涉及到先抓取哪個頁面,後抓取哪個頁面。而決定這些URL排列順序的方法,叫做抓取策略。下面是常用的兩種策略:深度優先、廣度優先 scrapy框架預設的是深度優先

基於鄰接表儲存的圖的深度優先和廣度優先遍歷

一.深度優先遍歷是連通圖的一種遍歷方法: 設x是當前被訪問頂點,在對x做過訪問標記後,選擇一條從x出發的未檢測過的邊(x, y)。若發現頂點y已訪問過,則重新選擇另一條從x出發的未檢測過的邊,否則沿邊(x,y) 到達未曾訪問過的y,對y訪問並將其標記為已訪問過;

深度優先和廣度優先

.text 網頁爬蟲 none 網絡 pen parser 不錯 函數 and 準備數據結構 在進行廣度優先和深度優先查找前,先定義一個數據結構。這裏我用二叉樹,每個節點的定義如下: class Node(object): def __init__(self, it

C++ 圖的鄰接矩陣表示以及深度優先和廣度優先遍歷

Node.h 宣告頂點類 #pragma once class Node { public: Node(char data=0); char m_cData; bool m_bIsVisited; }; Node.cpp 實現頂點的成員以及操作函式 #incl

10、【資料結構】圖之深度優先和廣度優先搜尋

一、深度優先搜尋 1、深度優先搜尋介紹 圖的深度優先搜尋(Depth First Search),和樹的先序遍歷比較類似。 它的思想:假設初始狀態是圖中所有頂點均未被訪問,則從某個頂點v出發,首先訪問該頂點,然後依次從它的各個未被訪問的鄰接點出發

C# 尋路,深度優先和廣度優先

using System; namespace helloWorld { public class FindingWay { int min = 99999; public int Min { get { re

python 圖的遍歷-深度優先和廣度優先

Python的圖實現有很多別人已經寫好的(比如我下面寫的就是參考python-graph),可是不適合一個剛開始的學習的人,我就簡化了一下,實現可深度優先和廣度優先遍歷。 #!/usr/bin/env python #-*- coding:utf8 -*- clas

python 圖 遍歷-深度優先和廣度優先 II

在上一篇(python 圖 遍歷-深度優先和廣度優先)的程式碼上加了最小生成樹和拓撲序列功能。程式碼如下: #!/usr/bin/env python #-*- coding:utf8 -*- import copy class Graph(object):

圖的深度優先和廣度優先搜尋演算法

#include<stdio.h> #include<stdlib.h> #include<string.h> #define MaxVertexNum 100 //佇列的宣告 typedef struct Qnode { int da

深度優先和廣度優先遍歷迷宮

package didi; import java.util.Stack; /** * 深度優先迷宮問題 {{1,1,0,1}, {1,1,0,1}, {0,1,1,1}, {0,0,1,1}}; {1,1,1,0,1}, {1,0,1,0,1}, {1,0,1,1

Python爬蟲從入門到放棄(十)之 關於深度優先和廣度優先

網站的樹結構深度優先演算法和實現廣度優先演算法和實現網站的樹結構通過伯樂線上網站為例子:並且我們通過訪問伯樂線上也是可以發現,我們從任何一個子頁面其實都是可以返回到首頁,所以當我們爬取頁面的資料的時候就會涉及到去重的問題,我們需要將爬過的url記錄下來,我們將上圖進行更改在爬蟲系統中,待抓取URL佇列是很重要

用深度優先和廣度優先遍歷資料夾下符合條件的檔案

第一步:需要有一個萬能過濾器:MyFileFilter.java package com.ten.practice.test15; import java.io.File; import jav

資料結構--圖的理解:深度優先和廣度優先遍歷及其 Java 實現

遍歷 圖的遍歷,所謂遍歷,即是對結點的訪問。一個圖有那麼多個結點,如何遍歷這些結點,需要特定策略,一般有兩種訪問策略: 深度優先遍歷廣度優先遍歷 深度優先 深度優先遍歷,從初始訪問結點出發,我們知道初始訪問結點可能有多個鄰接結點,深度優先遍歷的策略就是首先訪問第一個

圖的深度優先和廣度優先演算法(DFS遞迴與非遞迴)

本部落格前面文章已對圖有過簡單的介紹,本文主要是重點介紹有關圖的一些具體操作與應用 無向圖——鄰接矩陣的深度優先和廣度優先演算法實現 測試環境:VS2008(C) #include "st