tensorflow基礎學習之排錯:tensorflow.python.framework.errors_impl.ResourceExhaustedError

在搭建卷積神經網路中出現了ResourceExhaustedError錯誤。

ResourceExhaustedError:資源耗盡錯誤

- 意思就是可以用的電腦資源不足以運算整個網路,gpu記憶體不夠

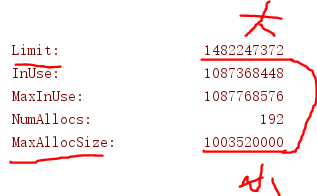

- 如下圖:最小需要 1482247372個位元組,而我的電腦最大隻可以提供:1003520000位元組。

解決辦法:

- 簡化卷積神經網路,使用更加少的神經元訓練,減少特徵,減少卷積核心等

- 土豪解決辦法,更換效能更加好的顯示卡

相關推薦

tensorflow基礎學習之排錯:tensorflow.python.framework.errors_impl.ResourceExhaustedError

在搭建卷積神經網路中出現了ResourceExhaustedError錯誤。 ResourceExhaustedError:資源耗盡錯誤 意思就是可以用的電腦資源不足以運算整個網路,gpu記憶體不夠 如下圖:最小需要 1482247372個位元組,而我的電腦最大隻可以提

Tensorflow深度學習之十四:Tensorflow變數管理

宣告:本篇文章參考《Tensorflow實戰Google深度學習框架》一書 Tensorflow提供了通過變數名稱來建立或者獲取一個變數的機制。通過這個機制,在不同的函式中可以直接通過變數的名字來使用變數,而不需要將變數通過引數的形式到處傳遞。 Tensor

Tensorflow深度學習之十二:基礎圖像處理之二

fcm 數字 ssi port con tty .net term file Tensorflow深度學習之十二:基礎圖像處理之二 from:https://blog.csdn.net/davincil/article/details/76598474 首先放出

Tensorflow深度學習之十二:基礎影象處理之二

首先放出原始影象: 1、影象的翻轉 import tensorflow as tf import cv2 # 這裡定義一個tensorflow讀取的圖片格式轉換為opencv讀取的圖片格式的函式 # 請注意: # 在tensorflow中,一個畫素

Tensorflow深度學習之十一:基礎影象處理

OpenCV是一個十分強大的視覺庫,tensorflow也提供了十分強大的圖片處理函式,下面是一個簡單的例子來說明使用tensorflow和opencv兩個工具進行深度學習程式的設計。 首先是使用的原始圖片: import tensorflow as

Tensorflow深度學習之三十三:tf.scatter_update

一、tf.scatter_update tf.scatter_update( ref, indices, updates, use_locking=True, name=None ) Applies sparse

Tensorflow深度學習之十九:矩陣切片與連結

1、TensorFlow矩陣切片操作:tf.slice函式 函式原型:slice(input_, begin, size, name=None) 引數: input:待切片的矩陣tensor。 begin:起始位置,表示從哪一個資料開始進行切片。這個起始

tensorflow 基礎學習五:MNIST手寫數字識別

truncate averages val flow one die correct 表示 data MNIST數據集介紹: from tensorflow.examples.tutorials.mnist import input_data # 載入MNIST數據集,

tensorflow 基礎學習七:模型的持久化

log meta oba 運算 int sig sha 自動 add tf.train.Saver類的使用 保存模型: import tensorflow as tf v1=tf.Variable(tf.constant(1.0,shape=[1]),name=‘v1

tensorflow 基礎學習八:重構MNIST神經網絡

sta pen 正則化 gpo 第一次 one spl post sse 使用前面介紹的技術,實踐一個神經網絡模型。將訓練和測試分成兩個獨立的程序,訓練網絡的程序可以持續輸出訓練好的模型,測試程序可以每隔一段時間檢驗最新模型的正確率。 # -*- coding:ut

tensorflow基礎學習:字元數字驗證碼寫入tfrecord檔案封裝成類

今天分享一下我寫的一個小小程式,基本可以滿足數字+字元型別字串寫入tfrecord檔案。還請多多指教! 簡單說明:這個是數字+字元4位驗證碼的tfrecord生成程式碼,5位,6位的可以自行修改一下,也就一點程式碼。我因為有點晚了就先不改了,大家加油啦。 先做些準備工作。

機器學習之神經網路:離線安裝tensorflow

Python學習中安裝方面是一個大坑,後面我會把所有的安裝過程都總結下來,這裡先推送一個tensorflow的安裝,大家不用慌,按照下面的過程一步一步來. 1、 準備工作 電腦安裝好anaconda,python(python,我是強烈推薦使用anaconda,

Python與自然語言處理(三):Tensorflow基礎學習

看了一段時間的TensorFlow,然而一直沒有思路,偶然看到一個講解TensorFlow的系列 視訊,通俗易懂,學到了不少,在此分享一下,也記錄下自己的學習過程。 教學視訊連結:點這裡 在機器學習中,常見的就是分類問題, 郵件分類,電影分類 等等 我這裡使用iris的

Tensorflow深度學習之七:再談mnist手寫數字識別程式

之前學習的第一個深度學習的程式就是mnist手寫字型的識別,那個時候對於很多概念不是很理解,現在回過頭再看當時的程式碼,理解了很多,現將加了註釋的程式碼貼上,與大家分享。(本人還是在學習Tensorflow的初始階段,如果有什麼地方理解有誤,還請大家不吝指出。)

Tensorflow深度學習之二十一:LeNet的實現(CIFAR-10資料集)

一、LeNet的簡介 LeNet是一個用來識別手寫數字的最經典的卷積神經網路,是Yann LeCun在1998年設計並提出的。Lenet的網路結構規模較小,但包含了卷積層、池化層、全連線層,他們都構成了現代CNN的基本元件。 LeNet包含輸入層在內共有

Tensorflow深度學習之二十二:AlexNet的實現(CIFAR-10資料集)

二、工程結構 由於我自己訓練的機器記憶體視訊記憶體不足,不能一次性讀取10000張圖片,因此,在這之前我按照圖片的類別,將每一張圖片都提取了出來,儲存成了jpg格式。與此同時,在儲存圖片的過程中,儲存了一個python的dict結構,鍵為每一張圖片的相對地

Tensorflow深度學習之二十七:tf.nn.conv1d

一、conv1d 在NLP領域,甚至影象處理的時候,我們可能會用到一維卷積(conv1d)。所謂的一維卷積可以看作是二維卷積(conv2d)的簡化,二維卷積是將一個特徵圖在width和height兩個方向上進行滑窗操作,對應位置進行相乘並求和;而一維卷積則

Tensorflow深度學習之三十二: tf.scatter_nd_update

一、tf.scatter_nd_update 函式定義: tf.scatter_nd_update( ref, indices, updates, use_locking=True, name=None )

Tensorflow深度學習之五:啟用函式

啟用函式的作用 在神經網路中,啟用函式的作用是能夠給神經網路加入一些非線性因素,使得神經網路可以更好地解決較為複雜的問題。 我們嘗試引入非線性的因素,對樣本進行分類。 在神經網路中也類似,我們需要引入一些非線性的因素,來更好地解決複雜的問題。而啟用函式恰好

深度學習框架哪家強:TensorFlow?Caffe?MXNet?Keras?PyTorch?

能夠 平臺 false 對稱 寫到 python form 演示 有一個 深度學習框架哪家強:TensorFlow?Caffe?MXNet?Keras?PyTorch?對於這幾大框架在運行各項深度任務時的性能差異如何,各位讀者不免會有所好奇。 微軟數據科學家Ili