hadoop叢集安裝前環境的配置

1.1增加hadoop使用者

一)建立一個admin使用者

[[email protected] home]# adduser hadoop

沒輸出?沒有輸出在linux下就是操作正確

(二)為admin使用者設定密碼

[[email protected] home]# passwd hadoop Changing password for user admin. New password: Retype new password: passwd: all authentication tokens updated successfully.

(三)對新hadoop使用者進行sudo操作的授權

因為sudo命令是在sudoers檔案中的,我們看一下sudoers檔案

[[email protected] home]# sudoers

-bash: sudoers: command not found

(四) 查詢sudoers檔案所在

[[email protected] home]# whereis sudoers

sudoers: /etc/sudoers /etc/sudoers.d /usr/share/man/man5/sudoers.5.gz

(五)檢視一下檔案的許可權

[[email protected]

可以看到只有只讀的許可權,這時候我們要加入一個可寫的(w)的許可權

(六)加入可寫的許可權

[[email protected] home]# chmod -v u+w /etc/sudoers

mode of ‘/etc/sudoers’ changed from 0440 (r--r-----) to 0640 (rw-r-----)

(七)把hadoop使用者新增到sudoers中

[[email protected]

## Allow root to run any commands anywher

root ALL=(ALL) ALL

hadoop ALL=(ALL) ALL #新增hadoop使用者

(八)wq儲存,然後把sudoers檔案許可權改回去,畢竟這是一個重要的檔案

[[email protected] home]# chmod -v u-w /etc/sudoers

mode of ‘/etc/sudoers’ changed from 0640 (rw-r-----) to 0440 (r--r-----)

(九)測試新使用者admin進行登陸,使用su admin操作:

[[email protected] admin]# su admin

[[email protected] ~]$

---------------------

作者:xudailong_blog

來源:CSDN

原文:https://blog.csdn.net/xudailong_blog/article/details/80518266

版權宣告:本文為博主原創文章,轉載請附上博文連結!

1.2同步時間

[[email protected] root]$ date

Mon Oct 22 15:28:57 CST 2018

檢視後沒問題,跳過

1.3修改主機名稱(另外兩臺相同方法設定)

(1)檢視本機的主機名,使用如下三個命令中任意一個即可

# hostname

# uname -n

# cat /proc/sys/kernel/hostname

使用 vi 編輯器開啟 /etc/hostname 檔案

# vi /etc/hostname

刪除檔案中原有內容,新增內容主機名:hdp-node-01,儲存退出

(2).設定主機名及IP對映

使用 vi 編輯器開啟 /etc/hosts 檔案

# vi /etc/hosts

在檔案尾部新增內容,格式:IP地址 主機名(中間用空格分隔),儲存退出

192.168.242.130 hdp-node-01

設定完成後,重啟網路服務

# systemctl restart network

使用 ping 命令 ping 主機名

# ping hdp-node-02

如果可以ping 通,表示設定成功

---------------------

作者:HG_Harvey

來源:CSDN

原文:https://blog.csdn.net/HG_Harvey/article/details/74216759

版權宣告:本文為博主原創文章,轉載請附上博文連結!

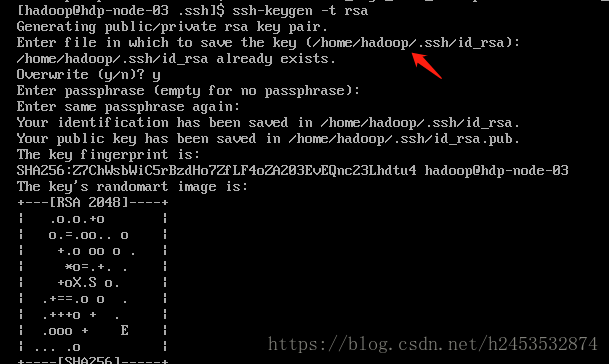

1.4配置ssh免密登陸(以hdp-node-01免密登陸hdp-node-02為例)

(1)在hadoop01機器上生成公私鑰

執行以下命令後,如果提示,就一直按“Enter”鍵,直至生成公鑰

1.在root使用者下生成祕鑰

su root

ssh-keygen -t rsa

執行完成後會生成兩個檔案id_rsa、id_rsa.pub

(2)把公鑰複製到需要免密登入的伺服器hadoop2

id_rsa.pub檔案就是公鑰,執行命令複製到hadoop2

scp id_rsa.pub [email protected]:/root/.ssh/authorized_keys_from_hadoop1hadoop2上/root/.ssh/authorized_keys_from_hadoop1檔案的內容就是id_rsa.pub的內容

(3)將公鑰加到hadoop2的authorized_keys檔案中

1. 登入到hadoop02伺服器進入./ssh目錄

cd root/.ssh

2. 將客戶端傳送來的公鑰檔案進行合併

cat authorized_keys_from_hadoop1 >> authorized_keys

說明:如果authorized_keys不存在就會自動建立,如果存在就會追加

(4)驗證

配置免登入完成後,在本機中輸入“ssh hadoop2” 或者 “ssh [email protected]” 。

* 如果無需輸入密碼,則表示配置免登入成功。

* 如果仍需要輸入密碼,則可能是.ssh目錄和檔案許可權需要修改。

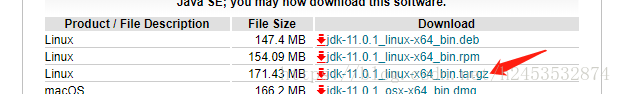

1.5安裝配置jdk

(1)先去官網下jdk檔案到你的Windows系統,因為wget命令無法用。(注意你的linux是64位還是32位)

(2)上傳檔案有很多種方法,我們這裡採用最簡單的 lrzsz

首先linux上安裝lrzsz

yum install lrzsz上傳檔案,輸入命令執行後彈框裡選擇要上傳的檔案,上傳的檔案在當前目錄下

#rz 解壓檔案

tar -zxvf jdk-linux-x64.tar.gz配置環境變數

vim /etc/profile

新增如下內容:JAVA_HOME根據實際目錄來

export JAVA_HOME=/usr/java/jdk1.8.0_161

export PATH=$PATH:$JAVA_HOME/bin

最後應用改變並測試安裝

#source /etc/profile

#java -version1.6安裝配置hadoop

(1)下載上傳hadoop二進位制檔案到 /user 目錄下

(2)解壓並重命名

tar -zxvf hadoop-2.7.7.tar.gz

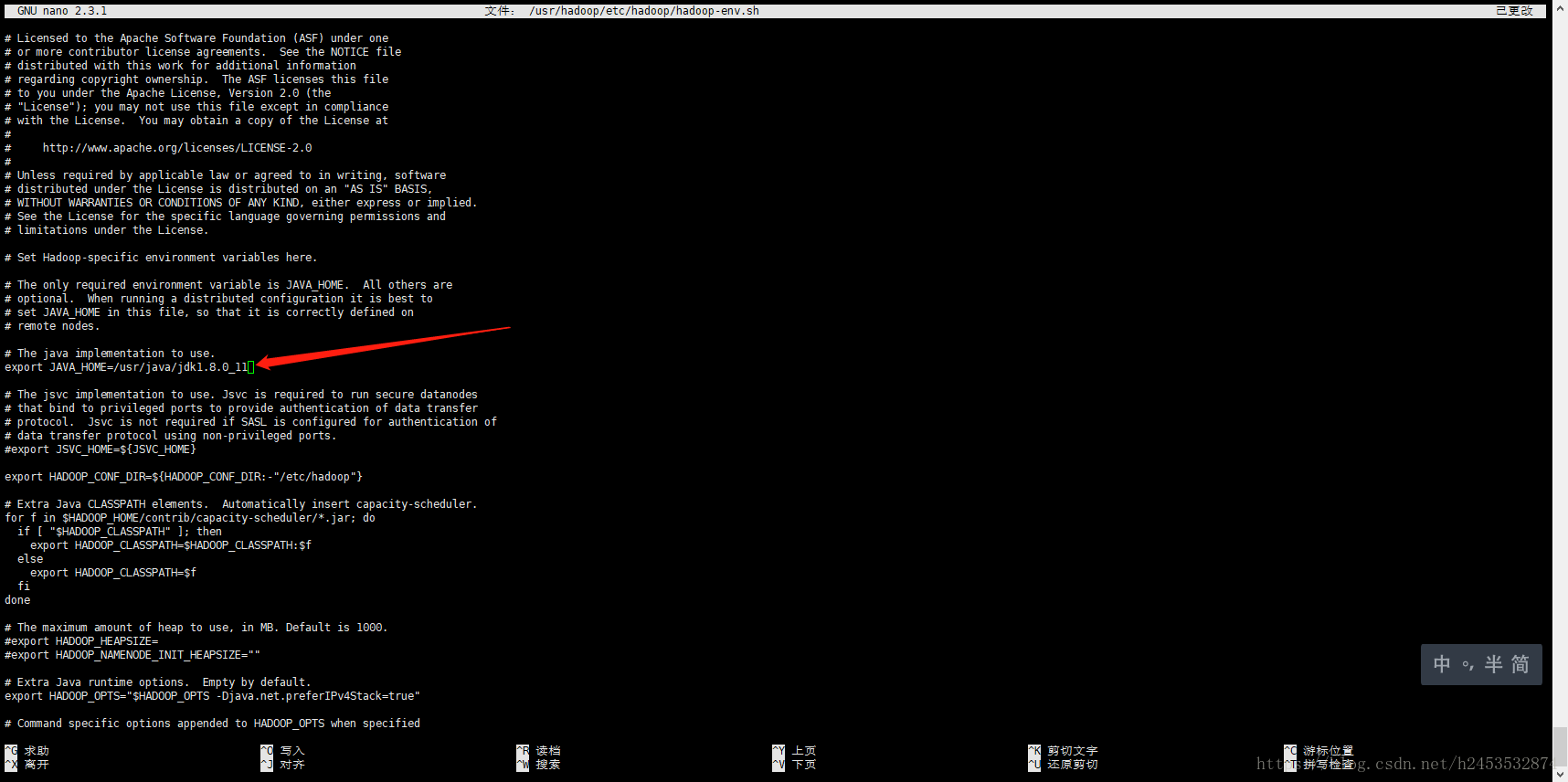

mv hadoop-2.7.7 hadoop(3)配置java環境hadoop-env.sh檔案

nano /usr/hadoop/etc/hadoop/hadoop-env.sh

(4).配置core-site.xml檔案

nano /usr/hadoop/etc/hadoop/core-site.xml新增

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop-01:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/hadoop</value>

</property>

</configuration>(5)配置hdfs-site.xml檔案

nano /usr/hadoop/etc/hadoop/hdfs-site.xml配置以下內容

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop-02:50090</value>

</property>

<property>

<name>dfs.namenode.secondary.https-address</name>

<value>hadoop-02:50091</value>

</property>

</configuration>

(6)配置datenode(主節點)

cd /usr/hadoop/etc/hadoop/

nano slaves刪除 localhost 增加以下內容

hadoop-02

hadoop-03

(7)在/usr/hadoop/etc/hadoop/下新建masters檔案

nano masters

新增以下內容

hadoop-01(8)刪除/usr/hasoop/share/doc/內容

rm -rf /usr/hadoop/share/doc/

(9)配置完畢的hadoop資料夾copy到其節點

scp -r /usr/hadoop [email protected]:/usr/

scp -r /usr/hadoop [email protected]:/usr/

(10)格式化namenode節點

nano /etc/profile

結尾處新增

export HADOOP_HOME=/usr/hadoop

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

儲存檔案後,使環境生效

source /etc/profile

hdfs namenode -format

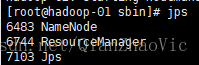

1.7啟動hadoop叢集

(1)在namenode節點啟動hdfs

bash start-all.sh

(2)檢視相關程序

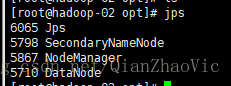

hadoop-01節點

hadoop-02節點

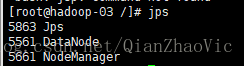

hadoop-03節點

9、網頁驗證

ECS例項安全組開飯50070埠許可權(由於使用阿里雲ECS)

在瀏覽器輸入如下:

http://namenodeIP地址:50070